Was ist Computer Vision? Die kurze Antwort

Computer Vision bringt Maschinen das Sehen bei. Nicht im Sinne von „ein Bild aufnehmen“ – das kann jede Webcam. Sondern im Sinne von verstehen, was auf einem Bild zu sehen ist.

Stell dir vor, du zeigst einem Kind ein Foto von einem Hund im Park. Das Kind erkennt sofort: Da ist ein Hund, er steht auf einer Wiese, im Hintergrund sind Bäume. Für einen Computer ist dasselbe Foto zunächst nichts weiter als eine riesige Tabelle voller Zahlen. Computer Vision ist die Technologie, die aus diesen Zahlen Bedeutung macht.

Während klassische Bildverarbeitung Bilder nur manipuliert – heller machen, Rauschen entfernen, komprimieren – geht Computer Vision einen entscheidenden Schritt weiter. Sie interpretiert den Inhalt. Sie erkennt Objekte, versteht räumliche Zusammenhänge und leitet handlungsrelevante Informationen ab.

Drei Prozesse stehen dabei im Zentrum: Erkennung (Was ist im Bild?), Rekonstruktion (Wie sieht die 3D-Szene aus?) und Reorganisation (Wie hängen die erkannten Elemente zusammen?).

Was „sieht“ ein Computer wirklich? Bilder als Zahlen

Pixel, Matrizen und das RGB-Farbmodell

Für dich ist ein Foto ein Motiv. Für einen Computer ist es ein Zahlenraster.

Jedes digitale Bild besteht aus winzigen Bildpunkten – den Pixeln. Bei einem Graustufenbild trägt jedes Pixel einen Wert zwischen 0 (Schwarz) und 255 (Weiß). Ein Bild mit 100 × 100 Pixeln ist also eine Tabelle mit 10.000 Zahlenwerten.

Bei Farbbildern wird es dreidimensional. Das RGB-Farbmodell (Rot, Grün, Blau) speichert für jedes Pixel drei Werte – einen pro Farbkanal. Ein 100 × 100 Pixel großes Farbbild hat damit die Dimension 100 × 100 × 3. Jedes Pixel wird durch einen Dreiervektor beschrieben: [Rot, Grün, Blau].

Die Mischung ergibt den Farbeindruck: [255, 0, 0] ist reines Rot, [255, 255, 0] ergibt Gelb, [0, 0, 0] ist Schwarz. Fun Fact: Die Bildverarbeitungsbibliothek OpenCV speichert die Kanäle standardmäßig in der Reihenfolge BGR statt RGB – eine historische Eigenheit, die bis heute Programmierer stolpern lässt.

Die semantische Lücke – warum Sehen für Maschinen so schwer ist

Hier liegt das Kernproblem: Ein einzelner Pixelwert sagt fast nichts über den Bildinhalt aus. Ein graues Pixel könnte Teil einer Straße sein, eines Elefanten oder eines bewölkten Himmels. Erst der Kontext – die Beziehung zu den umliegenden Pixeln – erzeugt Bedeutung.

Diese Diskrepanz zwischen rohen Pixelwerten und dem, was wir Menschen darin erkennen, nennt die Fachwelt die semantische Lücke (Semantic Gap). Wenn du ein Foto eines Sonnenuntergangs siehst, denkst du an Wärme und Abendstimmung. Der Computer sieht eine Matrix aus Zahlenwerten.

Fünf Faktoren machen das Schließen dieser Lücke besonders schwer:

- Beleuchtungsvarianz: Ein roter Apfel kann im Schatten fast schwarz aussehen und im Gegenlicht weiß glänzen. Trotzdem ist es derselbe Apfel.

- Perspektive und Verformung: Ein Teller ist von oben rund, von der Seite eine Ellipse. Eine Katze verändert ihre Form, je nachdem ob sie sich streckt oder zusammenrollt.

- Verdeckung: In der realen Welt sind Objekte selten komplett sichtbar. Ein Auto im Stadtverkehr wird von Fußgängern, Bäumen und anderen Fahrzeugen verdeckt.

- Hintergrund-Clutter: Objekte müssen vor komplexen Hintergründen erkannt werden, die ähnliche Farben oder Texturen aufweisen.

- Intra-Klassen-Variation: Ein Holzschemel und ein gepolsterter Fernsehsessel sehen völlig verschieden aus – und sind trotzdem beides „Stühle“.

Zum Vergleich: Ein Mensch öffnet die Augen und erfasst mühelos eine ganze Szene. Wir erkennen Gesichter in der Menge, schätzen Entfernungen ab und ergänzen verdeckte Objektteile automatisch. Unser visuelles System ist über Millionen Jahre evolutionär optimiert und tief in Erfahrung, Weltwissen und physikalisches Verständnis eingebettet. Maschinen müssen sich all das mühsam antrainieren.

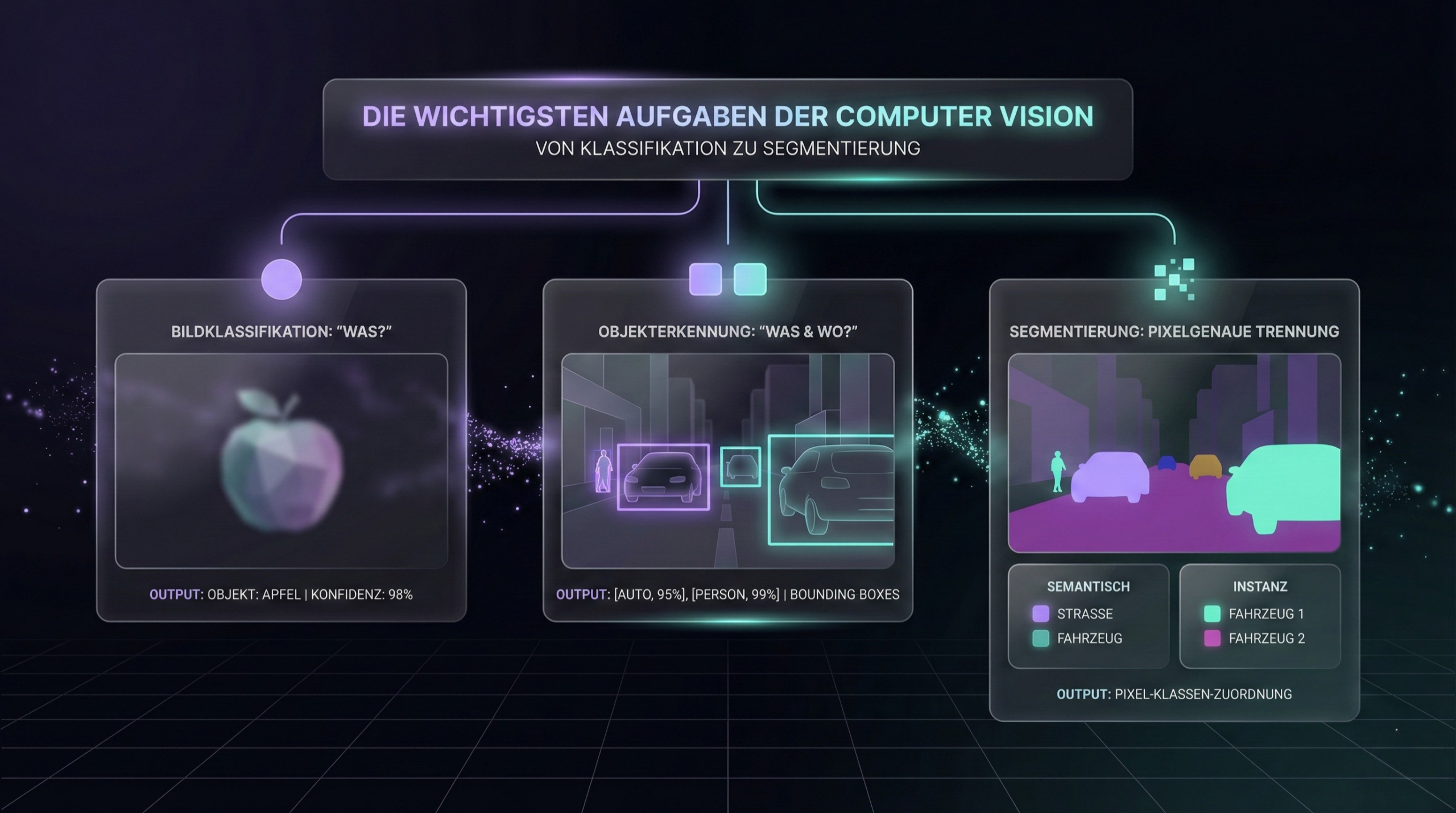

Die wichtigsten Aufgaben der Computer Vision

Computer Vision ist kein einzelnes Problem, sondern ein ganzes Feld mit unterschiedlichen Aufgabenstellungen. Jede stellt eine andere Frage an das Bildmaterial.

Gerade wenn dich die Unterscheidung zwischen KI, Machine Learning und Deep Learning beschäftigt, schärfst du dein Fundament mit dem Überblick zu KI vs. Machine Learning vs. Deep Learning – die Unterschiede einfach erklärt.

Bildklassifikation – „Was ist auf dem Bild?“

Die einfachste Frage: Das System bekommt ein Bild und wählt aus einer Liste von Kategorien die wahrscheinlichste aus.

Du zeigst ihm ein Foto eines Golden Retrievers, es antwortet: „Hund“ – mit einer Konfidenz von 98 %. Das gesamte Bild wird als Ganzes betrachtet. Wo genau der Hund sitzt oder ob im Hintergrund noch eine Katze steht, spielt keine Rolle. Es zählt nur die dominante Klasse.

Objekterkennung – „Was ist wo?“

Die Objekterkennung geht einen Schritt weiter. Sie identifiziert nicht nur, was im Bild ist, sondern auch wo.

Das System zeichnet sogenannte Bounding Boxes (Begrenzungsrahmen) um jedes erkannte Objekt. Bei einem Straßenfoto etwa: eine Box um ein Auto mit dem Label „Auto, 95 %“, eine weitere um einen Fußgänger mit „Person, 99 %“.

Das ist entscheidend für Systeme, die mit der physischen Welt interagieren. Ein selbstfahrendes Auto muss wissen, ob sich ein Hindernis links oder rechts befindet. Moderne Algorithmen wie YOLO (You Only Look Once) schaffen diese Erkennung in Echtzeit für Dutzende Objekte gleichzeitig.

Segmentierung – pixelgenaue Trennung

Die Segmentierung treibt die Präzision auf die Spitze. Statt grober Boxen ordnet sie jedem einzelnen Pixel eine Klasse zu.

Zwei Varianten sind hier wichtig:

| Art | Was sie macht | Beispiel |

|---|---|---|

| Semantische Segmentierung | Ordnet jedem Pixel eine Klasse zu (z. B. „Himmel“, „Straße“, „Auto“). Unterscheidet nicht zwischen einzelnen Objekten derselben Klasse. | Analyse von Luftbildern: Wald vs. Stadt |

| Instanz-Segmentierung | Trennt zusätzlich individuelle Objekte derselben Klasse. „Auto 1″ wird von „Auto 2″ unterschieden. | Autonomes Fahren: Unterscheidung einzelner Fahrzeuge |

Gesichtserkennung, Pose Estimation und OCR

Neben den drei Hauptaufgaben gibt es spezialisierte Disziplinen:

Gesichtserkennung verläuft in einer Kaskade: Erst wird das Gesicht im Bild gefunden (Detection), dann ausgerichtet (Alignment), anschließend werden einzigartige Merkmale wie Augenabstand und Wangenknochenform in einen numerischen Vektor umgewandelt (Faceprint). Dieser Vektor wird mit einer Datenbank abgeglichen – entweder zur Verifikation („Ist das Person X?“) oder zur Identifikation („Wer ist das?“).

Pose Estimation abstrahiert den menschlichen Körper auf ein Skelettmodell. Das System identifiziert Schlüsselpunkte wie Ellbogen, Knie und Schultern und schließt aus deren relativer Position auf die Körperhaltung. Sitzt die Person? Rennt sie? Winkt sie? Das wird in der Sportanalyse, Physiotherapie und gestengesteuerten Interaktion eingesetzt.

OCR (Optical Character Recognition) ist die Brücke zwischen Bild und Text. Moderne Deep-Learning-OCR-Systeme können auch verzerrte, unscharfe oder handschriftliche Texte in natürlichen Umgebungen entziffern – auf Straßenschildern, T-Shirts oder handgeschriebenen Notizen.

Wie funktioniert das technisch? CNNs und Vision Transformer

Hinter den Fähigkeiten der Computer Vision stecken zwei zentrale Architekturen: Convolutional Neural Networks (CNNs) und Vision Transformer (ViT). Beide verfolgen unterschiedliche Ansätze, um aus Pixeln Bedeutung zu extrahieren.

Convolutional Neural Networks (CNNs): Filter, die sehen lernen

CNNs sind die Architektur, die Computer Vision aus dem Forschungslabor in den Alltag gebracht hat. Ihre Grundidee ist biologisch inspiriert – von der Struktur des visuellen Kortex, wie ihn die Neurowissenschaftler Hubel und Wiesel beschrieben haben.

Das Problem klassischer neuronaler Netze: Sie behandeln jeden Pixel isoliert und verbinden ihn mit jedem Neuron der nächsten Schicht. Bei Bildern führt das zu einer Explosion der Rechenlast und zum Verlust räumlicher Information.

CNNs lösen das durch Faltung (Convolution). Statt das ganze Bild auf einmal zu verarbeiten, scannt ein kleines Fenster – der Filter oder Kernel – das Bild Stück für Stück ab. Typisch ist ein 3×3-Raster aus Zahlenwerten. An jeder Position multipliziert der Filter seine Werte mit den darunterliegenden Pixelwerten und summiert das Ergebnis zu einer einzigen Zahl.

Wer verstehen möchte, warum CNNs so leistungsfähig sind, sollte auch wissen, wie neuronale Netze generell lernen. Eine solide Basis bekommst du mit der Einführung „Wie lernt KI? Einfache Erklärung für Einsteiger“.

Das Resultat: eine Feature Map (Merkmalskarte), die zeigt, wo im Bild ein bestimmtes Muster gefunden wurde.

Das Revolutionäre daran: Diese Filter werden nicht von Menschen programmiert. Das Netzwerk lernt während des Trainings selbstständig, welche Zahlenwerte in den Filtern stehen müssen. Ein Filter lernt vielleicht, vertikale Kanten zu erkennen. Ein anderer reagiert auf Farbübergänge. In einem CNN arbeiten Hunderte solcher spezialisierten Filter parallel.

Von Kanten zu Konzepten – die Hierarchie der Schichten

CNNs sind „deep“ (tief), weil sie viele Filterschichten hintereinanderstapeln. Dadurch entsteht eine Hierarchie der Abstraktion:

- Frühe Schichten reagieren auf primitive Muster: Kanten, Linien, Ecken, Farbflecken. Noch nichts Objektspezifisches.

- Mittlere Schichten kombinieren diese Grundmuster. Aus Linien werden Formen, aus Kanten Texturen. Das Netz beginnt, Teile von Objekten zu erkennen – ein Auge, einen Reifen, ein Blatt.

- Tiefe Schichten setzen die Teile zusammen. Das Netz erkennt ganze Gesichter, Autokarosserien oder Hunderassen.

Zwischen den Faltungsschichten sitzen oft Pooling-Schichten. Beim Max Pooling wird aus einem kleinen Bereich (z. B. 2×2 Pixel) nur der höchste Wert übernommen. Das reduziert die Datenmenge und macht das Netz toleranter gegenüber kleinen Verschiebungen. Ob das Auge eines Hundes einen Pixel weiter links oder rechts sitzt, spielt keine Rolle – solange das Feature „Auge“ in der groben Region stark aktiviert wird. Das nennt man Translationsinvarianz.

Falls du dich konkret für Bildgeneratoren interessierst, verschafft dir der Vergleich von KI-Bildgeneratoren wie Midjourney, OpenAI und Leonardo AI einen praxisnahen Überblick.

Vision Transformer (ViT): Das Bild als „Satz“

Seit etwa 2020 mischt eine zweite Architektur das Feld auf: der Vision Transformer (ViT). Ursprünglich wurde die Transformer-Architektur für Sprachverarbeitung entwickelt – sie steckt hinter Modellen wie GPT und BERT. Forscher fanden einen Weg, sie auf Bilder zu übertragen.

Der Trick: Das Bild wird in kleine quadratische Flicken zerschnitten – sogenannte Patches (z. B. 16×16 Pixel). Diese Patches werden in Vektoren umgewandelt und hintereinandergereiht. Für den Transformer ist ein Bild damit nichts anderes als ein „Satz“ aus „Bild-Wörtern“.

Der entscheidende Mechanismus heißt Self-Attention (Selbstaufmerksamkeit). Während ein CNN immer nur die lokale Nachbarschaft eines Pixels betrachtet (begrenzt durch die Filtergröße), kann der Transformer Beziehungen zwischen allen Patches gleichzeitig berechnen. Er „fragt“: Wie stark hängt der Patch oben links mit dem Patch unten rechts zusammen?

Das gibt dem ViT ein globales Sichtfeld ab der allerersten Schicht. Er erkennt weitreichende Zusammenhänge, ohne sich erst durch viele Schichten vorarbeiten zu müssen.

CNN vs. ViT im Vergleich

| Merkmal | CNN | Vision Transformer (ViT) |

|---|---|---|

| Sichtweise | Lokal: Fokussiert auf Details und Nachbarschaften | Global: Erfasst das große Ganze sofort |

| Datenhunger | Moderat – lernt auch mit kleineren Datensätzen gut, da Vorwissen über Bildstrukturen eingebaut ist | Enorm – braucht riesige Datenmengen, übertrifft dann aber oft CNNs |

| Rechenaufwand | Effizienter bei hochauflösenden Bildern und Echtzeitanwendungen | Rechenintensiv, aber extrem skalierbar |

| Typischer Einsatz | Mobile Apps, Edge Devices, begrenzte Daten | Foundation Models, multimodale KI, große Cloud-Modelle |

Der aktuelle Trend geht zu hybriden Architekturen, die die Effizienz von CNNs mit der globalen Sicht von ViTs kombinieren.

Computer Vision ist längst nicht mehr auf Bilder beschränkt. Moderne Systeme kombinieren Text, Bild und Audio in einem Modell. Wenn du sehen willst, wie diese Verschmelzung funktioniert, findest du im Beitrag zu multimodalen KI-Modellen, die sehen, hören und sprechen die passende Vertiefung.

Quellen und weitere Infos:

- OpenCV Official Site – (Die weltweit führende Open-Source-Bibliothek bietet umfassende Dokumentationen und Tools für die Echtzeit-Bildverarbeitung und Computer Vision.)

- Google Research: Transformers for Image Recognition – (In diesem Blogpost wird der Vision Transformer (ViT) vorgestellt, der die Bildverarbeitung durch Mechanismen aus der Sprachverarbeitung grundlegend verändert hat.)

- IBM: Was ist Computer Vision? – (Diese Ressource bietet einen fundierten Überblick über die technologischen Grundlagen, die Geschichte und die wirtschaftlichen Anwendungsbereiche der Bilderkennung.)

- YOLO: Real-Time Object Detection – (Die offizielle Projektseite des YOLO-Algorithmus dokumentiert die Entwicklung und Leistungsfähigkeit einer der schnellsten Architekturen für die Objekterkennung.)