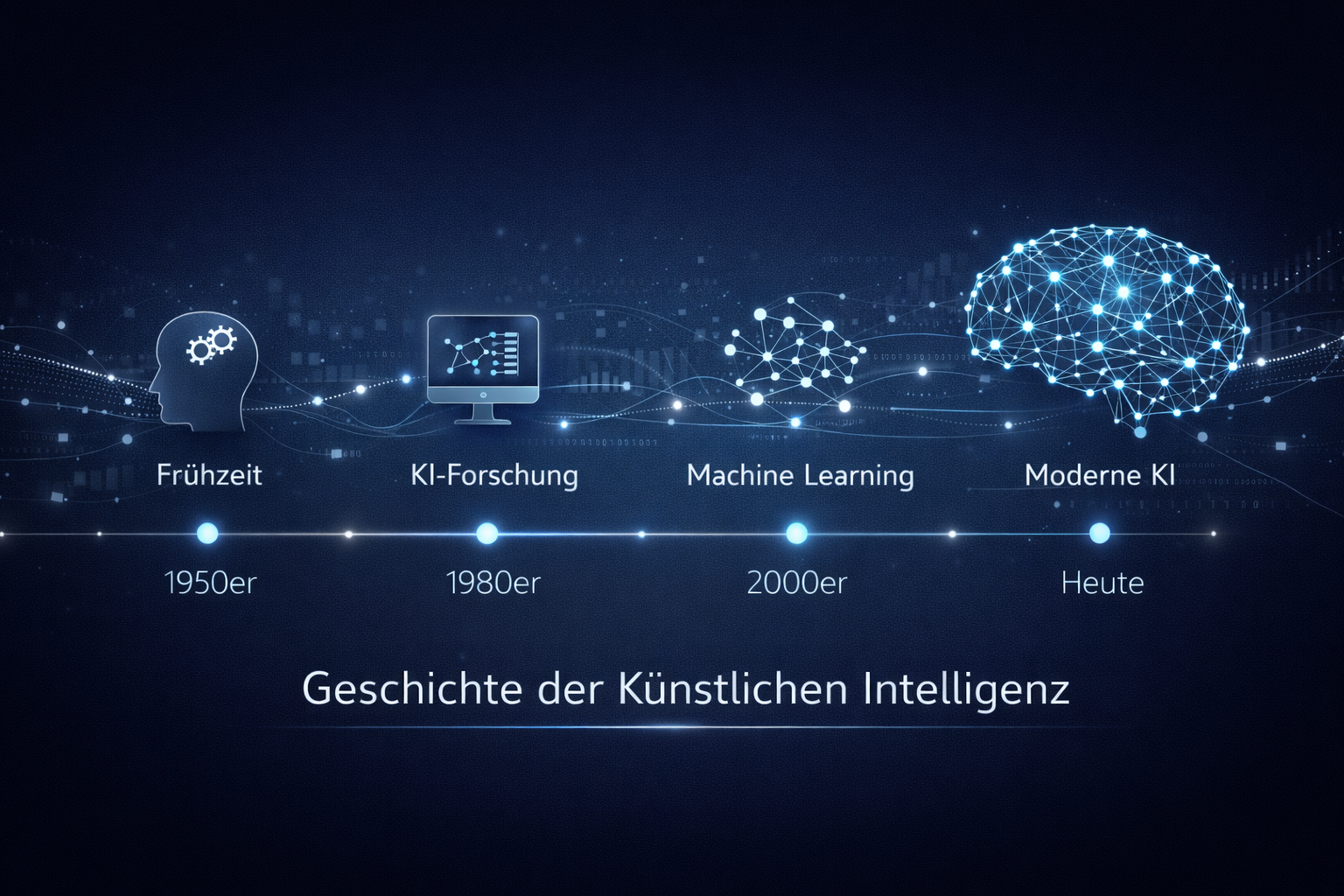

KI ist keine Erfindung des 21. Jahrhunderts. Die Idee, Maschinen das Denken beizubringen, reicht bis in die 1940er Jahre zurück. Seitdem hat das Feld zwei große „KI-Winter“ durchlebt – Phasen, in denen Fördergelder versiegten und der Hype in Ernüchterung umschlug. Erst die Kombination aus massiver Rechenleistung, riesigen Datenmengen und verfeinerten Algorithmen ermöglichte den Durchbruch, den wir heute erleben.

Die Anfänge: Von Rechenmaschinen zur Idee denkender Computer (bis 1950)

Bevor der Begriff „Künstliche Intelligenz“ überhaupt existierte, legten Pioniere das Fundament. Zwei Namen stechen heraus: Konrad Zuse in Deutschland und Alan Turing in Großbritannien.

Konrad Zuse und der Z3 – der vergessene Pionier

Die Geschichte beginnt nicht im Silicon Valley, sondern in Berlin. 1941 stellte der Bauingenieur Konrad Zuse den Z3 fertig – den ersten funktionsfähigen, frei programmierbaren Computer der Welt. Zuse nutzte ausrangierte Telefonrelais, weil Elektronenröhren zu teuer waren. Der Z3 arbeitete bereits binär mit Gleitkommazahlen – ein Prinzip, das sich später weltweit durchsetzen sollte.

Zuses Bedeutung für die KI geht über die Hardware hinaus. Schon 1936 antizipierte er in Patentanmeldungen Konzepte wie Speicheradressierung und logische Verknüpfungen. Später formulierte er in seinem Buch „Rechnender Raum“ die These, das Universum selbst könnte ein riesiger Computer sein. Diese Idee findet sich heute in Debatten über Simulationstheorie wieder.

In der angloamerikanisch geprägten Geschichtsschreibung wird Zuse oft übergangen. Dabei wurde erst 1998 bewiesen, dass der Z3 Turing-mächtig war – also theoretisch jede berechenbare Aufgabe lösen konnte.

Alan Turing und der Turing-Test

Während Zuse die Hardware schuf, lieferte Alan Turing das intellektuelle Fundament. Sein Aufsatz „Computing Machinery and Intelligence“ aus dem Jahr 1950 ist das Gründungsdokument der KI-Philosophie.

Gerade wenn dir Begriffe wie „Intelligenz“, „Lernen“ und „Denken“ im Text dauernd begegnen, hilft dir eine klare, alltagstaugliche Definition – die liefert dir was ist KI, einfach erklärt für Laien ohne akademisches Nebelwerfen, damit du jede Epoche der Entwicklung sauber einsortieren kannst

Turing stand vor einem Problem: Begriffe wie „Denken“ oder „Intelligenz“ waren zu vage für wissenschaftliche Arbeit. Seine Lösung war elegant. Statt zu fragen „Können Maschinen denken?“, schlug er das „Imitation Game“ vor: Kann eine Maschine einen Menschen in einer textbasierten Konversation so täuschen, dass dieser sie für einen anderen Menschen hält?

Diese Verschiebung vom Sein zum Verhalten war radikal. Sie erlaubte es Forschern, Fortschritt zu messen, ohne das Rätsel des Bewusstseins lösen zu müssen.

Turing war optimistisch. Er prognostizierte, dass Computer um das Jahr 2000 über etwa eine Milliarde Bits Speicher verfügen würden. Mit dieser Vorhersage lag er bemerkenswert richtig. Er ging auch proaktiv auf Einwände ein, die bis heute die KI-Debatte prägen:

- Das theologische Argument: Denken sei eine Funktion der Seele, die nur Menschen haben. Turings Antwort: Gott könnte auch einer Maschine eine Seele verleihen.

- Das mathematische Argument: Gödels Unvollständigkeitssätze zeigen Grenzen logischer Systeme. Turings Gegenfrage: Unterliegt der menschliche Intellekt nicht ähnlichen Grenzen?

- Das Bewusstseins-Argument: Maschinen könnten keine echten Gefühle haben. Turing konterte: Auch bei anderen Menschen vermuten wir Bewusstsein nur aufgrund ihres Verhaltens.

Die Geburtsstunde der KI: Dartmouth-Konferenz 1956

Im Sommer 1956 versammelten sich Forscher am Dartmouth College in New Hampshire. Dieses Treffen gilt als die offizielle Geburtsstunde der Künstlichen Intelligenz.

Die Gründerväter und ihre Vision

Vier Wissenschaftler hatten die Konferenz organisiert: John McCarthy (Dartmouth), Marvin Minsky (Harvard), Nathaniel Rochester (IBM) und Claude Shannon (Bell Labs). Sie beantragten bei der Rockefeller Foundation Mittel für eine „2-monatige, 10-Mann-Studie über künstliche Intelligenz“.

Jeder brachte eine andere Perspektive ein:

- John McCarthy prägte den Begriff „Artificial Intelligence“ und entwickelte später LISP, die dominierende Programmiersprache der frühen KI.

- Marvin Minsky hatte 1951 den ersten neuronalen Netz-Computer gebaut, wandte sich aber später der symbolischen Wissensrepräsentation zu.

- Claude Shannon, Begründer der Informationstheorie, brachte mathematische Strenge in die Analyse von Kommunikation.

- Nathaniel Rochester repräsentierte als IBM-Ingenieur die Hardware-Seite und schrieb frühe Programme für neuronale Simulationen.

Die Kernhypothese der symbolischen KI

Der Projektantrag enthielt einen Satz, der das Feld für Jahrzehnte definierte:

„Die Studie soll auf der Vermutung basieren, dass jeder Aspekt des Lernens oder jedes andere Merkmal der Intelligenz im Prinzip so genau beschrieben werden kann, dass eine Maschine gebaut werden kann, um es zu simulieren.“

Das war das Kernpostulat der symbolischen KI: Intelligenz ist nicht an biologische Neuronen gebunden. Sie ist ein Prozess der Informationsverarbeitung, der durch logische Regeln und Symbole abgebildet werden kann.

Die Konferenz dauerte etwa acht Wochen. Neben den Organisatoren nahmen spätere Größen wie Allen Newell und Herbert Simon teil. Sie stellten den „Logic Theorist“ vor – ein Programm, das mathematische Lehrsätze beweisen konnte. Es war der erste Beweis, dass Computer nicht nur rechnen, sondern logisch schlussfolgern konnten.

Die Stimmung war euphorisch. Man ging davon aus, dass maschinelle Übersetzung, Bilderkennung und allgemeines Problemlösen innerhalb einer Generation gelöst sein würden. Dieser Optimismus war notwendig, um Fördergelder zu sichern – legte aber auch den Grundstein für spätere Enttäuschungen.

Erste Erfolge der symbolischen KI (1956–1974)

Nach Dartmouth erlebte die KI einen ersten Frühling. Militärische Gelder, insbesondere von der DARPA, flossen reichlich. Der Kalte Krieg trieb das Interesse an automatisierter Übersetzung russischer Dokumente.

ELIZA – der erste Chatbot und der ELIZA-Effekt

Eines der bekanntesten Projekte dieser Ära war ELIZA, entwickelt von Joseph Weizenbaum am MIT zwischen 1964 und 1966. ELIZA war ein Programm zur Verarbeitung natürlicher Sprache – und demonstrierte, wie leicht Menschen zu täuschen sind.

Das berühmteste Skript namens „DOCTOR“ imitierte einen rogerianischen Psychotherapeuten. Ein typischer Dialog:

Nutzer: „Männer sind alle gleich.“

ELIZA: „Inwiefern?“

Nutzer: „Sie nerven uns immer wegen irgendetwas.“

ELIZA: „Können Sie ein spezifisches Beispiel nennen?“

Nutzer: „Mein Freund hat mich hergeschickt.“

ELIZA: „Ihr Freund hat Sie hergeschickt.“

Die technische Brillanz lag in der Einfachheit. ELIZA verstand kein einziges Wort. Sie erkannte Schlüsselwörter wie „Freund“, schlug in einer Tabelle nach und wendete Transformationsregeln an („Mein X“ wurde zu „Ihr X“). Bei fehlenden Schlüsselwörtern nutzte sie generische Phrasen wie „Erzählen Sie mir mehr“.

Der soziologische Effekt war gewaltig. Nutzer – darunter Weizenbaums eigene Mitarbeiter – bauten emotionale Bindungen zu ELIZA auf. Sie teilten intimste Geheimnisse und waren überzeugt, dass die Maschine sie verstand.

Dieses Phänomen wurde als ELIZA-Effekt bekannt: Die menschliche Tendenz, Computerverhalten zu vermenschlichen und Verständnis dort hineinzuprojizieren, wo nur Mustererkennung stattfindet.

Weizenbaum selbst war entsetzt. Er wurde zu einem der schärfsten KI-Kritiker und argumentierte in seinem Buch „Computer Power and Human Reason“, dass bestimmte Bereiche – wie Justiz und Medizin – niemals Maschinen überlassen werden sollten.

Mikrowelten und frühe Robotik

Parallel zur Sprachverarbeitung entstanden sogenannte „Microworlds“. Ein Beispiel ist Terry Winograds SHRDLU (um 1970). In einer virtuellen Welt aus Klötzen und Pyramiden konnte ein Roboterarm Anweisungen verstehen wie „Lege die rote Pyramide auf den blauen Block“. SHRDLU beantwortete auch Fragen zum Zustand der Welt und zeigte beeindruckendes Verständnis von Syntax und Semantik – allerdings nur innerhalb seiner extrem begrenzten Welt.

In der Robotik war Shakey (SRI International, späte 1960er) der erste mobile Roboter, der über seine eigenen Aktionen nachdenken konnte. Er nutzte Kameras und Sensoren, um in einer Büroumgebung Blöcke zu verschieben. Shakey zerlegte komplexe Aufgaben in Teilprobleme und plante Routen. Das war die Geburtsstunde moderner Planungsalgorithmen wie A*.

Die Grenzen zeigten sich schnell: Shakeys Bewegungen waren extrem langsam, weil jede Berechnung Minuten dauerte.

Der erste KI-Winter (1974–1980)

Anfang der 1970er kollidierten die hochfliegenden Erwartungen mit der Realität. Die „kombinatorische Explosion“ – das exponentielle Wachstum möglicher Zustände bei komplexen Problemen – machte viele Ansätze, die in Mikrowelten funktionierten, für reale Anwendungen unbrauchbar.

Der Lighthill-Report und seine Folgen

In Großbritannien beauftragte der Science Research Council den Mathematiker Sir James Lighthill mit einer Evaluation der KI-Forschung. Sein Bericht von 1973 war vernichtend:

- Die bisherigen Errungenschaften waren nur auf „Spielzeugprobleme“ anwendbar.

- Bei der Skalierung auf reale Probleme versagten die Methoden.

- Konventionelle Ingenieursmethoden waren oft effizienter als komplexe KI-Ansätze.

Als direkte Folge wurde die KI-Forschung in Großbritannien fast vollständig gestrichen. Nur wenige Zentren wie Edinburgh überlebten.

Warum die Erwartungen scheiterten

Auch in den USA änderte sich das Klima. Das Mansfield Amendment (1969/1970) verpflichtete das Militär, nur noch Forschung mit „direkter und offensichtlicher Beziehung zu einer militärischen Funktion“ zu finanzieren. Die Ära der freien Grundlagenforschung war vorbei.

Besonders hart traf es die maschinelle Übersetzung. Der ALPAC-Report von 1966 hatte festgestellt, dass maschinelle Übersetzungen teurer und schlechter waren als menschliche. Die Förderung versiegte.

Forscher begannen, den Begriff „Künstliche Intelligenz“ in Anträgen zu vermeiden. Diese Phase der Stagnation und des Pessimismus ging als der erste KI-Winter in die Geschichte ein.

Comeback durch Expertensysteme (1980–1987)

Die KI erfand sich in den 1980ern neu. Der Schlüssel: Man gab den Anspruch der „Allgemeinen Intelligenz“ auf und konzentrierte sich auf spezialisiertes Wissen. Das Paradigma wechselte von „Power durch Logik“ zu „Power durch Wissen“.

Wie Expertensysteme funktionieren

Expertensysteme basieren auf einer klaren Trennung:

| Komponente | Funktion |

|---|---|

| Wissensbasis | Sammlung von Fakten und Regeln, extrahiert von menschlichen Experten (z.B. „Wenn der Motor nicht startet und die Lichter schwach sind, dann ist die Batterie leer“) |

| Inferenzmaschine | Logischer Motor, der diese Regeln auf konkrete Fälle anwendet |

Die Regeln wurden von sogenannten „Knowledge Engineers“ in aufwendigen Interviews mit Fachexperten erhoben und in das System eingepflegt.

Kommerzielle Erfolge: XCON und MYCIN

Das bekannteste Beispiel für wirtschaftlichen Erfolg war XCON (auch R1 genannt), entwickelt für die Digital Equipment Corporation (DEC). XCON prüfte Kundenbestellungen für VAX-Computersysteme auf technische Machbarkeit und konfigurierte die Komponenten automatisch. Es sparte DEC geschätzt 40 Millionen Dollar jährlich, indem es Fehler in der manuellen Konfiguration eliminierte.

Im medizinischen Bereich zeigte MYCIN (Stanford, 1970er), dass ein Expertensystem bakterielle Infektionen diagnostizieren und Antibiotika-Dosierungen empfehlen konnte – oft präziser als Assistenzärzte. Obwohl MYCIN wegen rechtlicher und ethischer Bedenken nie im klinischen Alltag eingesetzt wurde, bewies es die Leistungsfähigkeit des Ansatzes.

Das japanische Fifth Generation Project

1981 kündigte Japan ein massives Investitionsprogramm an: das Fifth Generation Computer Systems Projekt. Ziel waren Computer, die nicht nur Daten verarbeiten, sondern logisch schlussfolgern und natürliche Sprache verstehen sollten.

Diese Ankündigung löste im Westen Panik aus. Die USA (mit dem MCC-Konsortium) und Europa (mit dem ESPRIT-Programm) reagierten mit eigenen Milliarden-Förderungen. Spezialisierte Hardware-Hersteller wie Symbolics und Lisp Machines Inc. florierten.

Es war ein neuer KI-Sommer – der allerdings nicht lange halten sollte.

Der zweite KI-Winter (1987–1993)

Wie sein Vorgänger endete auch der zweite KI-Sommer abrupt. Diesmal waren die Gründe primär ökonomisch.

Hardware-Kollaps und das Wartungsproblem

Die teuren LISP-Maschinen – spezialisierte Computer für KI-Anwendungen, die zwischen 50.000 und 100.000 Dollar kosteten – verloren ihren Vorsprung. Das Mooresche Gesetz machte Standard-Chips so schnell, dass generische Workstations von Sun Microsystems und PCs von Apple und IBM die Spezialhardware überflüssig machten. 1987 kollabierte der Markt für KI-Hardware.

Gleichzeitig stellten Unternehmen fest, dass Expertensysteme extrem teuer in der Wartung waren. Wissen ändert sich, und das manuelle Aktualisieren von Tausenden von Regeln erwies sich als Sisyphusarbeit. Zudem waren die Systeme „brüchig“: An den Rändern ihres Wissens produzierten sie nicht etwa unsichere, sondern völlig absurde Antworten.

Auch die Versprechen des japanischen Fifth Generation Projects erfüllten sich nicht. Die parallele Logikprogrammierung erwies sich als schwieriger als gedacht.

Investoren zogen sich zurück, Startups gingen pleite, und „KI“ wurde erneut zum Unwort in Förderanträgen.

Der statistische Wandel (1993–2010)

In den 1990ern und 2000ern vollzog sich ein stiller, aber radikaler Wandel. Die symbolische KI (regelbasiert, von Menschen programmiert) wurde durch statistische Methoden verdrängt. Anstatt Regeln einzuprogrammieren, entwickelte man Algorithmen, die Muster in Daten finden.

Wenn dich der Sprung von „Regeln“ zu „Daten“ fasziniert, ist wie lernt KI? einfache Erklärung der schnellste Weg, um zu verstehen, warum Expertensysteme so wartungsintensiv waren und datengetriebene Modelle so brutal skalieren können.

Deep Blue schlägt Kasparov

Ein symbolträchtiger Moment war das Schachmatch zwischen IBMs Deep Blue und Weltmeister Garry Kasparov im Mai 1997.

Deep Blue war kein lernendes System im modernen Sinne. Es war ein Triumph der Ingenieurskunst und roher Rechenkraft. Spezielle Chips ermöglichten die Analyse von bis zu 200 Millionen Schachstellungen pro Sekunde.

Im zweiten Spiel der Revanche passierte etwas Bemerkenswertes: Deep Blue opferte in einer geschlossenen Stellung Material für einen langfristigen positionellen Vorteil. Kasparov, der solche intuitiven Züge nur Menschen zutraute, war erschüttert. Er beschuldigte IBM später indirekt, menschliche Großmeister hätten eingegriffen. Tatsächlich war der Zug das Ergebnis purer Berechnungstiefe.

Deep Blue gewann das Match 3½ zu 2½. Die Implikation war klar: Man braucht keine „echte“ Intelligenz, um in hochkomplexen kognitiven Aufgaben besser als jeder Mensch zu sein. Es war der Sieg der Suche über das Verständnis.

Big Data und das Internet verändern alles

Ab den späten 1990ern veränderte das Internet die Datenverfügbarkeit fundamental. Während KI-Forscher früher mühsam Textsammlungen von Hand erstellen mussten, lieferte das Web nun Terabytes an Text und Bildern.

Suchmaschinen wie Google nutzten Algorithmen wie PageRank, die das Web als riesigen Graphen interpretierten. Hyperlinks wurden als „Stimmen“ gewertet – eine Form von KI, die auf statistischer Auswertung basierte.

Maschinelle Übersetzung wandelte sich ebenfalls. Anstatt Grammatikregeln zu programmieren, trainierten neue Systeme auf Millionen zweisprachiger Texte (etwa EU- oder UN-Protokolle). Sie lernten statistische Zusammenhänge: Wenn Wort A im Englischen auftaucht, folgt mit einer bestimmten Wahrscheinlichkeit Wort B im Französischen.

Viele Missverständnisse entstehen, weil „KI“, „Machine Learning“ und „Deep Learning“ wie Synonyme behandelt werden – sobald du den Unterschied über KI vs Machine Learning vs Deep Learning: Unterschiede wirklich im Griff hast, wirken KI-Winter und Paradigmenwechsel plötzlich logisch statt zufällig.

Die Deep-Learning-Revolution (2010–2020)

Um 2010 konvergierten drei Faktoren, die das Feld explodieren ließen:

| Faktor | Entwicklung |

|---|---|

| Daten | Projekte wie ImageNet (Fei-Fei Li) stellten Millionen gelabelter Bilder zur Verfügung |

| Hardware | Grafikkarten (GPUs), ursprünglich für Videospiele entwickelt, erwiesen sich als perfekt für die parallelen Berechnungen neuronaler Netze |

| Algorithmen | Forscher wie Geoffrey Hinton, Yann LeCun und Yoshua Bengio hatten Probleme wie das „Vanishing Gradient Problem“ gelöst |

AlexNet und der ImageNet-Durchbruch 2012

Der Urknall des Deep Learning ereignete sich beim ImageNet Large Scale Visual Recognition Challenge 2012. Jahrelang stagnierten die Fehlerraten der besten Bilderkennungssysteme bei etwa 25 Prozent.

Das Team SuperVision (Alex Krizhevsky, Ilya Sutskever, Geoffrey Hinton) trat mit einem tiefen neuronalen Netz namens AlexNet an. Es nutzte GPUs für das Training und neuartige Aktivierungsfunktionen (ReLU). Das Ergebnis: eine Fehlerrate von 15,3 Prozent – fast 10 Prozentpunkte besser als der Zweitplatzierte.

Dieser Erdrutschsieg überzeugte die gesamte Branche über Nacht. Innerhalb weniger Jahre basierten fast alle Systeme im Bereich Computer Vision auf Convolutional Neural Networks (CNNs).

AlphaGo und der legendäre Move 37

Nach der Bilderkennung fiel mit dem Brettspiel Go eine weitere Bastion menschlicher Überlegenheit. Go galt wegen seines riesigen Suchraums (etwa 10^170 mögliche Stellungen) als unlösbar für klassische Brute-Force-Methoden.

DeepMind (von Google übernommen) entwickelte AlphaGo, ein System, das Deep Learning mit Reinforcement Learning und Monte Carlo Tree Search kombinierte.

Im März 2016 trat AlphaGo gegen Lee Sedol an, einen der besten Go-Spieler der Geschichte. Im zweiten Spiel, im 37. Zug, spielte AlphaGo einen Stein auf die fünfte Linie – ein „Shoulder Hit“. Dieser Zug widersprach tausenden Jahren Go-Tradition. Kommentatoren hielten ihn zunächst für einen Fehler. Lee Sedol brauchte fast 15 Minuten, um zu reagieren.

Doch im weiteren Verlauf zeigte sich: Der Zug war strategisch brillant. AlphaGo sicherte sich die Kontrolle über das Spiel.

Move 37 wurde zum Symbol für kreative KI. Die Maschine hatte nicht nur menschliches Wissen repliziert, sondern neues Wissen generiert, das menschliche Intuition überstieg. Lee Sedol gewann nur eines von fünf Spielen – durch den legendären „Move 78“, der eine Schwäche in AlphaGos Algorithmus ausnutzte.

Die Ära der generativen KI (2017–heute)

Die aktuelle Phase wird nicht mehr durch Klassifikation („Ist das eine Katze?“) dominiert, sondern durch Generierung („Zeichne eine Katze“).

Die Transformer-Architektur erklärt

Der technologische Schlüssel ist die Transformer-Architektur, vorgestellt 2017 von Google-Forschern im Paper „Attention Is All You Need“.

Vor Transformern verarbeiteten KI-Modelle Sprache sequenziell – Wort für Wort. Das war langsam und verursachte Probleme bei langen Sätzen.

Transformer nutzen den Self-Attention-Mechanismus: Sie berechnen die Beziehung jedes Wortes zu jedem anderen Wort gleichzeitig. Das ermöglicht massive Parallelisierung auf tausenden GPUs und führte zur Entwicklung von Large Language Models (LLMs).

Von GPT-1 zu ChatGPT

OpenAI trieb die Skalierung der Transformer auf die Spitze:

| Modell | Jahr | Parameter | Bedeutung |

|---|---|---|---|

| GPT-1 | 2018 | 117 Millionen | Früher Beweis, dass Pre-Training auf großen Textmengen funktioniert |

| GPT-2 | 2019 | 1,5 Milliarden | OpenAI verzögerte die Veröffentlichung aus Angst vor Missbrauch für Desinformation |

| GPT-3 | 2020 | 175 Milliarden | Quantensprung. Das Modell zeigte Emergenz: Fähigkeiten wie einfaches Rechnen tauchten auf, obwohl sie nicht explizit trainiert wurden |

| ChatGPT | 2022 | basiert auf GPT-3.5 | Revolutionäres Produkt durch einfaches Chat-Interface |

Am 30. November 2022 veröffentlichte OpenAI ChatGPT. Technisch war es eine inkrementelle Verbesserung (durch Reinforcement Learning from Human Feedback). Aber als Produkt war es revolutionär. Das simple Chat-Interface machte KI für die breite Masse zugänglich.

Innerhalb von zwei Monaten erreichte ChatGPT 100 Millionen Nutzer – ein Wachstum, das selbst TikTok und Instagram in den Schatten stellte.

Dieser Moment löste ein globales Wettrüsten aus. Google rief „Code Red“ aus und lancierte Bard (später Gemini). Microsoft integrierte GPT-4 in Bing und Office. KI wurde zum dominierenden Thema in Politik, Bildung und Wirtschaft.

Der Satz „Diesmal ist alles anders“ fällt in jeder Tech-Welle – und trotzdem entscheidet am Ende oft Geopolitik über Tempo und Richtung; der Blick in das globale KI-Wettrüsten hilft dir, den heutigen Druck hinter „Code Red“, Milliardeninvestitionen und Regulierung besser zu verstehen.

Die aktuelle Modelllandschaft 2025

Bis 2025 hat sich das Feld diversifiziert:

Multimodalität: Modelle wie GPT-4o und Gemini 1.5 Pro verarbeiten Text, Bild, Audio und Video nativ. Gemini 1.5 führte ein Kontextfenster von einer Million Token ein – genug, um ganze Bücher oder stundenlange Videos in einem Prompt zu analysieren.

Wettbewerb: Neben OpenAI und Google etablierte sich Anthropic (gegründet von ehemaligen OpenAI-Mitarbeitern) mit der Claude-Serie als starker Konkurrent, der besonders auf Sicherheit und sprachliche Nuancen fokussiert ist.

Sobald du Tools auswählst oder Aussagen über „das beste Modell“ hörst, brauchst du eine Landkarte – und die bekommst du über unseren Vergleich der Top-Modelle: OpenAI vs Anthropic, damit du Fähigkeiten, Stärken und typische Einsatzfelder sauber gegeneinander abwägen kannst.

Zeitleiste: Die wichtigsten KI-Meilensteine

| Jahr | Meilenstein | Bedeutung |

|---|---|---|

| 1941 | Zuse Z3 | Erster funktionsfähiger, programmierbarer Computer (Berlin) |

| 1950 | Turing-Test | Alan Turing operationalisiert „Denken“ in „Computing Machinery and Intelligence“ |

| 1956 | Dartmouth-Konferenz | Offizielle Gründung des Forschungsfeldes „Artificial Intelligence“ |

| 1966 | ELIZA | Erster Chatbot demonstriert den ELIZA-Effekt |

| 1969 | Perceptrons (Buch) | Minsky & Papert zeigen Grenzen einfacher neuronaler Netze – Teilursache für 1. KI-Winter |

| 1973 | Lighthill-Report | Vernichtende Kritik führt zu massiven Kürzungen in UK |

| 1980 | XCON | Beginn der Expertensystem-Ära, erster großer kommerzieller Erfolg |

| 1987 | Marktkollaps | Zusammenbruch des LISP-Maschinen-Marktes, Beginn des 2. KI-Winters |

| 1997 | Deep Blue | IBMs Computer schlägt Weltmeister Kasparov im Schach |

| 2012 | AlexNet | Durchbruch des Deep Learning bei ImageNet |

| 2016 | AlphaGo | Sieg über Lee Sedol in Go, „Move 37“ zeigt maschinelle Kreativität |

| 2017 | Transformer | Paper „Attention Is All You Need“ legt Grundstein für moderne LLMs |

| 2020 | GPT-3 | Massive Skalierung, Emergenz von Few-Shot Learning |

| 2022 | ChatGPT | Schnellstes Wachstum einer Consumer-App in der Geschichte |

| 2025 | Multimodale Agenten | Systeme verarbeiten Text, Bild, Video und Code integriert |

Droht ein dritter KI-Winter?

Die Geschichte lehrt: Auf jeden Hype folgt Ernüchterung. Gibt es Anzeichen für einen dritten KI-Winter?

Für einen Winter spricht:

Die Kosten für das Training neuer Frontier-Modelle steigen exponentiell – in die Milliarden Dollar –, während die Leistungszuwächse kleiner werden. Die bisherigen „Scaling Laws“ (mehr Rechenleistung = bessere Ergebnisse) stoßen möglicherweise an Grenzen.

Unternehmen stellen fest, dass die Integration von KI in produktive Workflows komplexer ist als gedacht. Halluzinationen – also plausibel klingende, aber falsche Antworten – bleiben ein ungelöstes Problem.

Gegen einen Winter spricht:

Anders als in früheren Phasen gibt es diesmal reale, weit verbreitete Anwendungen. Millionen Menschen nutzen ChatGPT, Copilot und ähnliche Tools täglich. Die Technologie ist nicht mehr auf Labore beschränkt.

Der Fokus verschiebt sich von reinen Chatbots zu KI-Agenten, die autonom Aufgaben erledigen sollen. Ob diese Technologie die hohen Erwartungen erfüllen kann, wird entscheiden, ob wir auf einen neuen Frühling oder einen dritten Winter zusteuern.

AGI-Prognosen haben sich radikal verkürzt. Vor 2020 lagen Schätzungen für eine „Allgemeine Künstliche Intelligenz“ – also eine KI, die in allen intellektuellen Aufgaben dem Menschen ebenbürtig ist – oft bei 2050 oder später. Heute nennen viele Führungskräfte der Branche Zeiträume zwischen 2028 und 2032. Diese Prognosen sind mit Vorsicht zu genießen: Sie stammen oft von Akteuren mit finanziellem Interesse am Hype.

FAQ

Wann wurde der Begriff „Künstliche Intelligenz“ erfunden?

John McCarthy prägte den Begriff 1956 für die Dartmouth-Konferenz, um sich von der damals populären „Kybernetik“ abzugrenzen.

Was ist der ELIZA-Effekt?

Die menschliche Tendenz, Computerverhalten zu vermenschlichen und Verständnis dort hineinzuprojizieren, wo nur Mustererkennung stattfindet. Benannt nach dem Chatbot ELIZA (1966).

Warum gab es KI-Winter?

Beide KI-Winter entstanden, als überzogene Erwartungen auf technologische Realität trafen. Im ersten Winter (1974–1980) scheiterten Systeme an der kombinatorischen Explosion. Im zweiten Winter (1987–1993) kollabierten der Hardware-Markt und das Geschäftsmodell der Expertensysteme.

Was war der entscheidende Durchbruch für moderne KI?

Die Kombination aus drei Faktoren um 2010: riesige Datenmengen (ImageNet), leistungsfähige Hardware (GPUs) und verbesserte Algorithmen (Deep Learning). Der AlexNet-Sieg 2012 markierte den Wendepunkt.

Was ist ein Transformer?

Eine 2017 vorgestellte Architektur für neuronale Netze, die den Self-Attention-Mechanismus nutzt. Sie bildet die Grundlage aller modernen Large Language Models wie GPT-4 oder Claude.

Fazit: Was uns die KI-Geschichte lehrt

Die Geschichte der KI ist eine Parabel auf den menschlichen Entdeckergeist – und auf die Gefahr überzogener Erwartungen.

Erstens: KI ist keine Magie, die 2022 vom Himmel fiel. Sie ist das Ergebnis einer 80-jährigen Evolution. Viele „neue“ Konzepte wie neuronale Netze existierten schon in den 1950ern – sie warteten nur auf die nötige Rechenleistung.

Zweitens: Der Ansatz hat sich fundamental gewandelt. Von expliziter Programmierung (Regeln) hin zu implizitem Lernen (Daten). Die symbolische KI, die Wissen in Wenn-Dann-Regeln codierte, ist weitgehend Geschichte. Heute dominieren statistische Modelle, die Muster in Milliarden von Datenpunkten finden.

Drittens: Jeder Hype-Zyklus endete bisher in Ernüchterung. Wer heute in KI investiert oder mit ihr arbeitet, sollte diese Geschichte kennen. Die Frage ist nicht, ob die Erwartungen korrigiert werden – sondern wann und wie stark.

Viertens: Trotz aller Rückschläge hat sich das Feld immer weiterentwickelt. Jeder Winter bereitete den nächsten Frühling vor. Die gescheiterten Expertensysteme lehrten, dass manuelles Wissens-Engineering nicht skaliert – und ebneten so den Weg für datengetriebenes Lernen.

Wir stehen heute nicht am Ende dieser Entwicklung, sondern vermutlich erst am Anfang einer Ära, in der KI zur fundamentalen Infrastruktur wird – vergleichbar mit der Elektrizität im 20. Jahrhundert. Die nächsten Kapitel dieser Geschichte werden gerade geschrieben.