Was sind Diffusion Models? (Kurze Antwort)

Diffusion Models sind eine Klasse von KI-Modellen, die Bilder erzeugen, indem sie zufälliges Rauschen Schritt für Schritt in ein fertiges Bild verwandeln. Sie stecken hinter Tools wie Midjourney, Stable Diffusion, FLUX und DALL-E.

Das Grundprinzip ist überraschend einfach: Zuerst lernt das Modell, wie man ein Bild systematisch zerstört – indem man immer mehr Rauschen hinzufügt, bis nur noch statisches Chaos übrig ist. Dann lernt es, diesen Prozess umzukehren. Und genau diese Umkehrung – aus Chaos Struktur machen – ist der Trick, mit dem neue Bilder entstehen.

Seit 2022 haben Diffusion Models die KI-Bildgenerierung dominiert und ihre Vorgänger (die sogenannten GANs) weitgehend abgelöst. Warum das so ist, wie die Technik im Detail funktioniert und welche Modelle es heute gibt, erfährst du in diesem Artikel.

Der Blick aufs große Ganze schärft dein Verständnis enorm. Wenn du nachvollziehen willst, warum Diffusion Models GANs abgelöst haben und wie sie sich in die Entwicklung der letzten Jahre einfügen, gibt dir die Übersicht zu den wichtigsten KI-Meilensteinen 2015–2025 den historischen Kontext.

Wie funktionieren Diffusion Models?

Die Idee hinter Diffusion Models stammt nicht aus der Informatik, sondern aus der Physik – genauer gesagt aus der Thermodynamik. Um sie wirklich zu verstehen, hilft eine einfache Analogie.

Die Tinte-im-Wasser-Analogie

Stell dir vor, du lässt einen Tropfen Tinte in ein Glas klares Wasser fallen. Am Anfang ist der Tropfen klar erkennbar – du siehst genau, wo Tinte ist und wo Wasser. Mit der Zeit verteilen sich die Tintenmoleküle. Die scharfen Kanten verschwimmen, die Struktur löst sich auf. Irgendwann ist das Wasser gleichmäßig gefärbt.

Dieser Zustand heißt in der Physik maximale Entropie – maximale Unordnung. Die ursprüngliche Information (die Form des Tropfens) scheint verloren. In der echten Welt ist dieser Prozess nicht umkehrbar.

In der Welt der Diffusion Models passiert genau das Gleiche – nur digital und kontrolliert. Und mit einem entscheidenden Unterschied: Hier lässt sich der Prozess umkehren.

Forward Process: Rauschen hinzufügen

Der erste Schritt heißt Forward Process (Vorwärtsprozess). Er ist der einfache Teil – denn ein Bild zu zerstören erfordert keine Intelligenz.

Nimm ein digitales Bild, zum Beispiel ein Porträt. Der Algorithmus fügt diesem Bild schrittweise sogenanntes Gaußsches Rauschen hinzu. Das ist vergleichbar mit dem statischen Flimmern auf einem alten Fernseher ohne Empfang.

Das passiert nicht auf einen Schlag, sondern in vielen kleinen Schritten – typischerweise rund 1.000 Stück:

- Schritt 0: Das klare Originalbild.

- Schritt 10: Leicht körnig, alle Details noch erkennbar.

- Schritt 500: Stark verrauscht, das Motiv nur noch schemenhaft sichtbar – wie durch Milchglas.

- Schritt 1.000: Nur noch reines, zufälliges Rauschen. Jede Struktur ist ausgelöscht.

Mathematisch ist das eine simple Kette: Jeder Schritt hängt nur vom Schritt direkt davor ab. Nichts Kompliziertes – nur kontrollierte Zerstörung.

Reverse Process: Rauschen entfernen

Hier passiert die eigentliche Magie. Der Reverse Process (Rückwärtsprozess) kehrt die Zerstörung um. Ein neuronales Netzwerk lernt, einen einzelnen kleinen Zeitschritt rückwärts zu gehen.

Konkret: Das Modell bekommt ein verrauschtes Bild (z. B. aus Schritt 500) und soll vorhersagen, wie das Bild in Schritt 499 aussah. Noch präziser: Es sagt vorher, welches Rauschen hinzugefügt wurde – und subtrahiert es dann.

So läuft das Training ab:

Das Modell sieht Millionen von Bildern. Bei jedem Bild kennt der Algorithmus das exakte Rauschen, das hinzugefügt wurde (weil er den Vorwärtsprozess selbst kontrolliert). Das Modell muss raten, wie dieses Rauschen aussieht. Die Differenz zwischen Schätzung und Realität wird genutzt, um das Netzwerk zu verbessern. Das wiederholt sich millionenfach.

Spätestens beim Vergleich von Midjourney, Stable Diffusion und FLUX stellt sich die Frage: Welches Tool passt zu deinem Workflow? Der praxisnahe Überblick zu KI-Bildgeneratoren im Vergleich: Midjourney vs. OpenAI vs. Leonardo AI hilft dir, Qualität, Bedienbarkeit und Einsatzbereiche direkt gegeneinander abzuwägen.

Und so entsteht ein neues Bild:

Nach dem Training gibst du dem Modell reines Rauschen – ein zufälliges Muster, das es noch nie gesehen hat. Dann sagst du: „Entferne das Rauschen.“ Das Modell sieht im Chaos Muster, die eigentlich gar nicht da sind – ähnlich wie du in Wolken Gesichter erkennst. Es entfernt ein wenig Rauschen, verstärkt die entstehenden Strukturen und wiederholt den Schritt dutzende Male.

Über diese Schritte schälen sich erst grobe Umrisse heraus, dann Formen, Texturen und schließlich ein kohärentes Bild. Es entsteht etwas Neues, das nie existiert hat – aber den statistischen Regeln aller Bilder folgt, die das Modell beim Training gesehen hat.

Der Latent Space – warum „Stable“ Diffusion so heißt

Frühe Diffusionsmodelle arbeiteten direkt auf den Pixeln. Bei einem Bild mit 1024 × 1024 Pixeln und drei Farbkanälen bedeutete das über eine Million Werte pro Schritt. Das war extrem langsam und rechenintensiv.

Die Lösung kam 2022 durch die sogenannten Latent Diffusion Models (LDMs) – und genau deshalb heißt Stable Diffusion so, wie es heißt. Die Idee: Bevor das Rauschen ins Spiel kommt, wird das Bild komprimiert.

Ein Encoder (Teil eines Variational Autoencoders, kurz VAE) schrumpft das Bild auf eine kompakte mathematische Darstellung – den Latent Space. Unwichtige Details fallen weg, aber die Struktur und Bedeutung bleiben erhalten. Aus einem riesigen Bild wird ein kleines Datenpaket.

Der gesamte Diffusionsprozess – Verrauschen und Entrauschen – findet dann in diesem komprimierten Raum statt. Das ist massiv effizienter. Erst am Ende übersetzt ein Decoder das Ergebnis zurück in sichtbare Pixel.

Dieser Trick machte KI-Bildgenerierung auf normalen Heimcomputern möglich. Statt teurer Serverfarmen reichte plötzlich eine Consumer-Grafikkarte wie eine NVIDIA RTX 3060.

Wie wird aus Text ein Bild?

Ein Diffusionsmodell allein erzeugt Bilder – aber ohne Steuerung wären es nur zufällige Muster. Um aus dem Satz „Ein Astronaut reitet auf einem Pferd im Weltraum“ ein passendes Bild zu machen, braucht es einen Übersetzer zwischen Sprache und Bild.

CLIP: Sprache und Bild im selben Raum

Diesen Job übernimmt CLIP (Contrastive Language-Image Pre-Training), entwickelt von OpenAI und 2021 vorgestellt. CLIP wurde mit Hunderten Millionen Bild-Text-Paaren aus dem Internet trainiert. Das Besondere: Es lernte nicht einfach „Das ist eine Katze“, sondern wie stark ein Bild und ein Text zueinander passen.

CLIP projiziert Bilder und Texte in denselben mathematischen Raum (Embedding Space). Wenn das Modell „Hund“ wirklich versteht, liegt der Vektor für das Wort „Hund“ räumlich nahe am Vektor für ein Foto eines Hundes.

Gibst du einen Prompt ein, wandelt der Text-Encoder diesen in Vektoren um. Diese Vektoren dienen als Wegweiser für den Diffusionsprozess. Während das Modell Rauschen entfernt, prüft es laufend: „Sieht das, was hier entsteht, meinem Text-Prompt ähnlich?“ Die Entrauschung wird aktiv in die richtige Richtung gesteuert.

Von CLIP zu T5: Besseres Textverständnis

CLIP war revolutionär, hatte aber Grenzen. Einfache Objekte verstand es gut, komplexe räumliche Beziehungen oder Schriftzüge im Bild oft nicht. Neuere Modelle setzen deshalb auf mächtigere Sprachmodelle wie T5 (Text-to-Text Transfer Transformer), die Grammatik und Kontext viel tiefer verstehen.

Das erklärt einen deutlichen Qualitätssprung: Modelle ab 2025 (wie FLUX oder Midjourney v7) können Anweisungen wie „Ein roter Ball auf einem blauen Würfel, neben einer grünen Pyramide“ viel präziser umsetzen. Ältere Modelle platzierten die Objekte oft einfach irgendwo im Bild, ohne räumliche Beziehungen wie „auf“ oder „neben“ korrekt zu interpretieren.

Diffusion Models vs. GANs – warum Diffusion gewonnen hat

Bis etwa 2021 waren GANs (Generative Adversarial Networks) der Goldstandard für KI-generierte Bilder. Du kennst vielleicht „This Person Does Not Exist“ – das war ein GAN.

GANs funktionieren nach einem Wettbewerbsprinzip: Ein Generator versucht, ein Bild zu fälschen, ein Discriminator versucht, die Fälschung zu erkennen. Beide trainieren gegeneinander. Diffusion Models arbeiten dagegen nicht gegeneinander, sondern iterativ – sie verbessern das Ergebnis Schritt für Schritt.

Drei Probleme haben GANs das Genick gebrochen:

Mode Collapse: GANs wurden „faul“. Wenn der Generator einen Bildtyp fand, der den Discriminator zuverlässig täuschte, produzierte er nur noch diesen. Die Vielfalt ging verloren. Diffusion Models decken die gesamte statistische Verteilung der Trainingsdaten ab – sie können theoretisch alles generieren, was sie gelernt haben.

Trainings-Instabilität: Das Gleichgewicht zwischen Generator und Discriminator war extrem schwer zu finden. War einer zu gut, lernte der andere nichts mehr. Diffusion Models haben eine klare mathematische Zielfunktion (Entrauschung), die stabil konvergiert.

Fehlende Details: GANs waren oft gut bei globalen Strukturen (Gesichtsform), schwächelten aber bei feinen Texturen und kohärenten Hintergründen. Genau hier glänzen Diffusion Models.

Der einzige Vorteil der GANs war die Geschwindigkeit: Ein Bild in Millisekunden statt Sekunden oder Minuten. Doch durch Optimierungen wie Rectified Flow und Distillation (in Modellen wie FLUX Schnell oder SDXL Turbo) wurde dieser Nachteil bis 2026 weitgehend eliminiert. Diffusion Models sind heute fast genauso schnell – und in allem anderen überlegen.

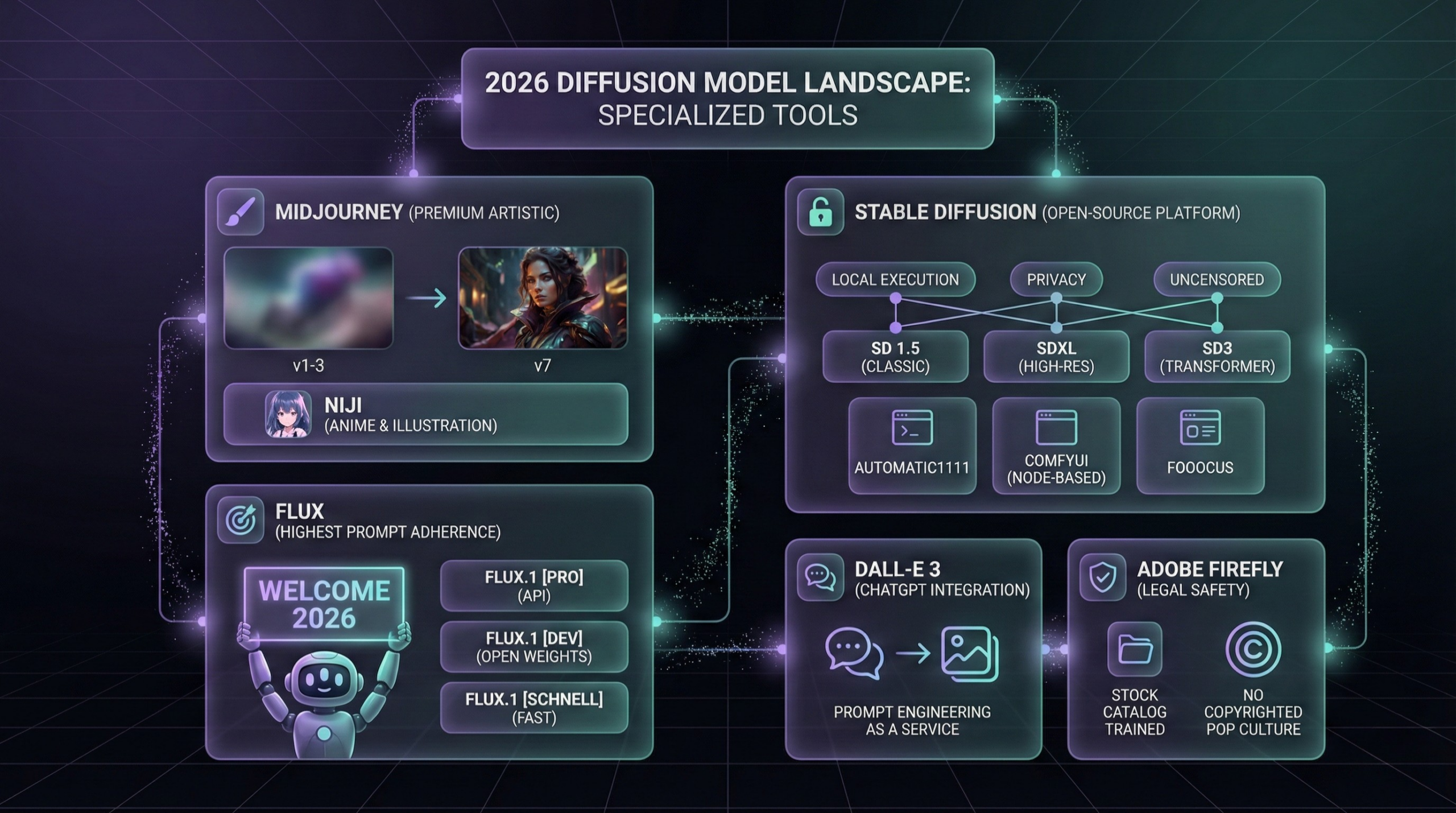

Die wichtigsten Diffusion Models im Überblick

Der Markt hat sich bis 2026 stark ausdifferenziert. Es gibt nicht mehr „das eine beste Modell“, sondern spezialisierte Werkzeuge für verschiedene Nutzergruppen.

Midjourney

Midjourney hat sich als das Premium-Tool für Designer und Künstler etabliert, die ästhetisch hochwertige Bilder wollen, ohne stundenlang am Prompt zu feilen.

Das Modell besitzt einen starken eingebauten „künstlerischen Bias“. Es neigt zu dramatischer Beleuchtung, satten Farben und ausgewogenen Kompositionen. Selbst vage Eingaben wie „Licht“ erzeugen oft ein beeindruckendes Ergebnis.

Die Evolution war rasant: v1 bis v3 (2022) lieferten abstrakte, malerische Bilder mit geringer Kohärenz. Mit v5 (2023) kam der Durchbruch zum Fotorealismus – und das berüchtigte Sechs-Finger-Problem verschwand weitgehend. v6 (2024) brachte besseres Textverständnis und komplexere Szenen. v7 (2025) erreichte extreme Detailtreue mit fast perfekter Textdarstellung und Materialphysik.

Daneben gibt es Niji, ein spezialisiertes Modell für Anime- und Illustrationsstile. Niji 7 (Januar 2026) gilt als Referenz für japanische Ästhetik mit einer bisher unerreichten Sauberkeit der Linienführung.

Midjourney ist proprietär und nur als Abo-Dienst verfügbar – lange Zeit ausschließlich über Discord, inzwischen auch über ein Web-Interface. Lokale Installation ist nicht möglich.

Stable Diffusion

Stable Diffusion ist das Herz der Open-Source-Bewegung. Es ist weniger ein einzelnes Produkt als eine Plattform.

Die Philosophie: Offenheit. Jeder kann das Modell herunterladen, modifizieren und lokal betreiben. Das garantiert Privatsphäre und Unabhängigkeit von Cloud-Diensten – und es bedeutet: keine Zensurfilter, wenn du das nicht willst.

Bei den Versionen gibt es mehrere relevante Stränge. SD 1.5 ist der ewige Klassiker – extrem effizient und mit einer riesigen Menge an Community-Erweiterungen. SDXL brachte höhere native Auflösung (1024 × 1024) und besseren Kontrast. SD3 / SD3.5 (2024/25) vollzog den Wechsel zur Transformer-Architektur, um das Textverständnis zu maximieren.

Für die Bedienung wählen Nutzer zwischen verschiedenen Interfaces: Automatic1111 ist das Feature-Monster für Power-User. ComfyUI bietet einen node-basierten Baukasten für maximale technische Kontrolle. Und Fooocus ist eine vereinfachte Oberfläche, die Midjourney nachahmt.

Die Einstiegshürde ist höher als bei Midjourney oder DALL-E, dafür ist die Kontrolle unübertroffen.

FLUX

2024 betrat Black Forest Labs die Bühne – gegründet von den ursprünglichen Entwicklern von Stable Diffusion. Ihr Modell FLUX gilt 2025/2026 als das mit der höchsten Prompt-Adhärenz.

Was das bedeutet: Wenn du FLUX bittest, „ein Schild mit der Aufschrift ‚Willkommen 2026′ in der Hand eines Roboters mit drei Augen“ zu malen, führt es das exakter aus als die Konkurrenz. Besonders bei Typografie und komplexen Szenen liegt FLUX vorne.

FLUX gibt es in drei Varianten. FLUX.1 [pro] bietet maximale Qualität, ist aber Closed Source und nur über API zugänglich. FLUX.1 [dev] hat offene Gewichte für Forscher und ist extrem leistungsstark, benötigt aber starke Hardware (viel VRAM). FLUX.1 [schnell] ist auf Geschwindigkeit optimiert und unter Apache-2.0-Lizenz frei nutzbar.

Technisch setzt FLUX auf „Flow Matching“ – eine Verallgemeinerung der Diffusion, die den Generierungsprozess geradliniger und effizienter macht.

Präzision bei Typografie und komplexen Szenen ist das große Versprechen von FLUX. Wie sich das Modell in der Praxis schlägt und ob sich der Hardware-Aufwand lohnt, erfährst du im detaillierten FLUX-Test zur Open-Source-Bildgenerierung.

DALL-E 3 & Adobe Firefly

DALL-E 3 von OpenAI ist durch die Integration in ChatGPT das zugänglichste Modell. Du tippst einfach ein, was du sehen willst – ChatGPT schreibt deinen Prompt im Hintergrund um, damit das beste Ergebnis entsteht. Quasi „Prompt Engineering as a Service“. Der Look ist oft etwas glatter und plastischer als bei Midjourney.

Adobe Firefly verfolgt einen anderen Ansatz: Rechtssicherheit. Adobe trainierte Firefly ausschließlich auf dem eigenen Stock-Katalog und lizenzfreien Werken. Das macht es zur ersten Wahl für Werbeagenturen, die Urheberrechtsklagen fürchten. Der Preis: Dem Modell fehlt oft das Wissen über geschützte Popkultur – es kann beispielsweise keinen Darth Vader generieren.

| Feature | Midjourney v7 | Stable Diffusion (SD3.5/SDXL) | FLUX.1 | DALL-E 3 |

|---|---|---|---|---|

| Zugänglichkeit | Einfach (Web/Discord), Abo | Komplex (lokal/Cloud), kostenlos möglich | Mittel (lokal, starke GPU), API | Sehr einfach (ChatGPT Plus) |

| Stilistik | Künstlerisch, dramatisch | Extrem variabel durch Community-Modelle | Fotorealistisch, präzise, neutral | Plastisch, sauber, logisch |

| Text-Rendering | Exzellent (seit v6/v7) | Gut (SD3.5), mäßig in älteren | Hervorragend (Marktführer) | Sehr gut |

| Zensur/Safety | Streng (NSFW-Filter) | Keine (lokal) | Mäßig (Dev/Schnell sind offen) | Sehr streng |

| Hardware | Cloud (keine eigene GPU nötig) | Lokal (GPU mit 4 GB+ VRAM) | Lokal (starke GPU, 12 GB+ VRAM) | Cloud |

| Hauptnutzen | Inspiration, High-End Art | Kontrolle, Workflow, Bastler | Typografie, komplexe Prompts | Chat-Integration, schnelle Ideen |

Was Diffusion Models heute alles können

Die reine Text-zu-Bild-Generierung war nur der Anfang. Professionelle Workflows brauchen präzise Kontrolle – und genau dafür sind in den letzten Jahren mächtige Werkzeuge entstanden.

ControlNet: Posen und Skizzen vorgeben

ControlNet (2023) löste eines der größten Probleme der generativen KI: die Zufälligkeit der Komposition. Vorher konntest du sagen „Eine Frau, die tanzt“ – aber du hattest keinen Einfluss darauf, wie sie tanzt.

ControlNet erlaubt es, dem Diffusionsmodell eine Zusatzbedingung neben dem Text zu geben. Drei Beispiele:

OpenPose – Du speist ein Strichmännchen (Skelett) ein. Die KI generiert eine Person exakt in dieser Pose.

Canny/Edge – Du nutzt eine Skizze oder die Umrisse eines Fotos. Die KI behält die Linien bei, füllt sie aber komplett neu. Aus einer Kinderzeichnung wird eine fotorealistische Landschaft.

Depth – Eine Tiefenkarte steuert die räumliche Staffelung des Bildes.

ControlNet machte Diffusion Models erst wirklich produktionstauglich für Film und Game Design. Plötzlich konnten Charaktere konsistent in bestimmten Posen dargestellt werden.

Inpainting & Outpainting

Inpainting ist das chirurgische Eingreifen in ein Bild. Du maskierst einen Bereich – zum Beispiel die Sonnenbrille einer Person – und sagst der KI: „Ersetze das durch normale Augen.“ Da das Modell im Kontext des restlichen Bildes arbeitet (Licht, Schatten, Stil), ist die Änderung oft unsichtbar.

Outpainting erweitert die Leinwand. Ein Hochformat-Foto kann zu einem Breitbild-Panorama werden. Die KI „träumt“ den fehlenden Rest dazu, basierend auf dem, was sie am Rand sieht. In der Praxis wird das oft als „Uncrop“ bezeichnet.

LoRA: Eigene Stile trainieren

LoRA (Low-Rank Adaptation) stammt ursprünglich aus der Welt der großen Sprachmodelle, wurde aber für Bilder adaptiert. Die Idee: Anstatt ein riesiges Basismodell komplett neu zu trainieren, trainierst du nur eine winzige Zusatzdatei – typischerweise 20 bis 200 MB groß.

Diese LoRAs funktionieren wie Filter oder Plugins. Du lädst ein Basismodell und schaltest dann ein Anime-LoRA, ein Pixel-Art-LoRA oder ein LoRA für einen bestimmten Kunststil dazu. Das ermöglichte die Explosion an benutzerdefinierten Stilen auf Plattformen wie Civitai.

Video-Diffusion: Von Sora bis Kling

Im Zeitraum 2024 bis 2026 verlagerte sich der Fokus massiv auf bewegte Bilder. Modelle wie Sora (OpenAI), Kling (Kuaishou), Veo (Google) und Runway Gen-3 nutzen im Kern dieselbe Diffusionstechnologie – stehen aber vor einer ungleich schwierigeren Aufgabe.

Das Kernproblem heißt temporale Konsistenz. Ein Video ist eine Abfolge von Bildern. Generierst du jedes einzeln, flackert alles: In Frame 1 trägt die Person ein rotes Hemd, in Frame 2 ist es dunkelrot, in Frame 3 hat es Falten, die vorher nicht da waren.

Wenn dich speziell interessiert, wie OpenAI das Thema Bewegtbild angeht, liefert dir der Überblick zu Sora – OpenAIs Videogenerator im Detail Einblicke in Architektur, Limitierungen und mögliche Anwendungsfälle.

Die Lösung: Moderne Video-Diffusionsmodelle behandeln Zeit als weitere Dimension. Sie generieren nicht Bild für Bild, sondern einen ganzen Block (z. B. 5 Sekunden) gleichzeitig im Latent Space. Dafür nutzen sie Spatio-Temporal Attention – das Modell schaut nicht nur auf die Pixel im aktuellen Bild (räumlich), sondern auch auf die Pixel im Bild davor und danach (zeitlich). Es „weiß“ also, dass das rote Hemd in Frame 1 auch in Frame 10 noch rot sein muss.

2026 ist Kling besonders stark bei physikalisch korrekten Bewegungen (Muskeln, Stoffsimulation), während Google Veo durch hohe Auflösung (4K) und Integration in YouTube Shorts besticht.

Video-Diffusion ist der nächste Evolutionsschritt – und deutlich komplexer als einzelne Frames. Einen direkten Vergleich aktueller Modelle findest du im Video-KI-Vergleich: Sora vs. Runway vs. Kling.

Bekannte Schwächen – und wie sie gelöst wurden

Trotz des rasanten Fortschritts gab es hartnäckige Probleme, die erst spät verschwanden.

Das Finger-Problem

Du kennst die KI-Bilder von 2022/23 mit sechs Fingern oder Händen, die ineinander verschmelzen. Das war kein Bug, sondern eine Folge der Trainingsdaten.

In den Milliarden Fotos, mit denen die Modelle trainiert wurden, sind Hände oft klein, unscharf, halten Objekte oder sind teilweise verdeckt. Für die KI war eine Hand lange Zeit nur eine Ansammlung von fleischfarbenen Schläuchen. Ihr fehlte das anatomische Verständnis: fünf Finger, bestimmte Gelenke, feste Proportionen.

Die Lösung kam durch qualitativ bessere Datensätze (in denen Hände speziell gelabelt wurden) und größere Modelle. In Midjourney v7 und FLUX ist das Problem weitgehend gelöst. Die Interaktion von Händen – etwa verschränkte Finger – bleibt aber auch 2026 noch eine Herausforderung.

Text in Bildern

KI-Modelle „sehen“ Text ursprünglich nur als visuelles Muster – Linien und Kurven, keine Buchstaben. Deshalb erzeugten sie oft Hieroglyphen, die wie Schrift aussahen, aber keinen Sinn ergaben.

Modelle wie Ideogram und FLUX lösten das, indem sie leistungsstarke Text-Encoder (T5) integrierten, die Buchstabe für Buchstabe verarbeiten. Das Modell „buchstabiert“ den Text intern, bevor es ihn malt. Seit 2026 ist korrekte Typografie in KI-Bildern Standard – was komplett neue Anwendungen im Grafikdesign ermöglicht hat.

Ethik und Recht: Urheberrecht, EU AI Act, Glaze & Nightshade

Der technologische Triumph wird von tiefgreifenden gesellschaftlichen Konflikten begleitet.

Der Urheberrechts-Konflikt

Die Modelle wurden mit Milliarden von Bildern aus dem offenen Internet trainiert – meist ohne Einwilligung oder Vergütung der Urheber. Künstler sehen darin einen Diebstahl ihres Lebenswerks, oft als „Style Theft“ bezeichnet.

Die Rechtslage 2026: In den USA laufen weiterhin große Sammelklagen. Es zeichnet sich ab, dass Gerichte das Training oft als „Fair Use“ (transformative Nutzung) betrachten könnten, solange der Output keine direkte 1:1-Kopie ist. Vergleiche deuten auf Entschädigungszahlungen hin, ohne das Geschäftsmodell komplett zu verbieten. Eine endgültige Klärung steht aber noch aus.

Der EU AI Act

Europa wählte einen regulatorischen Weg. Der EU AI Act (seit August 2025 voll wirksam) verpflichtet Anbieter von General Purpose AI Models, detaillierte Zusammenfassungen ihrer Trainingsdaten zu veröffentlichen. Das gibt Urhebern theoretisch die Möglichkeit, Ansprüche zu prüfen und sich per Opt-Out abzumelden.

In der Praxis führt das oft dazu, dass US-Modelle in der EU später oder eingeschränkt erscheinen.

Der digitale Widerstand: Glaze & Nightshade

Da rechtliche Lösungen langsam sind, griffen Künstler zur technologischen Selbstverteidigung. Beide Tools stammen von der University of Chicago.

Glaze funktioniert als Schutzschild. Es legt eine für das menschliche Auge fast unsichtbare Störschicht über ein Bild. Für die KI sieht das Bild danach stilistisch völlig anders aus – ein Ölgemälde wirkt für sie wie moderne abstrakte Kunst. Versucht jemand, einen LoRA auf diesen Stil zu trainieren, lernt die KI nur Müll. Glaze schützt den individuellen Stil eines Künstlers.

Nightshade geht einen Schritt weiter – es ist ein Gift für KI-Modelle. Ein Bild von einem Hund wird so manipuliert, dass die KI es im Latent Space als „Katze“ klassifiziert. Trainieren Firmen massenhaft solche Bilder ungefragt, wird ihr Modell korrumpiert: Nutzer geben „Hund“ ein und bekommen „Katze“. Nightshade dient als Abschreckung gegen unautorisiertes Scraping.

Nicht zuletzt spielt die kreative Dimension eine große Rolle. Wenn du wissen willst, ob KI echte Kreativität besitzt oder nur statistisch imitiert, bietet dir die Reflexion zu KI und Kreativität – philosophische und praktische Perspektiven eine fundierte Einordnung.

Quellen und weitere Informationen

- CVPR: High-Resolution Image Synthesis with Latent Diffusion Models – (Das fundamentale Forschungspapier der LMU München und Stability AI, das die Basis für Stable Diffusion legte.)

- Black Forest Labs – (Offizielle Website der Entwickler von FLUX.1, dem derzeit führenden Modell für Prompt-Adhärenz und Typografie.)

- Midjourney – (Hauptseite des populären KI-Kunst-Tools, inklusive Showcase-Galerie und Web-Interface-Zugang.)

- OpenAI: DALL-E 3 – (Detaillierte Vorstellung des Modells und seiner tiefen Integration in ChatGPT.)

- Stability AI – (Anbieter der Stable Diffusion-Modellfamilie (SDXL, SD3.5) und Hub für die Open-Source-Community.)

- OpenAI: CLIP Research – (Technische Erklärung, wie die Brücke zwischen natürlicher Sprache und visuellen Inhalten geschlagen wird.)

- GitHub: ControlNet – (Das offizielle Repository und die Dokumentation zur präzisen Steuerung von Bildkompositionen.)

- EU AI Act Explorer – (Übersicht und Volltext der europäischen KI-Verordnung zur Transparenz und Ethik.)