KI lernt nicht wie ein Mensch. Sie versteht nichts, sie fühlt nichts, sie hat keine Aha-Momente. Stattdessen durchforstet sie riesige Datenmengen und erkennt darin statistische Muster. Wenn eine KI „weiß“, dass Paris die Hauptstadt von Frankreich ist, dann nicht, weil sie Frankreich auf einer Karte gesehen hat – sondern weil in ihren Trainingsdaten die Wörter „Paris“ und „Hauptstadt“ und „Frankreich“ extrem oft gemeinsam auftauchen.

Das Ganze funktioniert über einen Kreislauf: Die KI bekommt Daten, macht eine Vorhersage, bekommt Feedback und passt sich an. Millionenfach wiederholt. Am Ende steht eine Maschine, die unsere Sprache erstaunlich gut imitiert – ohne ein einziges Wort davon zu begreifen.

Was „Lernen“ bei einer KI wirklich bedeutet

Verstehen vs. Mustererkennung – der fundamentale Unterschied

Denk an ein Kind, das lernt, was eine Katze ist. Es braucht dafür vielleicht drei oder vier Begegnungen. Es streichelt das Fell, hört das Schnurren, wird vielleicht einmal gekratzt. Aus diesen wenigen Erfahrungen entsteht ein echtes Konzept – das Kind versteht, was eine Katze ist.

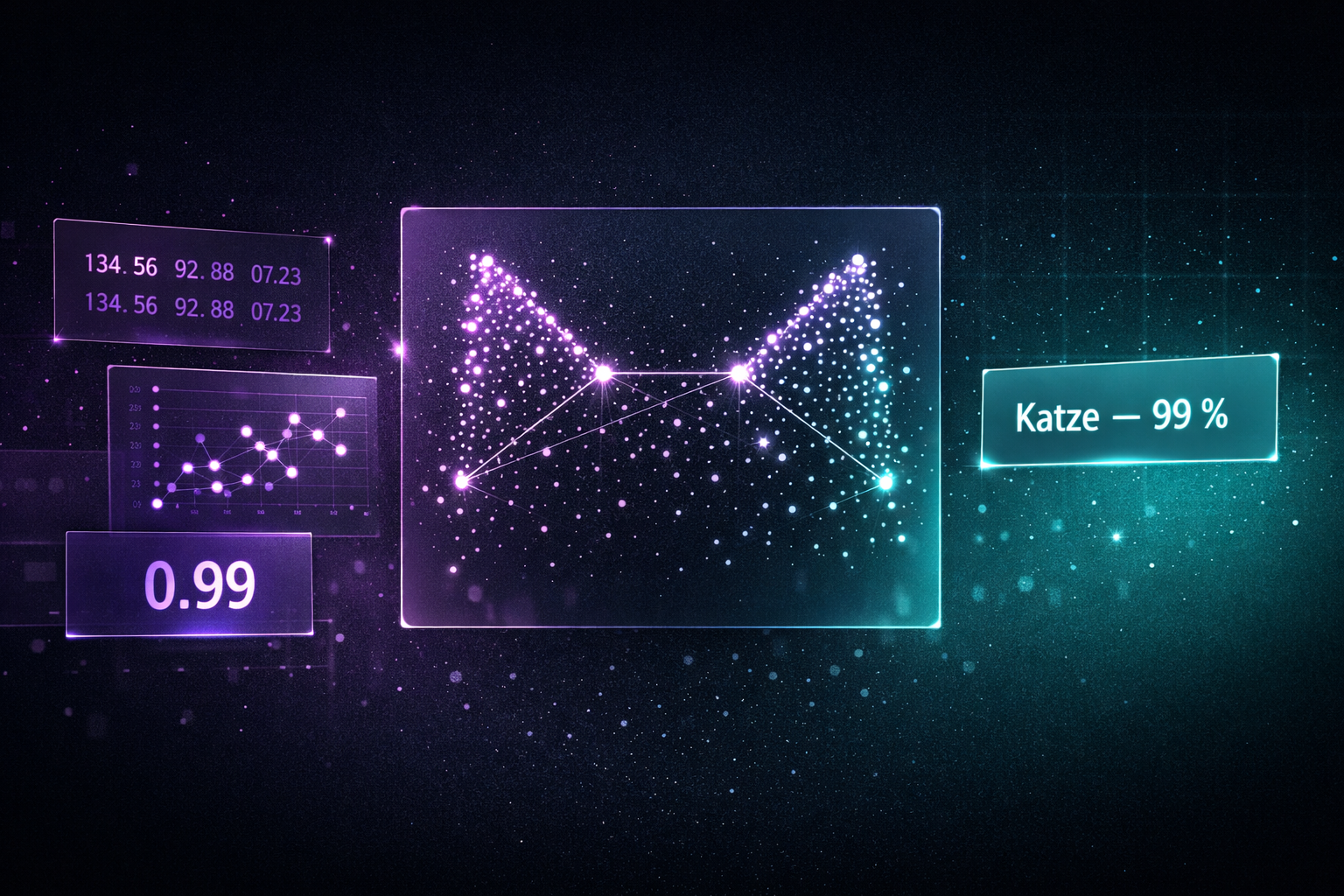

Eine KI hat keinen Körper, keine Sinne, keine Emotionen. Für sie ist ein Katzenbild eine Tabelle aus Millionen Zahlenwerten. Jeder Bildpunkt wird durch Zahlen für Farbe und Helligkeit beschrieben – mehr nicht.

Wenn wir sagen, eine KI „lernt“ Katzen zu erkennen, meinen wir: Sie findet in diesen Zahlen statistische Auffälligkeiten. Sie stellt fest, dass eine bestimmte Anordnung von Werten (die wir als „spitze Ohren“ sehen würden) oft in Dateien mit dem Etikett „Katze“ vorkommt. Die KI versteht nicht, dass Ohren zum Hören da sind. Sie weiß nur: Wenn Muster X auftaucht, ist die Wahrscheinlichkeit für „Katze“ bei 99 %.

Der Kern: Menschliches Lernen basiert auf Kausalität – warum passiert etwas? Maschinelles Lernen basiert auf Korrelation – was tritt oft gemeinsam auf?

Das Beispiel mit der Katzenbilderkennung wird noch greifbarer, wenn du dir anschaust, wie Maschinen visuelle Daten interpretieren – in Computer Vision: Wie KI sehen lernt erfährst du, wie Pixel zu Merkmalen und schließlich zu Klassifikationen werden.

Von starren Regeln zur flexiblen Mustererkennung

Früher mussten Programmierer dem Computer jede Regel einzeln vorgeben: „Wenn der Kontostand unter Null ist, berechne Zinsen.“ Klar, logisch, funktioniert für Buchhaltung.

Aber versuch mal, eine starre Regel für Gesichtserkennung zu schreiben. „Ein Gesicht hat eine Nase“ – okay, aber wie sieht eine Nase aus? Groß, klein, breit, schmal? Was, wenn die Person zur Seite schaut? Die Realität ist zu chaotisch für Wenn-Dann-Regeln.

Beim maschinellen Lernen drehen wir den Prozess um: Wir geben dem Computer nicht die Regeln, sondern Tausende Beispiele mit den dazugehörigen Lösungen. Seine Aufgabe ist es, die Regel selbst zu finden.

Stell dir vor, du willst den Apfelkuchen deiner Großmutter nachbacken – aber sie verrät das Rezept nicht. Also beobachtest du sie 1.000 Mal beim Backen. Du notierst jedes Mal die Zutaten und probierst den Kuchen. Nach langer Beobachtung erkennst du: Immer wenn sie die sauren Äpfel nimmt und viel Zimt dazugibt, schmeckt der Kuchen am besten. Du hast das Muster erkannt – ohne dass dir jemand das Rezept diktiert hat.

Gerade bei der Unterscheidung zwischen Korrelation und Kausalität stolpern viele über Begriffe wie Machine Learning oder Deep Learning – eine klare Einordnung findest du in KI vs. Machine Learning vs. Deep Learning – Unterschiede, damit du Diskussionen nicht nur verstehst, sondern fachlich sauber einordnen kannst.

Wie KI Sprache als Landkarte abbildet

Bei Sprachmodellen wie ChatGPT geht die Mustererkennung noch einen Schritt weiter. Die KI erstellt eine Art Landkarte der Sprache, auf der Wörter mit ähnlicher Bedeutung nahe beieinander liegen.

Wenn du fragst „König verhält sich zu Mann wie Königin zu …?“, ergänzt du sofort „Frau“. Die KI schafft das auch – nicht weil sie Geschlechter versteht, sondern weil sie in Milliarden von Texten festgestellt hat, dass der mathematische Abstand zwischen „König“ und „Mann“ fast identisch ist mit dem Abstand zwischen „Königin“ und „Frau“.

Lernen heißt für die KI: Diese Landkarte so lange verfeinern, bis die Abstände zwischen den Wörtern die Wirklichkeit unserer Sprache widerspiegeln.

Sobald du verstehen willst, warum Sprachmodelle keine Fakten „wissen“, sondern Wahrscheinlichkeiten berechnen, hilft dir der Grundlagenartikel zu wie funktionieren Large Language Models dabei, die Mechanik hinter Tokens, Wahrscheinlichkeitsverteilungen und Vorhersagen präzise nachzuvollziehen.

Trainingsdaten: Der Rohstoff der KI

Woher die Daten kommen

Ohne Daten ist das beste KI-Programm eine leere Hülle. Die überwältigende Mehrheit der Trainingsdaten für Modelle wie ChatGPT stammt aus dem öffentlichen Internet. Automatisierte Programme – sogenannte Crawler – durchforsten das Netz wie ein digitaler Staubsauger und kopieren jeden Text, den sie finden.

Dazu kommen Quellen wie Common Crawl (ein gemeinnütziges Internet-Archiv), digitalisierte Bibliotheken und die gesamte Wikipedia. Wichtig: Die KI liest nicht „live“ im Internet, wenn du ihr eine Frage stellst. Sie hat das Internet vorher gelesen – während ihres Trainings. Ihr Wissen ist eine eingefrorene Momentaufnahme.

Wie viele Daten eine KI braucht – ein Vergleich

Ein Mensch, der viel liest, schafft in seinem Leben vielleicht 5.000 bis 10.000 Bücher. Das sind maximal rund eine Milliarde Wörter.

GPT-4 wurde laut Schätzungen mit etwa 13 Billionen Textbausteinen (Tokens) trainiert. Das ist 20.000- bis 30.000-mal mehr, als ein Mensch je lesen könnte. Würdest du 24 Stunden am Tag lesen, ohne Pause, bräuchtest du über 3.000 Jahre für diese Datenmenge.

Die KI ist also nicht „intelligenter“ im menschlichen Sinne. Sie ist einfach unvorstellbar viel belesener. Sie hat jedes Kochrezept, jede Reparaturanleitung, jedes Gedicht von Goethe und jeden Wikipedia-Artikel über Quantenphysik gesehen – quasi gleichzeitig.

Warum Datenqualität entscheidend ist (Garbage In, Garbage Out)

Menge allein reicht nicht. Der alte Informatik-Grundsatz „Garbage In, Garbage Out“ gilt auch hier: Sind die Trainingsdaten fehlerhaft oder vorurteilsbehaftet, übernimmt die KI genau diese Probleme.

Ein Beispiel: Wenn eine KI überwiegend mit Texten trainiert wird, in denen Führungspositionen mit Männern und Pflegeberufe mit Frauen verknüpft sind, lernt sie dieses Muster als vermeintliche Wahrheit. Deshalb müssen die Daten vor dem Training massiv gereinigt werden – Hassrede, Spam und Unsinn werden herausgefiltert. Wie schmutziges Gemüse, das man wäscht, bevor man daraus eine Suppe kocht.

Parameter: Die Stellschrauben im KI-Gehirn

Was ein Parameter ist – die Mischpult-Analogie

Du liest oft Schlagzeilen wie „GPT-4 hat 1,76 Billionen Parameter“. Aber was ist ein Parameter eigentlich?

Stell dir ein gigantisches Mischpult in einem Tonstudio vor. Jeder Drehregler verändert den Klang: Bass aufdrehen, Hall zudrehen. Ein Parameter ist genau so ein Regler – eine Zahl, die bestimmt, wie stark ein Signal von einem Punkt im Netzwerk zum nächsten weitergeleitet wird.

Eine untrainierte KI ist ein Mischpult, an dem alle Regler zufällig stehen. Vorne sprichst du „Hallo“ hinein, hinten kommt nur Rauschen raus. Das Ziel des Trainings: Jeden einzelnen Regler so justieren, dass am Ende der richtige Klang entsteht.

Die Größenordnung sprengt jede Vorstellung: GPT-4 hat geschätzte 1,76 Billionen solcher Regler. Stell dir ein Mischpult vor, das viermal um die Erde reicht. Und jeder einzelne dieser winzigen Regler muss millimetergenau eingestellt werden.

Warum mehr Parameter mehr Wissen bedeuten

Parameter sind der Speicherort des Wissens. Dass Paris die Hauptstadt von Frankreich ist, steht nirgends als Satz in der KI. Es ist in der Konfiguration von Millionen Parametern kodiert – sie leiten das Signal für „Paris“ so um, dass am Ende „Frankreich“ aufleuchtet.

Ein Modell mit wenigen Parametern ist wie ein grober Pinsel: Es bildet einfache Sätze, macht aber Fehler bei komplexen Themen. Ein Modell mit vielen Parametern gleicht einem Set feinster Pinselspitzen – es kann Nuancen, Ironie und Fachwissen abbilden, weil genug Speicherkapazität in den Einstellungen steckt.

So läuft das Training ab

Die Lernschleife: Vorhersagen, Fehler messen, anpassen

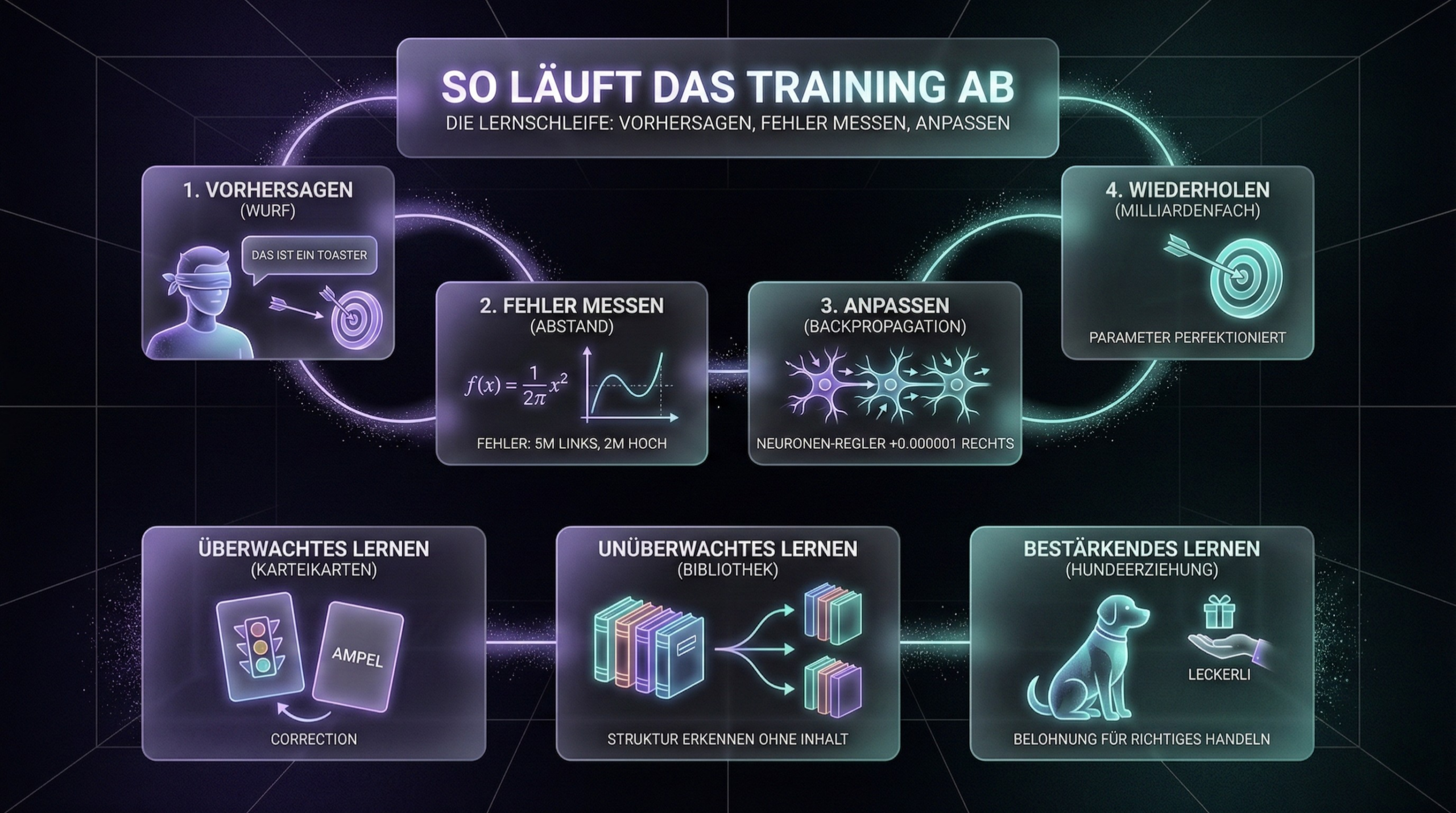

Stell dir die KI als Dartspieler mit verbundenen Augen vor. Das Bullseye ist die richtige Antwort. Der Lernprozess läuft in einer Endlosschleife:

Wurf: Die KI bekommt ein Katzenbild und rät blind. „Das ist ein Toaster.“ Der Pfeil landet in der Wand.

Abstand messen: Eine mathematische Funktion misst den Fehler – wie weit lag der Pfeil daneben? „5 Meter zu weit links, 2 Meter zu hoch.“

Anpassen: Die KI korrigiert ihre Haltung. Jedes der Billionen Neuronen bekommt eine winzige Nachricht: „Dreh deinen Regler ein Millionstel Millimeter nach rechts.“ Das nennt sich Backpropagation – der Fehler wird rückwärts durch das ganze Netzwerk geleitet.

Wiederholen: Nicht zehnmal, sondern milliardenfach. Nach 1.000 Würfen trifft die KI die Scheibe. Nach einer Million die Ringe. Nach einer Milliarde fast immer das Bullseye.

Am Ende sind die Parameter so fein justiert, dass die KI auf fast jede Eingabe die richtige Antwort liefert. Sie hat die „Wurftechnik“ perfektioniert – obwohl sie immer noch blind ist.

Drei Arten des Lernens: Karteikarten, Bibliothek und Hundeerziehung

Je nach Aufgabe nutzt man unterschiedliche Lehrmethoden:

Überwachtes Lernen – die Karteikarten-Methode. Die KI bekommt Beispiele mit Lösungen. Vorderseite: Bild einer Ampel. Rückseite: das Wort „Ampel“. Sie rät, dreht um, korrigiert sich. Wie Vokabeln lernen mit Karteikarten. So funktionieren Spam-Filter und Bilderkennung.

Unüberwachtes Lernen – der Bibliothekar im fremden Archiv. Hier gibt es keine Lösungen. Stell dir vor, du wirst in eine Bibliothek voller Bücher in einer Sprache gesperrt, die du nicht lesen kannst. Du sollst Ordnung schaffen. Den Inhalt verstehst du nicht – aber du erkennst: Diese Bücher haben rote Einbände, jene sind dünn mit vielen Bildern. Du sortierst nach Ähnlichkeit, ohne zu wissen, was drin steht. So lernen Sprachmodelle anfangs die Struktur von Sprache – ohne Grammatikunterricht.

Bestärkendes Lernen – die Hundeerziehung. Hier lernt die KI durch Versuch und Irrtum. Wie bei einem Hund: Du kannst ihm nicht erklären, was „Sitz“ bedeutet. Aber wenn er sich zufällig hinsetzt und ein Leckerli bekommt, speichert er ab: Hinsetzen = Belohnung. So lernen KIs Schach oder Videospiele. Auch ChatGPT wurde im letzten Trainingsschritt so verfeinert: Menschen bewerteten verschiedene Antworten, und die bessere Antwort war das „Leckerli“.

Quellen und weitere Infos:

- Google Machine Learning Crash Course – (Ein interaktives Lernangebot von Google, das die Grundlagen der statistischen Mustererkennung und des maschinellen Lernens fundiert erklärt.)

- OpenAI: Learning from Human Feedback – (In diesem Blogbeitrag erläutert OpenAI im Detail, wie das im Artikel erwähnte „Bestärkende Lernen“ durch menschliches Feedback die Qualität von Sprachmodellen verbessert.)

- Common Crawl – Statistics and Data – (Die offizielle Website des Common-Crawl-Projekts bietet Einblicke in das gewaltige Datenarchiv, das als primärer Rohstoff für das Training moderner KIs dient.)

- IBM Technologieführer: Was ist Machine Learning? – (Eine fachlich präzise Übersicht über die verschiedenen Arten des Lernens, von der klassischen Programmierung bis hin zu tiefen neuronalen Netzen.)

- Meta AI: Generative AI Explainer – (Ein Ressourcen-Hub von Meta, der die mathematischen Konzepte hinter Parametern und der Vorhersage von Sprachmustern für Fachleser aufbereitet.)