GPT-5, Claude Opus, Gemini 3, DeepSeek-R1 und Co. im großen Vergleich – welche API liefert dir am meisten Intelligenz pro Dollar?

Stand: Februar 2026

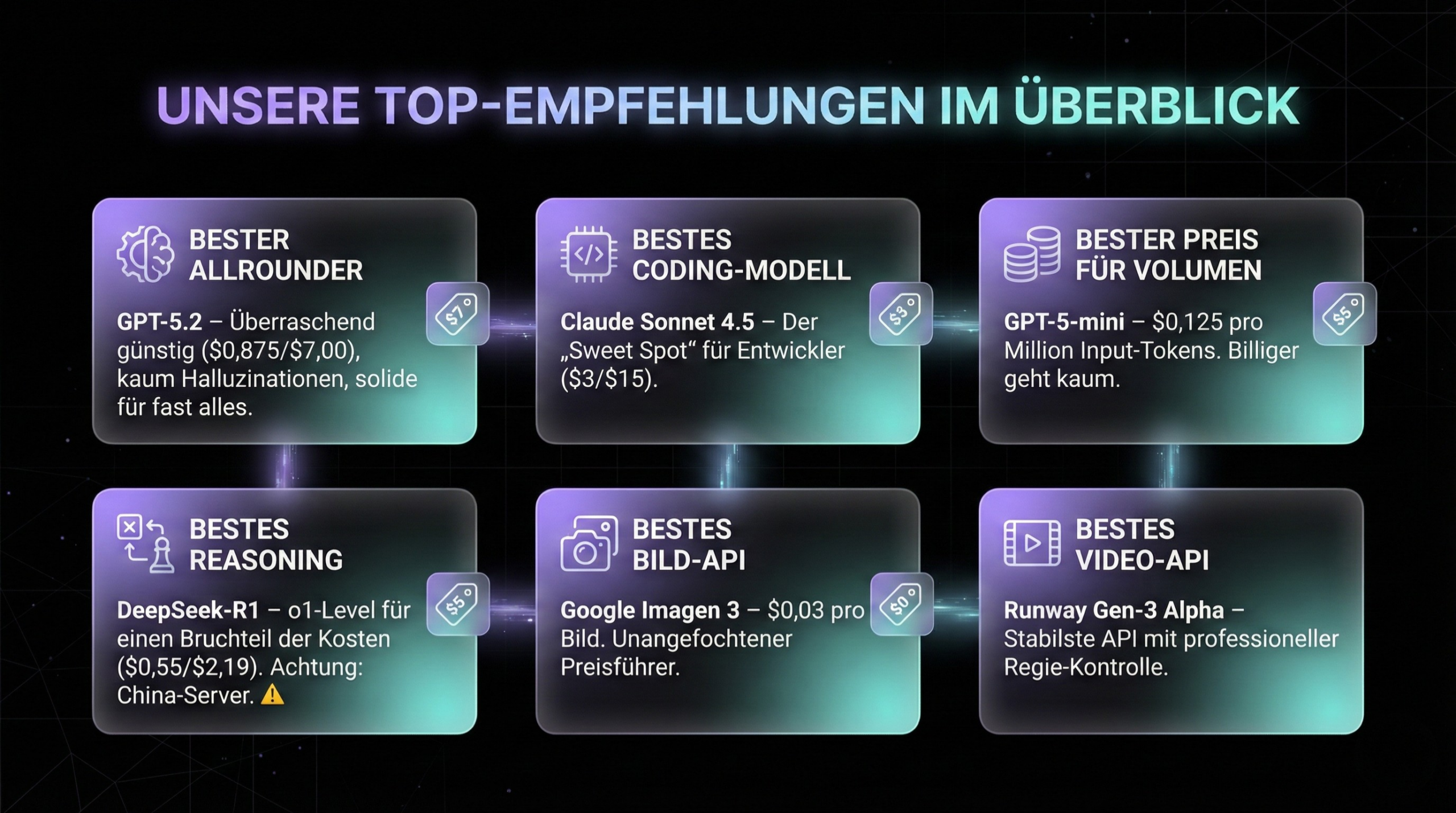

Unsere Top-Empfehlungen im Überblick

Du willst nicht den ganzen Artikel lesen? Hier sind unsere Empfehlungen nach Einsatzzweck – alle Details folgen weiter unten.

- Bester Allrounder: GPT-5.2 – Überraschend günstig ($0,875/$7,00), kaum Halluzinationen, solide für fast alles.

- Bestes Coding-Modell: Claude Sonnet 4.5 – Der „Sweet Spot“ für Entwickler ($3/$15).

- Bester Preis für Volumen: GPT-5-mini – $0,125 pro Million Input-Tokens. Billiger geht kaum.

- Bestes Reasoning: DeepSeek-R1 – o1-Level für einen Bruchteil der Kosten ($0,55/$2,19). Achtung: China-Server.

- Bestes Bild-API: Google Imagen 3 – $0,03 pro Bild. Unangefochtener Preisführer.

- Bestes Video-API: Runway Gen-3 Alpha – Stabilste API mit professioneller Regie-Kontrolle.

Was bedeutet Preis-Leistung bei KI-APIs?

Der KI-API-Markt hat sich 2026 grundlegend verändert. Die Zeit, in der du einfach den Preis pro Token zweier Modelle verglichen hast, ist vorbei. Heute musst du mehrere Dimensionen gleichzeitig im Blick behalten.

Warum der reine Token-Preis nicht reicht

Ein niedriger Input-Preis sagt wenig, wenn das Modell für die gleiche Aufgabe doppelt so viele Tokens im Output braucht. Oder wenn es bei komplexen Prompts halluziniert und du die Anfrage wiederholen musst. Echte Preis-Leistung berücksichtigt den Token-Preis, die Qualität der Antwort (weniger Wiederholungen = weniger Kosten) und die verfügbaren Optimierungen wie Caching.

Versteckte Kosten: Caching, Latenz und Rate Limits

Drei Faktoren werden regelmäßig unterschätzt. Erstens: Caching kann deine Kosten um bis zu 90 % senken – aber nur, wenn du es aktiv nutzt. Zweitens: Latenz kostet indirekt Geld, weil langsame Antworten User-Experience zerstören und bei Agenten-Workflows die Gesamtdauer explodieren lassen. Drittens: Rate Limits können dein Projekt ausbremsen, bevor der Code überhaupt skaliert. OpenAI vergibt höhere Limits erst an Accounts mit Ausgabenhistorie – als Startup startest du mit drastischen Einschränkungen.

Die besten KI-APIs für Text (LLMs)

Der Textmodell-Markt gliedert sich 2026 in drei klare Segmente: Frontier-Modelle für maximale Intelligenz, Effizienz-Modelle für Volumen und Reasoning-Modelle für logisches Denken.

Frontier-Klasse: Maximale Intelligenz

An der Spitze stehen die Modelle für komplexe, missionskritische Aufgaben. Hier geht es nicht um den günstigsten Token, sondern um die beste Antwort.

GPT-5.2 von OpenAI positioniert sich als neuer Standard. Mit $0,875 (Input) und $7,00 (Output) pro Million Tokens ist es überraschend aggressiv bepreist – deutlich günstiger als die initialen GPT-4-Preise von 2024. Die drastisch reduzierte Halluzinationsrate und die verbesserte Befolgung komplexer Systemprompts machen es zum Rückgrat vieler Enterprise-Anwendungen.

Claude Opus 4.6 von Anthropic ist mit $5,00 / $25,00 das teuerste General-Purpose-Modell im Vergleich. Der Preis wird durch zwei Faktoren gerechtfertigt: ein massives 1-Million-Token-Kontextfenster und speziell trainierte Agenten-Fähigkeiten. Für autonome Workflows, die über lange Zeiträume Tools nutzen und Coding-Tasks erledigen, ist Opus derzeit die zuverlässigste Wahl.

Claude Sonnet 4.5 verdient eine besondere Erwähnung: Mit $3,00 / $15,00 gilt es in der Developer-Community als der „Sweet Spot“ für Coding-Assistenten. Es liefert oft bessere Code-Ergebnisse als GPT-5.2.

Gemini 3 Pro von Google kostet $2,00 / $12,00 und nutzt Googles eigene TPU-Infrastruktur für Preispunkte, die GPU-abhängige Konkurrenten kaum erreichen. Achtung: Sobald dein Kontext 200.000 Tokens überschreitet, verdoppelt sich der Input-Preis auf $4,00.

| Modell | Anbieter | Input/1M | Output/1M | Cache Read | Anmerkung |

|---|---|---|---|---|---|

| GPT-5.2 | OpenAI | $0,875 | $7,00 | $0,4375 | Allrounder, niedrige Halluzinationsrate |

| Claude Opus 4.6 | Anthropic | $5,00 | $25,00 | $0,50 | 1M Kontext, Agenten-Spezialist |

| Gemini 3 Pro | $2,00 | $12,00 | $0,20 | TPU-Vorteil, +$4,50/h Cache-Speicher |

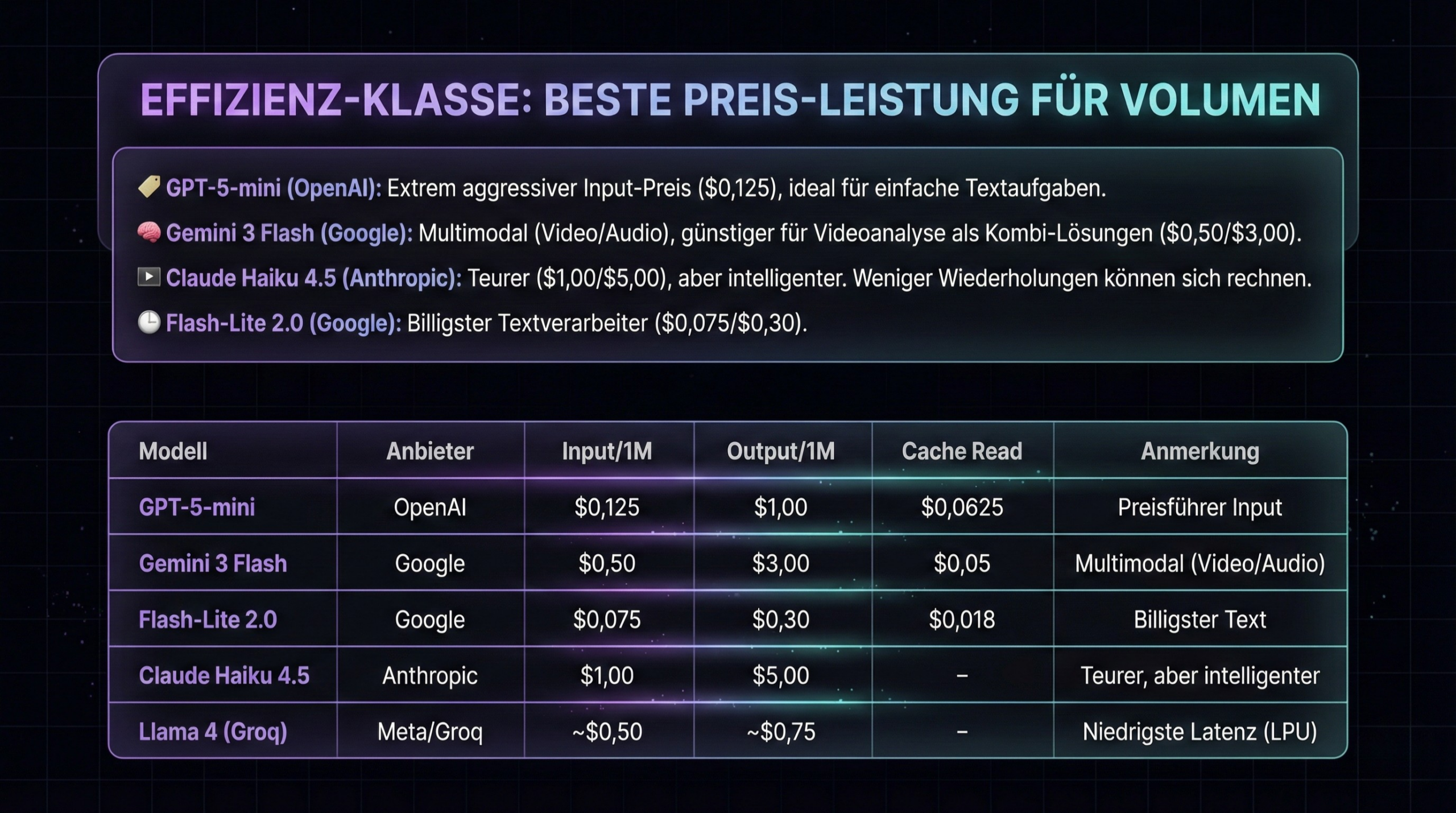

Effizienz-Klasse: Beste Preis-Leistung für Volumen

Für RAG-Pipelines, Log-Analysen und Echtzeit-Klassifikation zählt jeder Cent pro Token. Hier dominieren die „kleinen“ Modelle.

GPT-5-mini ist mit $0,125 im Input extrem aggressiv positioniert – es unterbietet sogar viele Open-Source-Hosting-Optionen, wenn du Hardwarekosten einrechnest. Ideal für einfache Textaufgaben.

Gemini 3 Flash kostet zwar im Input mehr ($0,50), kann dafür aber Videos und lange Audiodateien nativ verarbeiten. Wenn du stundenlanges Videomaterial analysieren musst, fährst du mit Flash oft günstiger als mit einer Kombination aus Whisper und GPT-5-mini.

Claude Haiku 4.5 ist mit $1,00 / $5,00 teurer als die Konkurrenz, liefert aber spürbar intelligentere Antworten. Wenn du die Wiederholungsrate durch Qualität senkst, kann sich der Aufpreis rechnen.

Am unteren Ende sitzt Flash-Lite 2.0 von Google mit $0,075 / $0,30 – der billigste Textverarbeiter auf dem Markt.

Effizienz-Modelle wie GPT-5-mini spielen ihre Stärke besonders dann aus, wenn du Small-Language-Model-Logik verstehst – der Beitrag zu Was sind Small Language Models? zeigt dir, warum kleinere Modelle oft das bessere Verhältnis aus Kosten, Geschwindigkeit und ausreichend guter Intelligenz liefern. Das hilft dir, nicht reflexartig zum teuersten Modell zu greifen.

| Modell | Anbieter | Input/1M | Output/1M | Cache Read | Anmerkung |

|---|---|---|---|---|---|

| GPT-5-mini | OpenAI | $0,125 | $1,00 | $0,0625 | Preisführer Input |

| Gemini 3 Flash | $0,50 | $3,00 | $0,05 | Multimodal (Video/Audio) | |

| Flash-Lite 2.0 | $0,075 | $0,30 | $0,018 | Billigster Text | |

| Claude Haiku 4.5 | Anthropic | $1,00 | $5,00 | – | Teurer, aber intelligenter |

| Llama 4 (Groq) | Meta/Groq | ~$0,50 | ~$0,75 | – | Niedrigste Latenz (LPU) |

Reasoning-Modelle: Wenn Logik zählt

Reasoning-Modelle wie DeepSeek-R1 und OpenAIs o-Serie generieren eine interne Gedankenkette, die dir nicht angezeigt wird – aber als Output-Token berechnet wird. Das verändert die Kostenkalkulation fundamental.

DeepSeek-R1 hat den Markt mit $0,55 / $2,19 erschüttert. Es bietet Reasoning-Fähigkeiten auf o1-Niveau zu einem Bruchteil der Kosten. Bei Cache-Hits sinkt der Input-Preis sogar auf $0,14. Der Haken: Deine Daten fließen potenziell über chinesische Server.

o3-mini von OpenAI bietet mit $1,10 / $4,40 starke Logik zu bezahlbaren Preisen und zielt auf Entwickler, die Reasoning für Agenten-Workflows brauchen, ohne das Budget zu sprengen.

Am oberen Ende stehen o3-Pro ($10 / $40) und o1-Pro ($75 / $300). Letzteres ist effektiv auf Nischen wie pharmazeutische Forschung beschränkt.

| Modell | Anbieter | Input/1M | Output/1M | Cache Read | Anmerkung |

|---|---|---|---|---|---|

| DeepSeek-R1 | DeepSeek | $0,55 | $2,19 | $0,14 | Preis-Leistungs-Sieger (China-Risiko) |

| o3-mini | OpenAI | $1,10 | $4,40 | $0,55 | Best Value Logic |

| o3-Pro | OpenAI | $10,00 | $40,00 | – | Wissenschaft & Mathematik |

| o1-Pro | OpenAI | $75,00 | $300,00 | – | Extreme Premium-Nische |

Die Kostenfalle bei Thinking Tokens: Du erwartest eine Antwort von 100 Tokens, aber das Modell generiert intern 5.000 Thinking Tokens zur Verifikation. Setze unbedingt max_completion_tokens, um Kostenexplosionen zu vermeiden. Aber Vorsicht: Zu niedrige Limits können den Gedankengang abbrechen, bevor ein Ergebnis vorliegt.

Die besten KI-APIs für Bilder

Während Text-APIs immer günstiger werden, bleibt Bildgenerierung ein Premium-Markt mit hohen Margen.

Google Imagen 3 ist mit $0,03 pro Bild der unangefochtene Preisführer. Für E-Commerce-Plattformen, die Millionen Produktbild-Variationen brauchen, gibt es derzeit keine günstigere Option.

DALL-E 3 kostet $0,04–$0,12 je nach Auflösung. Der Vorteil: Automatisches Prompt-Rewriting durch GPT-4o senkt die Einstiegshürde enorm. Du musst kein Prompt-Engineering beherrschen.

Stable Diffusion 3.5 Large liegt bei ~$0,065 pro Bild und bietet maximale Kontrolle über Parameter wie Prompt Strength, Seed und Skalierung – Features, die DALL-E fehlen.

Midjourney liefert ästhetisch die besten Ergebnisse, bietet aber Stand Februar 2026 immer noch keine offizielle API. Der Zugang bleibt auf Discord und Web beschränkt. Inoffizielle Wrapper sind für Enterprise-Anwendungen wegen Compliance-Risiken keine Option.

Bild-APIs wie Imagen 3 oder DALL-E entfalten ihr Potenzial erst, wenn du ihre technischen Unterschiede kennst. Der fundierte KI-Bildgeneratoren Vergleich Midjourney vs. OpenAI vs. Leonardo AI zeigt dir, wo Preis, Stil und API-Fähigkeiten auseinandergehen – besonders relevant für skalierende Kreativ-Workflows.

| Modell | Anbieter | Preis | Anmerkung |

|---|---|---|---|

| Imagen 3 | $0,03 / Bild | Preisführer, Vertex AI | |

| DALL-E 3 | OpenAI | $0,04–$0,12 / Bild | GPT-Integration, leichter Einstieg |

| SD 3.5 Large | Stability AI | ~$0,065 / Bild | Maximale Kontrolle (Seed, Strength) |

Die besten KI-APIs für Video

2026 überschreitet Video-Generierung die Schwelle vom Experiment zum Produkt. Die Preise werden pro Sekunde generiertem Video berechnet.

Runway Gen-3 Alpha bietet die stabilste API mit feingranularer Kontrolle über Kamerabewegungen (Motion Brush). Die Kosten liegen bei $0,10–$0,25 pro Sekunde – ideal für professionelle Marketing-Tools.

Google Veo kostet $0,35 pro Sekunde und punktet mit Enterprise-Compliance: Google garantiert, dass deine Daten nicht zum Training verwendet werden.

OpenAI Sora 2 setzt Maßstäbe in physikalischer Kohärenz, ist mit $0,50+ pro Sekunde aber teuer und durch Rate Limits oft eingeschränkt.

Luma Dream Machine positioniert sich als Budget-Option mit $0,05–$0,10 pro Sekunde. Für schnelle Drafts und Iterationen eine gute Wahl.

Minimax / Hailuo aus China liegt 50–70 % unter den US-Preisen bei beeindruckender Qualität menschlicher Bewegungen. Ein Geheimtipp – sofern du keine Datenschutzbedenken wegen chinesischer Server hast.

Videogenerierung ist 2026 kein Spielzeug mehr, sondern Produktionswerkzeug. Der umfassende Video-KI Vergleich Sora 2 vs. Runway Gen-4.5 vs. Kling 3.0 hilft dir abzuschätzen, ob höhere Sekundenpreise durch bessere physikalische Kohärenz oder Regiekontrolle gerechtfertigt sind.

| Modell | Anbieter | Preis | Anmerkung |

|---|---|---|---|

| Runway Gen-3 Alpha | Runway | $0,10–$0,25 / Sek. | Stabilste API, Motion Brush |

| Google Veo | $0,35 / Sek. | Enterprise-Compliance | |

| Sora 2 | OpenAI | $0,50+ / Sek. | Beste physikalische Kohärenz |

| Luma Dream Machine | Luma | $0,05–$0,10 / Sek. | Budget-Option |

| Minimax / Hailuo | Minimax | 50–70 % günstiger | China-Server, gute Bewegungen |

Die besten KI-APIs für Audio

Text-to-Speech: ElevenLabs vs. OpenAI vs. Google

ElevenLabs bleibt der Goldstandard für emotionale, menschliche Sprache. Das Preismodell ist Premium: $0,22 pro 1.000 Zeichen. Ein Hörbuch mit 100.000 Wörtern kostet über $130.

OpenAI TTS ist mit $0,015 pro 1.000 Zeichen fast 15-mal günstiger. Die Qualität ist gut genug für Assistenten und Chatbots, erreicht aber nicht die emotionale Tiefe von ElevenLabs.

Google Cloud TTS hat mit den neuen „Studio“-Stimmen qualitativ aufgeholt – kostet aber mit $0,16 pro 1.000 Zeichen fast so viel wie ElevenLabs. Die Standard-Stimmen (Neural2) sind mit $0,016 hingegen extrem günstig.

Speech-to-Text: Whisper vs. Deepgram

OpenAI Whisper ist der Industriestandard mit $0,006 pro Minute ($0,36/Stunde). Zuverlässig, gut dokumentiert, breit unterstützt.

Deepgram positioniert sich über Geschwindigkeit und Features: Diarization (Sprechererkennung), Real-Time-Streaming und geringere Latenz als Whisper. Preise sind bei Volumenverträgen oft noch aggressiver. Erste Wahl für Telefon-Bots.

| Modell | Anbieter | Preis | Anmerkung |

|---|---|---|---|

| ElevenLabs TTS | ElevenLabs | $0,22 / 1k Zeichen | Goldstandard Emotion |

| OpenAI TTS | OpenAI | $0,015 / 1k Zeichen | Günstig, gut genug für Assistenten |

| Google Cloud TTS (Studio) | $0,16 / 1k Zeichen | Qualitativ nah an ElevenLabs | |

| OpenAI Whisper (STT) | OpenAI | $0,006 / Minute | Industriestandard STT |

| Deepgram (STT) | Deepgram | Volumenbasiert | Schneller, Diarization, Real-Time |

Open-Source: Selbst hosten oder API nutzen?

Die Hardware-Realität: Was Llama 4 wirklich kostet

Meta hat mit Llama 4 erneut den Standard für offene Modelle gesetzt. Aber „Open Source“ heißt selten „kostenlos“. Ein Llama 4 70B mit akzeptabler Latenz braucht mindestens zwei NVIDIA H100-Karten.

Eine schnelle Rechnung: 2 × H100 bei ca. $2,50/Stunde = $5,00/Stunde = $3.600 pro Monat. Für das gleiche Geld kannst du bei GPT-5-mini fast 29 Milliarden Input-Tokens verarbeiten. Selbst-Hosting lohnt sich erst bei extremen Volumen oder wenn Datenschutzanforderungen den Einsatz von US-Cloud-APIs verbieten.

Inferenz-Provider: Groq, Together AI, Fireworks

Groq hat mit seiner LPU-Architektur die Latenz-Gleichung verändert: 500+ Tokens pro Sekunde für Llama-Modelle, preislich bei ~$0,50–$0,75 pro Million Tokens. Ideal für Echtzeit-Sprach-Anwendungen.

Together AI und Fireworks nutzen MoE-Optimierungen für Modelle wie Mistral Large 3 und liegen bei ca. $2,00 (Input) / $6,00 (Output). Günstiger als Selbst-Hosting, aber teurer als die Mini-Modelle der Hyperscaler.

Caching als Game-Changer: So senkst du deine API-Kosten

Im Jahr 2026 ist nicht mehr das Modell allein entscheidend, sondern wie effizient du ihm Informationen bereitstellst. Context Caching ist die wichtigste Technik, um RAG-Anwendungen wirtschaftlich zu betreiben.

Anthropic: Granulares Caching mit 90 % Rabatt

Anthropic bietet das ausgefeilteste System. Das Schreiben in den Cache kostet einen Aufschlag (z.B. $3,75 statt $3,00 bei Sonnet 4.5), aber das Lesen ist um bis zu 90 % rabattiert – z.B. $0,30 statt $3,00. Der Break-Even liegt oft schon bei der zweiten Anfrage. Für Agenten in Schleifen, die denselben Kontext immer wieder brauchen, ein enormer Hebel.

Google: Zeitbasiertes Caching für Hochfrequenz-Anwendungen

Google berechnet neben Token-Kosten eine Speichergebühr von $4,50 pro 1M Tokens pro Stunde für Gemini 3 Pro. Das lohnt sich, wenn ein Kontext – etwa ein Support-Handbuch – tausende Male pro Stunde abgefragt wird. Bei sporadischen Anfragen ist das Modell weniger attraktiv, weil die „Miete“ auch bei Inaktivität anfällt.

DeepSeek: Automatisches Prefix-Caching ohne Setup

Der entwicklerfreundlichste Ansatz: DeepSeek erkennt automatisch, wenn der Anfang eines Prompts identisch mit einem vorherigen ist, und berechnet dann den rabattierten Preis von $0,14 statt $0,55. Keine explizite Cache-Verwaltung nötig – die Implementierungshürde fällt komplett weg.

Faustregel: Wenn du denselben Kontext mehr als zweimal verwendest, lohnt sich Caching fast immer. Bei Anthropic sparst du ab der zweiten Anfrage, bei Google musst du die stündliche Speichergebühr gegen dein Anfragevolumen rechnen.

Große Vergleichstabelle: Alle Preise auf einen Blick

Alle wichtigen Modelle, normiert auf 1 Million Tokens (Input/Output). Preise vom Februar 2026.

Frontier-Modelle

| Modell | Anbieter | Input/1M | Output/1M | Cache Read | Anmerkung |

|---|---|---|---|---|---|

| GPT-5.2 | OpenAI | $0,875 | $7,00 | $0,4375 | Allrounder, niedrige Halluzinationsrate |

| Claude Opus 4.6 | Anthropic | $5,00 | $25,00 | $0,50 | 1M Kontext, Agenten-Spezialist |

| Gemini 3 Pro | $2,00 | $12,00 | $0,20 | TPU-Vorteil, +$4,50/h Cache-Speicher |

Effizienz-Modelle

| Modell | Anbieter | Input/1M | Output/1M | Cache Read | Anmerkung |

|---|---|---|---|---|---|

| GPT-5-mini | OpenAI | $0,125 | $1,00 | $0,0625 | Preisführer Input |

| Gemini 3 Flash | $0,50 | $3,00 | $0,05 | Multimodal (Video/Audio) | |

| Flash-Lite 2.0 | $0,075 | $0,30 | $0,018 | Billigster Text | |

| Claude Haiku 4.5 | Anthropic | $1,00 | $5,00 | – | Teurer, aber intelligenter |

| Llama 4 (Groq) | Meta/Groq | ~$0,50 | ~$0,75 | – | Niedrigste Latenz (LPU) |

Reasoning-Modelle

| Modell | Anbieter | Input/1M | Output/1M | Cache Read | Anmerkung |

|---|---|---|---|---|---|

| DeepSeek-R1 | DeepSeek | $0,55 | $2,19 | $0,14 | Preis-Leistungs-Sieger (China-Risiko) |

| o3-mini | OpenAI | $1,10 | $4,40 | $0,55 | Best Value Logic |

| o3-Pro | OpenAI | $10,00 | $40,00 | – | Wissenschaft & Mathematik |

| o1-Pro | OpenAI | $75,00 | $300,00 | – | Extreme Premium-Nische |

Bildgenerierung

| Modell | Anbieter | Preis | Anmerkung |

|---|---|---|---|

| Imagen 3 | $0,03 / Bild | Preisführer, Vertex AI | |

| DALL-E 3 | OpenAI | $0,04–$0,12 / Bild | GPT-Integration, leichter Einstieg |

| SD 3.5 Large | Stability AI | ~$0,065 / Bild | Maximale Kontrolle (Seed, Strength) |

Videogenerierung

| Modell | Anbieter | Preis | Anmerkung |

|---|---|---|---|

| Runway Gen-3 Alpha | Runway | $0,10–$0,25 / Sek. | Stabilste API, Motion Brush |

| Google Veo | $0,35 / Sek. | Enterprise-Compliance | |

| Sora 2 | OpenAI | $0,50+ / Sek. | Beste physikalische Kohärenz |

| Luma Dream Machine | Luma | $0,05–$0,10 / Sek. | Budget-Option |

| Minimax / Hailuo | Minimax | 50–70 % günstiger | China-Server, gute Bewegungen |

Audio (TTS & STT)

| Modell | Anbieter | Preis | Anmerkung |

|---|---|---|---|

| ElevenLabs TTS | ElevenLabs | $0,22 / 1k Zeichen | Goldstandard Emotion |

| OpenAI TTS | OpenAI | $0,015 / 1k Zeichen | Günstig, gut genug für Assistenten |

| Google Cloud TTS (Studio) | $0,16 / 1k Zeichen | Qualitativ nah an ElevenLabs | |

| OpenAI Whisper (STT) | OpenAI | $0,006 / Minute | Industriestandard STT |

| Deepgram (STT) | Deepgram | Volumenbasiert | Schneller, Diarization, Real-Time |

Alle Preise sind Momentaufnahmen vom Februar 2026 und können Währungsschwankungen oder kurzfristigen Anpassungen unterliegen.

Während sich Frontier-Modelle wie GPT-5.2 und Claude Opus im High-End-Segment positionieren, bekommst du mit dem direkten Top-Modelle Vergleich OpenAI vs. Anthropic ein klares Bild davon, wie sich die Philosophien, Preisstrukturen und Agentenfähigkeiten der beiden Schwergewichte unterscheiden – eine essenzielle Entscheidung, wenn du langfristig auf einen Anbieter setzen willst.

Welche API für welchen Einsatzzweck?

Das „beste“ Modell gibt es nicht – nur das beste Modell für deinen konkreten Fall. Hier unsere Empfehlungen für fünf typische Szenarien.

Enterprise Coding-Assistent

Empfehlung: Claude Sonnet 4.5 (via AWS Bedrock/Vertex)

Sonnet 4.5 bietet das beste Verhältnis aus Coding-Performance und Preis ($3/$15). Das große Kontextfenster erlaubt das Einlesen ganzer Codebasen, Bedrock garantiert Compliance.

Alternative: DeepSeek-R1 (nur bei nicht-proprietärem Code)

Sobald Coding-Performance und Codeverständnis im Fokus stehen, lohnt sich ein Blick auf den detaillierten Coding-Assistenten Vergleich GitHub Copilot vs. Cursor vs. Windsurf, um zu prüfen, welches Tool deine API-Entscheidung am sinnvollsten ergänzt. Denn das beste Modell bringt wenig, wenn dein Editor-Workflow nicht mithält.

High-Volume RAG-Chatbot

Empfehlung: Gemini 3 Flash

Mit $0,50/1M Input unschlagbar günstig für große Kontexte. Das massive Kontextfenster kann eine Vektor-Datenbank oft komplett ersetzen.

Alternative: GPT-5-mini (noch günstiger, aber kein Multimodal)

Die größte Kostenersparnis entsteht häufig durch saubere RAG-Architektur statt durch Modellwechsel. Wenn du nachvollziehen willst, wie Retrieval-Ansätze deine Token-Kosten drastisch senken können, findest du im Guide zu RAG erklärt – wie LLMs externes Wissen nutzen das technische Fundament für wirtschaftliche High-Volume-Chatbots.

Kreativ-Agentur (Bild & Video)

Empfehlung: Midjourney (Web) + Runway Gen-3

Midjourney liefert die ästhetisch besten Bilder, Runway die beste Regie-Kontrolle für Video.

Alternative: Imagen 3 + Luma (Budget-Variante)

Autonomer Forschungs-Agent

Empfehlung: o3-mini oder DeepSeek-R1

Starke Reasoning-Fähigkeiten zu bezahlbaren Preisen. o3-mini als Arbeitspferd, o3-Pro nur für kritische Eskalation.

Alternative: Claude Opus 4.6 (wenn Agenten-Fähigkeiten wichtiger als Reasoning)

Echtzeit-Sprachübersetzer

Empfehlung: OpenAI Realtime API (GPT-4o-audio)

Native Audio-Verarbeitung eliminiert STT/TTS als separate Schritte und reduziert Latenz drastisch.

Alternative: Groq + Deepgram (schneller Text, aber Latenz durch Kopplung)

Spätestens bei autonomen Workflows wird klar, dass es nicht nur um Token-Preise geht, sondern um Systemarchitektur. Der Guide zu KI-Agenten – was sind autonome Systeme? hilft dir zu entscheiden, ob ein teureres Agenten-Modell wie Claude Opus für deine Anwendung wirklich gerechtfertigt ist.

Compliance und Datenschutz: Was deutsche Entwickler wissen müssen

Für deutsche Entwickler ist der Standort der Datenverarbeitung essenziell. Hier die Kurzübersicht:

Microsoft Azure OpenAI und Google Vertex AI bieten Garantien für Datenresidenz in EU-Regionen (Frankfurt, Amsterdam). Das ist oft der einzige Weg, GPT-5 oder Gemini 3 DSGVO-konform in Konzernen einzusetzen.

Anthropic bietet AWS Bedrock und Google Vertex Integrationen, um von deren Compliance-Zertifikaten zu profitieren.

DeepSeek und Minimax: Daten fließen potenziell über chinesische Server. Für EU-Unternehmensanwendungen ist das in der Regel ein Ausschlusskriterium – unabhängig vom attraktiven Preis.

Achtung Free Tier: Googles AI Studio lässt dich Gemini 3 Pro und Flash kostenlos nutzen, aber im Free Tier können deine Eingaben für Modelltraining genutzt werden. Für produktive oder vertrauliche Daten ist das keine Option.

FAQ

Was kostet eine KI-API im Durchschnitt?

Das hängt stark vom Segment ab. Effizienz-Modelle starten bei $0,075 pro Million Input-Tokens (Flash-Lite 2.0), Frontier-Modelle liegen zwischen $0,875 (GPT-5.2) und $5,00 (Claude Opus 4.6). Reasoning-Modelle können bis $75 pro Million Tokens kosten. Ein „Durchschnitt“ ist wenig aussagekräftig – entscheidend ist dein Anwendungsfall.

Welche KI-API hat das beste Preis-Leistungs-Verhältnis?

Für reine Textaufgaben mit Volumen: GPT-5-mini. Für Coding: Claude Sonnet 4.5. Für Reasoning: DeepSeek-R1 (mit Datenschutz-Einschränkung) oder o3-mini. Für Bilder: Google Imagen 3. Es gibt keinen einzelnen Gewinner – nur den besten für deinen Fall.

Lohnt sich Selbst-Hosting mit Open-Source-Modellen?

Wirtschaftlich erst bei extremen Volumen. Zwei H100-Karten für ein Llama 4 70B kosten ca. $3.600/Monat. Dafür bekommst du bei GPT-5-mini fast 29 Milliarden Input-Tokens. Selbst-Hosting macht vor allem Sinn, wenn Datenschutz (Zero-Data-Retention, On-Premise) den Einsatz von Cloud-APIs verbietet.

Wie kann ich meine API-Kosten senken?

Drei Hebel: Erstens Context Caching nutzen (bis 90 % Rabatt bei Anthropic). Zweitens das richtige Modell für die Aufgabe wählen – nicht jede Anfrage braucht ein Frontier-Modell. Drittens bei Reasoning-Modellen max_completion_tokens setzen, um Thinking-Token-Explosionen zu vermeiden.

Sind chinesische Anbieter wie DeepSeek DSGVO-konform?

In der Regel nicht für EU-Unternehmensanwendungen. Daten fließen potenziell über Server in China, was DSGVO-Anforderungen an Datenresidenz und Datenschutz in den meisten Fällen nicht erfüllt. Für nicht-sensible Daten oder Forschungszwecke kann es eine Option sein – aber prüfe das mit deiner Rechtsabteilung.

Am Ende entscheidet dein Budgetrahmen über jede Architektur. Damit du deine API-Kosten nicht nur pro Token, sondern gesamtheitlich kalkulierst, unterstützt dich der praxisnahe KI-Tool Kosten & Budget Guide bei der Planung von Volumen, Caching und Eskalationsstrategien – besonders wertvoll, wenn dein Projekt gerade von MVP zu Skalierung wächst.

Fazit

Die Ära der einfachen Preisvergleiche ist vorbei. Als Entwickler musst du 2026 Architekt sein – nicht nur von Code, sondern von Kostenflüssen.

Der Schlüssel liegt nicht darin, das eine „beste“ Modell zu finden. Stattdessen dirigierst du ein Orchester aus spezialisierten Modellen: GPT-5-mini oder Flash-Lite für die Masse, Sonnet 4.5 oder GPT-5.2 für komplexe Aufgaben, DeepSeek-R1 oder o3-mini für logische Schwerstarbeit. Dazu Caching, das deine Kosten um 90 % senken kann, und eine bewusste Wahl zwischen Qualität, Geschwindigkeit und Compliance.

Unser wichtigster Rat: Starte mit einem günstigen Modell und eskaliere nur, wo die Qualität es verlangt. Die meisten Aufgaben in einer typischen KI-Anwendung brauchen kein Frontier-Modell. Wer das versteht, spart nicht nur Geld, sondern baut robustere Systeme.