Kurzfazit: OpenAI oder Anthropic – wer liegt vorn?

Die ehrliche Antwort: Beide – und keines von beiden. Seit dem 5. Februar 2026 hat die KI-Landschaft einen Punkt erreicht, an dem es kein universelles „bestes Modell“ mehr gibt. Stattdessen dominieren zwei Philosophien, die unterschiedliche Stärken bedienen.

OpenAI setzt mit dem GPT-5.3-Codex auf Geschwindigkeit, multimodale Vielfalt und agentisches Coding. Wenn du schnelle Iterationen, Video-Analyse oder ein günstiges API-Pricing brauchst, bist du hier richtig.

Anthropic kontert mit Claude Opus 4.6 durch Deep Reasoning, ein Kontextfenster von einer Million Token und überlegene Schreibqualität – besonders im Deutschen. Für komplexe Analysen, juristische Dokumente und redaktionelle Texte ist Opus die erste Wahl.

Kernaussage: Die Ära des „One-Size-Fits-All“-Modells ist vorbei. Der Erfolg deiner KI-Implementierung hängt davon ab, das richtige Werkzeug für die richtige Aufgabe zu wählen.

Die Modelle im Überblick

Beide Anbieter haben ihre Portfolios aufgefächert. OpenAI betreibt eine breite Diversifizierung, Anthropic eine vertikale Spezialisierung auf Textintelligenz.

GPT-5-Familie: GPT-5.2, GPT-5.3-Codex & o3-Pro

GPT-5.2 ist das Generalisten-Flaggschiff – nativ multimodal mit Text, Audio und Video-Verarbeitung. Es ersetzt die GPT-4o-Linie und bietet dynamische „Thinking“-Modi, die die Reasoning-Tiefe je nach Aufgabe steuern.

GPT-5.3-Codex, veröffentlicht am 5. Februar 2026, ist kein Allround-Upgrade, sondern ein Spezialist für Softwareentwicklung. Es kombiniert GPT-5-Trainingsdaten mit einem spezialisierten Codex-Datensatz und wurde auf agentische Interaktion getrimmt – Terminal-Bedienung, Dateisystem-Verwaltung, iteratives Debugging.

Die o-Serie (o3-Pro) ergänzt das Portfolio für Aufgaben mit höchster mathematischer und wissenschaftlicher Präzision, allerdings zu deutlich höheren Kosten und mit mehr Latenz.

Sobald du regelmäßig mit ChatGPT arbeitest, ist nicht nur das Modell, sondern das gesamte Ökosystem entscheidend. Im strukturierten Überblick zu ChatGPT – Funktionen, Modelle und Einsatzbereiche im Detail siehst du, welche Versionen, Modi und Integrationen aktuell relevant sind – vom Standard-Chat bis zum agentischen Coding-Setup.

Claude-4-Familie: Opus 4.6 & Sonnet 4.5

Claude Opus 4.6, ebenfalls am 5. Februar 2026 erschienen, ist Anthropics Flaggschiff für Deep Reasoning. Sein Alleinstellungsmerkmal: „Adaptive Thinking“ – das Modell entscheidet während der Inferenz selbstständig, wie viel Rechenzeit eine Teilaufgabe benötigt. Dazu kommt ein Kontextfenster von einer Million Token im Beta-Stadium.

Claude Sonnet 4.5 fungiert als effizientes Arbeitspferd für den Alltag. Es balanciert Intelligenz und Geschwindigkeit und ist für Standard-Chat-Aufgaben optimiert – bleibt in den anspruchsvollsten Benchmarks aber hinter Opus zurück.

Gerade bei Claude entscheidet die richtige Tarif- und Modellwahl darüber, ob du das 1-Millionen-Token-Fenster wirklich sinnvoll nutzt. Der Deep Dive im Claude-Überblick – Modelle, Stärken und Grenzen im Detail hilft dir, Opus, Sonnet und ihre Einsatzszenarien sauber zu unterscheiden, bevor du dich langfristig festlegst.

Preisvergleich

API-Preise pro Million Token

Für Entwickler und Unternehmen sind die Token-Kosten der entscheidende Faktor. Hier zeigt sich eine klare Divergenz: OpenAI fährt eine aggressive Preisstrategie, Anthropic positioniert sich als Premium-Anbieter.

| Modell | Input / 1M Token | Output / 1M Token |

|---|---|---|

| GPT-5.2 | 1,75 $ | 14,00 $ |

| GPT-5.2 Pro | 21,00 $ | 168,00 $ |

| Claude Opus 4.6 | 5,00 $ | 25,00 $ |

| Opus 4.6 Long Context | 10,00 $ (ab 200k Token) | 37,50 $ |

GPT-5.2 kostet im Input knapp ein Drittel von Claude Opus 4.6. Für Massenanwendungen und Standard-Tasks ist OpenAI aus Kostensicht der klare Sieger. Wer allerdings Claudes massives Kontextfenster über 200.000 Token nutzt, zahlt den doppelten Input-Preis – das 1M-Fenster ist ein echtes Luxusgut.

Abo-Modelle: ChatGPT Plus/Pro vs. Claude Pro/Max

| Abo | Preis | Kernfeature |

|---|---|---|

| ChatGPT Plus | 20 $/Monat | GPT-5.2 mit Nutzungslimits |

| ChatGPT Pro | 200 $/Monat | Unlimitiert GPT-5 + o1-Pro-Reasoning |

| Claude Pro | 20 $/Monat | 5× mehr Nutzung + Opus 4.6 Zugang |

| Claude Max | 200 $/Monat | 20× Nutzung, volles 1M-Fenster |

Der größte Kostenhebel liegt oft nicht beim Modell selbst, sondern bei der API-Strategie. Eine datenbasierte Einordnung findest du in der Analyse zu den besten KI-APIs nach Preis-Leistung, wo du erkennst, wann günstige Token-Preise wirklich skalieren – und wann Premium-Reasoning wirtschaftlich sinnvoller ist.

Wann lohnt sich das 200-Dollar-Abo?

Der Sprung von 20 auf 200 Dollar markiert die Grenze zwischen Gelegenheitsnutzer und KI-Power-User. ChatGPT Pro lohnt sich für Entwickler, die den Codex-Agenten stundenlang unter Volllast brauchen, und für Forscher, die o1-Pro-Reasoning benötigen. Claude Max ist essenziell, wenn du das 1-Millionen-Token-Fenster regelmäßig ausreizt oder agentische Coding-Features intensiv nutzt – beides ist extrem rechenintensiv und sprengt die Limits des Pro-Tiers schnell.

Gerade im Spannungsfeld zwischen 20-Dollar-Abo und 200-Dollar-Pro-Plan lohnt sich ein nüchterner Blick auf den tatsächlichen Mehrwert. Die Gegenüberstellung in Kostenlos vs. Premium bei KI-Tools – lohnt sich ein Bezahl-Abo 2026? zeigt dir, ab welchem Nutzungsgrad sich High-End-Tiers wie ChatGPT Pro oder Claude Max realistisch rechnen.

Funktionsvergleich

Kontextfenster: 400k vs. 1 Million Token

Claude Opus 4.6 bietet mit einer Million Token (Beta) mehr als die doppelte Kontextkapazität von GPT-5.2/5.3-Codex (400.000 Token). Praktisch bedeutet das: Du kannst ganze Bücher, umfangreiche Vertragswerke oder monolithische Codebases in einem einzigen Prompt verarbeiten – ohne externe Vektordatenbanken oder Chunking-Algorithmen.

Entscheidend ist dabei die Qualität der Kontextverarbeitung. Opus 4.6 erreicht in Benchmarks eine Retrieval-Rate von 76 % bei voller Auslastung des Kontextfensters (MRCR v2). GPT-5.2 kann hier nicht mithalten, da sein maximaler Kontext bei 400k endet.

Multimodalität: Video & Audio vs. Text & Vision

Hier divergieren die Pfade am stärksten. GPT-5.2 ist nativ multimodal: Text, Bilder, Audio und Video fließen in ein einziges neuronales Netz. Die Video-Analyse erreicht 90,5 % Genauigkeit im Video-MMMU Benchmark. Echtzeit-Audio-Interaktion (Speech-to-Speech) ist ein weiteres Alleinstellungsmerkmal.

Claude Opus 4.6 beschränkt sich bewusst auf Text und statische Bilder. Keine Video-Inputs, keine Audio-Generierung. Anthropic konzentriert seine Ressourcen voll auf Textanalyse und logisches Schließen. Für Dokumente, Diagramme und Screenshots ist die Vision-Fähigkeit exzellent – wer Videos verarbeiten muss, hat bei Anthropic keine Option.

Geschwindigkeit und Latenz

GPT-5.3-Codex wurde explizit auf Speed getrimmt – laut OpenAI rund 25 % schneller als Vorgängerversionen. Für Coding-Assistenz, wo schnelle Iterationszyklen zählen, ist das ein massiver Vorteil.

Claude Opus 4.6 nimmt sich mehr Zeit. Durch das Adaptive Thinking ist die Latenz bis zum ersten Token (Time to First Token) oft höher – das Modell „denkt nach“, bevor es antwortet. Es gibt einen Fast Mode, aber im Kern ist Opus für Aufgaben konzipiert, bei denen Qualität vor Geschwindigkeit geht.

Reasoning und Thinking-Modi

Beide Modelle bieten erweiterte Reasoning-Fähigkeiten, aber mit unterschiedlichem Ansatz. GPT-5.2 nutzt statische „Thinking“-Modi, die der Nutzer manuell aktiviert. Opus 4.6 entscheidet mit Adaptive Thinking selbstständig über die Verarbeitungstiefe – und zeigt in multidisziplinären Benchmarks wie Humanity’s Last Exam (53,1 % vs. 50,0 %) und GDPval-AA (+144 Elo) die robusteren Ergebnisse.

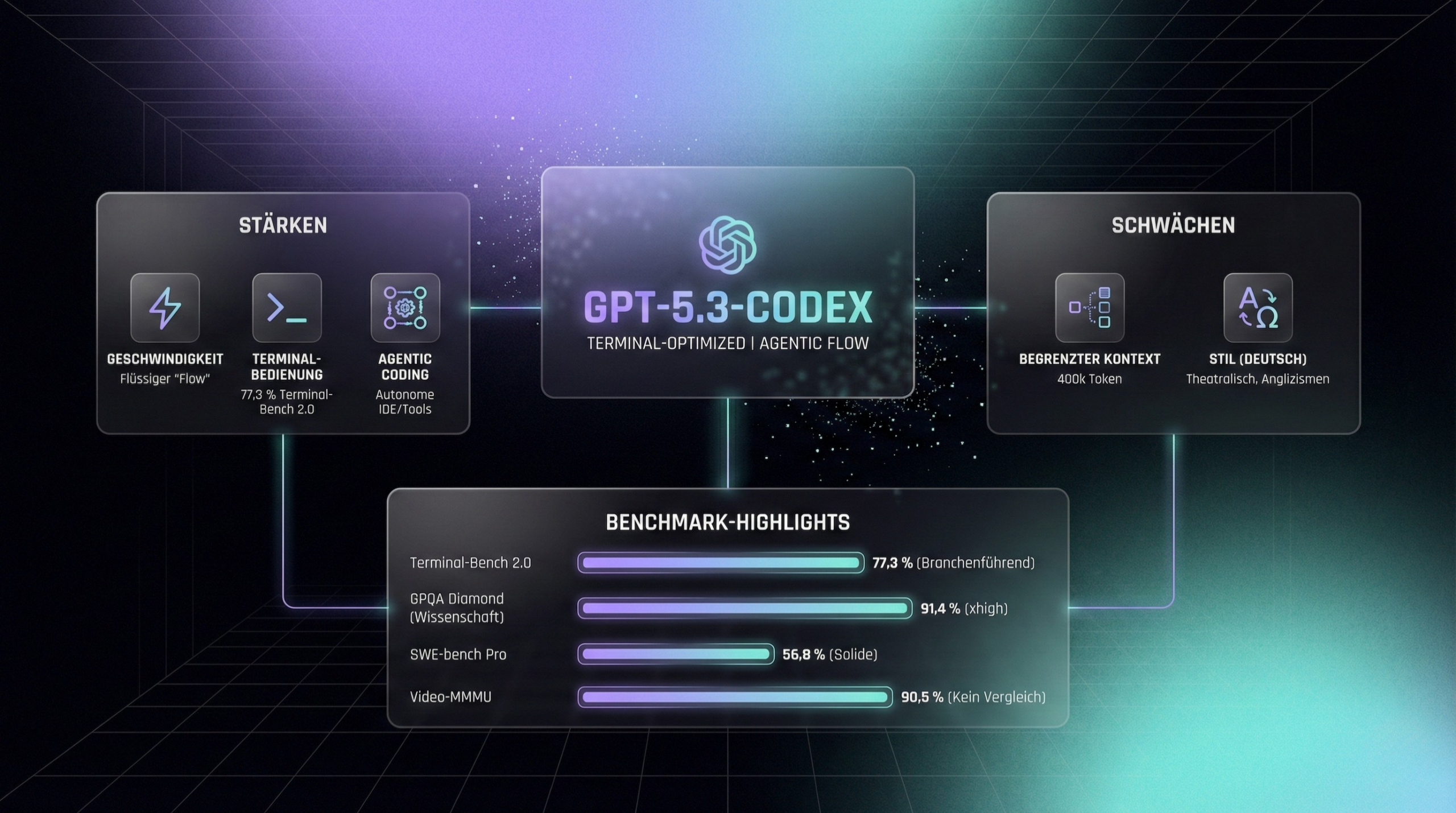

GPT-5.3-Codex im Detail

Stärken: Geschwindigkeit, Terminal-Bedienung, Agentic Coding

Die überragende Terminal-Bedienung (77,3 % in Terminal-Bench 2.0 vs. 65,4 % bei Opus) macht GPT-5.3-Codex zum effizientesten Partner für Scripting, DevOps und Greenfield Development. Die Inferenzgeschwindigkeit sorgt für einen flüssigen „Flow“ – Entwickler bekommen Antworten schneller, als sie tippen können.

OpenAI vermarktet das als „Agentic Coding“: Das Modell bedient IDEs, Terminals und Dateisysteme autonom und wurde sogar zur Fehlerbehebung seiner eigenen Trainingsprozesse eingesetzt.

Schwächen: Begrenzter Kontext, Stil im Deutschen

Das Kontextfenster bleibt mit 400k Token deutlich hinter Anthropic zurück. Bei großen Legacy-Codebases fehlt schlicht der Platz. Der Schreibstil in der Standardeinstellung tendiert zu Theatralik und einem übertrieben enthusiastischen Tonfall – im Deutschen fallen gelegentlich Anglizismen in der Phrasierung auf.

Benchmark-Highlights

| Benchmark | Score | Kontext |

|---|---|---|

| Terminal-Bench 2.0 | 77,3 % | Branchenführend |

| GPQA Diamond (Wissenschaft) | 91,4 % (xhigh) | Knapper Vorsprung |

| SWE-bench Pro | 56,8 % | Solide, aber hinter Opus (verified) |

| Video-MMMU | 90,5 % | Kein Vergleichswert bei Anthropic |

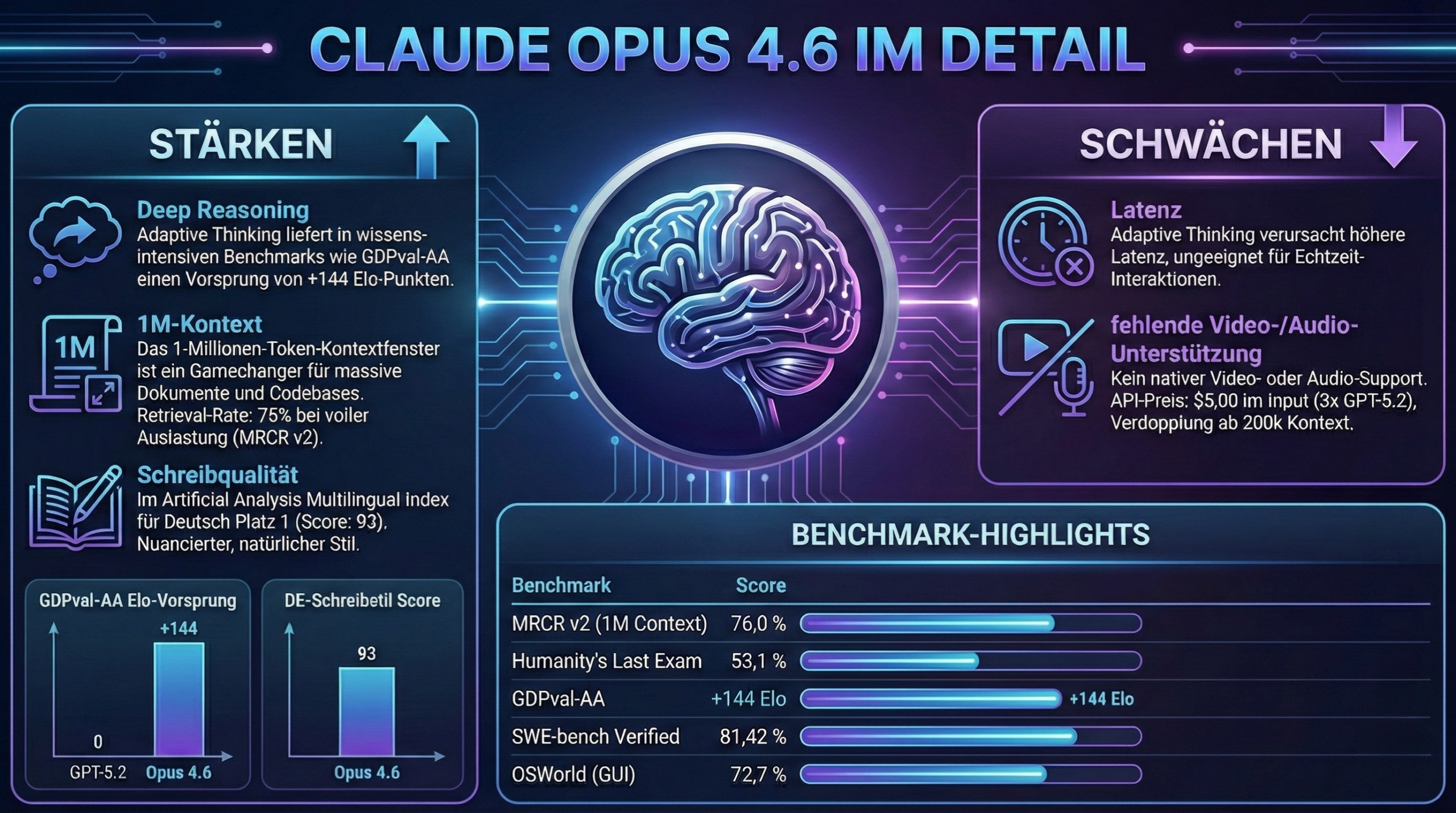

Claude Opus 4.6 im Detail

Stärken: Deep Reasoning, 1M-Kontext, Schreibqualität

Das 1-Millionen-Token-Kontextfenster ist ein Gamechanger für die Arbeit mit massiven Dokumenten und Codebases. Die Retrieval-Rate von 76 % bei voller Auslastung (MRCR v2) zeigt, dass dieses Fenster nicht nur groß, sondern auch funktional ist.

Adaptive Thinking liefert in wissensintensiven Benchmarks wie GDPval-AA einen Vorsprung von 144 Elo-Punkten gegenüber GPT-5.2. Im Artificial Analysis Multilingual Index für Deutsch erreicht Opus Platz 1 mit einem Score von 93 – der Schreibstil wirkt nuanciert, natürlich und erfordert weniger Nachbearbeitung.

Schwächen: Latenz, fehlende Video-/Audio-Unterstützung

Die höhere Latenz durch Adaptive Thinking macht Opus ungeeignet für Echtzeit-Interaktionen. Es gibt keinen nativen Video- oder Audio-Support. Der API-Preis liegt mit 5,00 $ im Input beim fast Dreifachen von GPT-5.2 – und verdoppelt sich ab 200k Kontext nochmals.

Benchmark-Highlights

| Benchmark | Score | Kontext |

|---|---|---|

| MRCR v2 (1M Context) | 76,0 % | Konkurrenzlos |

| Humanity’s Last Exam | 53,1 % | Vor GPT-5 Pro (50,0 %) |

| GDPval-AA | +144 Elo | Dominant in Finanzen/Recht |

| SWE-bench Verified | 81,42 % | Führend bei verifizierten Tasks |

| OSWorld (GUI) | 72,7 % | Bessere Computerbedienung |

Welches Modell wofür?

Softwareentwicklung: Greenfield vs. Legacy Code

Für Greenfield Development, Scripting und schnelles Debugging ist GPT-5.3-Codex die erste Wahl. Die Geschwindigkeit und die überlegene Terminal-Performance (77,3 % in Terminal-Bench) sorgen für einen flüssigen Entwickler-Flow.

Für Legacy Refactoring und Enterprise Systems – also das Verstehen und sichere Umbauen einer 500.000 Zeilen umfassenden, schlecht dokumentierten Codebase – ist Claude Opus 4.6 unverzichtbar. Das 1M-Token-Fenster hält den gesamten Kontext stabil, wo GPT-5.3 längst passen muss.

Für praxisnahe Einschätzungen zur Arbeit mit Cursor lohnt sich der Blick in alle Infos zu Cursor – der KI-Code-Editor im Detail, insbesondere wenn du wissen willst, wie sich autonome Refactorings und Terminal-Interaktionen im Alltag wirklich anfühlen.

Kreatives Schreiben & Content (DACH)

Empfehlung: Claude Opus 4.6. Der Schreibstil ist im Februar 2026 der Goldstandard für natürlich klingende, nuancierte Texte auf Deutsch (Multilingual Index Score 93, Platz 1). Es erfordert weniger Prompt-Engineering, um publikationsreife Ergebnisse zu erzielen. GPT-5.2 ist eine valide Alternative für reines Brainstorming und Ideengenerierung.

Analyse, Recht & Finanzen

Empfehlung: Claude Opus 4.6. Der GDPval-AA-Vorsprung von 144 Elo-Punkten spricht eine deutliche Sprache. Für die Analyse komplexer Finanzberichte, Verträge oder juristischer Dokumente minimiert Opus das Risiko, entscheidende Details in großen Datenmengen zu übersehen.

Große Kontextfenster lösen nicht automatisch jedes Präzisionsproblem. Die Hintergründe zu Fehleranfälligkeit und Unsicherheit findest du in der Analyse Halluzinationen in LLMs erklärt, was besonders relevant ist, wenn du juristische oder finanzielle Dokumente mit Claude Opus prüfst.

Multimedia & Echtzeit-Anwendungen

Empfehlung: GPT-5.2. Sobald Video-Analysen, Bildgenerierung oder Echtzeit-Sprachinteraktionen Teil des Workflows sind, ist OpenAI die einzige valide Option. Anthropic bietet hier keine vergleichbaren nativen Funktionen an.

Budget-bewusste API-Nutzung

Empfehlung: GPT-5.2. Mit 1,75 $ pro Million Input-Token bietet OpenAI das fast dreifach günstigere Preis-Leistungs-Verhältnis für allgemeine Aufgaben. Claude Opus 4.6 sollte als Premium-Werkzeug für spezifische High-Value-Tasks reserviert werden, bei denen Kontexttiefe oder Reasoning-Qualität den Aufpreis rechtfertigen.

Fazit

Der Februar 2026 hat die Ära der Allzweck-Modelle beendet. OpenAI liefert mit GPT-5.3-Codex den Motor für Geschwindigkeit und Multimodalität – ideal für Entwickler, die in Echtzeit iterieren, und für Teams, die Video- oder Audio-Workflows abbilden.

Anthropic stellt mit Claude Opus 4.6 das Gehirn für Tiefe und Kontext bereit. Wer juristische Akten analysiert, riesige Codebases durchdringt oder auf Deutsch textet, findet hier die höchste Qualität.

Die klügste Strategie ist oft der Dual-Ansatz: GPT-5.3 für schnelle Exekution, Opus 4.6 für tiefe Analyse. Der Erfolg einer KI-Implementierung hängt im Jahr 2026 weniger von der Wahl des „besten“ Modells ab – sondern davon, das richtige Werkzeug für die richtige Aufgabe einzusetzen.

FAQ

Welches Modell ist insgesamt besser – GPT-5.3-Codex oder Claude Opus 4.6?

Keines ist pauschal besser. GPT-5.3-Codex dominiert bei Geschwindigkeit, Terminal-Bedienung und Multimedia. Claude Opus 4.6 führt bei Deep Reasoning, Kontextverarbeitung und deutschsprachigem Schreiben. Die Wahl hängt von deinem konkreten Anwendungsfall ab.

Lohnt sich das 200-Dollar-Abo bei ChatGPT Pro oder Claude Max?

Nur, wenn du KI intensiv beruflich nutzt. ChatGPT Pro lohnt sich für Entwickler, die den Codex-Agenten stundenlang unter Volllast brauchen. Claude Max ist essenziell, wenn du das 1-Millionen-Token-Fenster oder agentische Coding-Features regelmäßig einsetzt. Für Gelegenheitsnutzer reicht jeweils das 20-Dollar-Abo.

Kann Claude Opus 4.6 Videos analysieren?

Nein. Claude Opus 4.6 unterstützt Text und statische Bilder (Vision). Für Video- und Audio-Analyse ist GPT-5.2 aktuell die einzige Option unter den beiden Anbietern.

Welches Modell ist günstiger über die API?

GPT-5.2 mit 1,75 $ pro Million Input-Token ist deutlich günstiger als Claude Opus 4.6 mit 5,00 $. Für Long-Context-Aufgaben über 200k Token verdoppelt sich der Claude-Preis sogar auf 10,00 $. Für budgetbewusste Standardaufgaben ist OpenAI klar im Vorteil.

Welches Modell schreibt besseres Deutsch?

Claude Opus 4.6 belegt Platz 1 im Artificial Analysis Multilingual Index für Deutsch (Score 93). Der Schreibstil wirkt nuancierter und natürlicher. GPT-5.2 liefert grammatikalisch einwandfreie Ergebnisse, neigt aber gelegentlich zu Anglizismen und einem übertrieben enthusiastischen Tonfall.

Was bedeutet „Adaptive Thinking“ bei Claude Opus 4.6?

Adaptive Thinking bedeutet, dass das Modell während der Verarbeitung selbst entscheidet, wie viel Rechenzeit eine Teilaufgabe braucht. Bei einfachen Fragen antwortet es schnell, bei komplexen Problemen schaltet es automatisch tiefere Verarbeitungsschleifen hinzu. Das führt zu präziseren Ergebnissen – allerdings auf Kosten der Latenz.

Für welches Modell sollte ich mich als Softwareentwickler entscheiden?

Für Greenfield Development, Scripting und schnelles Debugging: GPT-5.3-Codex. Für die Arbeit mit großen Legacy-Codebases, Refactoring und Architektur-Entscheidungen: Claude Opus 4.6. Idealerweise nutzt du beide Modelle je nach Aufgabe.