Fazit vorweg: Lohnt sich FLUX?

Ja – aber es kommt darauf an, was du brauchst. FLUX.2 von Black Forest Labs ist der aktuell stärkste Open-Source-Bildgenerator und spielt in vielen Bereichen auf dem Niveau von Midjourney oder Google Gemini. Die Prompt-Treue ist herausragend, die native 4-Megapixel-Auflösung beeindruckend und die Multi-Referenz-Funktion ein echter Gamechanger für professionelle Workflows.

Der Haken: Das volle 32-Milliarden-Parameter-Modell braucht teure Hardware. Wer keine RTX 4090 oder Cloud-Zugang hat, stößt schnell an Grenzen. Dafür gibt es mit FLUX.2 [klein] ein kompaktes Modell unter Apache-2.0-Lizenz, das sogar auf Mittelklasse-Grafikkarten läuft – komplett kostenlos und kommerziell nutzbar.

Unterm Strich: Für maximale Kontrolle und Qualität führt 2026 kein Weg an FLUX vorbei. Für schnelle, ästhetisch perfekte Ergebnisse ohne Technik-Aufwand bleibt Midjourney die bequemere Wahl.

FLUX im Steckbrief

| Eigenschaft | Details |

|---|---|

| Entwickler | Black Forest Labs (BFL) – Gründer der ursprünglichen Stable-Diffusion-Architektur |

| Release | FLUX.2 [dev]: November 2025 / FLUX.2 [klein]: 15. Januar 2026 |

| Architektur | Rectified Flow Transformer + Mistral-3-basiertes Vision-Language-Model (VLM) |

| Modellvarianten | [klein] 4B, [klein] 9B, [dev] 32B, [pro], [max], [flex] |

| Max. Auflösung | 4 Megapixel nativ (ca. 2048×2048) |

| Lizenz | Apache 2.0 ([klein] 4B), Non-Commercial ([dev]), Proprietär ([pro]/[max]/[flex]) |

| Zugang | Lokal (Open Weights), API, ComfyUI |

| Besonderheit | Native Multi-Referenz-Verarbeitung (bis zu 10 Referenzbilder) |

Preise und Versionen

FLUX.2 ist kein einzelnes Modell, sondern eine ganze Modellfamilie. Je nach Anwendungsfall und Budget stehen dir unterschiedliche Varianten zur Verfügung.

FLUX.2 [klein] – kostenlos und Open Source

Das [klein]-Modell gibt es in zwei Größen:

- [klein] 4B (4 Milliarden Parameter): Läuft auf Consumer-Grafikkarten ab 8 GB VRAM (z. B. RTX 4070, RTX 3060 12 GB). Inferenz in unter einer Sekunde. Lizenziert unter Apache 2.0 – du darfst es kommerziell nutzen, modifizieren und in eigene Software einbauen, ohne den Quellcode offenzulegen.

- [klein] 9B (9 Milliarden Parameter): Braucht ca. 12–16 GB VRAM (RTX 3090/4090). Bietet eine bessere Qualität als das 4B-Modell, ist aber langsamer. Lizenziert unter der FLUX Non-Commercial License.

FLUX.2 [dev] – das Forschungsmodell

Mit 32 Milliarden Parametern ist [dev] eines der größten offen verfügbaren Bildmodelle. Es bietet die komplette Architektur inklusive Multi-Referenz-Support und ist die Basis für LoRA-Trainings in der Community.

Die Einschränkung: Im nativen BF16-Format braucht es über 60 GB VRAM. Quantisierte Versionen (4-bit) laufen auf einer 24-GB-Karte, aber deutlich langsamer (3–5 Minuten pro Bild). Die Lizenz erlaubt Forschung und private Nutzung. Die generierten Bilder darfst du kommerziell verwenden – solange du sie nicht zum Training von Konkurrenzmodellen einsetzt.

Der strategische Kern von FLUX liegt in seiner Lizenzpolitik. Wenn dich interessiert, welche Vor- und Nachteile Open Weights gegenüber API-only-Modellen haben, liefert dir Open Source vs. Closed Source KI die nötige Einordnung.

FLUX.2 [pro], [max] und [flex] – die API-Modelle

Diese Modelle sind Closed Source und nur über die API erreichbar. Sie bieten die höchste Qualität und sind für den professionellen Einsatz gedacht:

- [pro]: Der Enterprise-Standard für Produktionsworkflows.

- [max]: Das Flaggschiff mit der besten Kohärenz, physikalischen Plausibilität und Prompt-Treue.

- [flex]: Spezialisiert auf Design und Typografie. Bietet granulare Kontrolle über Schritte und Detaildichte.

Was kostet FLUX über die API?

BFL setzt auf eine auflösungsabhängige Abrechnung (Megapixel-Pricing) statt Pauschalpreise pro Bild:

| Modell | Kosten ca. (1 MP Bild) | Kosten ca. (4 MP Bild) |

|---|---|---|

| [klein] 4B | $0,014 | $0,017 |

| [pro] | $0,03 | $0,075 |

| [max] | $0,07 | $0,16 |

| [flex] | $0,05 | $0,20 |

Das [klein]-Modell ist extrem günstig und zielt auf Massenanwendungen wie dynamische Website-Hintergründe oder Avatar-Generatoren. Das [max]-Modell ist als Premium-Produkt positioniert – $0,16 pro 4-MP-Bild ist für Unternehmen günstig, für Hobbyisten aber teuer.

Die wichtigsten Funktionen im Test

Bildqualität und Realismus

FLUX.2 verfolgt einen Ansatz des strikten Realismus. Wenn dein Prompt „ein hässlicher, grauer Raum“ verlangt, liefert FLUX genau das – ohne es filmisch aufzuhübschen. Das ist ein bewusster Unterschied zu Midjourney, das Bilder fast immer ästhetisch „verschönert“.

Besonders bei Hauttexturen, Stoffen und komplexen Materialien zeigt sich die Stärke der Flow-Matching-Architektur. Die Ergebnisse wirken natürlicher und weniger „KI-typisch“ als bei vielen Konkurrenten.

Prompt-Treue: Versteht FLUX, was du willst?

Hier liegt die größte Stärke von FLUX.2. Dank des integrierten Vision-Language-Models (basierend auf Mistral-3) „liest“ das Modell deinen Prompt nicht nur, sondern versteht ihn semantisch. Komplexe Anweisungen wie „ein roter Würfel auf einem blauen Buch, das neben einer gelben Vase steht“ werden korrekt umgesetzt – inklusive räumlicher Relationen und Attributzuordnung.

Das ist ein spürbarer Fortschritt gegenüber älteren CLIP-basierten Modellen, die bei solchen Aufgaben regelmäßig Attribute vertauschten.

Wenn du die Prompt-Treue von FLUX wirklich ausreizen willst, brauchst du saubere Prompt-Strukturen. Die Prompt-Grundlagen für Anfänger zeigen dir systematisch, wie du Attribute, Relationen und Stilvorgaben präzise formulierst – besonders relevant, wenn du komplexe Szenen mit mehreren Referenzbildern steuerst.

Textdarstellung in Bildern

FLUX.2 gehört zu den besten Modellen für Textrendering. Besonders [flex] bietet über Referenzbilder Kontrolle über Schriftarten und Layout. Für Designs, bei denen Text perfekt ins Bild integriert werden muss, ist das ein klarer Vorteil.

Native 4-Megapixel-Auflösung

Der neue VAE (Variational Autoencoder) ermöglicht eine native Ausgabe von bis zu 4 Megapixeln – also etwa 2048×2048 Pixel oder äquivalente Seitenverhältnisse. Feine Details wie kleine Schrift oder Gesichtszüge im Hintergrund bleiben erhalten, ohne dass du ein separates Upscaling brauchst.

Das ist ein großer Vorteil für Print-Anwendungen und überall dort, wo halluzinierte Details durch Upscaling ein Problem wären.

Multi-Referenz-Verarbeitung (Kontext-Feature)

Das ist die Funktion, die FLUX.2 wirklich von der Konkurrenz abhebt. Du kannst bis zu 10 Referenzbilder gleichzeitig einspeisen – etwa ein Produktfoto, ein Stil-Referenzbild und ein Layout-Grid. Das VLM analysiert alle Referenzen und fusioniert die Informationen im Generierungsprozess.

Das Ergebnis: Konsistente Charaktere und Produkte, ohne dass du ein separates LoRA trainieren musst. BFL nennt das „In-Context Learning für Bilder“ – und für Agenturen oder E-Commerce ist es ein massiver Effizienzgewinn.

Technik: Was steckt unter der Haube?

Flow Matching statt klassische Diffusion

Trotz des Begriffs „Diffusion“, der umgangssprachlich für alle Bildgeneratoren verwendet wird, setzt FLUX.2 auf „Rectified Flow Matching“. Statt einen stochastischen Prozess zu simulieren, konstruiert Flow Matching eine direktere Trajektorie zwischen Rauschen und fertigem Bild.

Das bringt zwei Vorteile: Weniger Sampling-Schritte für ein gutes Ergebnis (= schneller) und konsistentere Texturen mit weniger Artefakten.

Sobald du tiefer in die technische Einordnung von FLUX einsteigen willst, hilft dir der Blick auf Diffusion Models: Die Technik hinter Midjourney und DALL·E.

Das VLM für besseres Textverständnis

Ältere Modelle nutzten CLIP-Encoder für das Textverständnis. FLUX.2 ergänzt das durch ein vollständiges Vision-Language-Model auf Mistral-3-Basis. Dieses Modell fungiert als semantischer Interpreter: Es „liest“ deinen Prompt, extrahiert logische Zusammenhänge und speist diese Informationen in den Generierungsprozess ein.

Technisch wird das durch eine Skalierung auf bis zu 32 Milliarden Parameter unterstützt – FLUX.2 [dev] bewegt sich damit in der Größenordnung von Large Language Models.

Der neue VAE und Latenzraum

Der Variational Autoencoder komprimiert Bilder in einen Latenzraum und dekomprimiert sie nach der Generierung zurück. BFL hat diesen Latenzraum komplett neu trainiert. Frühere Modelle verloren bei der Kompression oft feine Details – typisch waren „verwaschene“ Gesichter im Hintergrund oder unlesbarer Text. Der neue VAE behebt das und ermöglicht die native 4-MP-Ausgabe.

FLUX lokal nutzen: Hardware und Setup

Welche Grafikkarte brauche ich?

| Modell | Min. VRAM | Empfohlene GPU | Geschwindigkeit |

|---|---|---|---|

| [klein] 4B | 8 GB | RTX 4070 / RTX 3060 12 GB | unter 1 Sekunde |

| [klein] 9B | 12 GB | RTX 3090 / RTX 4090 | wenige Sekunden |

| [dev] 32B (Q4) | 24 GB | RTX 4090 | 3–5 Minuten |

| [dev] 32B (nativ) | 60+ GB | A100 / H100 | je nach Setup |

ComfyUI als Workflow-Umgebung

ComfyUI hat sich als Standard-Plattform für FLUX.2 etabliert. Die knotenbasierte Oberfläche ermöglicht es, quantisierte Modelle zu laden, Text-Encoder in den RAM auszulagern und Multi-Referenz-Workflows aufzubauen. Über Custom Nodes wie ComfyUI-GGUF lassen sich die 32B-Modelle auch auf Consumer-Hardware betreiben.

LoRA-Training mit FLUX

Das Finetuning von FLUX.2 [dev] ist anspruchsvoll. Ein Full-Finetuning ist bei 32 Milliarden Parametern praktisch unmöglich. Selbst LoRA-Training erfordert auf einer RTX 4090 massive Optimierungen wie QLoRA, Gradient Checkpointing und Offloading.

Wichtig zu wissen: Experten empfehlen höhere Ranks (16–32) als bei SDXL und sehr saubere, kleine Datensätze. Das Modell neigt schnell zum Overfitting. Tools wie das Ostris AI Toolkit abstrahieren die technischen Details. Alternativ bieten Plattformen wie Civitai und Fal.ai Cloud-basiertes One-Click-Training an – für die meisten Nutzer ist das kosteneffizienter als eigene Hardware.

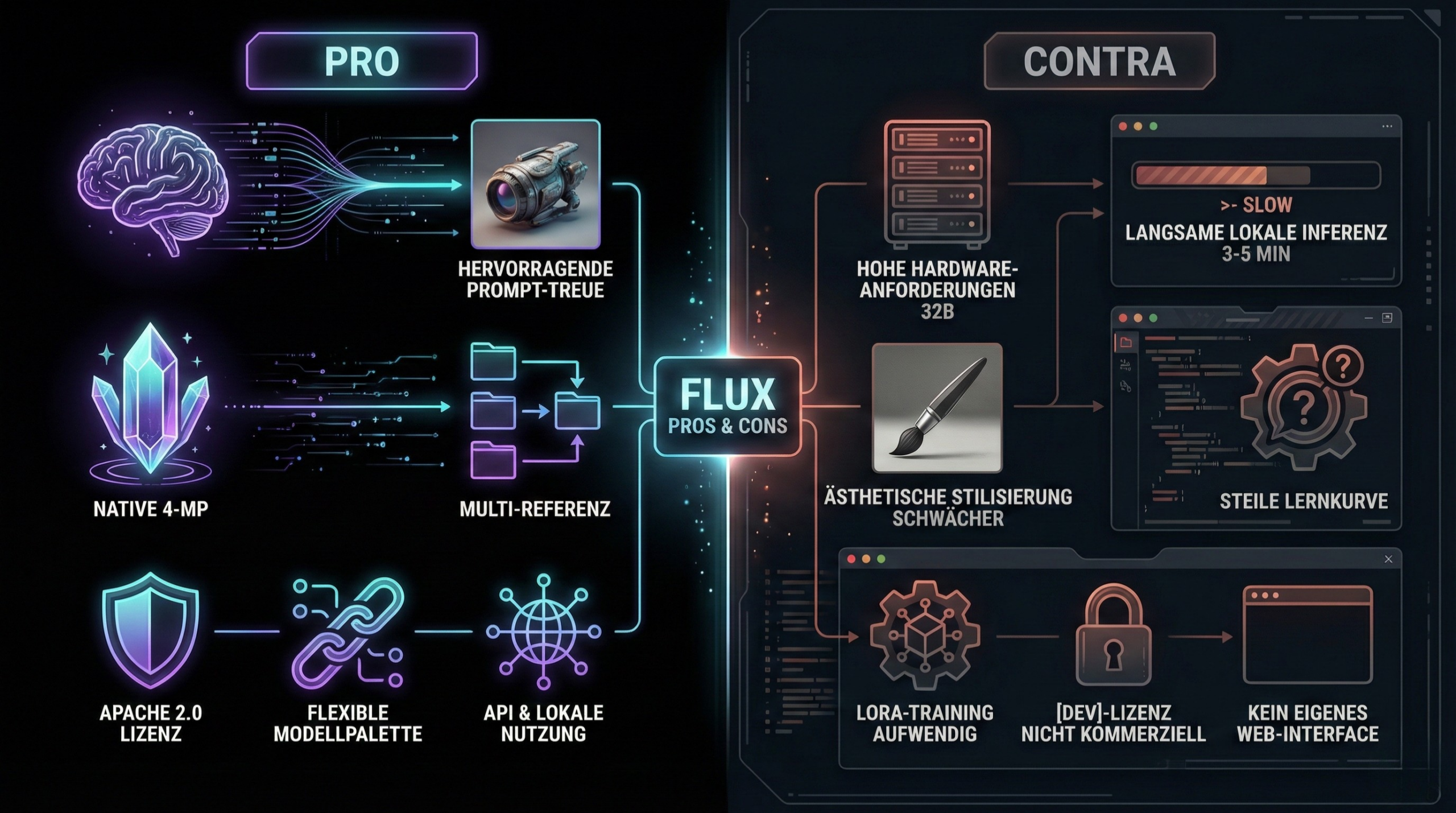

Pro: Das spricht für FLUX

- Herausragende Prompt-Treue – dank VLM-Integration versteht FLUX komplexe Anweisungen besser als fast jeder Konkurrent.

- Native 4-MP-Auflösung – kein separates Upscaling nötig, weniger halluzinierte Details.

- Multi-Referenz-Verarbeitung – bis zu 10 Referenzbilder nativ, ohne LoRA-Training.

- Apache-2.0-Lizenz für [klein] 4B – uneingeschränkt kommerziell nutzbar.

- Flexible Modellpalette – vom Edge-Device bis zum High-End-Server gibt es das passende Modell.

- API und lokal nutzbar – Integration in eigene Pipelines und ComfyUI möglich.

- Strikter Realismus – das Modell gibt dir, was du verlangst, ohne eigenmächtig zu verschönern.

Contra: Das spricht gegen FLUX

- Hohe Hardware-Anforderungen für das 32B-Modell – 24 GB VRAM Minimum, nativ über 60 GB.

- Langsame lokale Inferenz bei quantisierten Modellen – 3–5 Minuten pro Bild auf einer RTX 4090.

- Ästhetische Stilisierung schwächer als bei Midjourney – wer „schöne“ Bilder ohne viel Prompting will, ist bei MJ besser aufgehoben.

- Steile Lernkurve – ComfyUI, Quantisierung und LoRA-Training setzen technisches Wissen voraus.

- LoRA-Training aufwendig – Overfitting-Gefahr, hohe Ranks nötig, teure Hardware oder Cloud-Kosten.

- [dev]-Lizenz nicht kommerziell – nur die Outputs sind kommerziell nutzbar, nicht das Modell selbst.

- Kein eigenes Web-Interface – anders als Midjourney gibt es keine einsteigerfreundliche Oberfläche von BFL.

Für wen eignet sich FLUX?

Hobby-Anwender

Für dich ist FLUX.2 [klein] 4B die richtige Wahl. Es läuft auf einer RTX 3060 mit 12 GB VRAM, ist kostenlos und liefert für einfache Anwendungen gute Ergebnisse. Die Einstiegshürde ist allerdings höher als bei Midjourney – du musst ComfyUI oder ein ähnliches Tool einrichten.

Professionelle Anwender und Agenturen

Hier spielt FLUX.2 seine Stärken aus. Die native 4-MP-Auflösung, die Multi-Referenz-Funktion und die API-Anbindung machen es zum idealen Werkzeug für Produktfotografie, E-Commerce und konsistente Kampagnen-Visuals. Die [pro]- und [max]-Modelle über die API liefern Enterprise-Qualität zu kalkulierbaren Kosten.

Entwickler und Unternehmen

Die Apache-2.0-Lizenz von [klein] 4B erlaubt es, das Modell in eigene Software einzubauen – als Plugin, als Backend-Service oder als Teil einer App. Das ermöglicht State-of-the-Art-Bildgenerierung unter eigener Datenhoheit, ohne Abhängigkeit von Drittanbieter-APIs. Für Unternehmen mit Datenschutz-Anforderungen ist das ein entscheidender Vorteil.

FLUX vs. Midjourney vs. Gemini: Die Alternativen

Midjourney v7

Midjourney bleibt der Goldstandard für ästhetische Kohärenz. Die Bilder sehen fast immer „schön“ aus – auch ohne aufwendiges Prompting. In der Charakterkonsistenz schneidet FLUX.2 [pro] und [max] in Blindtests allerdings besser ab. Größtes Manko von Midjourney: Es bleibt in seinem Discord/Web-Ökosystem gefangen und lässt sich nicht in eigene Pipelines integrieren.

Midjourney bleibt im Artikel der wichtigste Vergleichsmaßstab. Damit du einschätzen kannst, ob dir Ästhetik oder Kontrolle wichtiger ist, findest du im Midjourney v7 Test eine detaillierte Analyse zu Qualität, Workflow und Einschränkungen.

Google Gemini 3 Pro Image

Google hat mit Gemini 3 Pro Image stark aufgeholt. Als natives multimodales Modell kann es logische Schlussfolgerungen ziehen, bevor es ein Bild generiert – für Infografiken oder datenbasierte Visualisierungen ist es FLUX überlegen. Im Textrendering sind beide Modelle stark, wobei FLUX [flex] mehr Kontrolle über Layout und Schriftarten bietet.

Google Gemini wird als Alternative genannt, vor allem bei logischem Reasoning. Im Gemini Advanced Test – Googles Premium-KI siehst du konkret, wo Googles Modell bei datenbasierten Visualisierungen und Multimodalität punktet – und wo es gegenüber FLUX in der kreativen Kontrolle zurückliegt.

Samsung EdgeFusion (Stable Diffusion)

Für mobile Bildgenerierung ist Samsung EdgeFusion auf dem Galaxy S26 ein interessanter Konkurrent zu FLUX.2 [klein]. EdgeFusion ist tief in die Hardware integriert (NPU-Optimierung) und dadurch energieeffizienter auf Mobilgeräten. Die Bildqualität dürfte aufgrund der älteren Diffusions-Architektur jedoch unter der von FLUX [klein] liegen.

| Kriterium | FLUX.2 [max] | Midjourney v7 | Gemini 3 Pro Image |

|---|---|---|---|

| Prompt-Treue | ★★★★★ | ★★★★☆ | ★★★★☆ |

| Ästhetik | ★★★★☆ | ★★★★★ | ★★★☆☆ |

| Charakterkonsistenz | ★★★★★ | ★★★★☆ | ★★★☆☆ |

| Textrendering | ★★★★★ | ★★★☆☆ | ★★★★☆ |

| Logisches Reasoning | ★★★☆☆ | ★★☆☆☆ | ★★★★★ |

| Lokale Nutzung | ✅ (Open Weights) | ❌ | ❌ |

| API-Integration | ✅ | Eingeschränkt | ✅ |

Fazit: Für wen lohnt sich FLUX wirklich?

FLUX.2 ist das technisch fortschrittlichste Bildgenerierungsmodell Anfang 2026. Die Kombination aus Flow-Matching-Architektur, VLM-Integration und nativer Multi-Referenz-Verarbeitung setzt neue Standards – vor allem für professionelle Anwender, die Kontrolle, Konsistenz und Integrierbarkeit brauchen.

Für Hobby-Nutzer, die einfach „schöne Bilder“ wollen, ist Midjourney weiterhin der bequemere Weg. Wer aber bereit ist, sich mit ComfyUI und der Technik auseinanderzusetzen, bekommt mit FLUX.2 ein Werkzeug, das in Prompt-Treue und Steuerbarkeit seinesgleichen sucht.

Der strategische Clou von BFL: Die Apache-2.0-Lizenz für [klein] 4B könnte FLUX.2 zum Standard-Motor in kreativer Software machen – ähnlich wie Stable Diffusion 1.5 es 2023 war. Gleichzeitig sichert das API-Geschäft mit [pro] und [max] die Finanzierung. Es ist ein durchdachtes Modell, das sowohl die Open-Source-Community als auch Enterprise-Kunden bedient.

FAQ

Ist FLUX kostenlos?

Teilweise. FLUX.2 [klein] 4B ist unter der Apache-2.0-Lizenz komplett kostenlos und kommerziell nutzbar. FLUX.2 [dev] ist kostenlos für Forschung und private Nutzung. Die [pro]-, [max]- und [flex]-Modelle sind kostenpflichtig über die API.

Kann ich FLUX-Bilder kommerziell nutzen?

Ja. Bei [klein] 4B ohne Einschränkungen. Bei [dev] darfst du die generierten Bilder kommerziell nutzen – solange du sie nicht zum Training von Konkurrenzmodellen einsetzt. Bei den API-Modellen gelten die jeweiligen Nutzungsbedingungen von BFL.

Welche Grafikkarte brauche ich für FLUX?

Für [klein] 4B reicht eine Grafikkarte mit 8 GB VRAM (z. B. RTX 3060 12 GB oder RTX 4070). Für [dev] 32B brauchst du mindestens 24 GB VRAM (RTX 4090) mit einer quantisierten Version – oder nutzt die Cloud.

Was ist der Unterschied zwischen FLUX [dev] und [pro]?

[dev] ist ein Open-Weights-Modell mit 32 Milliarden Parametern, das du lokal betreiben kannst. Die Lizenz erlaubt keine kommerzielle Nutzung des Modells selbst. [pro] ist ein Closed-Source-Modell, das nur über die API erreichbar ist und für professionelle Produktionsworkflows gedacht ist. Es bietet eine höhere Qualität und ist sofort einsatzbereit – ohne Hardware-Setup.

Wie schneidet FLUX im Vergleich zu Midjourney ab?

FLUX.2 ist stärker in Prompt-Treue, Charakterkonsistenz und Steuerbarkeit. Midjourney v7 liefert ästhetisch gefälligere Bilder „out of the box“ und ist einfacher zu bedienen. Für professionelle Workflows mit eigener Pipeline ist FLUX die bessere Wahl. Für schnelle, schöne Ergebnisse ohne Technik-Aufwand hat Midjourney die Nase vorn.