Generative KI hat die Erstellung von Deepfakes so einfach und billig gemacht, dass das Volumen gefälschter Inhalte laut Schätzungen der Cybersicherheitsfirma DeepStrike von rund 500.000 (2023) auf etwa 8 Millionen (2025) explodiert ist – ein Anstieg von fast 900 %. Die Folgen reichen von annullierten Wahlen in Rumänien über massenhaften Stimmbetrug am Telefon bis hin zu einer gesellschaftlichen Vertrauenskrise, die der Edelman Trust Barometer 2026 als „Insularität“ beschreibt.

Gleichzeitig entstehen Gegenmaßnahmen: Der EU AI Act schreibt ab August 2026 die Kennzeichnung von KI-Inhalten vor, der offene Standard C2PA liefert kryptografische Herkunftsnachweise, und Plattformen wie YouTube demonetarisieren massenhaft produzierten KI-Content. Doch der Kampf gegen Desinformation bleibt ein Dauerzustand – kein Problem, das sich einmal lösen lässt.

Was bedeutet KI-gestützte Desinformation?

KI-gestützte Desinformation beschreibt den gezielten Einsatz generativer Künstlicher Intelligenz, um falsche oder irreführende Inhalte zu erzeugen und zu verbreiten. Das reicht von gefälschten Videos und geklonten Stimmen über automatisierte Propaganda-Texte bis hin zu kompletten Fake-Nachrichtenportalen.

Der entscheidende Unterschied zu früherer Desinformation: Die Technologie ist nicht mehr Geheimdiensten oder spezialisierten Firmen vorbehalten. Hochleistungsfähige Tools zur Stimmen- und Videomanipulation stehen heute jedem offen – oft kostenlos oder als Open-Source-Software. Damit hat sich die Bedrohung von isolierten Fake-News-Kampagnen hin zu einer systemischen Untergrabung demokratischer und ökonomischer Prozesse verschoben.

Die Detection Horizon – warum du Fakes nicht mehr erkennst

Experten sprechen von der sogenannten „Detection Horizon“ – der Schwelle, ab der Menschen echte und gefälschte Inhalte statistisch nicht mehr unterscheiden können. Im Jahr 2026 ist diese Schwelle in mehreren Bereichen überschritten: bei Video, bei Audio und zunehmend auch bei Text.

Das bedeutet konkret: Dein Bauchgefühl reicht nicht mehr aus. Ohne technische Hilfsmittel oder forensische Analyse kannst du einem Video oder einer Sprachnachricht nicht mehr ansehen oder anhören, ob sie echt ist.

Viele unterschätzen, dass moderne Fakes nicht nur Text, sondern Bild, Video und Audio kombinieren. Im Überblick zu multimodalen KI-Modellen, die sehen, hören und sprechen erfährst du, wie Systeme mehrere Datentypen gleichzeitig verarbeiten – die technische Basis für realistische Deepfake-Videos mit synchroner Stimme.

Video-Deepfakes: Von sichtbaren Fehlern zur Perfektion

Noch 2023 verrieten sich KI-generierte Videos durch flackernde Hintergründe, seltsam verzerrte Hände oder asynchrone Lippenbewegungen. Diese Zeit ist vorbei.

Neue Modellarchitekturen trennen die Identität einer Person von ihren Bewegungen. Komplexe Bewegungsabläufe lassen sich auf eine Zielperson übertragen, ohne die typischen Verzerrungen an Gesichtsrändern oder Kieferlinie. Besonders auf kleinen Smartphone-Bildschirmen sind diese Videos von echten Aufnahmen nicht mehr zu unterscheiden.

Die Entwicklung lässt sich grob in drei Phasen einteilen:

- Bis 2023: Face-Swapping mit sichtbaren Rändern und niedriger Auflösung.

- 2024: Hochauflösende Gesichter, aber Probleme bei Profilansichten und Verdeckungen.

- 2026: Vollständig synthetische Performer, die in Echtzeit reagieren – mit konsistenter Beleuchtung und Physik.

Besonders brisant: Echtzeit-Deepfakes für Videoanrufe. Betrüger nutzen sie, um Identitätsprüfungen bei Banken zu umgehen oder sich in Videokonferenzen als Führungskräfte auszugeben.

Gerade bei Video-Deepfakes hilft es, die visuelle Komponente zu verstehen. Der Artikel über Computer Vision – wie KI sehen lernt zeigt dir, wie neuronale Netze Gesichter, Bewegungen und Licht analysieren.

Voice Cloning: 3 Sekunden reichen für eine Stimm-Kopie

Audio-Deepfakes haben sich am schnellsten demokratisiert und stellen 2026 womöglich die akuteste Bedrohung dar. Der Grund: Die benötigte Menge an Referenzmaterial ist drastisch geschrumpft.

| Merkmal | 2023 | 2026 |

|---|---|---|

| Referenzmaterial | 1–10 Minuten | 3–30 Sekunden |

| Latenz | Hohe Verzögerung | Echtzeit |

| Sprachen | Begrenzt, oft roboterhaft | 70+ Sprachen, fließend |

| Emotionalität | Monoton | Hohe emotionale Bandbreite |

| Kosten | Abo-Modelle | Oft kostenlos oder Cent-Beträge |

Eine Instagram-Story reicht also, um deine Stimme zu klonen. Die geklonte Version spricht inklusive Atempausen, Zögern und emotionaler Färbung. Laut einem Bericht der Universität Buffalo hat das Voice Cloning eine Schwelle überschritten, an der selbst enge Familienangehörige und Sicherheitssysteme von Banken getäuscht werden können. Das Ergebnis: ein Anstieg von Sprachbetrug um 442 % im Jahr 2025.

Viele Voice-Cloning-Fälle basieren auf spezialisierten Anbietern. Im ausführlichen ElevenLabs-Test – KI-Stimmen im Praxiseinsatz siehst du konkret, wie einfach sich Stimmen synthetisieren lassen und welche Qualität heute möglich ist.

Textgenerierung durch LLMs: Propaganda auf Knopfdruck

Large Language Models (LLMs) sind 2026 das Betriebssystem der Desinformation. Sie erzeugen Propaganda-Texte in perfekter Grammatik und lokalem Tonfall – etwas, das früher menschliche Muttersprachler erforderte.

Eine Untersuchung von NewsGuard im August 2025 zeigte: Führende KI-Chatbots wiederholten Falschinformationen zu Nachrichtenthemen in 35 % der Fälle – eine Verdopplung gegenüber dem Vorjahr. Der Grund: Die Modelle greifen über Echtzeit-Websuchen auf ein Internet zu, das zunehmend mit minderwertigem KI-Content und gezielt platzierter Desinformation verschmutzt ist. So werden sie ungewollt zu Verstärkern falscher Narrative.

Sobald du tiefer verstehen willst, warum Large Language Models heute in Sekunden glaubwürdige Propaganda erzeugen können, lohnt sich ein Blick auf die technischen Grundlagen. Der Beitrag zu wie Large Language Models funktionieren erklärt dir verständlich, wie Trainingsdaten, Wahrscheinlichkeiten und Mustererkennung zusammenspielen – und warum genau diese Mechanik Desinformation skalierbar macht.

Reale Fälle: Wo KI-Desinformation bereits Schaden angerichtet hat

Die Jahre 2024 und 2025 – das größte Wahl-Superjahr der Geschichte – dienten als globales Testfeld für KI-Desinformation. Die Ergebnisse sind ernüchternd.

Rumänien 2024 – die erste annullierte Wahl durch KI-Manipulation

Im Dezember 2024 passierte in der EU etwas Beispielloses: Das rumänische Verfassungsgericht annullierte die erste Runde der Präsidentschaftswahlen.

Der rechtsextreme Kandidat Călin Georgescu hatte überraschend gewonnen. Ermittlungen deckten eine massive, koordinierte Kampagne auf TikTok und Facebook auf. Über 25.000 Bot-Accounts und KI-gesteuerte Netzwerke generierten Millionen von Interaktionen, um Georgescu künstlich zu pushen. Es gab starke Indizien für russische Einflussnahme.

Das Gericht entschied: Die Integrität der Wahl war so stark beschädigt, dass das Ergebnis keinen Bestand haben konnte. Was folgte, waren massive Proteste und eine politische Krise, die bis ins Jahr 2025 andauerte.

Die Lehre: KI-gestützte Desinformation kann die Stabilität einer Demokratie brechen – noch bevor ein einziger Stimmzettel gefälscht wurde.

Indien 2024 – Deepfakes als Wahlkampf-Normalität

In Indien mit seinen über 800 Millionen Internetnutzern wurde KI im Wahlkampf zur Normalität. Parteien nutzten die Technologie, um Kandidatenreden in Echtzeit in Dutzende lokale Dialekte zu übersetzen und per WhatsApp an spezifische Wählergruppen zu senden.

Daneben kursierten Deepfakes von Bollywood-Stars, die Wahlempfehlungen abgaben, und Videos von verstorbenen Politikern, die „wiederbelebt“ wurden, um ihre Nachfolger zu unterstützen. Untersuchungen deckten auf, dass politische Akteure Millionenbeträge in sogenannte Shadow Networks investierten – inoffizielle Netzwerke, die KI-generierte Hassrede und Desinformation verbreiteten, ohne direkt mit einer Partei verknüpft zu sein.

Slowakei – die Gefahr von Last-Minute-Angriffen

Der Fall des slowakischen Politikers Michal Šimečka bleibt ein Lehrstück. Zwei Tage vor der Wahl im Herbst 2023 tauchte ein Audio-Deepfake auf, in dem er angeblich über Wahlmanipulation sprach.

Das Problem: Aufgrund eines gesetzlichen Wahlkampf-Moratoriums – 48 Stunden vor der Wahl darf keine Berichterstattung mehr stattfinden – konnten Medien und Faktenchecker den Fake nicht rechtzeitig widerlegen. KI ermöglicht gezielte Angriffe in genau den Zeitfenstern, in denen eine Korrektur systemisch unmöglich ist.

USA 2024 – die ausgebliebene Apokalypse?

Vor den US-Wahlen 2024 warnten Experten vor einer „Deepfake-Apokalypse“. Rückblickend blieb der direkte Einfluss hinter den schlimmsten Befürchtungen zurück.

Es gab dokumentierte Fälle – etwa Robocalls mit der gefälschten Stimme von Joe Biden in New Hampshire oder KI-generierte Bilder von Donald Trump, umringt von afroamerikanischen Wählern. Doch die größte Gefahr war subtiler: Nicht, dass Wähler einen Fake für echt hielten, sondern die allgemeine Verunsicherung. Das Bewusstsein für KI-Fälschungen führte dazu, dass Wähler generell skeptischer wurden – auch gegenüber legitimen Nachrichten.

Die Liar’s Dividend: Warum Deepfakes auch ohne Täuschung gefährlich sind

Das vielleicht gefährlichste Phänomen der Deepfake-Ära hat nichts mit Täuschung zu tun – sondern mit Leugnung. Die Rechtswissenschaftler Bobby Chesney und Danielle Citron prägten dafür den Begriff „Liar’s Dividend“: Wenn jede Aufnahme gefälscht sein kann, können Politiker und Wirtschaftsführer authentische, belastende Beweise einfach als KI-Fälschung abtun.

Das passiert bereits auf mehreren Ebenen. Vor Gericht nutzen Anwälte zunehmend das Argument der möglichen KI-Manipulation, um Video- oder Audiobeweise auszuhebeln oder deren Glaubwürdigkeit bei Geschworenen zu untergraben. In der Politik greifen Akteure, die mit Skandalen konfrontiert werden, standardmäßig zur Behauptung, das Material sei manipuliert. Studien zeigen, dass diese Taktik oft erfolgreicher ist als Schweigen oder Leugnen, weil sie die kognitive Unsicherheit gezielt ausnutzt.

Der Edelman Trust Barometer 2026 bestätigt die gesellschaftlichen Folgen. Das Vertrauen in Institutionen, Medien und NGOs ist weiter gesunken. 50 % der Befragten nennen die Angst vor KI-gesteuerter Desinformation als einen Hauptgrund für ihren Vertrauensverlust. Menschen ziehen sich in kleine, vertraute Kreise zurück und misstrauen externen Informationen – eine Fragmentierung der Öffentlichkeit, in der ein gemeinsamer Faktenkonsens kaum noch erreichbar ist.

So erkennst du Deepfakes – Tipps und Tools

Die Frage „Wie erkenne ich das?“ ist 2026 komplexer denn je. Trotzdem gibt es noch Anhaltspunkte – sowohl für dein eigenes Auge als auch technische Hilfsmittel.

Manuelle Erkennung: Worauf du achten kannst

Auch wenn die Qualität von Deepfakes massiv gestiegen ist, existieren noch subtile Indikatoren:

- Blinzeln: KI-generierte Menschen blinzeln oft unnatürlich – zu oft, zu selten oder in einem zu gleichmäßigen Rhythmus. Auch Mikro-Expressionen im Gesicht wirken oft starr oder fehlen ganz.

- Atmung: Menschliche Sprache ist untrennbar mit der Atmung verbunden. KI-Stimmen haben oft unnatürliche Atemmuster – Einatmen an der falschen Stelle oder komplett fehlende Atemgeräusche bei langen Sätzen.

- Profilansichten: Wenn sich ein synthetisches Gesicht zur Seite dreht, treten bei vielen Modellen noch Artefakte an Ohren, Brillenbügeln oder der Kieferlinie auf.

- Kontext: Oft verrät nicht das Bild selbst, sondern der Kontext den Fake. Stimmen Licht und Schattenwurf überein? Spiegelt sich die Umgebung korrekt in den Augen?

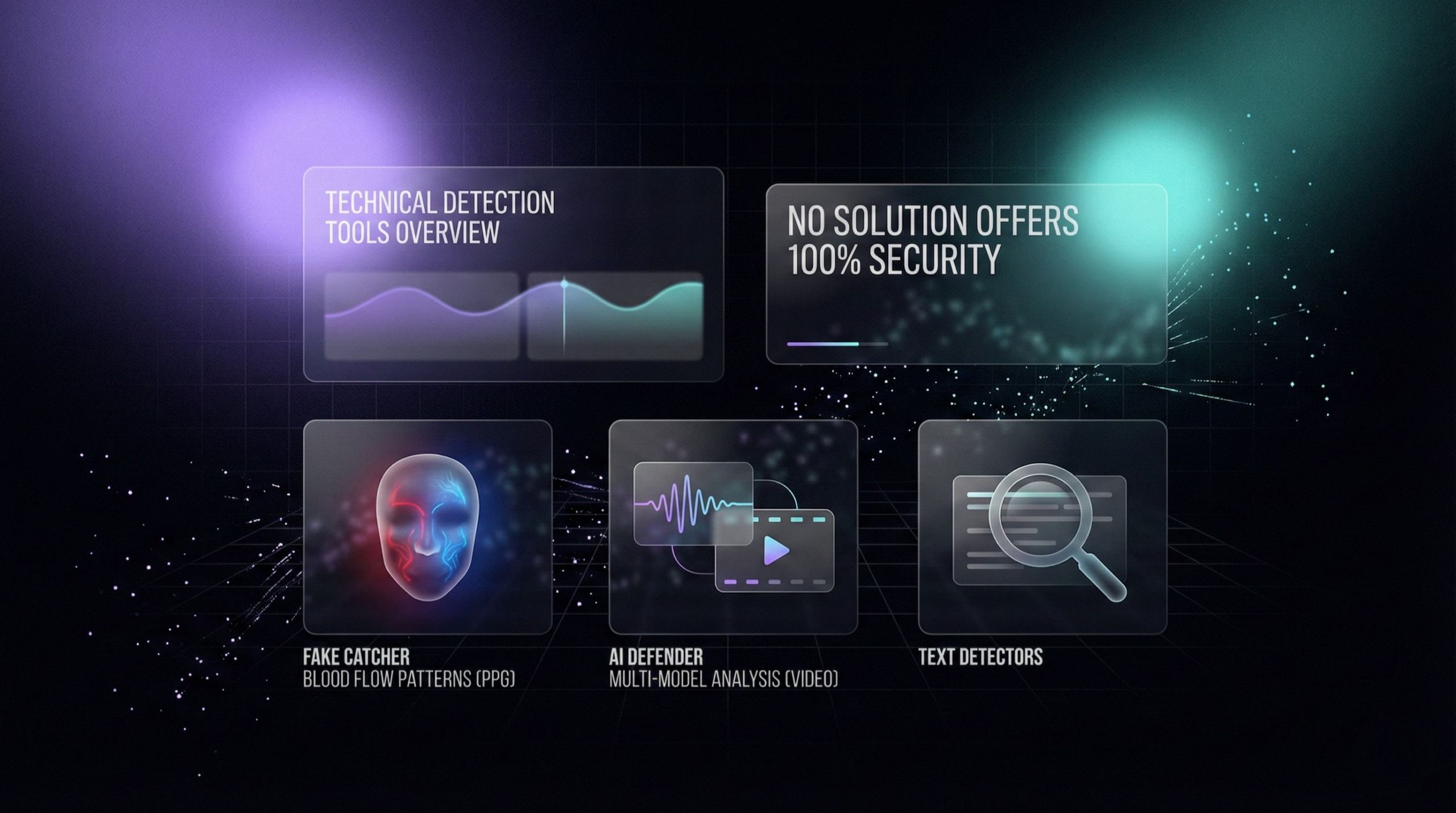

Technische Detektionstools im Überblick

Ein Markt für Erkennungssoftware hat sich etabliert – aber keine Lösung bietet hundertprozentige Sicherheit.

| Tool / Anbieter | Methode | Stärken | Schwächen |

|---|---|---|---|

| Intel FakeCatcher | Photoplethysmographie (PPG) | Erkennt Blutfluss-Veränderungen im Gesicht | Braucht hohe Videoqualität, versagt bei Kompression |

| Sensity AI / Reality Defender | Multi-Modell-Ansatz | Kombiniert Audio-, Video- und Metadaten-Analyse | Teuer, anfällig für „Adversarial Noise“ |

| Hive Moderation | Content Scanning | Schnelle Analyse großer Datenmengen | Anfällig für ganz neue Generatoren |

| Text-Detektoren (z. B. GPTZero) | Statistische Analyse | Versuch, KI-Textmuster zu erkennen | Hohe Fehlerquote, diskriminiert Nicht-Muttersprachler |

Besonders bei KI-generierten Texten bleibt die Erkennung ein ungelöstes Problem. Studien aus 2025 zeigen hohe Falsch-Positiv-Raten – was im akademischen Kontext zu falschen Beschuldigungen führt. Menschliche Bewerter schneiden dabei oft nicht besser ab als der Zufall.

Gegenmaßnahmen: Was Politik, Plattformen und Technik tun

EU AI Act und Transparenzpflichten

Der EU AI Act ist in Kraft getreten, befindet sich aber in einer kritischen Übergangsphase. Die zentralen Transparenzpflichten nach Artikel 50 verpflichten Anbieter, KI-generierte Inhalte wie Deepfakes und Chatbot-Ausgaben klar zu kennzeichnen. Die volle Anwendbarkeit und Strafbewehrung dieser Regeln greift allerdings erst ab August 2026.

Im Januar 2026 läuft die Konsultationsphase für den begleitenden „Code of Practice“. Dieser definiert die technischen Standards für die Kennzeichnung – etwa Wasserzeichen. Der Entwurf sieht vor, dass Markierungen maschinenlesbar und robust gegen Manipulation sein müssen. Zusätzlich sollen Anbieter kostenlose Detektionstools bereitstellen.

US-Regulierung: TAKE IT DOWN Act und kalifornische Gesetze

In den USA herrscht ein regulatorischer Flickenteppich. Auf Bundesebene wurde im Mai 2025 der TAKE IT DOWN Act unterzeichnet. Er verpflichtet Plattformen, nicht-einvernehmliche intime Deepfakes innerhalb von 48 Stunden nach Meldung zu löschen.

Kalifornien geht mit eigenen Gesetzen weiter. Der „Defending Democracy from Deepfake Deception Act“ (AB 2655) und AB 2839 verpflichten große Plattformen, während Wahlkampfzeiten – 120 Tage vor der Wahl – „materiell täuschende Inhalte“ zu blockieren oder zu labeln. Diese Gesetze gelten als Modell für andere Bundesstaaten, stehen aber im Spannungsfeld mit der Meinungsfreiheit des First Amendment.

C2PA und Content Credentials – der digitale Herkunftsnachweis

Die größte technische Hoffnung liegt auf dem offenen Standard C2PA (Coalition for Content Provenance and Authenticity). C2PA fügt einer Datei kryptografisch signierte Metadaten hinzu, die den Ursprung – Kamera, Software – und alle Bearbeitungsschritte dokumentieren. Stell dir eine Art digitales Herkunftssiegel für Medieninhalte vor.

TikTok und LinkedIn zeigen Content Credentials bereits automatisch an. Kamerahersteller wie Sony und Leica integrieren die Technologie direkt in die Hardware. Doch das System hat eine Schwäche: Es ist ein Opt-in-Standard. Propagandisten nutzen keine C2PA-Kameras. Zudem gehen die Credentials oft verloren, wenn Inhalte per Screenshot geteilt oder durch nicht-kompatible Apps geschleust werden.

Plattform-Strategien: YouTube, TikTok und X im Vergleich

Die großen Plattformen verfolgen unterschiedliche Ansätze:

YouTube setzt auf Offenlegung und ökonomischen Druck. Creator müssen synthetische Inhalte kennzeichnen. Seit Juli 2025 greift eine harte Linie gegen „Slop“ – massenhaft automatisch generierte Inhalte. Kanäle, die solchen Content hochladen, verlieren ihre Monetarisierung.

TikTok verfolgt eine strikte Politik gegen KI-Inhalte, die Minderjährige oder öffentliche Personen in falschen Kontexten zeigen. Die Plattform hat 2025 die C2PA-Integration vorangetrieben, um KI-Inhalte automatisch zu labeln.

X (Twitter) setzt primär auf Community Notes – also Crowd-sourced Fact-Checking. Eine Studie der University of Washington aus 2025 zeigt allerdings Grenzen auf: Community Notes bremsen zwar die Viralität, kommen aber oft zu spät. Bei emotional aufgeladenen Deepfakes verbreitet sich die Falschinformation schneller, als die Community einen Konsens für eine Korrektur finden kann.

Häufige Missverständnisse über KI und Desinformation

„Deepfakes betreffen nur Prominente und Politiker.“ Falsch. Voice Cloning wird massenhaft für den sogenannten „Enkeltrick“ eingesetzt – Betrüger rufen Angehörige mit der geklonten Stimme eines Familienmitglieds an und bitten um Geld. Echtzeit-Deepfakes dienen dazu, Identitätsprüfungen bei Banken oder Krypto-Börsen zu umgehen. Die Technologie trifft Privatpersonen genauso wie öffentliche Figuren.

„Ich erkenne einen Deepfake, wenn ich genau hinschaue.“ Das war bis etwa 2023 teilweise richtig. Inzwischen ist die Detection Horizon überschritten – die Qualität synthetischer Medien liegt jenseits dessen, was das menschliche Auge zuverlässig unterscheiden kann. Besonders auf Smartphone-Bildschirmen und bei komprimierten Videos hast du praktisch keine Chance, einen guten Deepfake zu erkennen.

„Deepfakes sind nur gefährlich, wenn jemand sie für echt hält.“ Eines der größten Missverständnisse. Die Liar’s Dividend zeigt: Deepfakes sind auch dann schädlich, wenn niemand getäuscht wird. Allein ihre Existenz erlaubt es Akteuren, echte Beweise als Fälschung abzutun. Das untergräbt Verantwortlichkeit und öffentliches Vertrauen – ganz ohne dass ein einziger Fake geglaubt werden muss.

„KI-Textdetektoren funktionieren zuverlässig.“ Studien aus 2025 zeichnen ein anderes Bild. Text-Detektoren weisen hohe Falsch-Positiv-Raten auf und diskriminieren häufig Nicht-Muttersprachler. Im akademischen Kontext führt das zu falschen Beschuldigungen. Menschliche Bewerter schneiden bei der Erkennung von KI-Texten oft nicht besser ab als der Zufall.

„Regulierung wird das Problem lösen.“ Regulierung ist ein wichtiger Baustein, aber kein Allheilmittel. Der EU AI Act etwa greift erst ab August 2026 vollständig. Und selbst dann bleibt die Durchsetzung schwierig – Propagandisten operieren grenzüberschreitend und passen ihre Taktiken schnell an. Es braucht das Zusammenspiel aus Regulierung, Technologie und Medienkompetenz.

FAQ

Wie viele Deepfakes gibt es aktuell im Internet?

Laut Schätzungen der Cybersicherheitsfirma DeepStrike ist das Volumen von rund 500.000 Deepfakes im Jahr 2023 auf etwa 8 Millionen im Jahr 2025 gestiegen – ein Anstieg von fast 900 %.

Wie viel Audiomaterial braucht man, um eine Stimme zu klonen?

2026 reichen 3 bis 30 Sekunden Referenzmaterial. Eine kurze Instagram-Story oder eine Sprachnachricht genügt, um einen überzeugenden Stimmklon zu erstellen – inklusive Atempausen und emotionaler Färbung.

Gibt es Tools, die Deepfakes zuverlässig erkennen?

Es gibt spezialisierte Tools wie Intel FakeCatcher, Sensity AI oder Hive Moderation. Keines bietet jedoch hundertprozentige Sicherheit. Jede Methode hat Schwächen – insbesondere bei stark komprimierten Inhalten oder völlig neuen Generatoren. Bei KI-generierten Texten ist die Erkennungsleistung besonders unzuverlässig.

Was ist die Liar’s Dividend?

Die Liar’s Dividend beschreibt den Vorteil, den Lügner aus der bloßen Existenz von Deepfakes ziehen. Wenn jede Aufnahme gefälscht sein könnte, können Politiker oder Wirtschaftsführer authentische, belastende Beweise einfach als KI-Fälschung abtun – und kommen damit oft durch.

Was regelt der EU AI Act bei Deepfakes?

Der EU AI Act verpflichtet Anbieter, KI-generierte Inhalte klar zu kennzeichnen (Artikel 50). Die volle Strafbewehrung dieser Transparenzpflichten greift ab August 2026. Ein begleitender Code of Practice legt die technischen Standards fest – etwa maschinenlesbare Wasserzeichen.

Was ist C2PA und wie hilft es gegen Desinformation?

C2PA (Coalition for Content Provenance and Authenticity) ist ein offener Standard, der Mediendateien kryptografisch signierte Metadaten hinzufügt. So lässt sich nachvollziehen, mit welcher Kamera oder Software ein Inhalt erstellt und wie er bearbeitet wurde. TikTok, LinkedIn sowie Kamerahersteller wie Sony und Leica setzen den Standard bereits ein. Die Schwäche: Es ist ein Opt-in-System, und die Metadaten gehen beim Teilen per Screenshot oft verloren.

Wurde wirklich eine Wahl wegen KI-Desinformation annulliert?

Ja. Im Dezember 2024 annullierte das rumänische Verfassungsgericht die erste Runde der Präsidentschaftswahlen. Ermittlungen hatten eine massive, koordinierte Kampagne mit über 25.000 Bot-Accounts und KI-gesteuerten Netzwerken auf TikTok und Facebook aufgedeckt. Es gab starke Indizien für russische Einflussnahme.

Fazit: Wachsamkeit als Dauerzustand

Die Ära der naiven Wahrnehmung ist vorbei. Audio-visuelle Beweise müssen ohne kryptografischen Nachweis wie C2PA standardmäßig als unbestätigt gelten. Die Risiken für Wahlen, Wirtschaft und sozialen Frieden sind akut – der Fall Rumänien führt das drastisch vor Augen.

Doch die Gesellschaft ist nicht wehrlos. Die Kombination aus technischer Authentifizierung, strengerer Regulierung und gesteigerter Medienkompetenz bildet das Bollwerk gegen die totale Erosion der Wahrheit. Der wichtigste Gedanke dabei: Der Kampf gegen Desinformation ist kein Problem, das sich einmal lösen lässt. Er ist ein Dauerzustand, der ständige Wachsamkeit erfordert – von Plattformen, von Regulierungsbehörden und von dir selbst.

Quellen und weitere Infos:

- AI False Claim Monitor August 2025 – NewsGuard

- The Apocalypse That Wasn’t – Harvard Ash Center

- Deepfakes, Elections, and Shrinking the Liar’s Dividend – Brennan Center

- Deep Fakes 2026 – University at Buffalo

- 2026 Edelman Trust Barometer

- Content Credentials Whitepaper – C2PA

- EU AI Act – Regulatory Framework – Europäische Kommission

- Community Notes on X – University of Washington

- Brands Send Billions to Misinformation Websites – NewsGuard/Comscore

- Romania Annulled Its Presidential Election Results – Atlantic Council