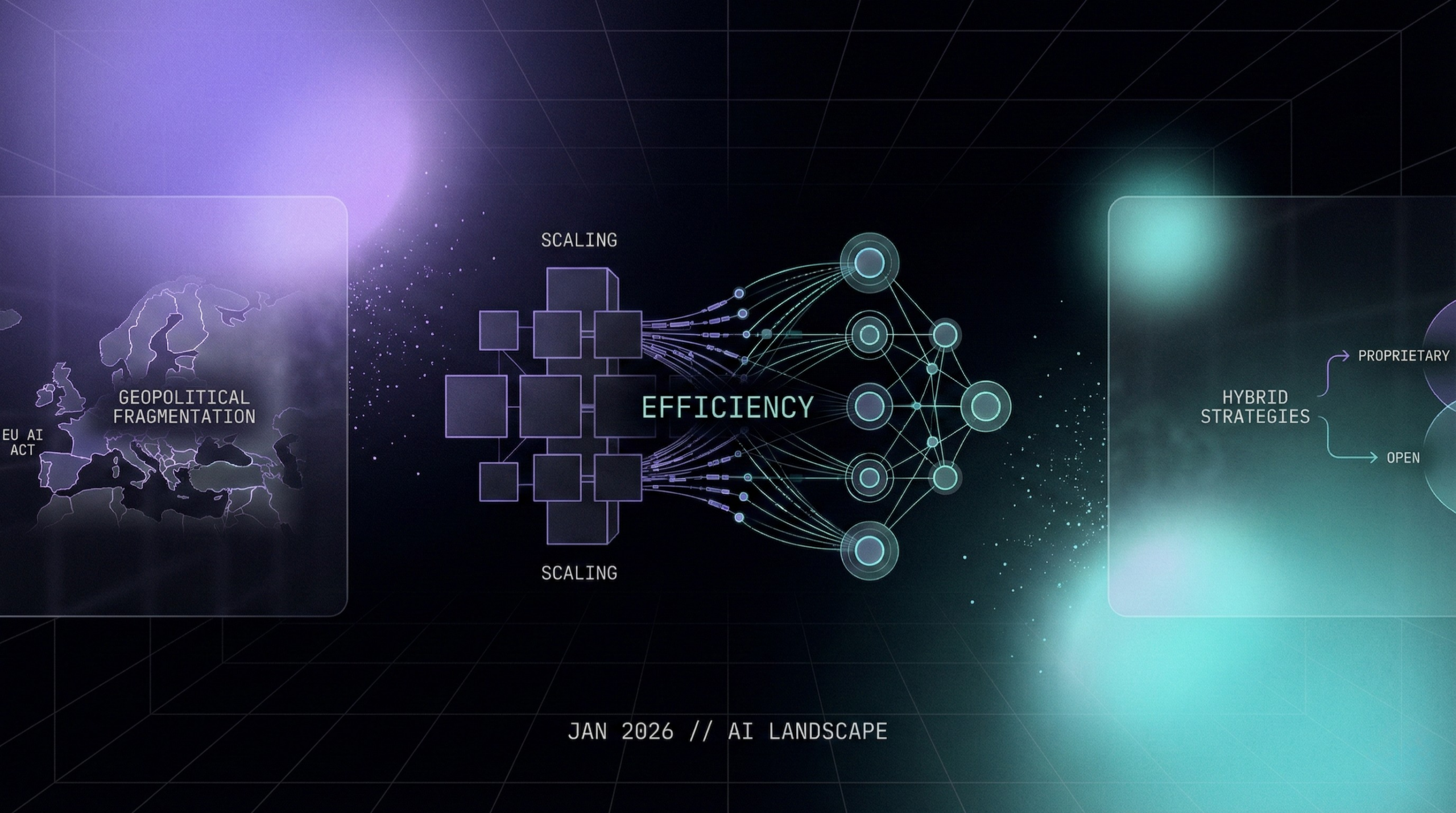

Weder noch – und beide gleichzeitig. Im Januar 2026 ist die Grenze zwischen offenen und geschlossenen KI-Modellen so verschwommen wie nie zuvor. Offene Modelle wie DeepSeek V3.2 und Meta Llama 4 haben bei Standardaufgaben zu den proprietären Giganten aufgeschlossen. Gleichzeitig verteidigen OpenAI, Google und Anthropic ihre Position bei komplexen Reasoning-Aufgaben und agentischen Workflows.

Die ehrliche Antwort: Für 95 % aller Unternehmensanwendungen liefern Open-Weights-Modelle vergleichbare Ergebnisse – zu einem Bruchteil der Kosten. Wer aber Spitzenleistung bei mathematischem Reasoning oder tief integrierte Ökosysteme braucht, kommt an Closed Source nicht vorbei. Die meisten Unternehmen fahren 2026 deshalb eine hybride Strategie.

Manchmal brauchst du keine neue Modellfamilie, sondern einen klaren, ehrlichen Überblick über das Kernprinzip hinter der ganzen Debatte. Der Grundlagenartikel Open Source vs. Closed Source KI hilft dir, Definitionen, Vor- und Nachteile sowie typische Missverständnisse sauber zu sortieren, bevor du intern eine Hybridstrategie festzurrst.

Open Source vs. Closed Source KI im Überblick

Bevor wir ins Detail gehen, hier der Schnellvergleich der beiden Ansätze:

| Kriterium | Closed Source | Open Weights |

|---|---|---|

| Zugang | Nur über API | Gewichte frei herunterladbar |

| Kosten | Laufende API-Gebühren | Einmalige Infrastrukturkosten, lokale Inferenz möglich |

| Spitzenleistung (Reasoning) | Führend (GPT-5.2 Thinking) | Knapp dahinter, aber aufholend (DeepSeek V3.2) |

| Standardaufgaben | Gleichauf | Gleichauf |

| Anpassbarkeit | Eingeschränkt (Fine-Tuning via API) | Volle Kontrolle über Gewichte und Architektur |

| Datenschutz | Daten verlassen das Unternehmen | Lokaler Betrieb möglich |

| Sicherheit | Zentrale Filterung, gehärtete Systeme | Community-gesteuert, variable Qualität |

| EU-Verfügbarkeit | Meist verfügbar | Teilweise gesperrt (z. B. Llama 4 Multimodal) |

Was bedeutet „Open Source“ bei KI überhaupt?

Der Begriff „Open Source“ ist im KI-Kontext 2026 ein juristisches Minenfeld. Was bei klassischer Software klar definiert ist, sorgt bei KI-Modellen für hitzige Debatten – und jede Menge Verwirrung.

Die OSI-Definition und ihre vier Freiheiten

Die Open Source Initiative (OSI) hat im Oktober 2024 die Version 1.0 ihrer „Open Source AI Definition“ veröffentlicht. Sie verlangt vier Freiheiten für ein KI-System:

- Verwendung – Das System für jeden Zweck nutzen, ohne Erlaubnis einzuholen.

- Studium – Die Funktionsweise des Systems untersuchen.

- Modifikation – Das System für jeden Zweck verändern.

- Weitergabe – Das System mit oder ohne Änderungen teilen.

Der Knackpunkt: Die OSI verlangt nicht nur offene Gewichte und Inferenzcode. Du brauchst auch „ausreichend detaillierte Informationen über die Trainingsdaten“, um ein gleichwertiges System nachbauen zu können.

Die Realität: Open Weights ≠ Open Source

Hier kracht Theorie auf Praxis. Fast keines der führenden „offenen“ Modelle erfüllt die OSI-Definition vollständig. Weder Meta mit Llama 4 noch DeepSeek mit V3.2 legen ihre Trainingsdatensätze offen. Die Gründe sind nachvollziehbar: Angst vor Urheberrechtsklagen und der Schutz von Geschäftsgeheimnissen wiegen schwerer als das OSI-Siegel.

Wenn also jemand „Open Source KI“ sagt, meint er in der Regel „Open Weights“ – du kannst die Modellgewichte herunterladen und lokal betreiben, aber die Trainingsdaten bleiben ein Geheimnis.

Die Taxonomie – von Closed Source bis Open Science

Um die Verwirrung aufzulösen, hat sich in der Fachwelt eine vierstufige Klassifikation durchgesetzt:

| Tier | Bezeichnung | Merkmale | Beispiele | OSI-konform? |

|---|---|---|---|---|

| 1 | Closed Source | Nur API-Zugang, alles geheim | GPT-5.2, Gemini 3 Pro, Claude Opus 4.5 | Nein |

| 2 | Open Weights (restriktiv) | Gewichte downloadbar, Lizenz mit Einschränkungen | Llama 4 (Community License), DeepSeek V3.2 | Nein |

| 3 | Permissive Open Weights | Freie Lizenzen (Apache 2.0, MIT), aber keine Trainingsdaten | Mistral Large 3, IBM Granite 4.0, Falcon 3 | Grauzone |

| 4 | Open Science | Volle Transparenz inkl. Trainingsdaten und Logs | OLMo 2, akademische Projekte | Ja |

Die meisten Modelle, die du im Alltag als „offen“ kennst, landen in Tier 2 oder 3. Echte Open Science nach OSI-Standard bleibt die Ausnahme.

Die Kontroverse um Open Washing und Lizenzen

Ein besonders heikles Thema: die Lizenzierungstricks der großen Anbieter.

Meta nennt Llama 4 „Open Source“, sperrt aber die multimodalen Varianten für EU-Nutzer komplett und verlangt ab 700 Millionen monatlichen Nutzern eine Sonderlizenz. Ein Modell, das ganze Kontinente ausschließt, als „offen“ zu bezeichnen – das sehen viele Kritiker als klassisches Open Washing.

DeepSeek wiederum nutzt formell die MIT-Lizenz für V3.2, schiebt aber Nutzungsbedingungen nach, die eine Haftung für „Missbrauch“ auf den Nutzer abwälzen. Das Ergebnis: Ein „offenes“ Modell, das indirekt die Zensurvorgaben seines Ursprungslandes exportieren könnte.

Preisvergleich: Was kosten die Modelle?

Die Kosten sind der Bereich, in dem Open Weights am deutlichsten punkten. Der Preisverfall bei der KI-Inferenz ist 2026 dramatisch – und das verändert die gesamte Kalkulation.

Der größte Hebel sitzt fast nie in der Modellwahl, sondern in deiner Kostenlogik: Sobald du API-Preise, Anfragevolumen und Infrastruktur sauber gegeneinanderstellst, kippt die „Open vs. Closed“-Debatte von Glaubensfrage zu Excel-Entscheidung. Genau dafür hilft dir der KI-Tool Kosten & Budget Guide dabei, typische Rechenfehler (zu optimistisches Volumen, vergessene Ops-Kosten, falsche Token-Annahmen) zu vermeiden und ein belastbares Budget für hybride Setups aufzusetzen.

Inferenzkosten im direkten Vergleich

DeepSeek hat mit Preisen von rund 0,28 Dollar pro Million Input-Tokens einen neuen Tiefstpreisanker gesetzt. Das zwingt westliche API-Anbieter wie OpenAI und Google, ihre Preise anzupassen oder einen massiven Mehrwert zu bieten, der die höheren Kosten rechtfertigt.

OpenAI reagiert darauf, indem es die Diskussion von „Kosten pro Token“ auf „Wert pro Arbeitsergebnis“ lenkt. Die Logik: Wenn GPT-5.2 Thinking autonom ein ganzes Softwaremodul schreibt und testet, sind höhere Token-Kosten irrelevant – der Output zählt.

Lokale Inferenz vs. API-Abonnement

Hier wird es für Unternehmen richtig interessant. Modelle wie Llama 4 Scout laufen mit Quantisierung auf einer einzigen H100-GPU. Die Grenzkosten sinken damit fast auf die Stromkosten. Du zahlst einmal für die Hardware und bist danach unabhängig von monatlichen API-Gebühren.

Für Unternehmen mit hohem Anfragevolumen oder strengen Datenschutzanforderungen ist das ein Gamechanger. Die Daten verlassen nie das eigene Netzwerk, und du bist nicht von der Verfügbarkeit oder Preispolitik eines API-Anbieters abhängig.

Der DeepSeek-Effekt auf die Preise

Der „DeepSeek-Schock“ von Anfang 2025 hat die gesamte Preisstruktur der Branche erschüttert. Als DeepSeek enthüllte, dass das Training des R1-Modells nur 5,6 Millionen Dollar kostete – ein Bruchteil der geschätzten 100 Millionen für GPT-4 – brach die Nvidia-Aktie ein und das Narrativ „Nur mit Milliarden-Budgets kann man konkurrieren“ zerbröselte.

Der Erfolg von DeepSeek auf H800-Chips (die von US-Sanktionen nicht betroffen sind) zeigt: Software-Optimierung kann Hardware-Nachteile ausgleichen. Das demokratisiert den Zugang zur KI-Entwicklung grundlegend.

Leistungsvergleich: Benchmarks im Januar 2026

Die entscheidende Frage: Wie groß ist der Leistungsunterschied zwischen offenen und geschlossenen Modellen tatsächlich? Die Antwort hängt davon ab, was du messen willst.

Wenn du gerade versuchst, „Preis pro Token“ gegen „Wert pro Ergebnis“ abzuwägen, brauchst du Vergleichswerte, die nicht nur auf Bauchgefühl basieren. Der Überblick beste KI-APIs nach Preis-Leistung gibt dir dafür eine pragmatische Marktkarte: Wo lohnt sich ein API-Abo trotz höherer Preise, wo sind günstige Anbieter gut genug, und wann wird Self-Hosting plötzlich wirtschaftlich.

Benchmark-Tabelle: GPT-5.2 vs. Llama 4 vs. DeepSeek V3.2

| Benchmark | Was wird gemessen? | GPT-5.2 Thinking (Closed) | Llama 4 Maverick (Open Weights) | DeepSeek V3.2 Speciale (Open Weights) |

|---|---|---|---|---|

| AIME 2025 | Mathematik (Wettbewerbsniveau) | 100 % | ca. 70 % | Goldmedaillen-Niveau |

| SWE-bench Verified | Software-Engineering | 80 % | 64,6 % | Hoch (IOI-Goldniveau) |

| GPQA Diamond | Wissenschaft (Experten) | 92,4 % | 69,8 % | Hoch |

| LMSYS Arena | Menschliche Präferenz (Elo) | 1.464 | 1.417 | 1.460+ |

Wo Closed Source noch vorne liegt

GPT-5.2 Thinking dominiert bei den absoluten Spitzenleistungen. Eine Erfolgsquote von 100 % bei AIME 2025 ist beeindruckend – das ist Mathematik auf Wettbewerbsniveau, die selbst für begabte Studierende eine Herausforderung darstellt. Auch bei wissenschaftlichen Expertenfragen (GPQA Diamond) hat OpenAI einen klaren Vorsprung.

Der Grund: „Thinking“-Modelle nutzen zur Laufzeit zusätzliche Rechenleistung, um interne Gedankenketten zu bilden, bevor sie antworten. Dieses Reasoning geht weit über das bloße Vorhersagen des nächsten Wortes hinaus.

Auch bei der Tool-Integration – also der Fähigkeit, Browser, Code-Ausführung und externe Dienste zu nutzen – haben geschlossene Modelle durch ihre tief integrierten Ökosysteme noch Vorteile.

Wenn du tiefer verstehen willst, warum OpenAI bei anspruchsvollem Reasoning oft noch den Tick stabiler wirkt, lohnt sich ein Blick auf die Modell-Linie und ihre Sprünge. Der Grundlagenartikel die Evolution der GPT-Modelle ordnet ein, wie sich „Thinking“-Ansätze, Tool-Nutzung und Produkt-Splits entwickelt haben – und was das für deine Praxis heißt.

Wo Open Weights gleichgezogen haben

Die LMSYS Arena erzählt eine andere Geschichte. Hier bewerten echte Nutzer blind die Antworten verschiedener Modelle. DeepSeek V3.2 erreicht mit einem Elo-Score von über 1.460 fast das Niveau von GPT-5.2 (1.464). Im Praxistest, bei dem es um alltägliche Aufgaben geht, ist der Unterschied für die meisten Nutzer kaum spürbar.

DeepSeek V3.2 Speciale hat außerdem bewiesen, dass offene Modelle durch spezialisiertes Training und Reinforcement Learning auch bei Reasoning-Aufgaben auf Goldmedaillen-Niveau kommen können – bei Mathematik-Olympiaden und Informatik-Wettbewerben.

Die ehrliche Einschätzung: Für die große Mehrheit der Unternehmensanwendungen – Textgenerierung, Zusammenfassungen, Kundensupport, Codeunterstützung – ist der Unterschied zwischen einem Llama 4 Maverick und GPT-5.2 vernachlässigbar. Der Kostenunterschied dagegen ist es nicht.

Wenn du Open Weights ernsthaft evaluierst, willst du mehr als Schlagzeilen: Lizenz, Laufzeitkosten, Qualität in Alltagstasks und die typischen Stolperfallen beim Betrieb. Der Test DeepSeek V3 Test: Chinas Open Source Modell ist dafür hilfreich, weil er den „günstig und stark“-Reiz gegen reale Praxisfragen wie Output-Stabilität, Einschränkungen und Einsatzszenarien hält.

Die Krise der Evaluation

Ein wichtiger Vorbehalt: Klassische Benchmarks wie MMLU sind 2026 weitgehend gesättigt. Alle großen Modelle erreichen dort Spitzenwerte, sodass die Tests kaum noch differenzieren.

Die Branche bewegt sich deshalb zu dynamischen Evaluierungen wie LiveCodeBench (das Kontamination mit Trainingsdaten vermeidet) und GDPval (das die Arbeitsleistung in 44 Berufsfeldern misst). Bei diesen praxisnahen Tests zeigen geschlossene Modelle durch ihre bessere Tool-Integration noch Vorteile – aber der Vorsprung schmilzt schnell.

Closed Source KI: Die großen Drei

Drei Unternehmen dominieren das proprietäre Segment im Januar 2026. Jedes verfolgt dabei eine eigene Strategie, um sich gegen die offene Konkurrenz zu behaupten.

OpenAI GPT-5.2 – Reasoning als Burggraben

OpenAI hat mit GPT-5.2 im Dezember 2025 seine Produktstrategie radikal neu ausgerichtet. Das Unternehmen sieht sich bei Standardaufgaben einem brutalen Preiskampf ausgesetzt – und flüchtet nach vorn in die Komplexität.

GPT-5.2 ist kein einzelnes Modell, sondern ein Triumvirat: „Instant“ für schnelle, günstige Anfragen, „Thinking“ für reasoning-intensive Aufgaben und „Pro“ mit maximaler Kapazität. Das Herzstück ist die Thinking-Variante. Sie nutzt zur Laufzeit zusätzliche Rechenleistung, um interne Gedankenketten zu bilden, bevor sie antwortet. Das Ergebnis: 100 % Erfolgsquote bei AIME 2025 und die Fähigkeit, autonom ganze Softwaremodule zu schreiben und zu testen.

Die Strategie dahinter ist klar: Da offene Modelle bei einfachen Aufgaben praktisch kostenlos sind, muss GPT-5.2 Aufgaben lösen, die wertvoll genug sind, um hohe Inferenzkosten zu rechtfertigen. OpenAI lenkt die Diskussion bewusst von „Kosten pro Token“ auf „Wert pro Arbeitsergebnis“.

Google Gemini 3 – Ökosystem-Strategie mit Agentic Vision

Google hat seine KI-Bemühungen unter der Marke Gemini konsolidiert. Gemini 3 Pro und Gemini 3 Flash sind im Januar 2026 die neuen Standards.

Das spannendste Feature heißt „Agentic Vision“. Statt ein Bild passiv als Ganzes zu verarbeiten, kann Gemini 3 aktiv Python-Code generieren, um in Bilder hineinzuzoomen, Ausschnitte zu analysieren und Details zu verifizieren. Bilderkennung wird damit von einem statischen Prozess zu einer aktiven Untersuchung – besonders relevant für industrielle Anwendungen und medizinische Diagnostik.

Googles eigentlicher Burggraben ist aber nicht das Modell selbst, sondern das Ökosystem. Gemini ist tief in Android und Workspace integriert. Ein Modell, das Zugriff auf deine E-Mails, deinen Kalender und deine Dokumente hat, bietet einen Mehrwert, den ein isoliertes Open-Weights-Modell nur schwer replizieren kann. Die Strategie heißt: Friktionslosigkeit statt Modellüberlegenheit.

Anthropic Claude Opus 4.5 – Sicherheit als Produkt

Anthropic positioniert sich als der „erwachsene“ Akteur im Raum. Mit Claude Opus 4.5 und der „Neuen Verfassung“ zielt das Unternehmen gezielt auf stark regulierte Märkte wie Finanzwesen, Gesundheit und öffentliche Verwaltung.

Der Ansatz „Constitutional AI“ bedeutet: Die Verhaltensweisen des Modells werden nicht nur durch Reinforcement Learning gesteuert, sondern durch explizite, menschenlesbare Prinzipien. Für Unternehmen, die KI tief in ihre Workflows integrieren, schafft das Rechtssicherheit und Nachvollziehbarkeit.

Eine herausragende Fähigkeit von Claude Opus 4.5 ist „Computer Use“ – die direkte Interaktion mit Benutzeroberflächen. Das Modell kann wie ein Mensch Software bedienen und greift damit den Markt für Robotic Process Automation (RPA) frontal an.

Open Source KI: Die Herausforderer

Die Gegenseite schläft nicht. Im Gegenteil: Die Allianz der Open-Weights-Modelle hat 2026 eine kritische Masse erreicht, die das Machtgefüge der KI-Industrie dauerhaft verschiebt.

DeepSeek V3.2 – Der 5,6-Millionen-Dollar-Schock

Das definierende Ereignis der letzten zwölf Monate war der Aufstieg von DeepSeek. Das chinesische Labor, hervorgegangen aus dem Hedgefonds High-Flyer, hat bewiesen, dass Milliarden-Budgets und Top-Chips keine Voraussetzung für Spitzenleistung sind.

Der Wendepunkt kam im Januar 2025: DeepSeek enthüllte, dass das Training des R1-Modells nur 5,6 Millionen Dollar kostete. Zum Vergleich – für GPT-4 wurden rund 100 Millionen Dollar geschätzt. Die Folge: der größte Tagesverlust der Nvidia-Aktie in der Geschichte und eine Grundsatzdebatte über die Skalierungsthese der gesamten Branche.

Im Januar 2026 legte DeepSeek mit V3.2 Speciale nach. Das Modell erreicht Parität mit Gemini 3.0 Pro und GPT-5 bei komplexen Aufgaben und Goldmedaillen-Niveau bei Mathematik-Olympiaden. Der Schlüssel liegt in einer extrem effizienten Mixture-of-Experts-Architektur und Sparse Attention (DSA), die die Inferenzkosten drastisch senkt. Das Modell läuft auf den günstigeren H800-Chips – also genau der Hardware, die von US-Sanktionen nicht betroffen ist.

Meta Llama 4 – Der neue Infrastruktur-Standard

Meta verfolgt eine andere Strategie: Das Modell soll zur Commodity werden, um das eigene Ökosystem zu stärken. Die im April 2025 veröffentlichte Llama-4-Familie ist der aktuelle De-facto-Standard für Open-Weights-Entwicklung.

Die Familie besteht aus drei Varianten. Llama 4 Scout ist das Effizienzwunder: 109 Milliarden Gesamtparameter, aber nur 17 Milliarden aktive Parameter pro Token und ein massives Kontextfenster von 10 Millionen Token. Es läuft mit Quantisierung auf einer einzigen H100-GPU. Llama 4 Maverick ist das Arbeitspferd mit 400 Milliarden Parametern (17 Milliarden aktiv, 128 Experten) und konkurriert direkt mit GPT-4o und Gemini 2.0 Flash. Llama 4 Behemoth schließlich ist ein 2-Billionen-Parameter-Modell, das noch im Training ist und als „Lehrer“ für die kleineren Varianten dient.

Ein wichtiger Fortschritt: Llama 4 nutzt eine „Early Fusion“-Architektur, bei der Text und Bild von Anfang an gemeinsam verarbeitet werden. Das führt zu einem deutlich tieferen Verständnis visueller Inhalte als bei früheren Versionen.

Der Haken für europäische Nutzer: Die multimodalen Varianten sind in der EU gesperrt.

Mistral AI – Europas souveräne Alternative

Das französische Unternehmen Mistral AI hat sich als dritte Säule im offenen Ökosystem etabliert und peilt für 2026 einen Umsatz von über 1 Milliarde Euro an.

Mistrals Ansatz ist hybrid. Kleinere Modelle wie Mistral Small und Ministral stehen unter freien Lizenzen (Apache 2.0). Das Spitzenmodell Mistral Large 3 wird primär über APIs und Partner wie Microsoft Azure vertrieben, ist aber auch als Open Weights für Forschung und On-Premise-Nutzung verfügbar.

Die eigentliche Stärke von Mistral liegt im Timing: Während Meta und DeepSeek in der EU regulatorische Probleme haben, vermarktet sich Mistral aggressiv als DSGVO-konforme, souveräne Alternative. Partnerschaften mit dem öffentlichen Sektor und die Zusage, europäische Werte zu respektieren, machen das Unternehmen zum bevorzugten Partner für Regierungen und Banken auf dem Kontinent.

Technologie: Warum offene Modelle so schnell aufholen

Der Leistungssprung der offenen Modelle ist kein Zufall. 2026 markiert den technologischen Abschied von der dichten, monolithischen Transformer-Architektur, die seit 2017 dominiert hatte. Stattdessen regieren effiziente Architekturen.

Mixture-of-Experts (MoE) erklärt

Sowohl Llama 4 als auch DeepSeek V3 basieren auf dem Mixture-of-Experts-Prinzip. Die Idee ist bestechend einfach: Anstatt bei jeder Anfrage das gesamte neuronale Netz zu aktivieren, leitet ein „Router“ die Eingabe an spezialisierte Experten-Netzwerke weiter.

Ein konkretes Beispiel: Llama 4 Maverick besitzt 400 Milliarden Parameter – das ist das gespeicherte „Wissen“. Pro Token werden aber nur 17 Milliarden aktiviert – das ist der tatsächliche „Rechenaufwand“. Damit entkoppelst du die Speicherkapazität eines Modells von seinen Ausführungskosten. Du bekommst ein riesiges Modell zum Preis eines kleinen.

DeepSeek geht noch weiter und nutzt eine extrem feingranulare Expertenstruktur mit bis zu 256 Experten bei V3.2-Exp. Das ermöglicht eine noch präzisere Spezialisierung für unterschiedliche Aufgabentypen.

Sparse Attention und hybride Architekturen

Das zweite große Problem klassischer Transformer: Die Aufmerksamkeitsschicht skaliert quadratisch mit der Kontextlänge. Doppelt so langer Text bedeutet vierfachen Rechenaufwand. Bei Kontextfenstern von Millionen Token wird das unbezahlbar.

Die Lösung kommt aus zwei Richtungen. DeepSeek Sparse Attention (DSA) reduziert die Komplexität der Aufmerksamkeitsschicht drastisch, ohne die Leistung bei langen Texten zu beeinträchtigen. IBMs Granite 4.0 geht einen anderen Weg und kombiniert Mamba-Schichten (die linear skalieren) mit Transformer-Schichten. Mamba übernimmt die Verarbeitung großer Informationsmengen, Transformer kommen nur für die kritische Entscheidungsfindung zum Einsatz. Das reduziert den Speicherbedarf um bis zu 70 %.

Das Ergebnis: Hochleistungs-KI wird nicht mehr durch immer größere Modelle erreicht, sondern durch intelligentere Architekturen. Effizienz schlägt Skalierung.

Sicherheit und Zensur: Wer kontrolliert die KI?

Sicherheit ist das Lieblingsargument der Closed-Source-Befürworter. Souveränität ist die Waffe der Open-Source-Verfechter. Beide Seiten haben einen Punkt – und beide haben blinde Flecken.

Closed Source: Sicherheit durch Verschlossenheit

OpenAI veröffentlicht detaillierte „System Cards“ für GPT-5.2, die zeigen, wie das Modell gegen Angriffe gehärtet wurde. Die Strategie setzt auf zentrale Filterung: Problematische Ausgaben werden serverseitig abgefangen, bevor sie den Nutzer erreichen.

Das Problem: „Security through Obscurity“ funktioniert nur so lange, wie niemand die Schutzmaßnahmen umgeht. Unabhängige Tests zeigen, dass auch GPT-5.2 anfällig für komplexe „Hydra“-Angriffe ist – Multi-Turn-Jailbreaks, die das Modell über mehrere Gesprächsrunden hinweg manipulieren. Die Erfolgsrate ist geringer als bei Vorgängern, aber nicht null.

Open Weights: Das DeepSeek-Zensur-Paradoxon

DeepSeek illustriert ein Phänomen, das 2026 für Unbehagen sorgt: ein technisch offenes Modell, das ideologisch eingeschränkt ist.

Durch die Integration von Zensurmechanismen direkt in den Trainingsprozess exportiert DeepSeek de facto chinesische Normen in den globalen Markt. Die Nutzungsbedingungen wälzen die Haftung für „Missbrauch“ auf den Nutzer ab. Das stellt den westlichen Begriff von „Open Source“ als Instrument der Freiheit grundlegend in Frage.

Andererseits: Weil die Gewichte offen sind, kann die Community die Zensurmechanismen theoretisch entfernen und das Modell neu ausrichten. Bei einem geschlossenen Modell hast du diese Option nicht. Du bekommst, was der Anbieter dir gibt.

Jailbreaks und System Cards

Die Sicherheitsdebatte zeigt 2026 eine unbequeme Wahrheit: Kein Ansatz ist perfekt. Geschlossene Modelle bieten mehr Kontrolle, aber weniger Transparenz. Offene Modelle bieten mehr Transparenz, aber weniger Kontrolle. Für stark regulierte Branchen wie Finanzwesen und Gesundheit spricht das aktuell eher für geschlossene Anbieter mit klaren Verantwortlichkeiten. Für Forschung und souveräne Anwendungen dagegen für offene Modelle, bei denen du selbst bestimmst, was gefiltert wird und was nicht.

Regulierung: Der EU AI Act als Gamechanger

Die vielleicht folgenreichste Entwicklung im Januar 2026 ist nicht technischer Natur, sondern regulatorisch. Der EU AI Act fragmentiert den globalen KI-Markt – mit Konsequenzen, die viele unterschätzt haben.

Warum Llama 4 in Europa gesperrt ist

Meta hat entschieden, die multimodalen Varianten von Llama 4 in der EU nicht zu veröffentlichen. Der offizielle Grund: die „unvorhersehbare regulatorische Umgebung“. Konkret geht es um das Zusammenspiel von DSGVO (welche Daten dürfen für Training genutzt werden?) und den Transparenzpflichten des AI Act.

Die Konsequenz ist drastisch: Europäische Unternehmen und Forscher sind vom Zugang zu den fortschrittlichsten offenen multimodalen Modellen abgeschnitten – es sei denn, sie operieren außerhalb der EU. In Foren ist bereits von „AI Geofencing“ die Rede. Lizenzen enthalten Klauseln, die die Nutzung verbieten, wenn du in der EU ansässig bist.

Wie Mistral von der Regulierung profitiert

Was für Meta ein Hindernis ist, wird für Mistral zur Chance. Das französische Unternehmen positioniert sich als die DSGVO-konforme Alternative und schließt Partnerschaften mit europäischen Regierungen und Banken. Wer in Europa KI einsetzen will, ohne regulatorische Risiken einzugehen, landet fast zwangsläufig bei Mistral.

Diese Isolation stärkt lokale Anbieter – schafft aber gleichzeitig einen massiven Wettbewerbsnachteil für den Standort Europa insgesamt. Europäische Entwickler arbeiten mit einem eingeschränkteren Werkzeugkasten als ihre Kollegen in den USA oder Asien.

US-China-Konflikt und die Zukunft offener Modelle

Der Erfolg von DeepSeek hat in den USA eine Grundsatzdebatte ausgelöst: Sollten Open Weights als Export von Waffentechnologie betrachtet werden? Stimmen mehren sich, die eine staatliche Kontrolle über die Veröffentlichung leistungsfähiger Modelle fordern. Das Ziel: verhindern, dass strategische Rivalen von US-Innovationen profitieren – oder dass chinesische Modelle die westliche Infrastruktur dominieren.

Das Paradoxe daran: Die gleiche Offenheit, die den technologischen Fortschritt beschleunigt, wird zum geopolitischen Risiko. 2026 steht die Branche vor der Frage, ob technologische Offenheit und nationale Sicherheit vereinbar sind – oder ob einer von beiden Werten weichen muss.

Welches Modell für welchen Einsatz?

Nach all der Analyse – was bedeutet das praktisch? Hier eine Orientierungshilfe für die Entscheidung.

Closed Source wählen, wenn …

Du brauchst absolute Spitzenleistung bei Reasoning, Mathematik oder wissenschaftlichen Fragestellungen. Du willst ein tief integriertes Ökosystem nutzen (z. B. Gemini in Google Workspace). Du operierst in einer stark regulierten Branche und brauchst klare Verantwortlichkeiten und SLAs. Du hast keine eigene Infrastruktur und willst schnell produktiv sein.

Open Weights wählen, wenn …

Datenschutz oberste Priorität hat und keine Daten das eigene Netzwerk verlassen dürfen. Du hohes Anfragevolumen hast und die API-Kosten nicht skalieren. Du das Modell anpassen willst – Fine-Tuning, eigene Sicherheitsfilter, domänenspezifisches Training. Du Unabhängigkeit von einzelnen Anbietern und deren Preispolitik brauchst.

In der Praxis scheitert die Modellwahl oft an einem simplen Punkt: Du brauchst ein gemeinsames Vokabular im Team, sonst redet jeder aneinander vorbei („Open Source“, „Open Weights“, „Agent“, „RAG“). Das KI-Glossar mit den wichtigsten Begriffen ist dafür Gold wert, weil es Diskussionen verkürzt und Entscheidungen schneller belastbar macht. (

Die hybride Strategie für Unternehmen

Die meisten Unternehmen fahren 2026 zweigleisig. Ein typisches Setup sieht so aus: Open-Weights-Modelle wie Llama 4 Maverick oder Mistral Large 3 übernehmen die Masse der Anfragen – Textgenerierung, Zusammenfassungen, Kundensupport, einfache Codeunterstützung. Für komplexe Aufgaben, die echtes Reasoning erfordern, wird auf GPT-5.2 Thinking oder Claude Opus 4.5 zurückgegriffen.

Dieses Routing-Modell senkt die Kosten drastisch und hält gleichzeitig die Qualität bei anspruchsvollen Aufgaben hoch. Die Infrastruktur dafür ist 2026 ausgereift – mehrere Orchestrierungstools ermöglichen es, Anfragen dynamisch an das passende Modell weiterzuleiten.

Fazit: Effizienz schlägt Skalierung

Im Januar 2026 ist die einfache Unterscheidung zwischen „Gut“ (Open Source) und „Böse“ (Closed Source) Geschichte. Die KI-Welt ist komplexer geworden – und ehrlicher.

Technologisch erleben wir eine Demokratisierung. Hocheffiziente Modelle wie DeepSeek V3.2 und Llama 4 bringen Spitzenleistung auf einzelne GPUs. Die Mixture-of-Experts-Architektur und Sparse Attention haben das Narrativ „Nur Milliarden-Budgets bringen Ergebnisse“ widerlegt.

Geopolitisch erleben wir eine Fragmentierung. Der Zugang zu Modellen hängt zunehmend von nationalen Grenzen und regulatorischen Blöcken ab. Der EU AI Act schließt europäische Nutzer von Teilen des offenen Ökosystems aus. US-Exportkontrollen könnten dasselbe in die andere Richtung bewirken.

Für Unternehmen gibt es drei Lehren aus dem Januar 2026: Hybride Strategien sind Pflicht – proprietäre Modelle für die Reasoning-Spitze, offene Modelle für die Masse der Inferenz. Souveränität hat einen Preis – wer in Europa KI betreiben will, muss entweder auf bestimmte US-Technologien verzichten oder auf lokale Champions setzen. Und die wichtigste Erkenntnis: Effizienz schlägt Skalierung. Der Trend geht weg von immer größeren Modellen hin zu intelligenten Architekturen, die ökonomisch nachhaltig sind.

Der Kampf zwischen offen und geschlossen ist nicht vorbei. Er hat sich nur in etwas Komplexeres verwandelt – und das ist vielleicht das Reifste, was dieser Branche passieren konnte.

FAQ

Ist Llama 4 wirklich Open Source?

Streng genommen nein. Llama 4 ist „Open Weights“ – du kannst die Modellgewichte herunterladen und lokal betreiben. Aber die Trainingsdaten bleiben geheim, und die Community License schränkt die Nutzung ein: Ab 700 Millionen monatlichen Nutzern brauchst du eine Sonderlizenz, und die multimodalen Varianten sind in der EU komplett gesperrt. Nach der Definition der Open Source Initiative (OSI) erfüllt Llama 4 die Anforderungen an echte Open-Source-KI nicht.

Sind offene KI-Modelle unsicherer als geschlossene?

Nicht pauschal. Geschlossene Modelle bieten zentrale Sicherheitsfilter und gehärtete Systeme, sind aber anfällig für „Security through Obscurity“ – wenn die Schutzmaßnahmen umgangen werden, hat der Nutzer keine Kontrolle. Offene Modelle bieten volle Transparenz und die Möglichkeit, eigene Sicherheitsmechanismen zu implementieren, erfordern dafür aber technisches Know-how. Beide Ansätze haben Schwächen: Auch GPT-5.2 ist anfällig für komplexe Jailbreaks, und offene Modelle wie DeepSeek können ideologische Einschränkungen aus dem Trainingsprozess mitbringen.

Kann ich Open-Weights-Modelle in der EU nutzen?

Grundsätzlich ja – aber mit Einschränkungen. Viele Open-Weights-Modelle wie Mistral Large 3, IBM Granite 4.0 oder Falcon 3 sind in der EU verfügbar und nutzbar. Die multimodalen Varianten von Meta Llama 4 sind allerdings für EU-Nutzer gesperrt. Der Grund ist die regulatorische Unsicherheit durch den EU AI Act in Kombination mit der DSGVO. Mistral AI positioniert sich als DSGVO-konforme Alternative für den europäischen Markt.

Was ist der Unterschied zwischen Open Weights und Open Science?

Open Weights bedeutet, dass du die Modellgewichte und den Inferenzcode herunterladen und nutzen kannst. Die Trainingsdaten und der vollständige Trainingsprozess bleiben aber geheim. Open Science geht deutlich weiter: Hier werden auch Trainingsdaten, Trainings-Logs und der gesamte Code offengelegt, sodass das Modell vollständig reproduzierbar ist. Beispiele für Open Science sind akademische Projekte wie OLMo 2. Die meisten kommerziellen „offenen“ Modelle sind Open Weights, nicht Open Science.

Lohnt sich lokale Inferenz für kleine Unternehmen?

Es kommt auf dein Anfragevolumen und deine Datenschutzanforderungen an. Modelle wie Llama 4 Scout laufen mit Quantisierung auf einer einzigen H100-GPU. Wenn du täglich tausende Anfragen verarbeitest, amortisiert sich die Hardware schnell gegenüber laufenden API-Gebühren. Auch bei sensiblen Daten, die das Unternehmen nicht verlassen dürfen, lohnt sich der lokale Betrieb. Für gelegentliche Nutzung mit wenigen hundert Anfragen pro Tag ist eine API-Lösung dagegen oft wirtschaftlicher und einfacher zu betreiben.

Quellen und weitere Infos: