Bilder per Textbefehl generieren, eigene Stile trainieren, ganze Produktions-Pipelines automatisieren – und das alles lokal auf dem eigenen Rechner? Stable Diffusion hat genau das möglich gemacht. Seit dem ersten Release 2022 hat sich das Ökosystem allerdings grundlegend verändert: Neue Architekturen, neue Anbieter und ein ganzer Zoo an Modellen machen den Überblick schwieriger denn je.

Dieser Artikel ist dein zentraler Anlaufpunkt. Du erfährst, wie die Technik funktioniert, welche Modelle es im Januar 2026 gibt, welche Hardware du brauchst – und worauf du bei Lizenzen achten musst.

Steckbrief: Stable Diffusion

| Merkmal | Details |

|---|---|

| Entwickler | Stability AI (SD-Serie), Black Forest Labs (FLUX-Serie), Tencent (Hunyuan) |

| Aktuelle Versionen | Stable Diffusion 3.5, FLUX.2, Hunyuan Image 3.0 |

| Architektur | Diffusion Transformer (DiT) / Flow Matching (löst U-Net ab) |

| Lizenz | Modellabhängig: Apache 2.0, Community License oder Non-Commercial |

| Preis | Basismodelle kostenlos (Open Weights), API-Nutzung ab ~$0,025/Megapixel |

| Plattformen | Windows, macOS, Linux, iOS, Android, Cloud-APIs |

| Zielgruppe | Kreative, Entwickler, Studios, Agenturen, Hobbyisten |

Für wen ist Stable Diffusion geeignet?

Stable Diffusion und seine Nachfolger richten sich an sehr unterschiedliche Nutzergruppen:

Hobbyisten und Kreative, die ohne Abo-Gebühren mit Bildgenerierung experimentieren wollen. Du brauchst nur eine halbwegs aktuelle Nvidia-GPU – oder nutzt kostenlose Web-Plattformen.

Illustratoren und Concept Artists, die KI als Werkzeug in ihren bestehenden Workflow einbinden. Über das Krita AI Diffusion Plugin lässt sich Stable Diffusion direkt auf der digitalen Leinwand nutzen.

App-Entwickler und Startups, die Bildgenerierung in eigene Produkte integrieren möchten. Modelle wie FLUX.2 klein 4B stehen unter Apache 2.0 – vollständig kommerziell nutzbar, ohne Lizenzgebühren.

Agenturen und Studios, die Produktfotografie, Texturierung oder Asset-Pipelines automatisieren wollen. Hier kommen die großen Modelle mit ControlNet und Multi-Reference-Funktionen zum Einsatz.

Forschende, die an der Weiterentwicklung generativer Modelle arbeiten. Offene Gewichte und veröffentlichte Architekturen machen Experimente möglich, die bei proprietären Diensten ausgeschlossen sind.

Preise & Versionen

Kostenlose Open-Source-Modelle

Die Basismodelle sind kostenlos herunterladbar. Du zahlst nur für Strom und Hardware. Modelle wie FLUX.2 klein 4B (Apache 2.0), SD 3.5 Medium und SDXL lassen sich lokal betreiben, ohne dass laufende Gebühren anfallen.

API-Dienste und Cloud-Nutzung

Wer keine leistungsstarke GPU besitzt, nutzt Cloud-Dienste:

| Dienst | Modell | Kosten (ca.) |

|---|---|---|

| Fal.ai / Replicate | FLUX.2 Dev | ~$0,025 pro Megapixel |

| RunPod | RTX 4090 (Cloud-GPU) | ~$0,34 pro Stunde |

| Civitai / Tensor.art | Diverse Modelle | Teils kostenlos (mit Limits) |

Die Preise sind 2026 deutlich gefallen. Für gelegentliche Nutzung kostet ein Bild oft nur Bruchteile eines Cents.

API-Nutzung wird schnell teuer, wenn du viele Bilder generierst. Unser Leitfaden zu den besten KI-APIs nach Preis-Leistung hilft dir, Megapixel-Preise, Serverless-Optionen und Skalierungsmodelle nüchtern zu vergleichen – ideal für Startups und Agenturen.

Enterprise-Lizenzen

Für Unternehmen mit mehr als 1 Mio. USD Jahresumsatz bieten Stability AI und Black Forest Labs kostenpflichtige Enterprise-Lizenzen an. Die genauen Konditionen werden individuell verhandelt.

Was ist Stable Diffusion? So funktioniert die Technik dahinter

Der Begriff „Stable Diffusion“ wird heute oft als Sammelbegriff für offene Bildgenerierungsmodelle verwendet. Technisch bezeichnet er eine bestimmte Klasse von Modellen: Latent Diffusion Models (LDMs).

Latent Diffusion Models (LDMs) kurz erklärt

Ältere Ansätze arbeiteten direkt auf der Pixelebene – rechenintensiv und bei hohen Auflösungen kaum praktikabel. Stable Diffusion löst das, indem es in einem komprimierten „Latenten Raum“ arbeitet. Der Prozess hat drei Hauptkomponenten:

Variational Autoencoder (VAE): Komprimiert Bilder in eine kleinere Darstellung und übersetzt das Ergebnis am Ende wieder zurück in sichtbare Pixel.

Diffusionsprozess: Das Herzstück. Das Modell lernt, schrittweise Rauschen aus einem Bild zu entfernen – gesteuert durch deinen Textprompt. In frühen Versionen (SD 1.5, SDXL) übernahm ein U-Net diese Aufgabe.

Text-Konditionierung (CLIP / T5): Dein Textprompt wird durch Encoder wie CLIP oder T5 in Zahlenvektoren umgewandelt. Diese Vektoren sagen dem Modell, was es generieren soll.

Von U-Net zu Transformer: Der Paradigmenwechsel 2025/2026

Bis 2024 basierten alle Stable-Diffusion-Versionen auf der U-Net-Architektur. Diese stieß bei der Skalierung an Grenzen: Größere Modelle brachten keine proportionalen Qualitätssteigerungen mehr.

2025 vollzog die Branche einen radikalen Wechsel zu Diffusion Transformern (DiT). Inspiriert durch den Erfolg großer Sprachmodelle ersetzen aktuelle Modelle wie SD 3.5, FLUX.2 und Hunyuan das U-Net durch eine Transformer-Architektur. Transformer skalieren deutlich besser mit mehr Daten und Parametern – ein 32-Milliarden-Parameter-Modell wie FLUX.2 Dev versteht Nuancen in Prompts, die einem U-Net verborgen blieben.

Der eigentliche Paradigmenwechsel 2025/2026 liegt in der Transformer-Architektur, und genau hier schafft unser Beitrag zur Transformer-Architektur verständlich erklärt Klarheit.

Flow Matching: Schnellere Ergebnisse mit weniger Rechenschritten

Black Forest Labs hat mit FLUX eine weitere Innovation eingeführt: Rectified Flow (Flow Matching). Klassische Diffusion simuliert einen gekrümmten, komplexen Pfad vom Rauschen zum fertigen Bild. Flow Matching „begradigt“ diesen Pfad. Das Ergebnis: schärfere Bilder bei weniger Rechenschritten – und damit schnellere Generierung.

Die wichtigsten Modelle im Überblick

Im Januar 2026 gibt es nicht mehr „das eine“ Modell. Stattdessen existieren spezialisierte Werkzeuge für unterschiedliche Hardware- und Lizenzanforderungen.

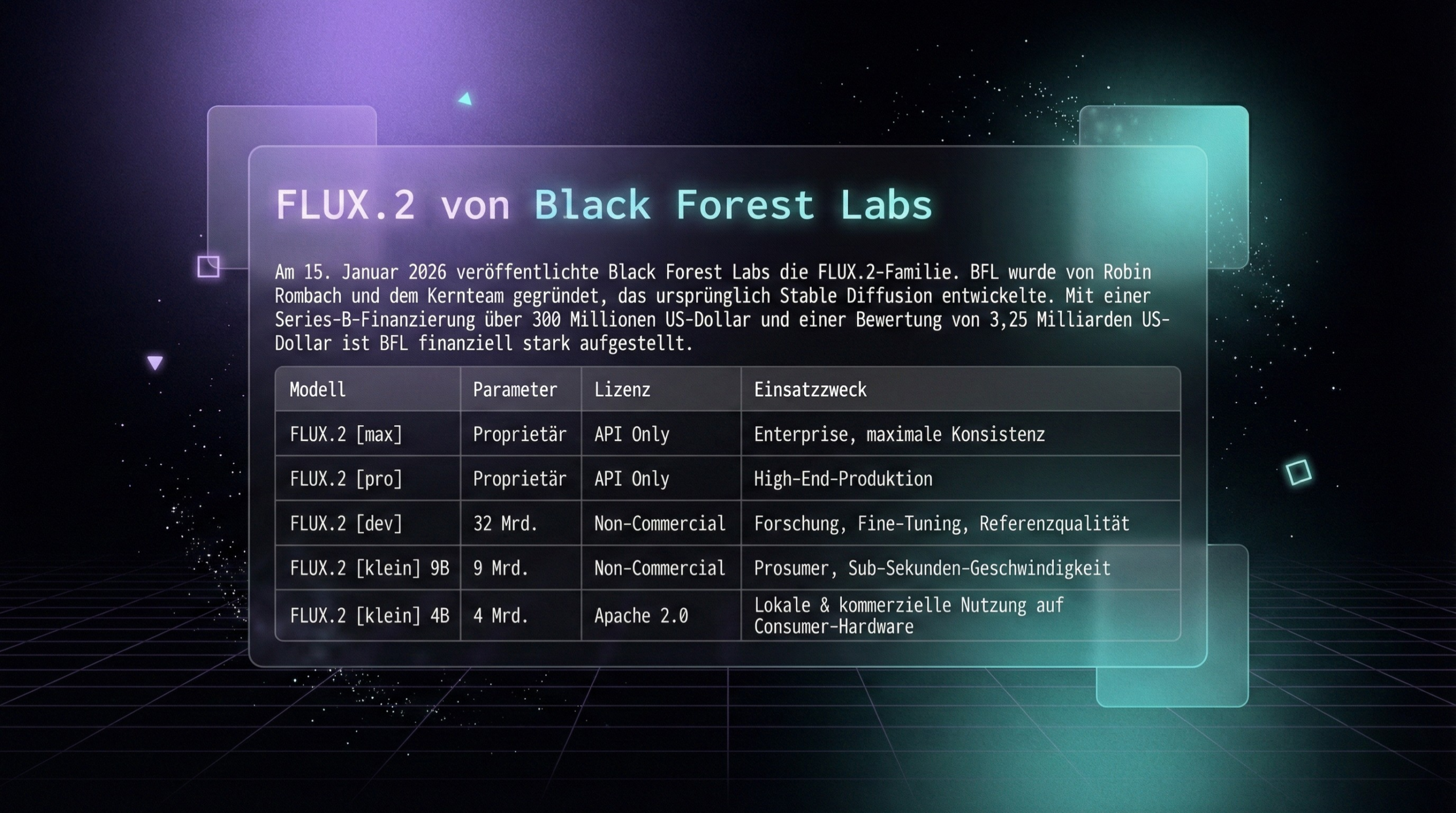

FLUX.2 von Black Forest Labs

Am 15. Januar 2026 veröffentlichte Black Forest Labs die FLUX.2-Familie. BFL wurde von Robin Rombach und dem Kernteam gegründet, das ursprünglich Stable Diffusion entwickelte. Mit einer Series-B-Finanzierung über 300 Millionen US-Dollar und einer Bewertung von 3,25 Milliarden US-Dollar ist BFL finanziell stark aufgestellt.

| Modell | Parameter | Lizenz | Einsatzzweck |

|---|---|---|---|

| FLUX.2 [max] | Proprietär | API Only | Enterprise, maximale Konsistenz |

| FLUX.2 [pro] | Proprietär | API Only | High-End-Produktion |

| FLUX.2 [dev] | 32 Mrd. | Non-Commercial | Forschung, Fine-Tuning, Referenzqualität |

| FLUX.2 [klein] 9B | 9 Mrd. | Non-Commercial | Prosumer, Sub-Sekunden-Geschwindigkeit |

| FLUX.2 [klein] 4B | 4 Mrd. | Apache 2.0 | Lokale & kommerzielle Nutzung auf Consumer-Hardware |

Die technischen Highlights: FLUX.2 integriert Inpainting und Image-to-Image direkt in die Architektur. Multi-Reference-Control ermöglicht es, bis zu vier Referenzbilder zu kombinieren. Und mit JSON-Prompting lassen sich Szenen über strukturierte Daten statt natürlicher Sprache definieren – ein großer Vorteil für die professionelle Produktion.

Stable Diffusion 3.5 von Stability AI

Stability AI bietet mit SD 3.5 eine solide Alternative. Die Architektur basiert auf einem Multimodal Diffusion Transformer (MMDiT), bei dem Text- und Bildinformationen durch separate Gewichtungsstränge verarbeitet werden.

SD 3.5 Large (8B): Das Flaggschiff mit exzellenter Prompt-Adhärenz. Die Community License erlaubt kommerzielle Nutzung bis 1 Mio. USD Umsatz – ein entscheidender Vorteil gegenüber dem nicht-kommerziellen FLUX.2 Dev.

SD 3.5 Medium (2.5B): Strategisch wichtig für Nutzer mit Standard-Hardware. Das Modell läuft auf GPUs mit 10–12 GB VRAM ohne aufwendige Quantisierung.

Hunyuan Image 3.0 von Tencent

Tencent hat mit Hunyuan Image 3.0 das größte Open-Source-Bildgenerierungsmodell veröffentlicht: 80 Milliarden Parameter, basierend auf einer Mixture-of-Experts-Architektur.

Die Qualität bei komplexen Szenen mit vielen Objekten ist beeindruckend. Im Januar 2026 erschienen spezialisierte Versionen: Instruct für bildbasierte Bearbeitung und Distil für schnellere Inferenz.

Der Haken: Ohne Multi-GPU-Setup oder extremes Disk-Offloading ist das Modell lokal kaum nutzbar. Für Hobbyisten bleibt es vorerst außer Reichweite.

SDXL und Pony Diffusion: Warum Legacy-Modelle noch relevant sind

Trotz der neuen Transformer-Modelle hat SDXL (U-Net-basiert) nach wie vor seine Berechtigung. Insbesondere das Derivat Pony Diffusion V6 XL dominiert in Nischen-Communities für Anime und stilisierte Kunst. Der Grund: ein riesiges Ökosystem an existierenden LoRAs und deutlich geringere Hardwareanforderungen.

Stable Diffusion nutzen: Einstieg und Workflows

Die Nutzung hat sich von einfachen Text-Prompts zu komplexen, modularen Workflows entwickelt.

Lokal vs. Cloud – was passt zu dir?

Lokale Nutzung bietet maximale Privatsphäre, keine laufenden Kosten und volle Kontrolle. Du brauchst allerdings eine Nvidia-GPU mit ausreichend VRAM. Tools wie ComfyUI, Forge oder SwarmUI machen die Einrichtung einfacher als noch vor zwei Jahren.

Cloud-Dienste sind ideal, wenn du keine leistungsstarke GPU besitzt oder flexibel skalieren willst. Fal.ai, Replicate und RunPod bieten APIs an, um FLUX.2 oder SD 3.5 per Abruf zu nutzen.

ComfyUI: Der Standard für Power-User

ComfyUI ist 2026 das De-facto-Standard-Interface für Enthusiasten und Profis. Das node-basierte System (ähnlich wie Blender Nodes) erlaubt es, Module zu verketten: Checkpoint laden → Text encodieren → Sampling → VAE Decode.

Der größte Vorteil: Neue Modelle wie FLUX.2 oder Hunyuan werden oft innerhalb von Stunden nach Release durch die Community integriert. Für das 80B-Modell von Hunyuan nutzt ComfyUI spezielle Disk-Offloading-Techniken, um Gewichte dynamisch zwischen RAM, SSD und VRAM zu verschieben.

Sobald du verstehen willst, warum Diffusion Transformer klassische U-Nets ablösen, hilft dir die technische Einordnung in unserem Grundlagenartikel zu Diffusion Models – die Technik hinter Midjourney und DALL·E.

WebUI Forge: Die einfache Alternative

Forge ist der Nachfolger von Automatic1111 und die Empfehlung für alle, die „einfach nur Bilder generieren“ wollen, ohne Nodes zu verkabeln. Es nutzt die vertraute A1111-Oberfläche, aber ein optimiertes Backend – bis zu 75 % schneller als A1111 bei FLUX-Inferenz.

SwarmUI und weitere Tools

SwarmUI (entwickelt von Stability AI) verbindet die Power von ComfyUI mit einer zugänglicheren Oberfläche und unterstützt Cluster-Generierung über mehrere GPUs im Netzwerk.

Krita mit AI Diffusion Plugin: Für Künstler

Für Illustratoren ist die Integration in Malprogramme entscheidend. Das Krita AI Diffusion Plugin erlaubt es, FLUX oder SDXL direkt auf der digitalen Leinwand zu nutzen – Inpainting, Live-Sketch-to-Image, nahtlos im Workflow.

Mobile Nutzung (iOS & Android)

Dank Apple Silicon und Snapdragon NPUs funktioniert lokale Bildgenerierung inzwischen auch auf Mobilgeräten:

Draw Things (iOS/macOS): Die führende App im Apple-Ökosystem. Sie unterstützt FLUX.2 (quantisiert auf 4-bit oder 8-bit) und nutzt die Metal-Schnittstelle effizient.

Local Diffusion (Android): Nutzt stable-diffusion.cpp für die Ausführung auf Android. Die Performance hängt stark vom NPU-Support des Chipsatzes ab.

Hardware-Anforderungen

2026 sind die Anforderungen zweigeteilt: Einsteigermodelle werden effizienter, Spitzenmodelle verlangen mehr denn je.

Wie viel VRAM brauchst du wirklich?

VRAM ist der limitierende Faktor. Hier eine Übersicht:

| Modell-Klasse | Beispiel | Min. VRAM (quantisiert) | Empfohlen (nativ) | GPU-Beispiele |

|---|---|---|---|---|

| High-End | FLUX.2 Dev (32B) | 24 GB (FP8/NF4) | > 64 GB | RTX 4090/5090, A6000 |

| Enterprise | Hunyuan 3.0 (80B) | 24–48 GB (Offload) | > 160 GB | Multi-GPU, H100 Cluster |

| Performance | FLUX.2 klein 9B | 8–12 GB (GGUF) | 20 GB | RTX 4070 Ti, RTX 4080 |

| Mainstream | SD 3.5 Medium / FLUX 4B | 6–8 GB | 12 GB | RTX 3060 (12 GB), RTX 4060 Ti |

| Legacy | SDXL / Pony | 4–6 GB | 8 GB | RTX 3050, GTX 1070 |

Quantisierung: Große Modelle auf kleinen GPUs

Ohne Quantisierung wären Modelle wie FLUX.2 Dev für die meisten Nutzer unerreichbar.

FP8 (8-bit): Der Standard 2026. Reduziert den Speicherbedarf um rund 50 % bei minimalem Qualitätsverlust. Wird nativ von RTX 40er und 50er Serien unterstützt.

NF4 / GGUF (4-bit): Ursprünglich für Sprachmodelle entwickelt, erlauben diese Formate das Ausführen von 32B-Modellen auf 16-GB- oder sogar 12-GB-Karten. Die Qualität sinkt sichtbar, reicht aber für Hobby-Anwendungen.

NVFP4: Eine neue Kooperation zwischen Nvidia und BFL. Speziell auf Blackwell-GPUs (RTX 50er Serie) bis zu 2,7x schneller.

Cloud-GPUs als Alternative

Wer keine 24-GB-Karte besitzt, fährt mit Cloud-Computing oft günstiger. Eine RTX 4090 bei RunPod kostet rund $0,34 pro Stunde – ideal für längere Sessions oder Training. Serverless-Dienste wie Fal.ai sind besser für sporadische Nutzung oder API-Integration geeignet.

Wichtige Features und Techniken

ControlNet Union Pro 2.0

Das klassische ControlNet brauchte ein separates Modell pro Aufgabe (Canny, Depth, Pose). Im Januar 2026 dominiert ControlNet Union Pro 2.0: ein einziges Modell beherrscht alle Kontrollarten. Trainiert auf 20 Millionen Bildern, liefert es präzise Kontrolle über die Bildkomposition – unverzichtbar für Agenturen, die exakte Layouts einhalten müssen.

Inpainting: Native Funktionen in FLUX.2

Während SDXL noch auf separate Inpainting-Modelle angewiesen war, integriert FLUX.2 Dev Inpainting direkt in das Basismodell. Spezialisierte Flux-Fill-Modelle liefern State-of-the-Art-Ergebnisse beim Entfernen oder Hinzufügen von Objekten – selbst bei komplexen Hintergründen.

LoRA-Training: Eigene Stile und Charaktere erstellen

Eigene Stil- oder Charakter-Modelle trainieren ist 2026 einfacher denn je:

Ostris AI Toolkit ermöglicht FLUX-Training auf GPUs mit 16 GB VRAM. Kohya_ss unterstützt „On-the-fly FP8 Scaling“ und senkt den Speicherbedarf beim Training massiv.

Ein Trend 2026 sind Slider-LoRAs: Statt einen Stil nur an- oder auszuschalten, regelst du Attribute wie Alter, Gewicht oder Chaos stufenlos per Slider.

Dank der starken Basismodelle reichen oft schon 10–15 Bilder, um einen Charakter fotorealistisch zu trainieren. Der Schlüssel ist die Qualität der Beschreibungen – Tools wie JoyCaption nutzen Vision-LLMs, um Trainingsbilder extrem detailliert zu beschreiben.

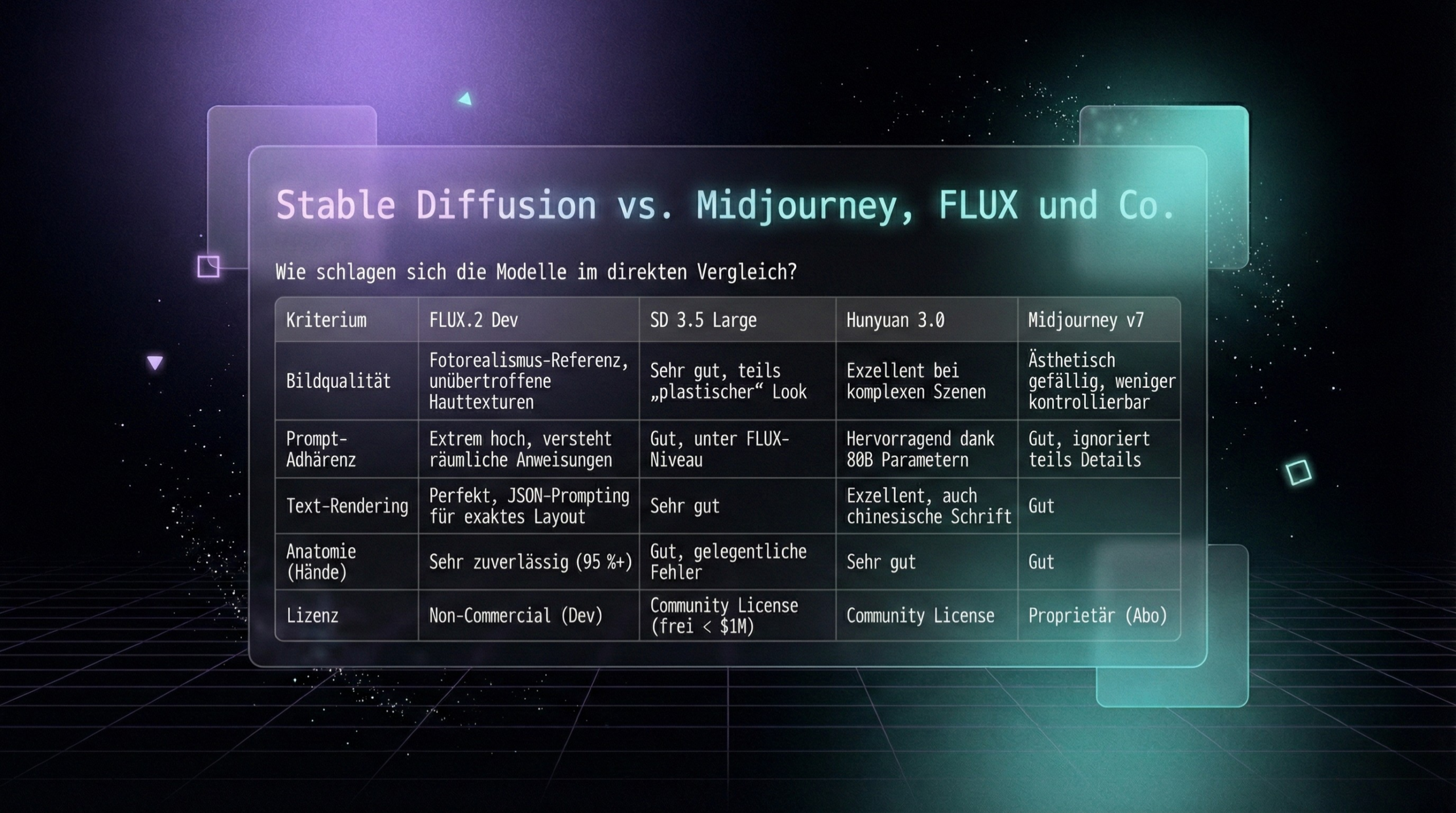

Stable Diffusion vs. Midjourney, FLUX und Co.

Wie schlagen sich die Modelle im direkten Vergleich?

| Kriterium | FLUX.2 Dev | SD 3.5 Large | Hunyuan 3.0 | Midjourney v7 |

|---|---|---|---|---|

| Bildqualität | Fotorealismus-Referenz, unübertroffene Hauttexturen | Sehr gut, teils „plastischer“ Look | Exzellent bei komplexen Szenen | Ästhetisch gefällig, weniger kontrollierbar |

| Prompt-Adhärenz | Extrem hoch, versteht räumliche Anweisungen | Gut, unter FLUX-Niveau | Hervorragend dank 80B Parametern | Gut, ignoriert teils Details |

| Text-Rendering | Perfekt, JSON-Prompting für exaktes Layout | Sehr gut | Exzellent, auch chinesische Schrift | Gut |

| Anatomie (Hände) | Sehr zuverlässig (95 %+) | Gut, gelegentliche Fehler | Sehr gut | Gut |

| Lizenz | Non-Commercial (Dev) | Community License (frei < $1M) | Community License | Proprietär (Abo) |

Kurzfassung: FLUX.2 Dev liefert die höchste Qualität, ist aber nicht kommerziell nutzbar. SD 3.5 Large ist der sichere Hafen für kommerzielle Startups. Hunyuan beeindruckt technisch, stellt aber extreme Hardwareanforderungen. Midjourney bleibt der einfachste Einstieg – allerdings ohne lokale Kontrolle.

Eine datenbasierte Entscheidung zwischen den großen Bildtools fällt leichter mit unserem Vergleich der KI-Bildgeneratoren Midjourney vs. OpenAI vs. Leonardo AI.

Kommerzielle Nutzung und Lizenzen

Die Lizenzierung ist 2026 der kritischste Aspekt für professionelle Anwender. Hier musst du genau hinschauen.

Apache 2.0: FLUX.2 klein 4B

FLUX.2 klein 4B steht unter der Apache-2.0-Lizenz. Das bedeutet: uneingeschränkt kommerziell nutzbar, modifizierbar, integrierbar – ohne Lizenzgebühren. Für App-Entwickler und Spiele-Studios ist das der Favorit.

Stability AI Community License

Für SD 3.5 Large gilt: kostenlos für Forschung und nicht-kommerzielle Nutzung. Kommerzielle Nutzung ist frei für Einzelpersonen und Firmen mit weniger als 1 Mio. USD Jahresumsatz. Darüber hinaus brauchst du eine Enterprise-Lizenz.

FLUX Non-Commercial License

FLUX.2 Dev (32B) ist strikt nicht-kommerziell. Keine Bilder für Kunden, keine Nutzung in monetarisierten Apps. Für kommerzielle Zwecke muss eine Lizenz bei BFL erworben werden. Cloud-Anbieter wie Fal.ai führen diese Gebühren oft im Hintergrund ab – prüfe aber immer die AGB deines Anbieters.

Rein strategisch betrachtet ist Stable Diffusion Teil eines größeren Open-Source-Trends. Wenn du abwägen willst, wann offene Gewichte sinnvoller sind als geschlossene APIs, hilft dir die Einordnung in Open Source vs. Closed Source KI.

Was bedeutet das Getty-Images-Urteil für die Branche?

Im Dezember 2025 erhielt Getty Images die Erlaubnis, gegen ein früheres Urteil Berufung einzulegen, das Stability AI in Teilen entlastet hatte. Die Kernfrage: Stellt das Training von KI-Modellen mit urheberrechtlich geschütztem Material ohne Lizenz eine Urheberrechtsverletzung dar?

Sollte Getty 2026 gewinnen, könnte das Geschäftsmodell von Stability AI und anderen Anbietern im UK und potenziell in der EU massiv gefährdet werden. Die Divergenz zur US-Rechtsprechung (Fair Use) würde den Markt fragmentieren. Für Nutzer bedeutet das: Die rechtliche Lage bleibt im Fluss – wer auf Nummer sicher gehen will, setzt auf Modelle mit klarer Lizenz und dokumentiertem Training.

Anwendungsfälle in der Praxis

Game Development: Asset-Pipelines

Spielestudios nutzen FLUX.2 und SD 3.5 längst nicht mehr nur für Konzeptkunst. Ein typischer Workflow: Ein Concept Artist skizziert ein Asset, FLUX.2 generiert per Image-to-Image Variationen, Hunyuan 3D erstellt daraus ein Mesh, Blender-Skripte bereinigen die Topologie. Auch PBR-Materialien (Physically Based Rendering) werden zunehmend generativ erstellt.

Marketing und Produktfotografie

Agenturen ersetzen physische Fotoshootings durch KI-gestützte Workflows. Mit FLUX.2 Multi-Reference lässt sich ein Produktfoto in einen neuen Stil übertragen, ohne dass das Produkt verzerrt wird. Die starke Text-Rendering-Fähigkeit von FLUX ermöglicht zudem Hyper-Personalisierung – etwa dynamisch generierte Bilder mit dem Namen des Betrachters.

Alternativen zu Stable Diffusion

- Midjourney – der ästhetischste Weg zur Bildgenerierung, aber proprietär und nur per Abo.

- DALL-E – Bildgenerierung von OpenAI, integriert in ChatGPT. Einfach, aber weniger kontrollierbar.

- Adobe Firefly – auf lizenzierte Trainingsdaten fokussiert. Sicher für kommerzielle Nutzung, aber eingeschränkt bei Fotorealismus.

Aktuelle Updates und Trends

Konvergenz von Bild und Video

Die Grenze zwischen Bild- und Videogenerierung verschwimmt. Modelle wie LTX-Video (Lightricks) und Hunyuan Video bauen direkt auf den Bildgeneratoren auf. Ein typischer Workflow: ein perfektes FLUX-Bild als Start-Frame für ein 5-Sekunden-Video.

Agentic AI: KI-Agenten steuern Workflows

Statt Nodes in ComfyUI manuell zu verbinden, sagt der Nutzer einem LLM-Agenten: „Baue mir einen Workflow für Inpainting mit ControlNet.“ Der Agent konfiguriert die Software automatisch. Das senkt die Einstiegshürde massiv.

3D-Generierung mit Hunyuan 3D

Mit Hunyuan 3D 3.0 ist die Generierung von 3D-Meshes aus Bildern so gut geworden, dass sie als Basis für Game-Assets taugt. Der Schritt vom „Blob“ zum strukturierten Mesh mit sauberen Texturen ist 2026 weitgehend vollzogen.

FAQ

Ist Stable Diffusion kostenlos? Ja – die Basismodelle (SD 3.5, FLUX.2 klein 4B, SDXL) sind kostenlos herunterladbar. Du zahlst nur für Hardware oder Cloud-Dienste.

Brauche ich eine Nvidia-GPU? Für die lokale Nutzung ist eine Nvidia-GPU mit mindestens 6–8 GB VRAM empfehlenswert. Auf Apple-Geräten funktioniert Draw Things. Alternativ nutzt du Cloud-Dienste ganz ohne eigene GPU.

Welches Modell soll ich als Anfänger nehmen? FLUX.2 klein 4B (GGUF oder NF4) über WebUI Forge. Es läuft auf den meisten aktuellen GPUs und ist kommerziell nutzbar.

Darf ich die generierten Bilder kommerziell nutzen? Kommt auf das Modell an. FLUX.2 klein 4B (Apache 2.0) und SD 3.5 Large (unter 1 Mio. USD Umsatz) erlauben kommerzielle Nutzung. FLUX.2 Dev ist strikt nicht-kommerziell.

Wie lange dauert die Generierung eines Bildes? Mit FLUX.2 klein auf einer RTX 4070: wenige Sekunden. FLUX.2 Dev (32B) auf einer RTX 4090: 10–30 Sekunden je nach Auflösung und Steps. Cloud-APIs liefern oft in unter 5 Sekunden.

Was ist besser – Stable Diffusion oder Midjourney? Midjourney ist einfacher zu bedienen und liefert ästhetisch konsistente Ergebnisse. Stable Diffusion und FLUX bieten dafür volle Kontrolle, lokale Nutzung und Anpassbarkeit. Für Profis, die eigene Modelle trainieren oder Workflows automatisieren wollen, führt kein Weg an Open Source vorbei.

Fazit + Nächste Schritte

Das Open-Source-Ökosystem für Bildgenerierung ist im Januar 2026 vielfältiger und leistungsfähiger als je zuvor. FLUX.2 hat die technologische Führung übernommen, SD 3.5 bleibt eine solide kommerzielle Option, und Hunyuan zeigt, was mit extremer Skalierung möglich ist.

Für deinen Einstieg:

Schnell testen: Nutze Draw Things (iOS) oder Web-Plattformen wie Civitai, um FLUX kostenlos auszuprobieren.

Mit eigener GPU starten: Installiere WebUI Forge und lade das FLUX.2 klein 4B Modell herunter.

Professionell arbeiten: Installiere ComfyUI, besorge dir einen API-Key bei Fal.ai für FLUX.2 Pro – oder investiere in eine RTX 4090/5090 für die lokale Nutzung von FLUX.2 Dev.

Die Technik entwickelt sich rasant weiter. Bleib dran – wir halten diesen Artikel aktuell.