Runway ist längst kein Experiment mehr. Was 2018 als Uni-Projekt an der New York University begann, hat sich zur wohl vollständigsten Plattform für KI-generierte Videos entwickelt. Egal ob Musikvideo, Werbespot oder Pre-Viz für einen Kinofilm – Runway steckt mittlerweile in erstaunlich vielen Produktions-Pipelines.

Aber was kann die Plattform im Januar 2026 konkret? Welches Modell brauchst du wofür? Und lohnt sich das Abo überhaupt? Dieser Artikel gibt dir den kompletten Überblick – von Funktionen und Preisen bis zu Praxis-Tipps und ehrlichen Limitierungen.

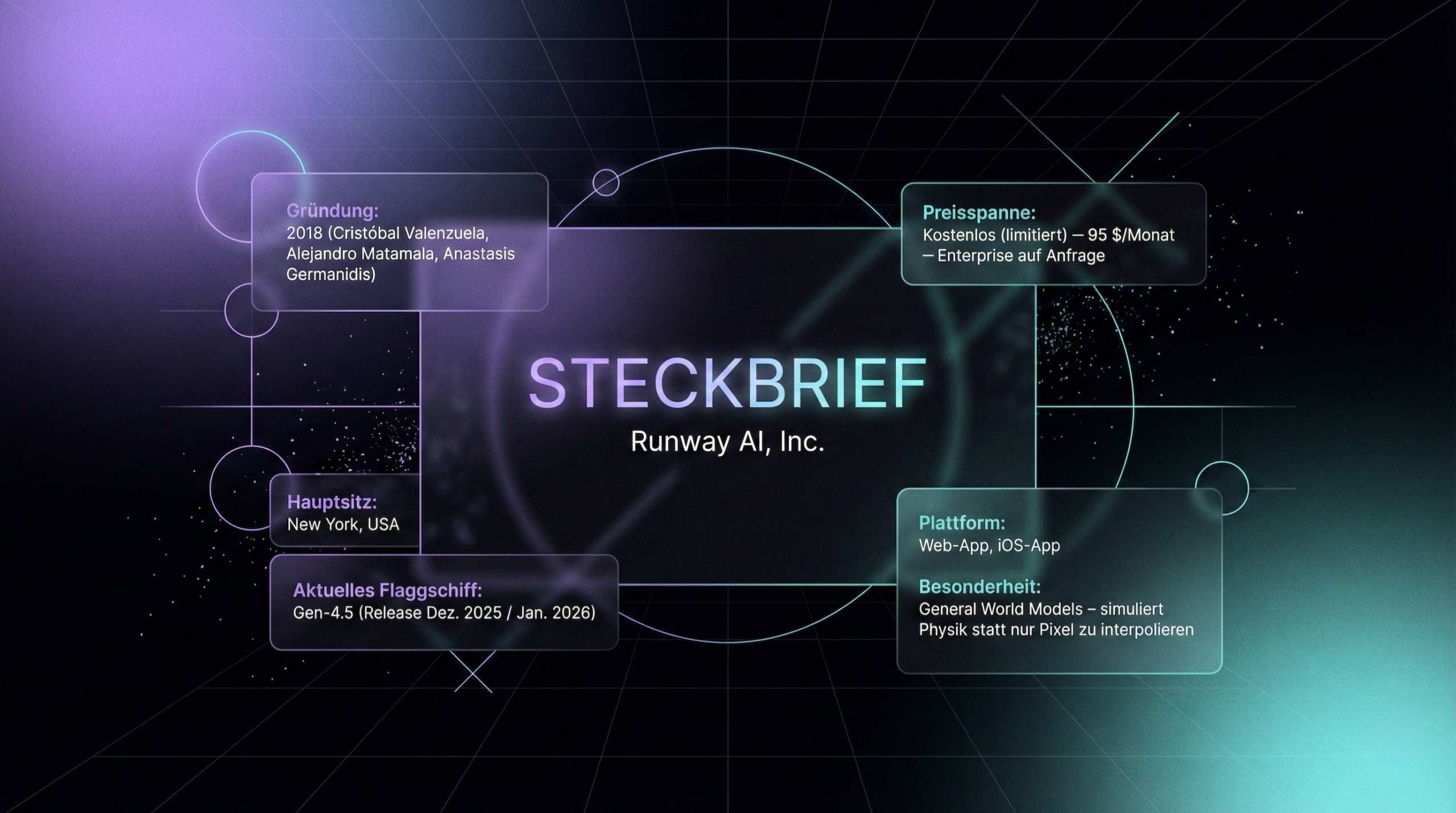

Steckbrief

| Entwickler | Runway AI, Inc. |

| Gründung | 2018 (Cristóbal Valenzuela, Alejandro Matamala, Anastasis Germanidis) |

| Hauptsitz | New York, USA |

| Aktuelles Flaggschiff | Gen-4.5 (Release Dez. 2025 / Jan. 2026) |

| Preisspanne | Kostenlos (stark limitiert) bis 95 $/Monat – Enterprise auf Anfrage |

| Plattform | Web-App, iOS-App (keine native Android-App, kein Desktop-Offline) |

| Besonderheit | General World Models – simuliert Physik statt nur Pixel zu interpolieren |

Für wen ist Runway geeignet?

Filmemacher & Video-Editoren

Runway richtet sich in Oberfläche und Features klar an Profis. Die Timeline, Layer-Struktur und Exportoptionen (ProRes, PNG-Sequenzen) sprechen die Sprache von Premiere und DaVinci Resolve. Wer Pre-Viz, animierte Storyboards oder VFX-Elemente braucht, findet hier das passende Werkzeug.

Werbeagenturen & Marketing-Teams

Produkte in neue Umgebungen setzen, Werbespots per Lip-Sync in 20 Sprachen anpassen, schnelle Animatics für Kundenpräsentationen – das sind die Workflows, für die Agenturen Runway täglich nutzen. Der Unlimited-Plan mit unbegrenzten Generierungen im Explore Mode macht das wirtschaftlich planbar.

Content Creator & Social Media

Für TikTok und Instagram Reels reichen oft die schnelleren Turbo-Modelle. In wenigen Sekunden entstehen visuell überwältigende Loops, die den Scroll-Fluss stoppen. Besonders beliebt: „Impossible Visuals“ – Dinge, die in der Realität nicht existieren können.

Künstler & Musikvideo-Produzenten

Musikvideos sind der größte Spielplatz für KI-Video. Die surrealen, traumartigen Qualitäten der Generierung passen perfekt zur abstrakten Natur von Musik. Mit Gen-4.5, Lip-Sync und Act-Two lassen sich komplette Videos produzieren.

Preise & Pläne

Abo-Modell im Überblick

Runway bietet fünf Stufen an. Die Monatspreise im Überblick (bei Jahresabo ca. 20 % günstiger):

| Plan | Preis / Monat | Credits / Monat | Highlights |

|---|---|---|---|

| Free | 0 $ | 125 (einmalig) | Kein Gen-4.5, Wasserzeichen, kein Upscaling. Nur zum Testen. |

| Standard | 15 $ (12 $ jährlich) | 625 | Gen-4.5 & Aleph, 4K-Upscaling, 100 GB Speicher, kein Wasserzeichen. |

| Pro | 35 $ (28 $ jährlich) | 2.250 | Custom Voice Cloning, 500 GB Speicher, ProRes-Export, Team-Features. |

| Unlimited | 95 $ (76 $ jährlich) | 2.250 + ∞ Explore | Unbegrenzte Generierungen im Explore Mode (Relaxed-Warteschlange). |

| Enterprise | Auf Anfrage | Skalierbar | SSO, dedizierter Support, private Modelle, Sicherheits-Audits. |

Das Credit-System erklärt

Credits sind die interne Währung. Entscheidend: Die Kosten pro Sekunde Video variieren je nach Modell enorm.

| Modell / Funktion | Credits pro Sekunde | Bedeutung (Standard-Plan, 625 Credits) |

|---|---|---|

| Gen-4.5 (High Fidelity) | ca. 25 | ≈ 25 Sekunden Video pro Monat |

| Gen-4 (Standard) | ca. 12–15 | ≈ 40–50 Sekunden |

| Gen-4 Turbo / Gen-3 Alpha Turbo | ca. 5 | ≈ 125 Sekunden |

| Aleph (Video-Editing) | ca. 15 | ≈ 40 Sekunden |

| Bildgenerierung (Gen-4 Image) | 8–10 pro Bild | ≈ 60–78 Bilder |

Welcher Plan lohnt sich wirklich?

Die ehrliche Antwort: Für jeden, der Runway regelmäßig nutzt, ist der Unlimited-Plan faktisch alternativlos. Der Grund heißt „Explore Mode“. KI-Videogenerierung ist Trial-and-Error – das Verhältnis von Ausschuss zu nutzbarem Material liegt oft bei 10:1. Im Explore Mode kannst du hunderte Variationen testen, ohne dein Credit-Kontingent zu belasten. Du wartest nur etwas länger in der Warteschlange.

Der Standard-Plan mit 625 Credits reicht für Gen-4.5 gerade mal für 25 Sekunden. Das ist zum Ausprobieren okay, für echte Projekte aber zu wenig.

⚠️ Kostenfalle API

Die API rechnet ebenfalls in Credits ab (1 Credit = 0,01 $), bietet aber keine Unlimited-Flatrate. Ein 5-Sekunden-Clip mit Gen-4 Turbo kostet über API ca. 0,25 $. Wer viele Generierungen automatisiert, sollte genau kalkulieren.

Die wichtigsten Funktionen

Text-to-Video (Gen-4.5)

Die Basis-Funktion, aber qualitativ inzwischen auf einem anderen Level. Gen-4.5 erreicht fotorealistische Qualität, die oft nicht von gefilmtem Material zu unterscheiden ist. Hauttexturen, Haare, Stoffe – in 4K (via Upscaling) überzeugend. Standardmäßig generiert das Modell Clips von 5 oder 10 Sekunden. Die Extend-Funktion verlängert nahtlos, wobei die Kohärenz in der Praxis bei 20–30 Sekunden ihre Grenzen findet.

Neu seit Januar 2026: First Frame Control. Du bereitest ein Startbild in Midjourney oder Photoshop vor und Gen-4.5 übernimmt nur die Bewegung. Das erhöht die visuelle Kontrolle massiv.

Image-to-Video & Motion Brush

Für Profis oft wertvoller als Text-to-Video, weil es maximale Kontrolle über die Bildkomposition gibt. Du lädst ein Bild hoch und animierst es mit Gen-4 oder Gen-4.5.

Das Highlight ist der Motion Brush: Du malst Bereiche im Bild an und bestimmst per Vektor, was sich bewegen soll. Beispiel: Wolken nach rechts, Wasser nach unten, Leuchtturm bleibt statisch. Das verhindert das gefürchtete „Ganzbild-Wabern“ früherer KI-Videos.

Aleph – Video-Editing mit KI

Aleph löst ein zentrales Problem: Statt bei einem Fehler das ganze Video neu zu generieren, erlaubt es gezielte Eingriffe an bestehendem Material.

Was damit geht: Objekte austauschen (Hund → Löwe, inklusive Schattenwurf), Tag zu Nacht verwandeln, Wetter ändern, Stil-Transfer (z. B. „Claymation“ oder „Cyberpunk Anime“) – alles, ohne Kamerabewegung oder zeitliche Struktur des Originals zu zerstören. Aleph nutzt Flow-Matching-Algorithmen, um Änderungen von Frame 1 bis Frame 100 konsistent zu propagieren.

Act-Two – Performance Capture

Eingeführt Ende 2025, demokratisiert Act-Two die Charakteranimation. Du nimmst ein Referenzvideo per Webcam oder iPhone auf. Act-Two extrahiert Mimik, Kopfbewegung und Augenaufschläge und überträgt sie auf einen beliebigen Ziel-Charakter – ein Alien, einen Cartoon, ein fotorealistisches Model.

Ideal für virtuelle Influencer, Synchronisationen in andere Sprachen oder animierte Filme. Teure Motion-Capture-Anzüge oder Studios brauchst du dafür nicht mehr.

Game Worlds (Beta)

Strategisch das spannendste Feature. Game Worlds ist eine interaktive Umgebung, in der du per Textbefehle eine simulierte Welt erkundest – ein visuelles Text-Adventure, in Echtzeit generiert.

Der Clou: Das Modell versteht Zustandspermanenz. Wenn du einen Schlüssel aufhebst, weiß die KI zehn Minuten später noch, dass er in deiner Tasche ist. Die Technologie basiert auf Runways General World Models und deutet auf das langfristige Ziel hin: voll interaktive, generative Videospiele.

Die General World Models von Runway berühren ein größeres Thema: KI, die physikalische Regeln simuliert. Der Artikel über Physical AI – KI in der physischen Welt zeigt dir, warum Masse, Trägheit und Zustandspermanenz mehr sind als Marketingbegriffe – sondern Schritte Richtung echter Weltmodelle.

Audio: Text-to-Speech, Lip Sync & Custom Voices

Runway bietet mittlerweile eine komplette Audio-Suite. Text-to-Speech generiert Sprachausgabe, Lip Sync passt Lippenbewegungen automatisch an Audiodateien an. Im Pro-Plan und höher kannst du deine eigene Stimme klonen, um konsistente Erzählerstimmen zu haben.

Runway-Modelle im Vergleich

Runway betreibt mehrere Modellgenerationen parallel. Welches wofür?

| Modell | Stärke | Geschwindigkeit | Credits/Sek. | Einsatzzweck |

|---|---|---|---|---|

| Gen-4.5 | Beste Physik, Texturen, Prompt-Treue | Langsam | ca. 25 | Finale Produktionsclips, High-End-Projekte |

| Gen-4 | Consistent Characters, solide Qualität | Mittel | ca. 12–15 | Animatics, narrative Projekte, Entwürfe |

| Gen-4 Turbo | Bis zu 7× schneller als Gen-4 | Schnell | ca. 5 | Konzeptphase, Social Media, schnelle Iterationen |

| Gen-3 Alpha Turbo | Günstigstes Modell | Schnell | ca. 5 | Hintergrundelemente, stilisierte Effekte (Legacy) |

| Aleph | Video-zu-Video, In-Context Editing | Mittel | ca. 15 | Nachbearbeitung, Stil-Transfer, Objekt-Austausch |

💡 Tipp

Starte mit Gen-4 Turbo für schnelle Tests. Wenn der Prompt sitzt, generiere den finalen Clip mit Gen-4.5 für maximale Qualität.

Video-Qualität & technische Specs

Auflösung & Upscaling

Die meisten Modelle generieren nativ in 1280 × 720 (720p). Das klingt erst mal niedrig, hat aber Performance-Gründe. Runway integriert einen proprietären KI-Upscaler, der Clips auf 4K (3840 × 2160) hochskaliert. Der Upscaler fügt Details hinzu und schärft Kanten – funktioniert am besten bei sauberem Ausgangsmaterial.

Framerate & Cliplänge

Standard sind 24 fps – der klassische Kino-Look mit natürlicher Bewegungsunschärfe. Andere Raten (30, 60 fps) entstehen durch Interpolation. Die Basis-Generierung erfolgt in Blöcken von 5 oder 10 Sekunden. Längere Sequenzen baust du durch „Stitching“ mehrerer Clips, was dank der Konsistenz-Features von Gen-4.5 immer nahtloser funktioniert.

Export-Optionen: MP4, ProRes, PNG-Sequenzen

MP4 (H.264) ist der Standard – kompatibel mit allem, aber komprimiert. Ab dem Pro-Plan steht ProRes 4444 zur Verfügung: weniger Artefakte, 10-bit Farbtiefe, ideal für Color-Grading. PNG-Sequenzen (Einzelbilder pro Frame) sind wichtig für VFX-Workflows. Bestimmte Tools erlauben außerdem den Export mit Alpha-Kanal (Transparenz) für Compositing in After Effects.

Benutzeroberfläche & Apps

Web-Interface

Das Herzstück ist app.runwayml.com. Die Oberfläche hat sich von einer simplen Prompt-Box zu einer Non-Linear Editing Umgebung entwickelt: Timeline, Layer für Audio und Video, Seitenleisten für Parameter wie Seed, Auflösung und Motion Sliders. Wer Premiere oder Final Cut kennt, findet sich schnell zurecht. Assets werden in Ordnern organisiert – bei großen Projekten essentiell.

iOS-App

Die iOS-App ist überraschend leistungsfähig. Kamera-Integration erlaubt, Videos direkt aufzunehmen und in Act-Two oder Video-to-Video zu nutzen – ein „Shoot & Edit“-Workflow unterwegs.

Android & Desktop

Stand Januar 2026 gibt es keine native Android-App mit vollem Funktionsumfang. Android-Nutzer weichen auf die mobile Webversion aus, die weniger performant ist. Eine native Desktop-App existiert ebenfalls nicht – alles läuft in der Cloud. Es gibt lediglich PWA-Wrapper, die die Webseite wie ein Programm aussehen lassen.

Tipps: So holst du bessere Ergebnisse raus

Prompt-Struktur für Gen-4.5

Für Gen-4.5 gilt: Struktur schlägt Prosa. Nutze eckige Klammern, um dem Modell die Trennung der Konzepte zu erleichtern.

❌ Schlecht

„Ein cooler Cyberpunk Typ läuft durch die Stadt.“

✅ Gut

„[Subject: A man in a neon-lit leather jacket, mid-30s, walking slowly]. [Setting: Rainy cyberpunk alley, puddles reflecting holographic billboards]. [Lighting: Volumetric lighting, cyan and magenta color palette]. [Camera: Slow dolly forward, low angle].“

Camera Controls nutzen

Verlasse dich nicht auf den Text für Kamerabewegungen – die KI „überliest“ Bewegungswörter oft. Nutze stattdessen die Camera Motion Slider im Interface: Horizontal/Vertical für Schwenks, Zoom für Dolly In/Out, Roll für Dutch Angles. Die explizite Einstellung zwingt das Modell, die Geometrie entsprechend zu verschieben.

Konsistenz-Hacks: Seed & Image Prompts

Fixed Seed: Wenn ein Ergebnis fast perfekt ist, behalte den Seed bei und ändere nur minimal den Prompt. So iterierst du gezielt statt blind.

Image Prompts: Nutze immer ein Bild als Startpunkt (Image-to-Video), wenn du spezifische visuelle Vorstellungen hast. Text allein ist zu interpretationsfähig. Ein in Midjourney generiertes Bild als Referenz garantiert den Look.

Runway vs. Alternativen

Gerade bei der Frage „Runway oder Sora?“ wird es konkret. Wenn du wissen willst, wie sich die Modelle in Sachen physikalischer Realismus, Prompt-Treue und Workflow-Kontrolle schlagen, liefert der Vergleich Sora 2 vs. Runway Gen-4.5 vs. Kling 3.0 eine fundierte Entscheidungsbasis für dein Budget und deinen Use Case.

Runway vs. OpenAI Sora

Sora gilt als Benchmark für rohen physikalischen Fotorealismus „out of the box“. Runway punktet dagegen durch granulare Kontrolle. Sora funktioniert eher als Black Box (Prompt rein → Video raus), Runway gibt dir Regler, Pinsel und Editoren. Kurz: Sora für den schnellen Wow-Effekt, Runway für Regisseure mit spezifischer Vision.

Für den direkten Blick auf OpenAIs Ansatz hilft dir außerdem der detaillierte Sora-Test zu OpenAIs Videogenerator. Dort siehst du, wann die „Black-Box“-Generierung beeindruckt – und wann dir die granularen Eingriffe von Runway fehlen könnten.

Runway vs. Kling (Kuaishou)

Kling generiert längere Clips (bis 2 Minuten am Stück) und zeigt beeindruckende menschliche Bewegungen. Runway gewinnt bei Integration in professionelle Workflows, Konsistenz-Tools und Datenschutz – für westliche Enterprise-Kunden ist Runways SOC2-Compliance ein wichtiger Faktor.

Spannend wird es, wenn du mit längeren Clips experimentieren willst. Der Kling-Test – Chinas Video-KI im Detail zeigt, warum viele Creator Kling für 60–120-Sekunden-Sequenzen testen und wo Runway in puncto Workflow-Integration und Enterprise-Compliance die Nase vorn hat.

Runway vs. Pika

Pika fokussiert sich auf Animationen (Anime, 3D-Renderstil) und „Fun“-Features wie Lip-Sync für Memes. Zugänglicher und schneller, aber weniger auf professionelle Filmproduktion ausgelegt. Runway ist das „ernstere“ Tool.

Wer eher im kreativen Animationsbereich unterwegs ist, bekommt mit dem Pika-Test – kreative Video-KI im Praxiseinsatz ein Gefühl dafür, wann stilisierte Looks schneller erreichbar sind als mit Runways eher filmischem Ansatz.

Runway vs. Google Veo

Veo ist tief ins Google-Ökosystem integriert (YouTube Shorts, Workspace) und punktet mit hoher nativer Auflösung (1080p+) und Geschwindigkeit dank Googles TPU-Infrastruktur. Runway bietet dafür granularere Bearbeitungsmöglichkeiten durch Act-Two und Aleph.

Wann ist eine Alternative die bessere Wahl?

Wenn das Budget minimal ist: Runways Free Tier ist extrem limitiert. Tools wie Kling oder Luma bieten oft großzügigere kostenlose Testphasen. Für reine Anime-Generierung sind spezialisierte Modelle wie Pika oft stilistisch treffsicherer.

Aktuelle Updates & Entwicklungen

Gen-4.5 Release (Dezember 2025 / Januar 2026)

Gen-4.5 ist der neue technologische Zenit der Plattform. Das Modell versteht Masse und Trägheit – ein rennender Mensch hat Gewicht, ein fallendes Objekt beschleunigt korrekt. Die Prompt-Treue bei Lichtstimmungen und Kamerabewegungen hat sich deutlich verbessert.

First Frame Control (Januar 2026)

Eine der wichtigsten Neuerungen: Du kannst ein Startbild hochladen und Gen-4.5 nur für die Bewegung nutzen. Das gibt Regisseuren die Möglichkeit, das Szenenbild exakt vorzubereiten und die KI gezielt einzusetzen.

Partnerschaft mit Lionsgate

Im September 2024 angekündigt und 2025/26 aktiv: Lionsgate arbeitet mit Runway zusammen, um benutzerdefinierte Modelle auf eigenem Filmkatalog zu trainieren. Statt KI zu verklagen, kooperiert Hollywood – lizenzierte Daten statt Web-Scraping. Das könnte das Modell für die Zukunft des Copyrights werden.

Runway AI Film Festival 2026

Das jährlich in New York und Los Angeles stattfindende AI Film Festival (AIFF) ist zum „Cannes der KI-Filme“ geworden. Für 2026 sind Preisgelder und Production Grants in Millionenhöhe ausgeschrieben. Runway investiert damit gezielt in die kulturelle Legitimierung der Technologie.

Limitierungen & Content Policy

Technische Grenzen

Auch Gen-4.5 hat Schwächen. Bei sehr schnellen Bewegungen oder komplexen Interaktionen (zwei Personen umarmen sich, kämpfen) treten Morphing-Artefakte auf. Hände und Finger bleiben gelegentliche Fehlerquellen – seltener als 2024, aber nicht gelöst.

Ein bekanntes Phänomen bei Diffusionsmodellen: Manchmal passiert die Wirkung vor der Ursache. Ein Glas bricht, bevor der Stein trifft. Das liegt daran, dass das Modell das Video als ganzen Block berechnet und nicht chronologisch.

Da Gen-4.5 wie viele moderne Videomodelle auf Diffusion basiert, verstehst du mit dem Grundlagenartikel zu Diffusion Models – die Technik hinter Midjourney und DALL·E besser, warum Ursache und Wirkung manchmal „vertauscht“ wirken und weshalb Kohärenz bei 30 Sekunden an ihre Grenzen stößt.

Inhaltsrichtlinien: Was Runway blockiert

Runway operiert unter strengen ethischen Richtlinien. Erotische Inhalte, Nacktheit, extreme Gewalt und Gore werden durch automatische Filter blockiert. Das Generieren fotorealistischer Videos bekannter Politiker oder Stars ist ebenfalls gesperrt – Deepfake-Prävention. Die Moderation ist hier strikter als bei vielen Open-Source-Modellen, was manche Künstler aus dem Bereich Dark Fantasy oder Horror frustriert.

FAQ

Ist Runway kostenlos nutzbar?

Ja, aber stark eingeschränkt. Der Free-Plan bietet 125 einmalige Credits (ohne Erneuerung), kein Gen-4.5, Wasserzeichen und kein 4K-Upscaling. Zum Testen der Oberfläche reicht es, für echte Projekte nicht. Wie lang können generierte Videos sein?

Wie lang können generierte Videos sein?

Die Basis-Generierung erfolgt in 5- oder 10-Sekunden-Blöcken. Durch die Extend-Funktion verlängerst du Clips nahtlos. In der Praxis bleibt die Kohärenz bis ca. 20–30 Sekunden stabil, danach können subtile Inkonsistenzen auftreten. Welche Auflösung haben Runway-Videos?

Welche Auflösung haben Runway-Videos?

Nativ generieren die Modelle in 720p (1280 × 720). Ein integrierter KI-Upscaler skaliert auf 4K (3840 × 2160) hoch – verfügbar ab dem Standard-Plan. Gibt es eine Android-App?

Gibt es eine Android-App?

Stand Januar 2026: Nein, es gibt keine native Android-App mit vollem Funktionsumfang. Android-Nutzer können die mobile Webversion nutzen, die aber weniger performant ist. Kann ich Runway-Videos kommerziell nutzen?

Kann ich Runway-Videos kommerziell nutzen?

Ja, ab dem Standard-Plan (kein Wasserzeichen). Für Enterprise-Kunden gibt es zusätzliche rechtliche Absicherungen. Beachte jedoch die Content Policy – bestimmte Inhalte sind generell gesperrt. Was ist der Unterschied zwischen Gen-4 und Gen-4.5?

Was ist der Unterschied zwischen Gen-4 und Gen-4.5?

Gen-4.5 bietet feinere Texturen, bessere physikalische Simulation (Masse, Trägheit) und höhere Prompt-Treue. Gen-4 ist schneller, günstiger und für Entwürfe oder weniger komplexe Szenen oft die bessere Wahl. Gibt es eine API?

Gibt es eine API?

Ja. Die API bietet Zugriff auf Modelle wie Gen-4 Image und Gen-3 Alpha Turbo. Der API-Zugriff auf Gen-4.5 ist Stand Januar 2026 noch eingeschränkt (Beta für ausgewählte Partner). Abgerechnet wird in Credits (1 Credit = 0,01 $), ohne Unlimited-Flatrate.

Fazit + Nächste Schritte

Runway ist nicht das billigste Tool und nicht immer das physikalisch perfekteste – aber das vollständigste.

Die Kombination aus Gen-4.5, Aleph, Act-Two, Motion Brush und einer professionellen Editing-Oberfläche macht Runway zur bisher komplettesten Plattform für KI-Videoproduktion. Wer Präzision, Editierbarkeit und Konsistenz braucht, findet hier das richtige Werkzeug.

Deine nächsten Schritte:

Starte mit dem Free-Plan, um die Oberfläche kennenzulernen. Wechsle für ernsthafte Projekte direkt auf den Unlimited-Plan – der Explore Mode macht den Unterschied. Nutze Image-to-Video statt reinem Text-to-Video, wann immer du eine klare visuelle Vorstellung hast. Und investiere Zeit ins Prompt Engineering: Struktur, Camera Controls und ein fester Seed bringen dich deutlich schneller zum Ergebnis als blindes Regenerieren.