Small Language Models (SLMs) sind KI-Sprachmodelle mit weniger als 7–10 Milliarden Parametern. Sie können direkt auf Smartphones, Laptops oder kleinen Servern laufen – ohne Cloud-Anbindung.

Der Clou: Trotz ihrer kompakten Größe erreichen moderne SLMs in bestimmten Aufgaben die Leistung von Modellen, die zehnmal größer sind. Das macht sie zur vielleicht wichtigsten KI-Entwicklung der Jahre 2025 und 2026.

Während das Rennen um immer größere Modelle (GPT-4, Claude, Gemini Ultra) die Schlagzeilen dominierte, passierte im Hintergrund etwas Entscheidendes: Forscher fanden heraus, wie man Intelligenz komprimiert. Nicht die Anzahl der Parameter entscheidet über die Qualität – sondern wie effizient sie genutzt werden.

Das Ergebnis? Ein 1,5-Milliarden-Parameter-Modell von DeepSeek löst heute mathematische Aufgaben besser als GPT-4o. Und ein 3B-Modell auf deinem iPhone antwortet schneller als jede Cloud-API.

Wie groß ist „klein“? Die drei Größenklassen

Der Begriff „klein“ ist relativ. Was 2023 neben GPT-3 (175 Milliarden Parameter) als winzig galt, hat sich zu einer differenzierten Klassifikation entwickelt. Heute unterscheidet die Industrie drei Klassen – jeweils mit eigenen Hardware-Anforderungen und Einsatzgebieten.

Micro-Modelle (unter 1 Milliarde Parameter)

Micro-Modelle wie Qwen 2.5 0.5B oder spezialisierte 1-Bit-Implementierungen sind für extreme Edge-Umgebungen gebaut: Mikrocontroller, IoT-Geräte, Wearables. Sie führen keine Gespräche, sondern erledigen klar definierte Aufgaben – Klassifizierung, Anfragen-Routing oder einfache Sprachbefehle.

Ihr Speicherbedarf liegt oft unter 1 GB RAM. Dafür verzichten sie auf Nuance und breites Weltwissen. Denk an sie als hochspezialisierte Werkzeuge, nicht als Gesprächspartner.

Nano- und Edge-Modelle (1–3 Milliarden Parameter)

Das ist die spannendste Klasse in 2026. Modelle wie Llama 3.2 3B, Gemma 3 4B oder Apples On-Device-Modell laufen direkt auf modernen Smartphones – auf der NPU (Neural Processing Unit), ohne Internetverbindung.

Sie beherrschen kohärente Textgenerierung, folgen Anweisungen zuverlässig und passen in weniger als 4 GB RAM. Hier entscheidet sich der Wettbewerb um die „Alltags-KI“: der persönliche Assistent, der direkt auf deinem Gerät lebt.

Small Models (3–8 Milliarden Parameter)

Die klassische „kleine“ Kategorie, populär geworden durch Mistral 7B. Hierzu zählen Phi-4 Mini (3.8B), Llama 3.1 8B und Qwen 2.5 7B. Diese Modelle sind die Arbeitspferde für lokale Desktop-Inferenz, Coding-Assistenten und komplexe Agenten-Workflows.

Sie bieten echte Reasoning-Fähigkeiten – logisches Schließen, das über simples Anweisungen-Befolgen hinausgeht. Anforderung: 8–16 GB RAM, also ein normaler Consumer-Laptop oder eine Mittelklasse-GPU.

SLMs entfalten ihre Stärke besonders in agentischen Workflows, bei denen Geschwindigkeit und Autonomie entscheidend sind. Wenn du verstehen willst, was autonome Systeme wirklich leisten und wo ihre Grenzen liegen, findest du im Grundlagenartikel zu KI-Agenten: Was sind autonome Systeme? die konzeptionelle Einordnung hinter dem Router-Prinzip.

Warum der Trend zu kleineren Modellen?

Der Schwenk zu SLMs ist kein Hype. Er folgt aus knallharten ökonomischen Zwängen, technischen Durchbrüchen und wachsenden Datenschutz-Anforderungen.

Kosten: Bis zu 100x günstiger als Frontier-Modelle

KI-Kosten werden in Token gemessen. Und hier wird der Unterschied drastisch.

SLMs kosten über API-Dienste oft weniger als 0,05 USD pro Million Input-Token. Frontier-Modelle wie GPT-4 oder Claude liegen bei 2,00 bis 5,00 USD – oder mehr. Für Unternehmen, die Millionen Kundenanfragen täglich verarbeiten, ist das der Unterschied zwischen einem profitablen und einem defizitären Geschäftsmodell.

Dazu kommt der Durchsatz: Ein Modell wie Mistral Small generiert Hunderte Token pro Sekunde. Das macht es ideal für Echtzeitanwendungen, bei denen Latenz direkt mit Umsatz korreliert – etwa bei Echtzeit-Übersetzungen oder interaktiven Assistenten.

Geschwindigkeit: Echtzeit-KI ohne Cloud

Für Sprachassistenten und Agenten-Systeme ist Latenz ein Dealbreaker. Menschen nehmen Verzögerungen ab 200–500 Millisekunden als störend wahr. Cloud-basierte LLMs leiden unter Netzwerklatenz und langsamer Generierung.

Ein 3B-Modell auf der lokalen NPU eliminiert den Netzwerk-Roundtrip komplett. Modelle wie Gemma 3 oder Llama 3.2 liefern eine nahezu verzögerungsfreie Erfahrung. Technologien wie BitNet b1.58 erreichen Inferenzlatenzen von nur 29 Millisekunden auf Standard-CPUs – viermal schneller als herkömmliche Modelle. Das öffnet die Tür für komplexe KI-Operationen auf Geräten ohne dedizierte GPU.

Datenschutz: Daten bleiben auf dem Gerät

Mit der tiefen Integration von KI in persönliche Lebensbereiche ist Datenschutz zum vielleicht wichtigsten Treiber für SLMs geworden.

SLMs verarbeiten sensible Daten – Gesundheitsakten, Finanzdokumente, private Chats – vollständig auf dem Gerät. Kein Cloud-Upload, kein Risiko. Das Samsung Galaxy S25 und Apples Intelligence-Plattform nutzen genau diese Architektur: Persönlicher Kontext wird lokal verarbeitet, nur nicht-sensible Anfragen gehen (anonymisiert) an die Cloud.

Für regulierte Branchen wie Gesundheitswesen oder Finanzsektor bieten SLMs einen praktikablen Weg zur Einhaltung von DSGVO und EU AI Act. Die Daten verlassen das kontrollierte Hoheitsgebiet nie.

Energieeffizienz und Akkulaufzeit

Ein 70-Milliarden-Parameter-Modell für jede banale Anfrage zu aktivieren, ist energetische Verschwendung. SLMs reduzieren den Energieverbrauch pro Anfrage um Größenordnungen. Eine 1-Bit-LLM-Implementierung senkt die Energiekosten pro Inferenz auf bis zu 0,028 Joule.

Für Smartphones ist das existentiell. Kein Hersteller kann KI-Features ausrollen, die den Akku in Stunden leeren. Die NPUs in Chips wie dem Snapdragon 8 Elite (Galaxy S25) und Apple Silicon sind spezifisch auf die 3B-Modellklasse abgestimmt – für „Always-On“-KI ohne merkbaren Batterieverlust.

Die wichtigsten Small Language Models im Überblick

Das SLM-Ökosystem ist hart umkämpft. Hier die relevantesten Modelle im Januar 2026.

| Modell | Parameter | MMLU (Wissen) | Mathe-Stärke | Kontextfenster | Stärke |

|---|---|---|---|---|---|

| Phi-4 Mini (Microsoft) | 3.8B | ~67 % | Hoch | 128k | Reasoning |

| Ministral 3B (Mistral) | 3.0B | ~61 % | Stark | 128k | Allrounder |

| Llama 3.2 (Meta) | 3.0B | ~56 % | Moderat | 128k | Ökosystem |

| Gemma 3 4B (Google) | 4.0B | ~60 % | Moderat | 128k | Multimodal |

| Qwen 2.5 3B (Alibaba) | 3.0B | Hoch | Sehr stark | 32k | Code & Mathe |

| DeepSeek-R1-Distill | 1.5B | Hoch | 83,9 % (MATH-500) | 32k/128k | Mathe-Reasoning |

Llama 3.2 (Meta)

Meta setzt auf offene Gewichtungen (Open Weights). Die Llama 3.2 Modelle (1B und 3B) erschienen Ende 2024 und setzten den Standard für mobile KI in 2025. Als erste „Edge-Native“ Llamas unterstützen sie ein Kontextfenster von 128.000 Token und sind tief für Qualcomm- und MediaTek-Hardware optimiert.

Das 3B-Modell ist der Favorit für mobile Deployments. Es zeigt für seine Größe starke Reasoning-Fähigkeiten, liegt aber knapp hinter größeren 8B-Modellen.

Sobald du tiefer in die Architektur eintauchst, stößt du zwangsläufig auf die Transformer-Struktur, die auch in kompakten Modellen wie Llama 3.2 oder Phi-4 Mini steckt. Wenn du wirklich verstehen willst, warum Attention-Mechanismen, Kontextfenster und GQA so entscheidend für Edge-Modelle sind, hilft dir Transformer-Architektur einfach erklärt dabei, die technischen Bausteine hinter der „komprimierten Intelligenz“ greifbar zu machen.

Phi-4 Mini (Microsoft)

Microsofts Phi-Serie hat bewiesen, dass extrem hochwertige Trainingsdaten („Textbook Quality“) kleine Modelle befähigen, mit Riesen zu konkurrieren. Phi-4 Mini bringt 3,8 Milliarden Parameter mit, bietet ein 128k-Kontextfenster und wurde auf 5 Billionen Token trainiert.

Es ist als „Reasoning-Dense“-Modell für Edge-Geräte positioniert und zielt direkt auf Llama 3.2 3B und Ministral 3B. In Reasoning-Benchmarks konkurriert das größere Phi-4 (14B) sogar mit Llama 3.1 70B.

Gemma 3 (Google)

Googles offene Gemma-3-Familie (veröffentlicht März 2025) umfasst Größen von 1B bis 27B. Das Besondere: Die Modelle sind standardmäßig multimodal – sie verarbeiten Text und Bilder. Das 4B-Modell nutzt ein 128k-Kontextfenster und alternierende lokale/globale Attention-Layer für maximale Effizienz.

Parallel dazu treibt Googles proprietäres Gemini Nano Features wie Betrugserkennung bei Anrufen und On-Device-Zusammenfassungen auf Pixel- und Samsung-Geräten an.

Ministral 3B (Mistral AI)

Das französische Labor Mistral AI hat mit „Les Ministraux“ Ende 2024 den Edge-Markt ins Visier genommen. Ministral 3B übertrifft laut Benchmarks sowohl Llama 3.2 3B als auch Gemma 2 2.6B in Wissens- (MMLU) und Mathe-Aufgaben (GSM8K). Ein starker Allrounder für mobile Anwendungen.

Qwen 2.5 (Alibaba)

Die Qwen-2.5-Serie von Alibaba gilt als vielleicht vielseitigste offene Modellfamilie. Die granulare Abstufung reicht von 0.5B bis 32B. Besonders die 3B- und 7B-Varianten für Code und Mathematik gelten als State of the Art in ihren Domänen – und schlagen regelmäßig Modelle, die zehnmal größer sind.

Weil viele SLMs als Open Weights veröffentlicht werden, spielt die Frage nach Offenheit eine zentrale Rolle. Der Vergleich unter Open Source vs. Closed Source KI hilft dir abzuwägen, ob du auf transparente Modelle wie Llama oder Qwen setzt – oder lieber auf proprietäre Systeme wie Gemini Nano.

DeepSeek-R1-Distill

Der Disrupter. Anstatt kleine Modelle von Grund auf zu trainieren, destillierte DeepSeek die Denkmuster seines massiven R1-Modells (671B Parameter) in eine kompakte Qwen-Architektur mit nur 1,5 Milliarden Parametern.

Das Ergebnis ist bemerkenswert: 83,9 % im MATH-500-Benchmark – besser als GPT-4o in spezifischen mathematischen Aufgaben. Ein 1,5B-Modell, das ein Frontier-Modell schlägt. Das beweist: Für bestimmte Logikaufgaben ist die Parameteranzahl irrelevant. Entscheidend ist die Qualität der Trainingsdaten.

Wie schaffen kleine Modelle so viel Leistung?

Der Boom der SLMs ruht auf zwei technologischen Säulen: Wissensdestillation und aggressive Quantisierung.

Der Vergleich zwischen SLMs und Frontier-Modellen wird klarer, wenn du weißt, wie große Sprachmodelle grundsätzlich funktionieren. Eine verständliche Einordnung liefert Wie funktionieren Large Language Models?, wo du lernst, warum mehr Parameter lange als Qualitätsgarantie galten – und weshalb Destillation und bessere Trainingsdaten diese Logik heute aufbrechen.

Wissensdestillation: Vom großen Modell lernen

Destillation funktioniert wie ein Meister-Schüler-Prinzip. Ein kleines „Schüler“-Modell lernt, ein großes „Lehrer“-Modell zu imitieren – nicht nur die Antworten, sondern den Denkprozess.

DeepSeek hat das revolutioniert. Sie generierten Tausende von Gedankengängen (Reasoning Paths) mit ihrem 671B-Modell. Dann wurde ein kleines Qwen-Modell (1.5B) auf diese Pfade feinabgestimmt. Das Ergebnis: Das kleine Modell lernt nicht nur was die richtige Antwort ist, sondern wie man logisch dorthin kommt. So löst ein 1,5B-Modell mathematische Probleme, für die zuvor 70 Milliarden Parameter nötig waren.

Microsofts Phi-Serie geht einen ähnlichen Weg: Sie nutzt „lehrbuchartige“ synthetische Daten, generiert von größeren Modellen, um dem SLM Logik und Sprache beizubringen – ohne das Rauschen des rohen Internets.

Quantisierung: Weniger Bits, kaum Qualitätsverlust

Quantisierung reduziert die Präzision, mit der ein Modell seine Gewichte speichert. Statt 16-Bit-Gleitkommazahlen (FP16) werden 4-Bit-Ganzzahlen verwendet.

In 2026 ist 4-Bit-Quantisierung (Q4_K_M) der Standard für lokale Anwendungen – etwa über Tools wie Ollama. Das bringt rund 50 % Speichereinsparung bei vernachlässigbarem Genauigkeitsverlust. Ein 7B-Modell, das in FP16 über 14 GB braucht, passt quantisiert in 5–6 GB.

Techniken wie SpinQuant minimieren zusätzlich die „Ausreißer“ in den Aktivierungsmatrizen und ermöglichen höhere Genauigkeiten bei extrem niedrigen Bitraten (2-Bit oder 3-Bit).

1-Bit-Modelle (BitNet): Die nächste Stufe

Die technologische Grenze sind 1-Bit- bzw. 1.58-Bit-Modelle (BitNet b1.58). Diese nutzen Gewichte mit nur drei möglichen Zuständen: {-1, 0, 1}. Komplexe Gleitkomma-Multiplikationen werden durch simple Ganzzahl-Additionen ersetzt.

Die Ergebnisse sind beeindruckend: bis zu 71 % weniger Energieverbrauch und 3- bis 4-fach reduzierter Speicherbedarf. Ein 3B-BitNet-Modell kann in der Leistung mit einem herkömmlichen 7B-FP16-Modell konkurrieren – auf deutlich schwächerer Hardware.

Das entkoppelt die „Größe“ eines Modells (in Gigabyte) endgültig von seiner Parameteranzahl. Ein „kleines“ Modell von 2026 erbringt die kognitive Leistung eines „großen“ Modells von 2023 – bei einem Bruchteil des Ressourcenverbrauchs.

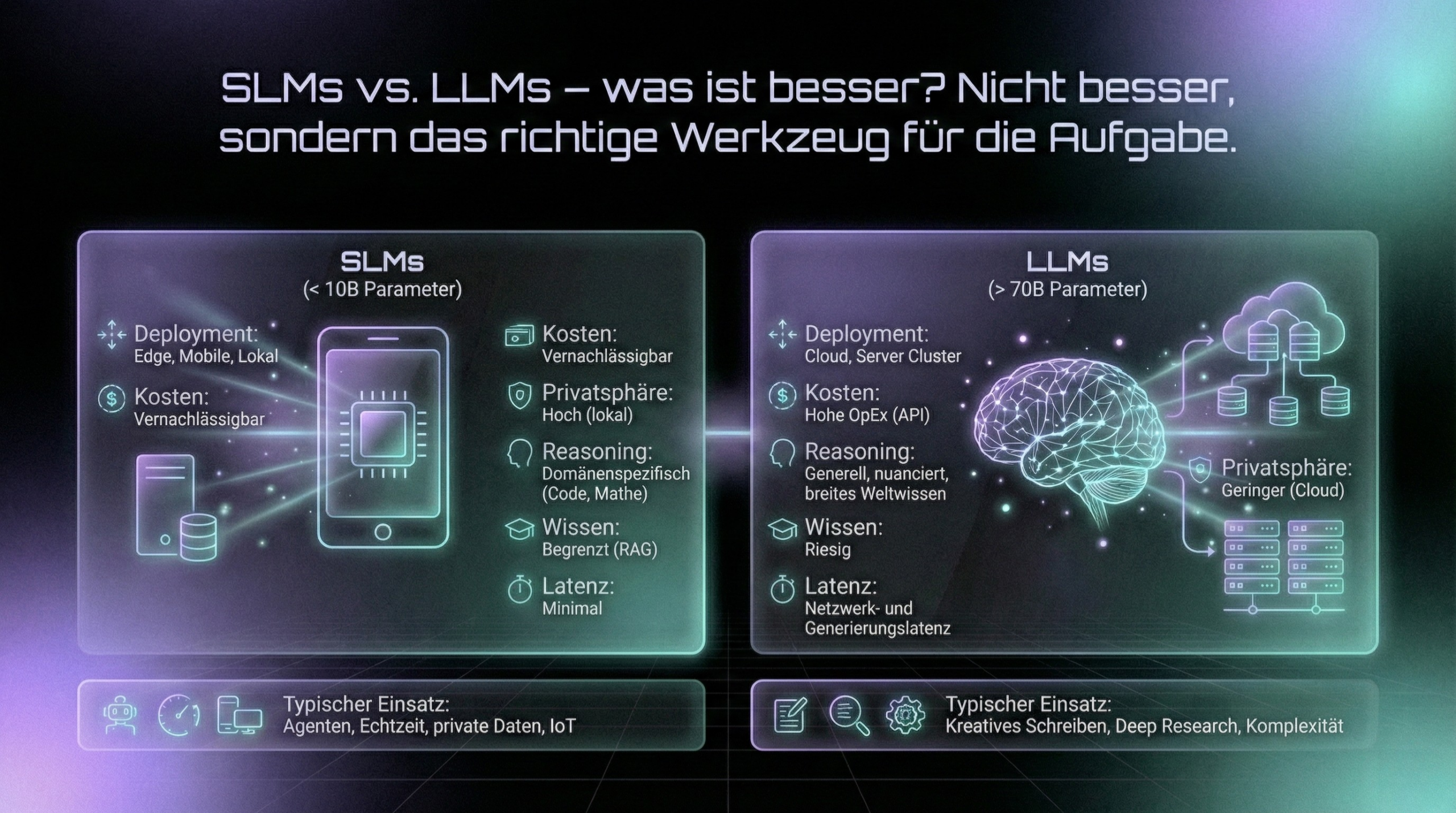

SLMs vs. LLMs – was ist besser?

Die Frage ist falsch gestellt. Es geht nicht um „besser oder schlechter“, sondern um das richtige Werkzeug für die jeweilige Aufgabe.

| Merkmal | SLMs (< 10B Parameter) | LLMs (> 70B Parameter) |

|---|---|---|

| Deployment | Edge, Mobile, Lokal | Cloud, Server Cluster |

| Kosten | Vernachlässigbar / geringe CapEx | Hohe OpEx (API-Kosten) |

| Privatsphäre | Hoch (Daten bleiben lokal) | Geringer (Daten gehen in die Cloud) |

| Reasoning | Domänenspezifisch stark (Code, Mathe) | Generell, nuanciert, breites Weltwissen |

| Wissen | Begrenzt (braucht RAG für Fakten) | Riesig (Weltwissen in den Parametern) |

| Latenz | Minimal bis null | Netzwerk- und Generierungslatenz |

| Typischer Einsatz | Agenten, Echtzeit, private Daten, IoT | Kreatives Schreiben, Deep Research, Komplexität |

Wo SLMs überlegen sind

SLMs gewinnen überall dort, wo Geschwindigkeit, Kosten und Datenschutz entscheiden. Konkret:

Für agentische Workflows – also autonome KI-Agenten, die browsern, planen und Code schreiben – brauchst du schnelle Reaktionszeiten. Ein Cloud-Roundtrip pro Entscheidung ist zu langsam. SLMs reagieren in Millisekunden.

Für hochvolumige Anwendungen wie Kundensupport-Chatbots, die Millionen Anfragen täglich bearbeiten, macht der Faktor 100x bei den Token-Kosten den Unterschied zwischen Gewinn und Verlust.

Für datensensible Bereiche – Gesundheitswesen, Finanzbranche, Rechtsberatung – sind SLMs oft die einzige Option, die regulatorische Anforderungen wie DSGVO oder EU AI Act erfüllt, ohne auf KI zu verzichten.

Gerade beim Thema Halluzinationen brauchst du ein realistisches Bild, statt Marketing-Versprechen zu glauben. Die Analyse unter Halluzinationen in LLMs erklärt zeigt dir, warum kleinere Modelle anfälliger für Faktenfehler sind – und welche Gegenmaßnahmen in der Praxis funktionieren.

Wo LLMs weiterhin vorne liegen

SLMs haben klare Grenzen. In diesen Bereichen sind große Modelle nach wie vor überlegen:

Weltwissen und Halluzination: SLMs halluzinieren häufiger, wenn sie Wissen abrufen müssen, das außerhalb ihrer Trainingsverteilung liegt. Ihnen fehlt die massive Redundanz an Faktenwissen, die in einem 100B+-Modell steckt.

Lange Kontexte nutzen: Obwohl SLMs 128k-Kontextfenster bieten, haben sie größere Schwierigkeiten als LLMs, relevante Fakten präzise aus der Mitte langer Dokumente zu extrahieren – das sogenannte „Lost in the Middle“-Problem.

Nuance und Stil: In kreativen Schreibaufgaben, bei subtilen sprachlichen Nuancen oder beim Erfassen von Subtext bleiben große Modelle überlegen.

Auch OpenAI bleibt relevant, wenn du hybride Setups planst oder API-Kosten bewerten willst. Die Seite Infos rund um ChatGPT liefert dir einen strukturierten Überblick über Modellvarianten, Einsatzszenarien und Preisstruktur.

Das Router-Prinzip: SLM + LLM kombinieren

Die effektivste Architektur in 2026 ist nicht „SLM gegen LLM“, sondern „SLM plus LLM“.

Das funktioniert so: Ein schnelles SLM fungiert als Router und klassifiziert jede Nutzeranfrage. Einfache Anfragen beantwortet das lokale SLM selbst – null Kosten, null Latenz. Komplexe oder nuancierte Anfragen werden an ein Cloud-LLM eskaliert.

Dieser hybride Ansatz optimiert gleichzeitig Kosten und Qualität. Du zahlst nur für die Anfragen, die wirklich ein großes Modell brauchen.

Sobald du über hybride Architekturen nachdenkst, brauchst du einen Überblick über die großen Cloud-Modelle, die als Eskalationsstufe dienen. Der Vergleich ChatGPT vs. Claude vs. Gemini 2026 zeigt dir, welches Frontier-Modell sich als „Fallback“ am besten für komplexe oder kreative Aufgaben eignet.

SLMs auf dem Smartphone: So funktioniert On-Device-KI

Die sichtbarste Auswirkung der SLM-Revolution: KI läuft direkt auf deinem Handy. Ohne Internetverbindung, ohne Cloud, ohne Wartezeit.

Samsung Galaxy S25 und Gauss 2

Die Samsung Galaxy S25 Serie integriert „Galaxy AI“ tief ins System. Zwei Modelle arbeiten dabei zusammen:

Samsung Gauss 2 Compact ist Samsungs eigenes On-Device-Modell. Es bewältigt Anrufzusammenfassungen, Übersetzungen und Textkomposition offline – in 9 bis 14 Sprachen. Optimiert für die NPU des Snapdragon 8 Elite.

Gemini Nano (Googles Modell) übernimmt multimodale Aufgaben im Android-Ökosystem: Bildschirminhalte verstehen („Screen Awareness“), „Circle to Search“ und Betrugserkennung bei Anrufen.

Die Hardware ist darauf abgestimmt: 12 GB RAM sind Standard, damit die Modelle (je nach Quantisierung 1–4 GB groß) permanent im Speicher bleiben können.

Apple Intelligence

Apples Ansatz basiert auf einem proprietären On-Device-Modell mit rund 3 Milliarden Parametern.

Das Modell nutzt Grouped-Query Attention (GQA) und aggressive Quantisierung (durchschnittlich 3,5 Bits pro Gewicht), um in die strikten Speichergrenzen der iPhone 16/17 Serie zu passen. Es läuft nativ auf dem A18 Pro Chip.

Die Schlüsselinnovation sind LoRA-Adapter – kleine, feinabgestimmte Layer, die auf das Basis-3B-Modell geladen werden. Damit wechselt das System in Millisekunden zwischen Fähigkeiten: von „Kreativer Schreiber“ zu „Zusammenfasser“ zu „Coder“. Kein neues Modell laden, kein Warten. Das spart massiv Speicherbandbreite.

Google Pixel und Gemini Nano

Googles Pixel-Geräte treiben die Gemini-Nano-Grenze weiter voran. Mit den neuesten Varianten werden die Modelle zunehmend „agentisch“ – sie navigieren Apps, verstehen Audio- und visuellen Kontext in Echtzeit und handeln eigenständig.

Häufige Missverständnisse über Small Language Models

„SLMs sind einfach schlechtere LLMs.“ Falsch. Sie sind spezialisierte Werkzeuge. Ein DeepSeek-R1-Distill mit 1,5B Parametern schlägt GPT-4o in Mathe-Benchmarks. Das ist kein „schlechteres“ Modell – es ist ein besseres, für seinen spezifischen Zweck.

„Kleine Modelle halluzinieren zu viel für den Produktiveinsatz.“ Halluzination ist ein reales Problem – aber kein SLM-spezifisches. Die Lösung heißt RAG (Retrieval-Augmented Generation): Du koppelst das SLM mit einer Wissensdatenbank, statt dich auf sein internes Wissen zu verlassen. So halluziniert auch ein 3B-Modell kaum noch.

„Man braucht teure Hardware für lokale KI.“ Ein 3B-Modell in 4-Bit-Quantisierung braucht rund 2 GB RAM. Das schafft jedes moderne Smartphone. Selbst 7B-Modelle laufen auf einem MacBook Air mit 8 GB – knapp, aber machbar.

„Die Parameteranzahl bestimmt die Intelligenz.“ Das war 2023 noch eine vertretbare Annahme. Heute ist sie widerlegt. Architektonische Innovationen, hochwertige Trainingsdaten und Destillation haben die Kopplung zwischen Größe und Leistung aufgebrochen.

Tools: So kannst du SLMs selbst ausprobieren

Du brauchst weder Cloud-Zugang noch Programmierkenntnisse, um SLMs lokal zu nutzen. Das Tooling-Ökosystem in 2026 macht es jedem zugänglich.

Ollama

Ollama ist der De-facto-Standard für lokale Inferenz. Ein Befehl im Terminal genügt, und du hast ein Modell wie Llama 3.2 oder Gemma 3 lokal am Laufen. Ollama abstrahiert die gesamte Komplexität von Quantisierung und Hardware-Offloading.

Aktuelle Updates bringen Support für die neuesten Architekturen (Llama 4, Gemma 3) und Kompatibilität mit Entwicklertools wie Claude Code und OpenAI Codex.

LM Studio

Wer eine grafische Oberfläche bevorzugt, greift zu LM Studio. Es erlaubt dir, quantisierte Modelle (im GGUF-Format) direkt von Hugging Face zu entdecken, herunterzuladen und auszuführen. Ideal zum Experimentieren mit verschiedenen Modellgrößen und Quantisierungen.

Hardware-Anforderungen

| Modellgröße | Quantisierung | RAM-Bedarf | Beispiel-Hardware |

|---|---|---|---|

| < 1B | Q4 | < 1 GB | Raspberry Pi, Mikrocontroller |

| 3B | Q4 | ~2 GB | Smartphone (iPhone 15 Pro+, Galaxy S23+), Raspberry Pi 5 |

| 7B/8B | Q4 | ~5–6 GB | Laptop (MacBook Air M1+, 16 GB empfohlen), RTX 3060 |

| 14B+ | Q4 | ~10–12 GB | Gaming-Laptop, Desktop (RTX 3080/4070+) |

FAQ

Was sind Small Language Models? Small Language Models (SLMs) sind KI-Sprachmodelle mit weniger als 7–10 Milliarden Parametern. Sie laufen direkt auf Smartphones, Laptops oder lokalen Servern und bieten in spezialisierten Aufgaben Leistung, die mit deutlich größeren Modellen konkurriert.

Wie unterscheiden sich SLMs von LLMs? SLMs sind kompakter, schneller und günstiger. Sie eignen sich für Echtzeit-Anwendungen, datensensible Einsätze und Edge-Geräte. LLMs bieten dafür breiteres Weltwissen, bessere kreative Fähigkeiten und höhere Nuance bei komplexen Aufgaben.

Welches SLM ist das beste? Das hängt vom Einsatzzweck ab. Für Mathe und Logik ist DeepSeek-R1-Distill kaum zu schlagen. Für mobile Deployments bieten Llama 3.2 3B und Phi-4 Mini das beste Gesamtpaket. Für Code sind die Qwen-2.5-Coder-Varianten State of the Art.

Kann ich SLMs auf meinem Laptop laufen lassen? Ja. Mit Tools wie Ollama oder LM Studio kannst du 7B-Modelle auf einem Laptop mit 8–16 GB RAM betreiben. 3B-Modelle laufen sogar auf Smartphones.

Halluzinieren SLMs mehr als große Modelle? Tendenziell ja, besonders bei Faktenwissen außerhalb ihrer Trainingsverteilung. Die Lösung: SLMs mit einem RAG-System (Retrieval-Augmented Generation) koppeln, das den nötigen Kontext liefert.

Was ist Wissensdestillation? Ein Verfahren, bei dem ein kleines Modell lernt, die Denkmuster eines großen Modells zu imitieren. So „erbt“ das kleine Modell komplexe Fähigkeiten wie logisches Schließen, ohne selbst Milliarden Parameter zu benötigen.

Was bedeutet Quantisierung? Quantisierung reduziert die Speicherpräzision der Modellgewichte – etwa von 16-Bit auf 4-Bit. Das halbiert den Speicherbedarf bei minimalem Qualitätsverlust und ermöglicht den Betrieb auf schwächerer Hardware.

Fazit

Small Language Models sind keine Kompromisslösung – sie sind die nächste Evolutionsstufe der KI-Anwendung. Die Entkopplung von Modellgröße und Intelligenz durch Destillation, Quantisierung und architektonische Innovationen hat die Spielregeln verändert.

Für die Praxis bedeutet das: Starte mit einem 3B-Modell wie Llama 3.2 oder Phi-4 Mini für generische Edge-Anwendungen. Nutze DeepSeek-R1-Distill, wenn du komplexe Logik brauchst. Koppele jedes SLM mit einem RAG-System für faktische Anfragen. Und designe deine Architektur hybrid – das lokale SLM übernimmt den Alltag, das Cloud-LLM springt ein, wenn es wirklich komplex wird.

2026 ist nicht das Jahr, in dem SLMs die großen Modelle ersetzen. Es ist das Jahr, in dem sie ihren eigenen, gleichwertigen Platz in der KI-Landschaft einnehmen – als schnelle, günstige und private Spezialisten, die KI dorthin bringen, wo sie am meisten gebraucht wird: direkt zu dir.

Quellen und weitere Infos:

- Meta Llama 3.2 – (Die offizielle Seite von Meta AI bietet detaillierte Einblicke in die Architektur der Llama 3.2-Modelle, die speziell für den Einsatz auf mobilen Geräten und Edge-Hardware optimiert wurden.)

- Mistral AI – Les Ministraux – (In diesem Blogbeitrag stellt Mistral AI die Modelle Ministral 3B und 8B vor, die für lokale Inferenz und niedrige Latenzzeiten entwickelt wurden.)

- Google Gemma Ressourcen – (Die offizielle Entwicklerplattform bietet technische Dokumentationen und Anwendungsbeispiele für Googles offene Modellfamilie Gemma.)

- Qwen 2.5 Release Blog – (Alibaba Cloud präsentiert hier die technischen Durchbrüche der Qwen 2.5-Serie, insbesondere in den Bereichen Mathematik und Programmierung.)

- DeepSeek-R1 Repository – (Dieses GitHub-Repository dokumentiert die Destillationsmethoden, mit denen DeepSeek die Reasoning-Fähigkeiten großer Modelle in kompakte Architekturen überträgt.)

- The Era of 1-bit LLMs (Research Paper) – (Das wissenschaftliche Papier von Microsoft Research beschreibt die Grundlagen von BitNet b1.58 und die Zukunft extrem energieeffizienter KI-Modelle.)

- Ollama Homepage – (Ollama ist das führende Tool, um Small Language Models mit nur einem Befehl lokal auf Windows, macOS oder Linux auszuführen.)

- LM Studio – (Diese Anwendung bietet eine benutzerfreundliche grafische Oberfläche, um quantisierte Modelle von Hugging Face zu entdecken und ohne Cloud-Anbindung zu testen.)