Was ist Physical AI? Die kurze Antwort

Physical AI beschreibt KI-Systeme, die nicht nur Texte oder Bilder erzeugen – sondern physisch in der Welt handeln. Sie greifen Objekte, navigieren durch Räume und treffen in Sekundenbruchteilen Entscheidungen über reale Bewegungen. Der entscheidende Unterschied zur klassischen Automation: Physical AI wird nicht programmiert, sondern trainiert.

Während die Jahre 2023 und 2024 von Large Language Models wie GPT-4 dominiert wurden, verschiebt sich der Fokus seit 2025 auf sogenannte „Large Action Models“ und Vision-Language-Action (VLA) Modelle. Die KI verlässt den Bildschirm – und betritt die physische Welt.

Von Software zu Hardware: Der Paradigmenwechsel

Bis vor wenigen Jahren bedeutete Robotik vor allem eines: Ein Roboterarm schweißt eine Karosserie an einer exakt definierten Position. Ändert sich die Position um Millimeter, scheitert der Prozess. Physical AI bricht mit diesem Konzept.

Laut NVIDIA und Fujitsu beschreibt Physical AI Systeme, die die unstrukturierte physische Welt verstehen und mit ihr interagieren, indem sie erlernte motorische Fähigkeiten nutzen. Es ist die Symbiose aus digitaler Intelligenz – dem „Gehirn“ – und fortgeschrittener Aktorik – dem „Körper“.

Die Kommerzialisierung läuft dabei in zwei Geschwindigkeiten: Im Industriesektor setzen Unternehmen humanoide Roboter wie den Tesla Optimus bereits in der Fertigung und Logistik ein. Parallel entsteht ein Consumer-Segment, in dem Firmen wie 1X Technologies und Figure AI erste Haushaltsroboter zur Vorbestellung anbieten.

Die Entwicklung von Large Language Models war die Voraussetzung für Large Action Models – wie sich GPT & Co. historisch entwickelt haben, zeigt die Analyse zur Evolution der GPT-Modelle.

Die drei Säulen der Physical AI

Die Architektur der Physical AI ruht auf drei fundamentalen Säulen:

Embodied AI (Verkörperte KI): Die kognitive Softwarearchitektur. Foundation Models vereinen Wahrnehmung, logisches Schließen und Handlungsplanung in einem neuronalen Netz.

Moderne Mechatronik: Die Hardware hat sich von starren Industrierobotern zu biomimetischen Formen entwickelt. Dazu gehören sehnengetriebene Aktuatoren wie bei 1X Technologies oder hochpräzise elektrische Gelenke wie bei Tesla und Unitree.

Hyperrealistische Simulation und Digital Twins: Weil das Trainieren in der realen Welt teuer und gefährlich ist, lernen moderne Roboter in physikalisch korrekten virtuellen Welten – etwa im NVIDIA Omniverse. Der „Sim-to-Real“-Transfer ist der Schlüssel zur Skalierbarkeit.

Erst das Zusammenspiel dieser drei Säulen ermöglicht die aktuellen Durchbrüche.

Ambient IoT – wenn die Umgebung mitdenkt

Eine oft übersehene Komponente: Physical AI beschränkt sich nicht auf den Roboter selbst. Durch Ambient Computing wird die Umgebung intelligent. Winzige, batterielose Sensoren – etwa Wiliot IoT Pixels – erfassen Temperatur, Standort und Zustand von Objekten in Echtzeit und speisen diese Daten in die KI-Modelle ein.

Das schafft eine Rückkopplungsschleife: Der Roboter „sieht“ nicht nur mit seinen Kameras, sondern die Umgebung „teilt ihm mit“, wo sich Objekte befinden. Diese Konvergenz von IoT und Robotik macht die komplexe Logistik möglich, die in modernen vollautomatisierten Lagerhäusern („Lights-Out Warehouses“) angestrebt wird.

Foundation Models: Das Gehirn der Roboter

Der entscheidende Durchbruch – oft als „ChatGPT-Moment der Robotik“ bezeichnet – fand nicht in der Mechanik statt, sondern in der Software. Bis 2024 wurden Roboter meist modular gesteuert: Ein Modul für das Sehen, eines für die Planung, eines für die Motorsteuerung. 2026 dominieren monolithische Foundation Models, die all das in einem Modell vereinen.

Vision-Language-Action (VLA) Modelle

VLA-Modelle funktionieren ähnlich wie Large Language Models – nur geben sie keine Text-Token aus, sondern Bewegungsvektoren.

NVIDIA GR00T gilt als Referenzarchitektur für humanoide Roboter. Das multimodale Modell versteht natürliche Sprache und kann menschliche Bewegungen durch bloßes Beobachten von Videos emulieren. Mit dem Update auf GR00T N1.6 im Januar 2026 führte NVIDIA Reasoning-Fähigkeiten ein: Roboter können nun mehrdeutige Anweisungen wie „Räum das Chaos auf“ in eine logische Kette von Einzelhandlungen zerlegen – basierend auf gesundem Menschenverstand.

Google DeepMind RT-3, integriert in Gemini Robotics 1.5, geht einen anderen Weg. Das Modell verfügt über ein extremes Langzeitgedächtnis für Video-Input und kann minutenlange Demonstrationsvideos analysieren, um neue Aufgaben per „One-Shot Learning“ zu erlernen. Ein Schlüsselelement ist das „Chain-of-Thought Planning“: Bevor der Roboter handelt, generiert er intern einen Gedankengang – etwa „Das Glas ist zerbrechlich, ich muss den Greifdruck reduzieren.“ Das erhöht die Sicherheit und Fehlerkorrektur massiv.

Sobald du tiefer in Vision-Language-Action-Modelle einsteigst, stößt du zwangsläufig auf multimodale Architekturen, die Text, Bild und Sensorik kombinieren – ein strukturiertes Verständnis dafür liefert dir der Überblick zu multimodalen KI-Modellen, die sehen, hören und sprechen.

End-to-End Learning: Der Tesla-Ansatz

Tesla verfolgt einen radikaleren Weg. Sowohl bei der Full Self-Driving (FSD) Software als auch beim Optimus Roboter fließen die Rohdaten der Kameras direkt in ein neuronales Netz. Dieses gibt ohne expliziten Code die Steuerbefehle für die Aktuatoren aus.

Im Januar 2026 trainiert Tesla diese Netze auf Exabytes an Videodaten der eigenen Fahrzeugflotte und Teleoperationseinheiten. Das Ziel: eine generelle Intelligenz, die weder auf hochauflösendes Kartenmaterial noch auf vordefinierte Regeln angewiesen ist.

Agentic AI – vom Befehlsempfänger zum Agenten

Der „State of AI Report 2025″ identifiziert Agentic AI als den prägenden Trend. Roboter sind nicht mehr passive Befehlsempfänger. Sie agieren als Agenten, die Ziele verfolgen, Pläne schmieden und bei Fehlern selbstständig Korrekturen vornehmen.

Ein Beispiel: Wenn ein Roboter versucht, eine Tür zu öffnen, und diese verschlossen ist, wird er 2026 nicht mehr endlos gegen die Tür laufen. Stattdessen sucht er nach einem Schlüssel oder fordert Hilfe an. Diese Fähigkeit zur Selbstreflexion ist der Schritt von der Automation zur Autonomie.

Der Schritt vom Befehlsempfänger zum autonomen System ist kein Marketingbegriff, sondern ein architektonischer Paradigmenwechsel – genau das beleuchtet der Artikel über KI-Agenten und autonome Systeme.

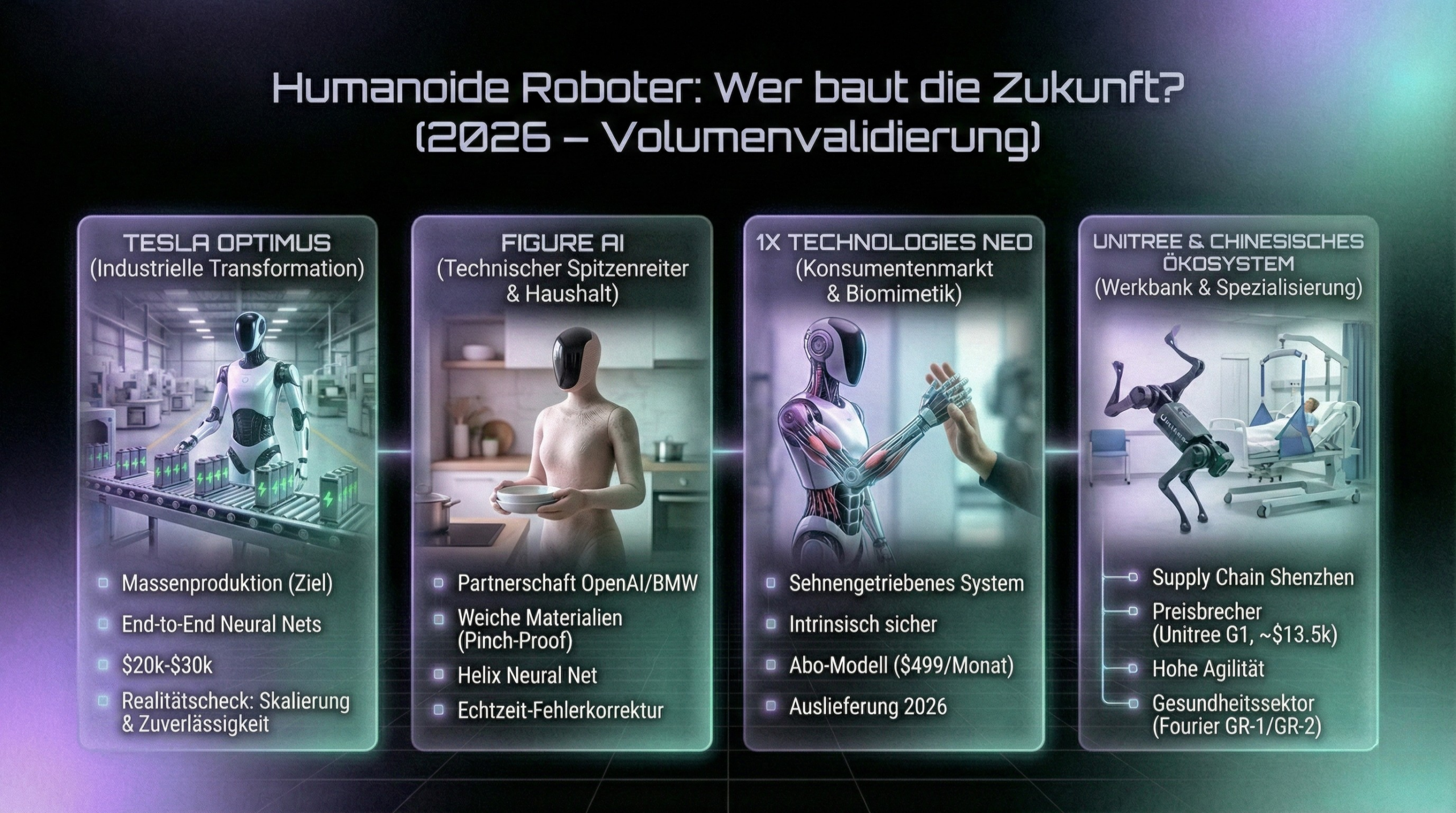

Humanoide Roboter: Wer baut die Zukunft?

Das auffälligste Merkmal der Physical AI 2026 ist die Explosion humanoider Roboterplattformen. Analysten sprechen von einer Phase der „Volumenvalidierung“ – Hersteller müssen beweisen, dass sie von Prototypen zu Serienfertigung skalieren können.

Tesla Optimus

Tesla vollzieht 2026 eine drastische industrielle Transformation. CEO Elon Musk bezeichnete die Einstellung der Produktionslinien für Model S und X im Werk Fremont als „ehrenhaften Abschied“, um Platz für die Massenproduktion des Optimus zu schaffen.

Der Optimus Gen 3 wird aktiv in der Giga Texas getestet, wo er logistische Aufgaben wie den Transport von 4680-Batteriezellen übernimmt. Tesla setzt auf End-to-End Neural Networks als Kern-KI und peilt einen Preis von 20.000 bis 30.000 US-Dollar an.

Die Realität sieht allerdings nüchterner aus: Trotz Musks Ankündigung von einer Million Einheiten pro Jahr sehen Branchenbeobachter 2026 eher als Jahr der Rekalibrierung. Die Produktion ist noch weit von diesen Stückzahlen entfernt, und die autonome Zuverlässigkeit – gemessen an der „Intervention Rate“ – bleibt ein kritisches Thema.

Autonome Fahrzeuge sind letztlich eine besonders komplexe Form von Physical AI. Wenn du die technologischen Grundlagen besser verstehen willst, findest du im ChatGPT vs. Claude vs. Gemini Vergleich 2026 eine Einordnung der zugrunde liegenden Foundation Models – viele dieser Modelle bilden die kognitive Basis für Robotik-Stacks.

Figure AI

Figure AI hat sich durch Partnerschaften mit OpenAI und BMW als technischer Spitzenreiter positioniert. Das neueste Modell Figure 03, eingeführt Ende 2025, wurde speziell für die Akzeptanz im Haushalt entwickelt. Es verfügt über eine weiche Außenhaut aus Textilien und Schaumstoff, um Verletzungsrisiken zu minimieren – inklusive sogenannter „Pinch-Proof Joints“.

Dank des „Helix“-Neuronalnetzes (einer Zusammenarbeit mit OpenAI) demonstrierte der Roboter komplexe Haushaltsaufgaben wie das Einräumen von Geschirrspülern. Besonders bemerkenswert: Er korrigierte Fehler – etwa fallengelassene Objekte – in Echtzeit.

1X Technologies NEO

Das norwegisch-amerikanische Unternehmen 1X Technologies verfolgt mit dem NEO den aggressivsten Ansatz für den Konsumentenmarkt.

Die Designphilosophie unterscheidet sich grundlegend von der Konkurrenz: Statt starrer, motorgetriebener Gelenke nutzt NEO ein sehnengetriebenes System, das der menschlichen Anatomie nachempfunden ist. Das macht den Roboter „nachgiebig“ und intrinsisch sicher – besonders wichtig für die Interaktion mit Kindern oder älteren Menschen.

Das Geschäftsmodell ist ebenso ungewöhnlich: 1X bietet NEO für 20.000 US-Dollar oder im Abo für 499 US-Dollar pro Monat an. Die Auslieferung in den USA soll im Laufe des Jahres 2026 beginnen.

Unitree und das chinesische Ökosystem

China etabliert sich als die „Werkbank“ der Physical AI, getrieben durch eine unübertroffene Supply Chain in Shenzhen.

Unitree Robotics bricht mit dem G1 Humanoiden Preisbarrieren – der Einstieg liegt bei rund 13.500 US-Dollar. Die Roboter beeindrucken mit hoher dynamischer Agilität, darunter Saltos und Kampfkunst-Demonstrationen, die ihre Überlegenheit in der Motorsteuerung unterstreichen.

Fourier Intelligence geht mit den Modellen GR-1 und GR-2 einen anderen Weg und fokussiert sich auf den Gesundheitssektor. Angesichts der demografischen Krise in China werden diese Roboter 2026 in Krankenhäusern pilotiert, um Patienten zu heben und Logistik zu übernehmen.

Autonome Mobilität: Robotaxis auf dem Vormarsch

Während humanoide Roboter noch am Anfang ihrer Kommerzialisierung stehen, erreicht die autonome Mobilität 2026 eine neue Reifestufe.

Waymo vs. Tesla – Lidar gegen Vision-Only

Der Markt spaltet sich philosophisch in zwei Lager.

Waymo (Alphabet) gilt als unangefochtener Technologieführer und expandiert 2026 erstmals nach Europa – mit einem geplanten Start in London. In den USA operiert der Dienst kommerziell in San Francisco, Phoenix, Los Angeles und Austin. Waymo setzt auf Lidar-basierte Redundanz mit mehreren Sensorsystemen. Ex-CEO John Krafcik kritisiert Teslas Ansatz scharf und bezeichnet das Fehlen von Lidar und Radar als „Myopie“ – Kurzsichtigkeit, die echte Sicherheit verhindere.

Tesla setzt mit dem Cybercab alles auf KI und Kameras. Elon Musk verkündete im Januar 2026, dass „unüberwachte“ Robotaxis in Texas bald ohne Begleitfahrzeuge operieren würden. Analysten bleiben skeptisch: Daten zeigen, dass Teslas Eingriffsraten immer noch höher sind als die von Waymo.

Cruise (General Motors) hat sich nach dem Sicherheitsdebakel von 2023/24 neu ausgerichtet. Das dedizierte „Origin“-Fahrzeug ohne Lenkrad wurde aufgegeben. Stattdessen integriert GM die Cruise-Technologie in das Super-Cruise-Assistenzsystem für Privatfahrzeuge und startet eine kleinere, konservativere Robotaxi-Flotte neu.

Europa als neues Schlachtfeld

Lange regulatorisch abgeschottet, öffnet sich Europa 2026 für autonome Flotten. Das führt zu einer bemerkenswerten Konstellation: London wird zur ersten Stadt weltweit, in der US-amerikanische (Waymo) und chinesische (Baidu Apollo) Robotaxis direkt miteinander konkurrieren.

Baidu Apollo hat eine Partnerschaft mit Lyft geschlossen, um ab 2026 Robotaxis in Großbritannien und Deutschland zu testen. Pony.ai startet parallel dazu in Luxemburg. Damit wird Europa zum geopolitischen Testfeld für den Wettbewerb zwischen amerikanischer und chinesischer Physical AI.

Physical AI in der Industrie

In der Industrie geht es bei Physical AI weniger um den Ersatz von Arbeitern – sondern um die Ergänzung durch intelligente Assistenzsysteme und flexible Automation. Der Begriff „Industrie 5.0″ beschreibt genau diesen Wandel: Mensch und Maschine arbeiten nicht gegeneinander, sondern zusammen.

Industrial Copilots – Maschinen per Sprache steuern

Siemens und Microsoft haben das Konzept des „Industrial Copilot“ zur Marktreife gebracht. Auf der CES 2026 wurden Systeme demonstriert, die es Ingenieuren erlauben, mit Maschinen in natürlicher Sprache zu kommunizieren. Ein Beispiel: „Optimiere die Greifarm-Trajektorie für 10 % weniger Energieverbrauch.“

Das klingt nach Zukunftsmusik, ist aber bereits Praxis. Zulieferer wie Schaeffler nutzen diese Tools, um SPS-Code (Speicherprogrammierbare Steuerung) automatisch zu generieren. Das Ergebnis: drastisch verkürzte Rüstzeiten und eine Demokratisierung der Programmierung. Ingenieure müssen nicht mehr jede Codezeile selbst schreiben – sie beschreiben das gewünschte Ergebnis, und der Copilot setzt es um.

Auch die gesellschaftlichen Auswirkungen sind real: Wie sich Robotik auf Beschäftigung und Qualifikationen auswirkt, analysiert der Artikel zu KI und Arbeitsplätze – realistische Einschätzung.

Das „Lights-Out“ Warehouse

In der Logistik nähert sich die Vision des menschenleeren Lagers der Realität. Agility Robotics‘ Digit Roboter haben bei GXO Logistics den Meilenstein von 100.000 bewegten Behältern („Totes“) erreicht.

Durch die Integration von Ambient IoT wissen diese Roboter jederzeit, wo sich welche Ware befindet. Das ermöglicht eine dynamische Lagerhaltung, die ohne menschliche Eingriffe funktioniert – ein sogenanntes „Lights-Out“ Warehouse, in dem buchstäblich kein Licht brennen muss, weil kein Mensch anwesend ist.

Flexible Fertigung am Edge

Rockwell Automation setzt 2026 auf autonome mobile Roboter (AMRs), die KI direkt am sogenannten „Edge“ verarbeiten – also lokal auf dem Gerät statt in der Cloud.

Durch die Integration von NVIDIAs „Nemotron Nano“, einem Small Language Model, in die Steuergeräte können Maschinen visuelle Daten lokal verarbeiten und Entscheidungen in Millisekunden treffen. Keine Latenz durch Cloud-Anbindung, keine Abhängigkeit von stabiler Internetverbindung. Das ist besonders relevant für zeitkritische Fertigungsprozesse, in denen jede Millisekunde zählt.

Simulation und der „Reality Gap“

Ein zentrales Thema der Physical AI ist die Überwindung des „Reality Gap“ – der Diskrepanz zwischen Simulation und Realität. KI-Modelle brauchen Millionen von Trainingsstunden. Das in der realen Welt zu machen, wäre unbezahlbar und gefährlich. Simulation ist daher unverzichtbar.

Sim-to-Real: Vom digitalen Training in die echte Welt

Das Problem: Was in der Simulation perfekt funktioniert, scheitert in der echten Welt oft an kleinen Abweichungen – andere Lichtverhältnisse, unebene Böden, unerwartete Hindernisse.

Neue Forschungsergebnisse zeigen hier signifikante Fortschritte. Das „Point Bridge“-Paper von 2026 demonstriert, dass durch die Nutzung von 3D-Punktwolken-Repräsentationen die Erfolgsrate beim sogenannten „Zero-Shot Transfer“ – also dem direkten Übertragen simulierter Fähigkeiten auf echte Roboter – um 66 % gesteigert werden konnte.

Digital Twins als Trainingsumgebung

Fabriken werden heute zweimal gebaut: einmal digital und einmal physisch.

Im NVIDIA Omniverse erstellen Unternehmen wie PepsiCo und Foxconn mit dem „Digital Twin Composer“ exakte digitale Kopien ganzer Produktionslinien. Roboter werden in diesen digitalen Zwillingen trainiert, bevor das physische Gebäude überhaupt existiert. Das reduziert das Risiko bei der Inbetriebnahme massiv und spart Millionen an Kosten, die bei Fehlern in der realen Welt anfallen würden.

Herausforderungen: Was Physical AI noch bremst

Trotz aller Fortschritte steht die Branche vor gewaltigen Hürden. Wer nur die Demos auf YouTube sieht, bekommt ein verzerrtes Bild.

EU AI Act und regulatorische Hürden

Ab August 2026 greift der EU AI Act vollumfänglich. Er klassifiziert KI-Systeme, die als Sicherheitskomponenten in Produkten wie Robotern oder Autos dienen, als „hochriskant“.

Was bedeutet das konkret? Hersteller müssen umfangreiche Konformitätsbewertungen durchlaufen, Datengovernance nachweisen und menschliche Aufsicht garantieren. Das schafft eine transatlantische Kluft: Während Tesla in den USA Beta-Software wie „Unsupervised FSD“ aggressiv ausrollt, wird die Einführung solcher Systeme in Europa durch strenge Compliance-Anforderungen massiv verzögert und verteuert.

Unternehmen wie Volvo Autonomous Solutions passen ihre Entwicklungsprozesse bereits präventiv an diese Regulierung an. Die zentrale Frage bleibt: Ist der EU AI Act eine Bremse für Innovation – oder ein notwendiger Sicherheitsgarant?

Batterielaufzeit und Energiedichte

Die Energiedichte von Batterien bleibt die Achillesferse der Physical AI. Humanoide Roboter erreichen oft nur 2 bis 4 Stunden Laufzeit bei hoher Last. Das macht einen 24/7-Betrieb ohne komplexe Batteriewechselsysteme schlicht unmöglich.

Solange sich hier kein Durchbruch abzeichnet, bleiben viele Einsatzszenarien – vom Haushaltsroboter bis zum Industriearbeiter in der Dauerschicht – eher Vision als Realität.

Die letzten 1 % Zuverlässigkeit

Eine Erfolgsrate von 99 % klingt beeindruckend. In der physischen Welt reicht sie nicht. Wenn ein Roboter das 100. Glas fallen lässt, ist der Schaden real – im Gegensatz zu einem Chatbot, der eine falsche Antwort gibt.

Die letzten 1 % Zuverlässigkeit – die sogenannten „Edge Cases“ – sind exponentiell schwieriger zu lösen als die ersten 90 %. Genau hier entscheidet sich, ob Physical AI den Sprung aus der kontrollierten Demo-Umgebung in den chaotischen Alltag schafft.

Marktprognosen: Zwischen Hype und Billionen-Markt

2025 war ein Rekordjahr für KI-Investments: 211 Milliarden US-Dollar flossen in den Sektor. 2026 verschiebt sich der Fokus zunehmend von Software auf Hardware – von generativer KI zu Embodied AI. VCs wie Sequoia und Lightspeed investieren massiv, etwa in die 100-Millionen-Dollar-Runde für RobCo, die modulare Industrieroboter entwickeln.

Die Marktprognosen zeigen allerdings eine enorme Bandbreite – und spiegeln damit die Unsicherheit der Branche wider.

Goldman Sachs prognostiziert einen Markt von 38 Milliarden US-Dollar bis 2035. Die Analysten sehen 2026 als das Jahr der „Volumenvalidierung“. Wenn Hersteller ihre Produktionsziele verfehlen, droht eine Korrektur der Bewertungen.

Morgan Stanley ist deutlich optimistischer und sieht bis 2050 einen Markt von 5 Billionen US-Dollar – eine Welt, in der Roboter zahlreicher sein könnten als Menschen.

Zwischen 38 Milliarden und 5 Billionen liegt ein Faktor von über 100. Das zeigt: Niemand weiß wirklich, wohin die Reise geht. Klar ist nur, dass die Richtung stimmt.

Warum Physical AI wichtig ist – und was als Nächstes kommt

Im Januar 2026 hat die Physical AI den „Proof of Concept“-Status verlassen. Die Technologie funktioniert prinzipiell. Foundation Models wie GR00T verleihen Robotern ein bisher ungekanntes Maß an Flexibilität und Verständnis.

Doch 2026 wird zur Bewährungsprobe. Die Hersteller müssen beweisen, dass ihre Systeme außerhalb von YouTube-Demos in der chaotischen Realität bestehen können. Sie müssen regulatorische Hürden meistern und Skeptiker überzeugen, dass ein Roboter im Haus sicher und nützlich ist.

Die Revolution findet statt – aber sie wird nicht über Nacht geschehen. Sie wird ein mühsamer Prozess der Skalierung von Produktion, Zuverlässigkeit und Vertrauen. Wer diesen Prozess meistert, wird die physische Ökonomie des 21. Jahrhunderts dominieren.

Quellen und weitere Infos:

- NVIDIA Project GR00T – (NVIDIA beschreibt hier die technologische Basis für ihr Foundation Model, das speziell für das Training humanoider Roboter entwickelt wurde.)

- Tesla AI & Robotics – (Auf der offiziellen KI-Plattform gibt Tesla Einblicke in die Entwicklung des Optimus-Roboters und die zugrunde liegende End-to-End-Vision-Architektur.)

- Figure AI News – (Die Website des Unternehmens dokumentiert die Fortschritte des Figure-Roboters, insbesondere die Integration von OpenAI-Modellen für die sprachbasierte Interaktion.)

- 1X Technologies – NEO Design – (Dieser Blogbeitrag stellt die anatomisch inspirierte Bauweise des NEO-Roboters vor, die ihn für den direkten Einsatz mit Menschen qualifiziert.)

- Waymo Safety Framework – (Waymo legt hier detailliert dar, wie ihr Lidar-basiertes System für autonomes Fahren die Sicherheit im städtischen Verkehr gewährleistet.)

- EU AI Act Explorer – (Dieses Portal bietet eine strukturierte Übersicht über die regulatorischen Anforderungen für hochriskante KI-Systeme in Europa.)

- Wiliot Ambient IoT – (Wiliot beschreibt die Funktionsweise ihrer IoT-Pixel, die als passive Sensoren die Umgebung für Physical AI Systeme digital erfassbar machen.)