DALL-E war jahrelang das Synonym für KI-Bildgenerierung. Doch im Jahr 2026 sieht die Realität anders aus: OpenAI hat den Namen DALL-E faktisch zu Grabe getragen und durch die GPT-Image-Modellfamilie ersetzt. Was das für dich bedeutet, welche Funktionen die neuen Modelle mitbringen und ob sich der Umstieg lohnt – das erfährst du in diesem Artikel.

Wichtig vorab: Wenn du heute in ChatGPT ein Bild generierst, nutzt du bereits GPT-Image und nicht mehr DALL-E. Der alte Name hält sich hartnäckig, aber technisch ist DALL-E 3 ein Auslaufmodell mit festem Ablaufdatum.

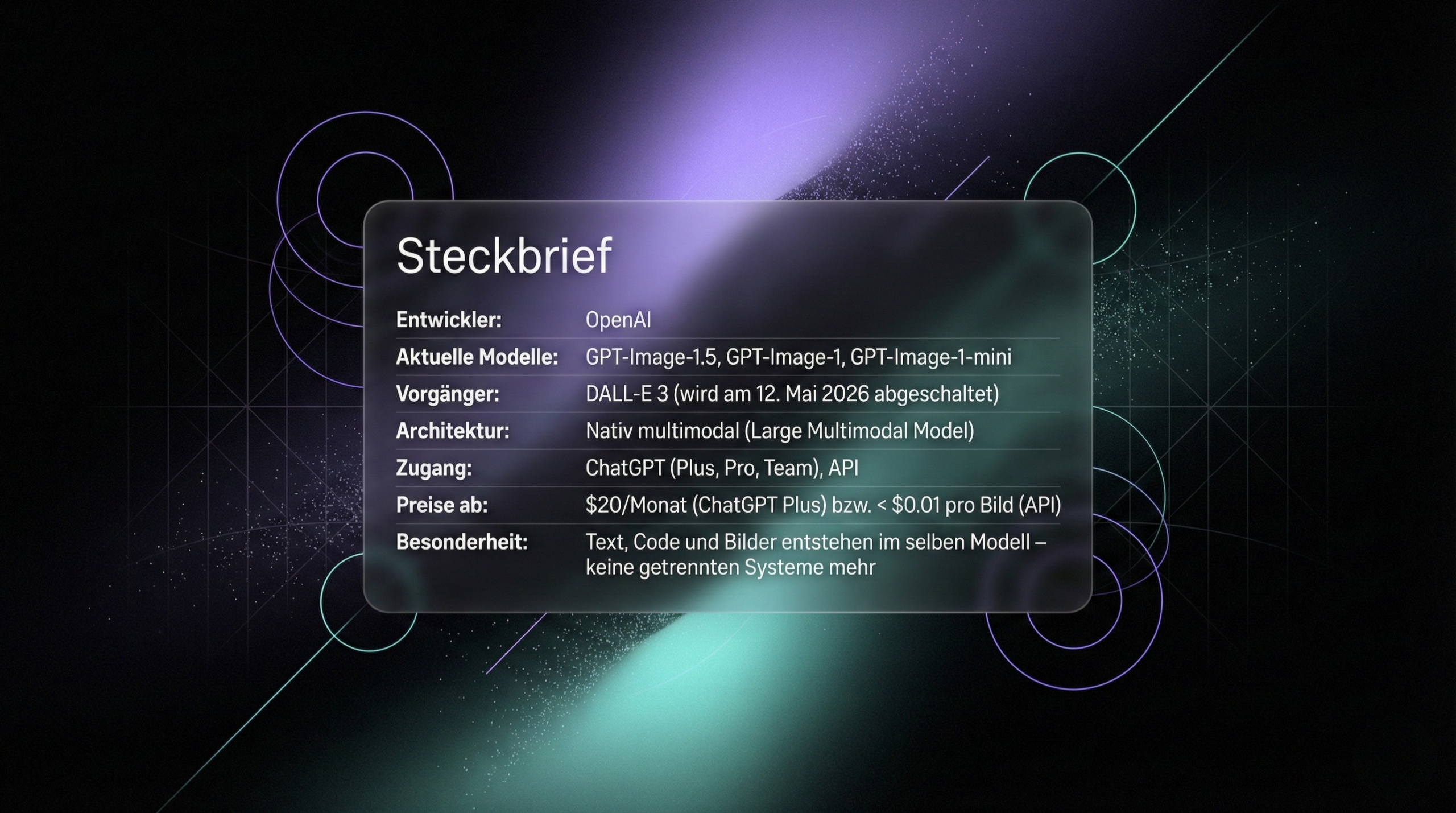

Steckbrief

| Entwickler | OpenAI |

| Aktuelle Modelle | GPT-Image-1.5, GPT-Image-1, GPT-Image-1-mini |

| Vorgänger | DALL-E 3 (wird am 12. Mai 2026 abgeschaltet) |

| Architektur | Nativ multimodal (Large Multimodal Model) |

| Zugang | ChatGPT (Plus, Pro, Team), API |

| Preise ab | $20/Monat (ChatGPT Plus) bzw. < $0.01 pro Bild (API) |

| Besonderheit | Text, Code und Bilder entstehen im selben Modell – keine getrennten Systeme mehr |

Sobald du Bildgenerierung nicht isoliert, sondern im Zusammenspiel mit Text, Code und Canvas nutzen willst, hilft dir der umfassende Guide zu allen Infos rund um ChatGPT dabei zu verstehen, wie tief GPT-Image inzwischen in das ChatGPT-Ökosystem integriert ist – inklusive Workspaces, Modelle und Tariflogik.

Für wen ist DALL-E / GPT-Image geeignet?

Content-Creator und Social-Media-Teams

Du brauchst schnell ein passendes Bild für einen Blogpost, eine Instagram-Story oder einen Newsletter? GPT-Image liefert dir innerhalb von Sekunden brauchbare Ergebnisse – direkt im ChatGPT-Chat, ohne extra Tool. Besonders praktisch: Du kannst im selben Gespräch den Begleittext schreiben lassen und das Bild dazu generieren.

Content-Creator, die GPT-Image im Alltag einsetzen wollen, profitieren von der kuratierten Übersicht zu beste KI-Tools für Content Creator, um Bild-, Text- und Video-Tools sinnvoll zu kombinieren.

Grafikdesigner und Agenturen

Für Moodboards, erste Entwürfe und schnelle Konzeptvisualisierungen ist GPT-Image ein starkes Werkzeug. Die Canvas-Oberfläche erlaubt iteratives Arbeiten, und die native Transparenz-Unterstützung macht das Tool endlich tauglich für Logo-Entwürfe und Web-Assets. Für pixelgenaue Endprodukte wirst du aber weiterhin Photoshop oder Figma brauchen.

Entwickler und App-Builder

Über die API kannst du Bildgenerierung direkt in deine Anwendung einbauen – von dynamischen Thumbnails bis hin zu personalisierten Produktvisualisierungen. Mit GPT-Image-1-mini gibt es erstmals ein Modell, das explizit auf Geschwindigkeit und niedrige Kosten bei hohem Volumen ausgelegt ist.

Unternehmen mit Brand-Workflows

Du kannst Referenzbilder und Brand Guidelines direkt hochladen. Das Modell nutzt diese als Anker für Farbpaletten, Stil und Charakterkonsistenz. In Kombination mit der Team-Version ($30/Nutzer/Monat) bekommst du zusätzlich Datenschutz – deine Daten werden nicht für das Training verwendet.

Von DALL-E zu GPT-Image: Was hat sich geändert?

DALL-E 3 – das Auslaufmodell

DALL-E 3 kam 2023 auf den Markt und war ein echtes Upgrade gegenüber seinen Vorgängern. Es nutzte einen vorgeschalteten „Captioner“, der kurze Prompts in detaillierte Bildbeschreibungen umschrieb. Das verbesserte die Prompt-Genauigkeit deutlich.

Trotzdem blieb ein Grundproblem: DALL-E 3 war im Kern ein getrenntes System. Ein Textmodell interpretierte deine Eingabe, übergab eine mathematische Repräsentation an das Bildmodell, und dieses versuchte, daraus Pixel zu machen. Bei komplexen räumlichen Anweisungen – „platziere den roten Ball exakt links vom blauen Würfel, aber in dessen Schatten“ – ging dabei regelmäßig Information verloren.

Native Multimodalität statt getrennter Bildgenerierung

GPT-Image funktioniert fundamental anders. Es ist ein sogenanntes Large Multimodal Model (LMM), das Text und Bilder nicht getrennt verarbeitet, sondern beides im selben System „denkt“.

Die technische Kerninnovation hinter GPT-Image ist seine native Multimodalität – wenn du nachvollziehen willst, was das architektonisch bedeutet, liefert der Grundlagenartikel zu multimodalen KI-Modellen, die sehen, hören und sprechen das nötige Fundament, um die Unterschiede zu klassischen, getrennten Bildgeneratoren wirklich zu verstehen.

Drei Dinge machen den Unterschied:

- Visuelle Tokenisierung. Das Modell sagt visuelle Tokens direkt aus dem Kontextfenster voraus. Es muss nicht mehr „übersetzen“, was ein roter Hut visuell bedeutet – der Begriff und die visuelle Repräsentation sind im Modell untrennbar verknüpft.

- Weltwissen. Wenn du nach einem „technischen Schema einer Dampfmaschine aus dem 19. Jahrhundert“ fragst, greift das Modell nicht nur auf visuelle Trainingsdaten zurück. Es „versteht“ die Mechanik aus seinen Textdaten und wendet diese Logik auf die visuelle Konstruktion an.

- Kontext-Bewusstsein. Das Modell behält die visuelle Konsistenz über eine Konversation hinweg bei. Dein vorheriges Bild ist Teil des Kontextfensters – nicht nur eine statische Dateireferenz. Du kannst ein Bild iterativ verfeinern, ohne dass die Komposition jedes Mal komplett neu gewürfelt wird.

Abschaltung der DALL-E-3-API am 12. Mai 2026

OpenAI hat im November 2025 offiziell die Abschaltung angekündigt. Der Zeitplan ist straff:

| Datum | Ereignis | Was das bedeutet |

|---|---|---|

| November 2025 | Offizielle Benachrichtigung | Entwickler wurden per E-Mail und Blogpost informiert |

| Januar 2026 | Legacy-Status | DALL-E 3 ist technisch veraltet, funktioniert aber noch |

| 12. Mai 2026 | Endgültige Abschaltung | API-Endpunkte werden deaktiviert, nicht migrierte Apps brechen |

Wenn du als Entwickler noch DALL-E-3-Endpunkte nutzt, musst du vor Mai 2026 auf die GPT-Image-1-API umstellen. OpenAI empfiehlt dabei die Responses API statt der reinen Images API, weil diese Text und Bild in einem einzigen Stream vereint.

Preise & Versionen

ChatGPT Plus ($20/Monat)

Du bekommst Zugang zu GPT-4o und GPT-Image-1. Die Bildgenerierung ist auf dynamische Grenzen beschränkt – typischerweise rund 50 Bilder alle 3 Stunden, abhängig von der Serverlast. Canvas und grundlegende Bearbeitungswerkzeuge sind enthalten.

Für die meisten Nutzer ist das ausreichend. Wenn du regelmäßig Bilder für Social Media oder Blogposts brauchst, kommst du damit gut zurecht.

ChatGPT Pro ($200/Monat) – Vorsicht bei den Limits

Das Pro-Abo verspricht „unlimitierten“ Zugang zu den leistungsfähigsten Modellen, darunter GPT-Image-1.5. Klingt verlockend – aber es gibt einen Haken.

Nutzer berichten von einer harten Grenze, die nach 50 bis 200 hochwertigen Bildern in kurzer Zeit greift. Die Fehlermeldung „You’ve hit the pro plan limit… limit resets in 720 hours“ sperrt dich dann effektiv für einen ganzen Monat aus der Bildgenerierung. OpenAI bezeichnet das als „Missbrauchsschutz“, aber bei einem 200-Dollar-Abo empfinden viele Nutzer das als irreführend.

Unser Rat: Der Pro-Plan lohnt sich vor allem für Nutzer, die die Rechenleistung für Code und Text brauchen. Wenn du primär Bilder generieren willst, prüfe zuerst, ob Midjourney oder Ideogram für deinen Workflow günstiger und planbarer sind.

ChatGPT Team ($30/Nutzer/Monat)

Fügt kollaborative Workspaces und einen wichtigen Datenschutz-Aspekt hinzu: Deine Daten werden nicht für das Modelltraining verwendet. Für Agenturen und Teams mit sensiblen Kundenprojekten ist das ein relevanter Punkt.

API-Preise für Entwickler

OpenAI rechnet bei GPT-Image hybrid ab – sowohl pro Bild als auch pro Token. Die Kosten hängen von Auflösung und Detailgrad ab, da ein Bild je nach Komplexität unterschiedlich viele „visuelle Tokens“ verbraucht.

| Modell / Qualität | Preis pro Bild (ca.) | Preis pro 1M Tokens (Output) | Anwendungsfall |

|---|---|---|---|

| GPT-Image-1-mini | < $0.01 | $8.00 | Thumbnails, Drafts, Massenproduktion |

| GPT-Image-1 (Low) | ~$0.011 | $40.00 | Standard-Web-Content |

| GPT-Image-1 (Medium) | ~$0.042 | $40.00 | Marketing, Social Media |

| GPT-Image-1.5 (High) | ~$0.167 | $168.00 | High-End-Produktion, Print |

Der API-Zugang ist nach Ausgabenhistorie gestaffelt. Neue Entwicklerkonten starten im Tier 1 mit nur 5–20 Bildern pro Minute. Enterprise-Kunden im Tier 5 können bis zu 8.000 Bilder pro Minute generieren.

Die wichtigsten Funktionen

Canvas: Iterative Bildbearbeitung statt One-Shot-Prompts

Canvas ist die wohl wichtigste Neuerung für den Arbeitsalltag. Statt eines linearen Chats öffnet sich ein dedizierter Arbeitsbereich, in dem du Bilder „pinnen“ und schrittweise verändern kannst.

Du kannst mit einem Pinselwerkzeug (Selection Brush) bestimmte Bereiche markieren – zum Beispiel die Hand einer Person – und eine gezielte Änderung anweisen: „Ändere das Objekt in der Hand zu einer Kaffeetasse.“ Das Modell bearbeitet dann nur diesen Bereich.

Ein Kritikpunkt: GPT-Image nutzt einen „Soft Masking“-Ansatz. Anders als in Photoshop regeneriert das Modell oft den Kontext um die Auswahl herum, um Übergänge zu glätten. Das kann dazu führen, dass sich Hintergründe ungewollt verändern. Wenn du absolute Pixel-Kontrolle brauchst, bleibt ein dediziertes Bildbearbeitungsprogramm unverzichtbar.

Text-Rendering und Typografie

Lesbarer Text in KI-Bildern war jahrelang eine Schwachstelle. GPT-Image-1.5 macht hier einen echten Sprung: Das Modell kann korrekt buchstabierten Text in komplexen Layouts erzeugen – Poster, Logos, Diagramme. Da es Text-Token direkt verarbeitet, behandelt es Text im Bild mit der gleichen linguistischen Präzision wie Text in einer Chat-Antwort.

Bei sehr kleinen Schriftgrößen oder stark stilisierten Schriftarten stößt auch dieses Modell noch an Grenzen. Für reine Typografie-Aufgaben kann Ideogram v3 die bessere Wahl sein (mehr dazu unter Alternativen).

Transparente Hintergründe (Alpha-Kanal)

Ein lang ersehntes Feature: Transparenz wird nativ unterstützt. Über die API kannst du output_format="png" mit background="transparent" anfordern. In der ChatGPT-Oberfläche reicht es, „transparenter Hintergrund“ in den Prompt zu schreiben.

Das macht GPT-Image endlich praktikabel für Logo-Design, Game-Assets, Sticker und Web-Design-Elemente – ohne den Umweg über externe Freistell-Tools.

Brand Consistency und Style References

Du kannst Referenzbilder oder ganze Brand Guidelines direkt in ChatGPT hochladen. Das Modell extrahiert die stilistischen Merkmale – Farbpalette, künstlerischer Stil, Charakterdesign – und nutzt diese als Anker für die Generierung.

Das funktioniert ähnlich wie „Style Reference“ in Midjourney oder „IP-Adapter“ in Stable Diffusion. Für Unternehmen, die konsistentes visuelles Material über verschiedene Kanäle hinweg brauchen, ist das ein echter Produktivitätsgewinn.

Inpainting und Outpainting

Inpainting bedeutet: Du bearbeitest einen bestimmten Bereich innerhalb eines Bildes, ohne den Rest zu verändern. Outpainting erweitert das Bild über seine ursprünglichen Grenzen hinaus.

Beides ist in der Canvas-Oberfläche integriert und funktioniert über natürliche Sprache. Du markierst einen Bereich und beschreibst, was sich ändern soll. Das Modell erledigt den Rest – mit den bereits erwähnten Einschränkungen beim Soft Masking.

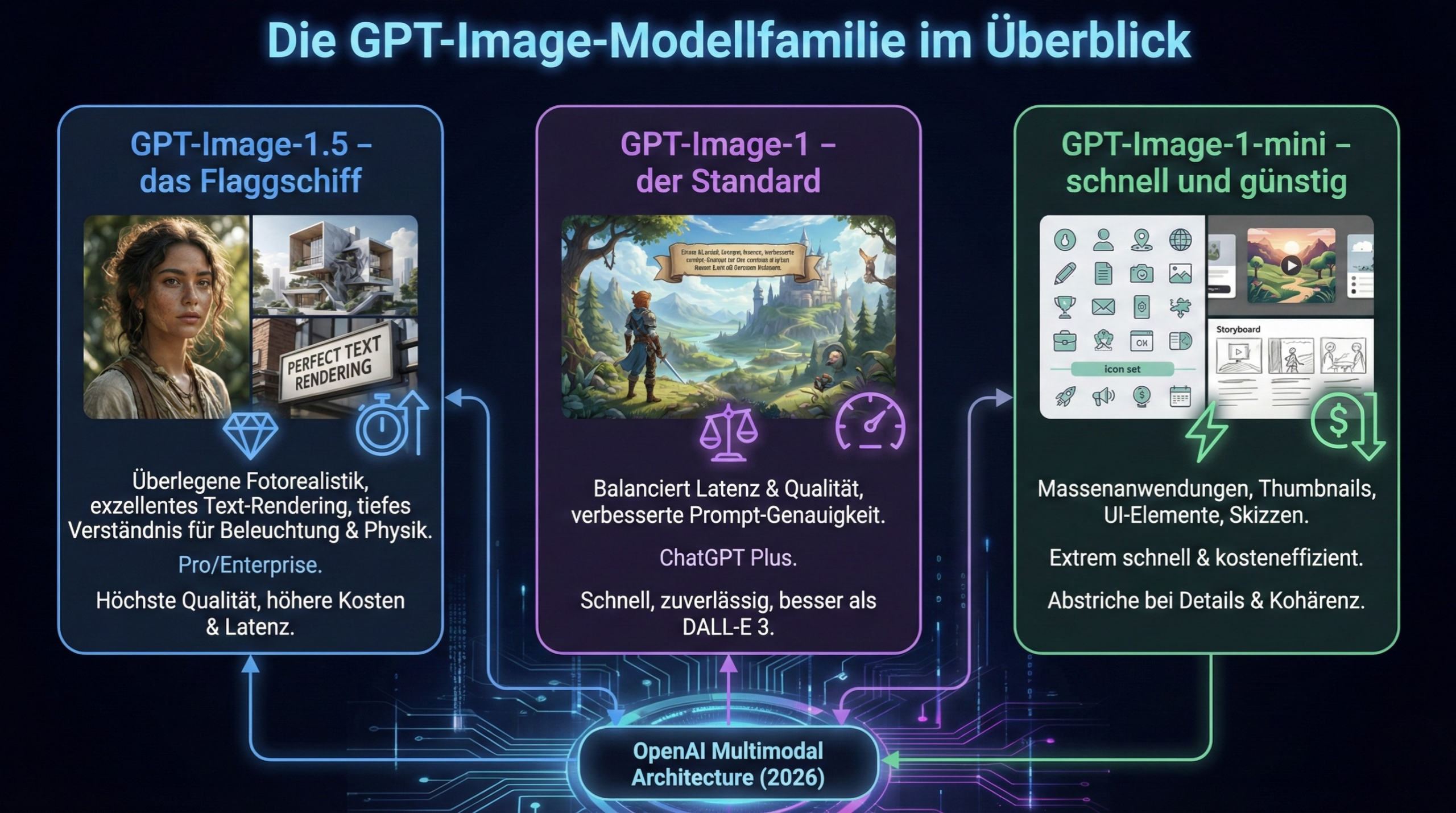

Die GPT-Image-Modellfamilie im Überblick

GPT-Image-1.5 – das Flaggschiff

Das leistungsstärkste Modell im Angebot. Es arbeitet hinter den Kulissen im Pro-Tier und in Enterprise-Umgebungen. Seine größte Stärke: überlegene Fotorealistik, die das oft „plastikartige“ Aussehen von DALL-E 3 hinter sich lässt. Dazu kommen exzellentes Text-Rendering und ein tiefes Verständnis für Beleuchtung und Materialphysik.

Der Preis dafür: höhere Kosten und längere Generierungszeiten. GPT-Image-1.5 ist das Modell für Anwendungsfälle, bei denen Qualität über allem steht.

GPT-Image-1 – der Standard

Das Arbeitspferd der aktuellen Generation. Es balanciert Latenz und Qualität und ist das Modell, das die meisten ChatGPT-Plus-Nutzer erleben. Es übertrifft DALL-E 3 in der Prompt-Genauigkeit deutlich, erreicht aber nicht ganz die texturelle Feinheit des 1.5-Modells. Dafür ist es schnell genug für einen flüssigen Chat-Dialog.

GPT-Image-1-mini – schnell und günstig

Neu im Jahr 2026: ein explizites Mini-Modell für Bilder. Es richtet sich an Entwickler mit Massenanwendungen – dynamische Thumbnails, UI-Elemente, Storyboard-Skizzen. Extrem schnell und kosteneffizient, aber mit Abstrichen bei Details und Kohärenz in komplexen Szenen.

Bekannte Schwächen und Kritikpunkte

„The Gloom“ – der gedämpfte Look

In Foren und auf Reddit taucht immer wieder ein Kritikpunkt auf: GPT-Image-Bilder wirken „gedämpft“, mit einem leichten Sepia-Schleier. Nutzer beschreiben das Phänomen als „The Gloom“ – eine emotionale Schwere, die im Kontrast zur lebhaften, oft chaotischen Kreativität von DALL-E 3 steht.

Die wahrscheinliche Ursache: Aggressives Reinforcement Learning from Human Feedback (RLHF). Um Sicherheit und Fotorealismus zu maximieren, wurde das Modell so stark optimiert, dass stilistische Ausreißer und kreative „Wildheit“ unterdrückt werden. Wer knallige, experimentelle Bilder will, ist bei Midjourney oft besser aufgehoben.

Soft Masking statt Pixel-Kontrolle

Die Bearbeitungswerkzeuge in Canvas sind mächtig – aber nicht pixelgenau. Wenn du einen Bereich änderst, passt das Modell oft auch die Umgebung an, um weiche Übergänge zu erzeugen. Das kann gewollt sein, führt aber bei Power-Usern zu Frust, wenn sich Hintergründe ungewollt verändern.

Undurchsichtige Nutzungslimits beim Pro-Plan

Das 200-Dollar-Pro-Abo wirbt mit „unlimitiertem“ Zugang. In der Praxis berichten Nutzer von harten Grenzen nach wenigen hundert Bildern, gefolgt von einer 720-Stunden-Sperre (also effektiv einem Monat). OpenAI kommuniziert diese Limits nicht transparent, was für berechtigten Unmut sorgt.

Sicherheit und Kennzeichnung

C2PA-Wasserzeichen in jedem Bild

Jedes von GPT-Image generierte Bild enthält C2PA-Metadaten (Coalition for Content Provenance and Authenticity). Diese kryptografische Signatur überlebt grundlegende Bearbeitungen wie Zuschneiden und Skalieren. Plattformen wie X, LinkedIn und Meta können den Inhalt damit automatisch als „KI-generiert“ kennzeichnen.

Für Unternehmen ist das mittlerweile auch eine rechtliche Anforderung: Die Herkunft von Marketing-Assets muss nachweisbar sein, um Klagen wegen irreführender Werbung zu vermeiden.

Umgang mit Personen des öffentlichen Lebens

OpenAI hat das absolute Verbot von Bildern öffentlicher Personen gelockert. Bilder mit satirischem oder künstlerischem Kontext sind unter bestimmten Bedingungen möglich. Gleichzeitig gelten strikte Regeln: Nicht-einvernehmliche intime Bilder (NCII) führen zu sofortigen Kontosperrungen, und es existiert eine Opt-Out-Liste für Prominente, die die Nutzung ihres Ebenbildes untersagt haben.

Deepfake-Gesetzgebung und Over-Refusals

Mit Gesetzen wie dem „Data (Use and Access) Act 2025″ im Vereinigten Königreich ist die Erstellung von Deepfakes zur Straftat geworden. OpenAIs Systeme sind entsprechend kalibriert und nehmen bewusst „Over-Refusals“ in Kauf – also übertriebene Ablehnungen bei eigentlich harmlosen Anfragen, um rechtlich abgesichert zu sein. Das kann im Alltag frustrierend sein, ist aber die Konsequenz aus der aktuellen Regulierungslandschaft.

Alternativen zu DALL-E / GPT-Image

Midjourney v7 – für High-End-Ästhetik und Kunst

Midjourney v7 bleibt der König der künstlerischen Ästhetik. Nutzer bewerten es konsistent höher bei Textur, Beleuchtung und „kinematischem Gefühl“. Es hat die Discord-Exklusivität hinter sich gelassen und bietet einen Web-Editor mit Panning-, Zoom- und Retexturing-Tools. Das Feature „Omni Reference“ erlaubt es, Charakter- und Stilreferenz gleichzeitig zu verarbeiten – essenziell für Storyboard-Artists und Comic-Zeichner.

Wenn du Bilder brauchst, die eine „künstlerische Seele“ haben statt eines polierten Stock-Photo-Looks, ist Midjourney die bessere Wahl.

Sobald du GPT-Image ernsthaft mit anderen Tools vergleichen willst, führt kaum ein Weg am großen KI-Bildgeneratoren-Vergleich Midjourney vs. OpenAI vs. Leonardo AI vorbei, weil du dort systematisch Qualität, Preis und Workflow gegeneinander abwägen kannst.

Ideogram v3 – für Typografie und Grafikdesign

Ideogram v3 dominiert die Nische für Grafikdesign. Während GPT-Image Text „buchstabieren“ kann, kann Ideogram ihn „designen“: Kerning, Schriftgewichtung, Text um Objekte gewickelt – das beherrscht kein anderes Tool so gut. Dazu kommt eine Batch-Generierung (z.B. 100 Logo-Varianten auf einmal), was es für Print-on-Demand-Händler zur ersten Wahl macht.

Die API ist aggressiv bepreist ($0.03–$0.09 pro Bild) und damit deutlich günstiger als GPT-Image für spezifische Design-Workflows.

Für alle, die vor allem Logos, Poster oder typografische Layouts bauen, lohnt sich ein Blick in den Spezialtest zu Ideogram 2.0 – Text-in-Bild-Spezialist, um zu verstehen, wo GPT-Image beim Design noch an Grenzen stößt.

Google Nano Banana (Gemini) – für Google-Workspace-Nutzer

Googles Bildgenerierung ist tief in das Gemini-Advanced-Ökosystem und Google Workspace (Docs, Slides) integriert. Wenn du ohnehin in Googles Welt arbeitest, ist die nahtlose Einbindung ein Pluspunkt.

Die Schwächen: Frühe Reviews deuten auf einen stärkeren „Uncanny Valley“-Effekt hin – zu glatte Haut, zu perfekte Gesichter. Zudem sind die Sicherheitsfilter notorisch übervorsichtig, was die Nutzung oft frustrierend macht.

Stable Diffusion 3.5 / Flux – für lokale Kontrolle und Fine-Tuning

Open-Weight-Modelle wie Stable Diffusion 3.5 und Flux 1.1 Pro dominieren den Markt für lokale Installationen. Der entscheidende Vorteil: Mit ControlNet und LoRA kannst du kleine Adapter auf eigene Gesichter oder Produkte trainieren und konsistente Bilder lokal generieren – ein Level an Fine-Tuning, das OpenAI aus Sicherheitsgründen nicht erlaubt.

Flux 1.1 Pro ist dabei bekannt für extreme Geschwindigkeit (bis zu 6x schneller als SD 3.5) und starke Prompt-Adherence.

Wenn Geschwindigkeit und Kosten im Vordergrund stehen, liefert der Praxistest zu Flux – Open-Source-Bildgenerierung im Test wertvolle Einblicke, wie stark sich Performance und Prompt-Adherence im Open-Weight-Bereich entwickelt haben.

Aktuelle Updates

November 2025: OpenAI kündigt offiziell die Deprecation von DALL-E 3 an. Entwickler werden per E-Mail und Blogpost informiert.

Januar 2026: DALL-E 3 erhält den Legacy-Status. Es funktioniert noch, bekommt aber keine Updates oder Support mehr. GPT-Image-1 und 1.5 sind der neue Standard in ChatGPT.

12. Mai 2026 (geplant): Endgültige Abschaltung der DALL-E-3-API. Nicht migrierte Anwendungen geben ab diesem Tag Fehlermeldungen zurück.

FAQ

Was ist der Unterschied zwischen DALL-E und GPT-Image?

DALL-E war ein separates Bildgenerierungsmodell, das Anweisungen von einem Textmodell empfing. GPT-Image ist nativ multimodal – es versteht Text und Bilder im selben System. Das Ergebnis: bessere Prompt-Genauigkeit, iterative Bearbeitung und ein tieferes Verständnis für komplexe Anweisungen.

Wann wird DALL-E 3 abgeschaltet?

Die API-Endpunkte für DALL-E 3 werden am 12. Mai 2026 unwiderruflich abgeschaltet. In ChatGPT selbst ist GPT-Image bereits der Standard.

Kann GPT-Image lesbaren Text in Bilder schreiben?

Ja, und zwar deutlich besser als DALL-E 3. GPT-Image-1.5 kann korrekt buchstabierten Text in komplexen Layouts erzeugen – Poster, Logos, Diagramme. Bei sehr kleinen Schriftgrößen oder stark stilisierten Fonts gibt es noch Einschränkungen.

Wie viele Bilder kann ich mit ChatGPT Plus generieren?

Die Grenzen sind dynamisch und hängen von der Serverlast ab. Typischerweise sind es rund 50 Bilder alle 3 Stunden. Die genauen Limits kommuniziert OpenAI nicht transparent.

Budget ist kein Nebenthema, sondern ein strategischer Hebel – der praxisnahe Leitfaden zu KI-Tool-Kosten & Budget-Guide hilft dir, Abo-Modelle wie Plus, Pro oder Team realistisch einzuordnen und langfristig zu planen.

Sind KI-generierte Bilder als solche erkennbar?

Jedes GPT-Image-Bild enthält C2PA-Metadaten – eine kryptografische Signatur, die grundlegende Bearbeitungen überlebt. Plattformen wie X, LinkedIn und Meta können Bilder damit automatisch als KI-generiert kennzeichnen.

Lohnt sich der Pro-Plan für Bildgenerierung?

Nur bedingt. Der Pro-Plan ($200/Monat) bietet Zugang zu GPT-Image-1.5, hat aber undurchsichtige Nutzungslimits. Nutzer berichten von Sperren nach wenigen hundert Bildern. Für Power-User im Bildbereich können Midjourney oder Ideogram planbarer und günstiger sein.

Fazit + Nächste Schritte

DALL-E ist Geschichte – GPT-Image ist die Zukunft von OpenAIs Bildgenerierung. Der Übergang von einem getrennten Bildgenerator zu einem nativ multimodalen System ist kein simples Upgrade, sondern ein Generationswechsel.

Die Stärken von GPT-Image liegen klar bei komplexen Instruktionen, Text-Rendering, Transparenz und der Integration in Business-Workflows. Die Schwächen – der gedämpfte Look, die undurchsichtigen Limits beim Pro-Plan und das Soft Masking – zeigen, dass das System noch nicht perfekt ist.

Unsere Empfehlungen:

Für Entwickler: Migriere deine Codebasis vor Mai 2026 von DALL-E 3 auf die GPT-Image-1-API. Nutze die Responses API für die beste Integration.

Für Content-Creator: ChatGPT Plus reicht für die meisten Anwendungsfälle. Arbeite im Canvas-Modus und nutze iterative Bearbeitung statt „One-Shot“-Prompts.

Für Designer: Kombiniere GPT-Image mit spezialisierten Tools. Midjourney v7 für Ästhetik, Ideogram v3 für Typografie, GPT-Image für Logik und Business-Integration.

Für Unternehmen: Investiere in Brand Guidelines als Referenzmaterial und nutze die Team-Version für Datenschutz. Prüfe den Pro-Plan kritisch, bevor du dich festlegst.

Die beste Strategie für 2026: Betrachte das Bild nicht als Endprodukt eines einzelnen Befehls, sondern als Ergebnis eines Gesprächs zwischen dir und der KI. Iterative Ko-Kreation im Canvas – das ist der Workflow, der die besten Ergebnisse liefert.