Fazit vorweg: Lohnt sich Windsurf?

Ja – für die meisten Entwickler ist Windsurf im Februar 2026 das beste Preis-Leistungs-Paket unter den KI-Code-Editoren. Für 15 Dollar im Monat bekommst du unbegrenzten Zugriff auf das hauseigene SWE-1.5-Modell, das mit 950 Token pro Sekunde schneller generiert als jede vergleichbare Alternative. Dazu kommen agentische Funktionen wie Cascade, Megaplan und der Arena Mode, die über bloße Code-Vervollständigung weit hinausgehen.

Windsurf ist nicht perfekt: Die Oberfläche wirkt weniger poliert als bei Cursor, und die schnelle Release-Kadenz bringt gelegentlich Bugs mit. Aber wer Geschwindigkeit, Tiefe und ein faires Preismodell sucht, findet hier aktuell den höchsten Return on Invest.

Wer KI-gestütztes Coding strategisch angehen will, braucht einen strukturierten Marktüberblick statt Einzelmeinungen – genau dafür ist der umfassende Coding-Assistenten-Vergleich: GitHub Copilot vs. Cursor vs. Windsurf ideal, weil du dort Funktionen, Preise und agentische Tiefe direkt nebeneinander siehst und fundierter entscheiden kannst, welches Tool wirklich zu deinem Workflow passt.

Windsurf im Steckbrief

| Eigenschaft | Details |

|---|---|

| Entwickler | Cognition (ehemals Codeium) |

| Basis | Visual Studio Code (Fork) |

| Hauseigenes Modell | SWE-1.5 (950 Token/s) |

| Weitere Modelle | Claude Opus 4.6, GPT-5.3-Codex-Spark, Gemini 3 Flash u. a. |

| Plattformen | macOS (Apple Silicon & Intel), Windows, Linux (inkl. ARM64) |

| Preis ab | 0 $ (Free) / 15 $ pro Monat (Pro) |

| Aktuelles Release | Wave 14 (stabil), Wave 15 (Preview) |

Preise & Pläne

Free-Plan

Der Einstieg kostet nichts. Du bekommst 25 Credits pro Monat, unbegrenztes Tab-Autocomplete und grundlegenden Zugang zu Cascade. Für gelegentliches Ausprobieren reicht das – für ernsthaftes Arbeiten nicht.

Pro-Plan (15 $/Monat)

Hier wird es interessant. Der Pro-Plan enthält 500 Credits pro Monat und – das ist der entscheidende Punkt – unbegrenzte Nutzung des SWE-1.5-Modells. Das hauseigene Modell verbraucht keine Credits. Nur wenn du auf Premium-Modelle wie Claude Opus 4.6 oder GPT-5.3 wechselst, werden Credits abgezogen. Wer mehr braucht, kauft 250 zusätzliche Credits für 10 Dollar nach.

Im Vergleich: Cursor kostet 20 Dollar pro Monat und limitiert Premium-Modelle oft deutlich strikter.

Teams & Enterprise

Der Teams-Plan liegt bei 30 Dollar pro Nutzer und Monat, inklusive zentralem Billing und Admin-Dashboard. Enterprise-Kunden verhandeln individuelle Konditionen und erhalten mindestens 1.000 Credits pro Nutzer, SSO, RBAC und die Option auf Hybrid Deployment.

| Plan | Preis | Credits | Kern-Features |

|---|---|---|---|

| Free | 0 $ | 25/Monat | Tab-Autocomplete, Basis-Cascade |

| Pro | 15 $/Monat | 500/Monat | Unbegrenzt SWE-1.5, Premium-Modelle, Fast Context |

| Teams | 30 $/Nutzer | 500/Nutzer | Zentrales Billing, Admin-Dashboard, Priority Support |

| Enterprise | Custom | 1.000+/Nutzer | SSO, RBAC, Hybrid Deployment, Compliance-Pakete |

Windsurf einrichten: Setup & Migration

Der Umstieg ist bewusst einfach gehalten. Windsurf basiert auf VS Code – du kannst deine bestehenden Einstellungen, Keybindings und Erweiterungen mit einem Klick importieren. Wer von Cursor oder VS Code kommt, fühlt sich sofort zuhause.

Die IDE läuft auf macOS (Apple Silicon und Intel), Windows und Linux. Seit Februar 2026 gibt es auch ARM64-Support für Linux. Die Installation dauert wenige Minuten, danach indexiert Windsurf dein Projekt lokal – je nach Größe der Codebasis kann das beim ersten Mal etwas Zeit beanspruchen.

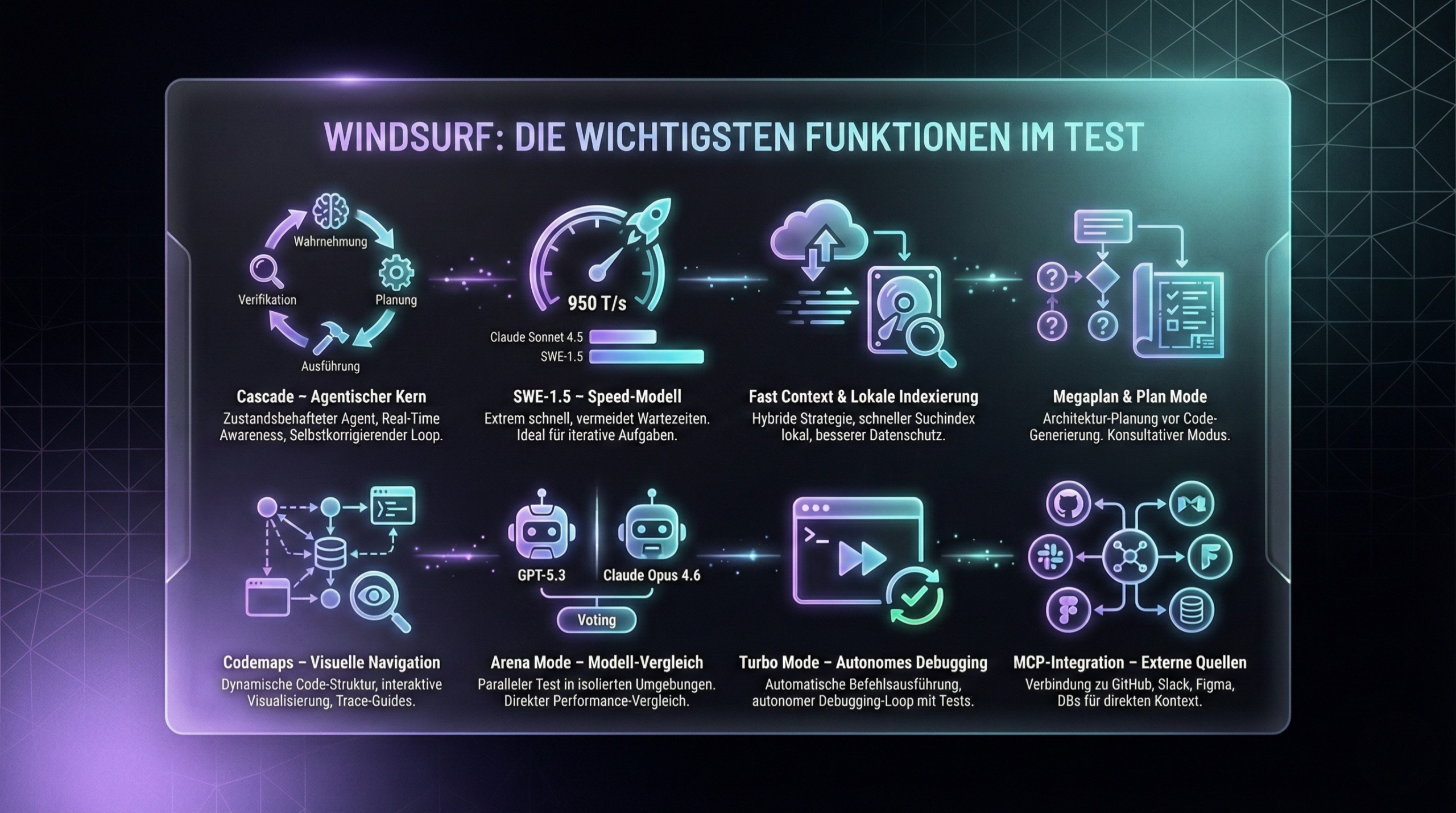

Die wichtigsten Funktionen im Test

Cascade – der agentische Kern

Cascade ist das Herzstück von Windsurf und weit mehr als ein Chatfenster. Es handelt sich um einen zustandsbehafteten Agenten mit „Real-Time Awareness“: Cascade sieht nicht nur den Code, den du markierst, sondern überwacht kontinuierlich Cursor-Positionen, offene Tabs, Terminal-Ausgaben und Dateiänderungen.

Der typische Cascade-Workflow funktioniert als Loop: Wahrnehmung → Planung → Ausführung → Verifikation. Gibst du den Auftrag, einen Bug zu fixen, analysiert Cascade den Stack Trace, findet die betroffenen Dateien, plant die Korrektur, führt sie durch und prüft das Ergebnis anhand von Linter- oder Testausgaben. Schlägt die Validierung fehl, korrigiert sich der Agent selbstständig.

Das klingt nach Marketingversprechen, funktioniert in der Praxis aber erstaunlich zuverlässig – zumindest bei klar eingegrenzten Aufgaben. Bei sehr großen Monorepos oder verschachtelten Abhängigkeiten stößt Cascade gelegentlich an Grenzen.

Die eigentliche Revolution hinter Cascade liegt im Agenten-Ansatz – wenn du verstehen willst, was autonome Systeme technisch ausmacht, liefert der Grundlagenartikel zu KI-Agenten – was sind autonome Systeme? das nötige Fundament, damit du einschätzen kannst, warum ein zustandsbehafteter Agent mehr ist als nur ein Chatfenster.

SWE-1.5: Das hauseigene Modell

SWE-1.5 ist nicht das „klügste“ Modell auf dem Markt. Claude Opus 4.6 und GPT-5.3 übertreffen es bei komplexer Logik. Aber SWE-1.5 ist das schnellste: 950 Token pro Sekunde, rund 13-mal schneller als Claude Sonnet 4.5.

Warum das zählt? Windsurf nennt es die Vermeidung des „Semi-Async Valley of Death“ – jener Wartezeit, die zu lang ist, um auszuhalten, aber zu kurz, um sinnvoll den Kontext zu wechseln. In der Praxis bedeutet das: Du gibst eine Anweisung und hast das Ergebnis in wenigen Sekunden. Für Standard-Refactorings, Boilerplate-Code und iterative Fehlerbehebung reicht die Qualität locker aus. Für architektonische Grundsatzentscheidungen wechselst du besser auf Opus oder GPT-5.3.

Auf dem SWE-bench-Pro-Benchmark erreicht SWE-1.5 eine Lösungsrate von rund 40 %, etwas unter Claude Sonnet 4.5 mit knapp 44 %. Die 14-fache Geschwindigkeit gleicht das im Alltag mehr als aus.

Fast Context & lokale Indexierung

Windsurf setzt auf eine hybride Indexierungsstrategie namens Fast Context. Anders als viele Konkurrenten, die rein cloudbasierte Embeddings nutzen, liegt der Suchindex primär lokal auf deiner Maschine.

Zwei Vorteile: Erstens ist die Suche extrem schnell – Windsurf nutzt proprietäre Modelle namens SWE-grep und SWE-grep-mini, die laut Anbieter bis zu zehnmal schneller arbeiten als Retrieval-Methoden auf Basis von Frontier-Modellen. Zweitens verlässt dein Code bei lokaler Indexierung nicht das Gerät (nur die eigentliche Inferenz geht in die Cloud).

Dazu kommt die parallele Ausführung von bis zu acht Tool Calls pro Runde. In der Praxis braucht Cascade dadurch rund vier Turns bis zum Ergebnis – bei klassischen Ansätzen sind es oft zehn oder mehr.

Die lokale Indexierung von Windsurf lässt sich besser verstehen, wenn du das Prinzip hinter Retrieval-Ansätzen kennst – im Grundlagenartikel RAG erklärt – wie LLMs externes Wissen nutzen erfährst du, wie hybride Suchstrategien funktionieren und warum „Fast Context“ ein Performance-Vorteil sein kann.

Megaplan & Plan Mode

Ein häufiges Problem bei KI-Coding-Tools: Sie produzieren sofort Code, ohne die Architektur zu durchdenken. Windsurf adressiert das mit dem Plan Mode.

Aktivierst du den Befehl „megaplan“, wechselt Cascade in einen konsultativen Modus. Der Agent analysiert die Codebasis, stellt gezielte Rückfragen und erstellt einen detaillierten Markdown-Implementierungsplan. Erst nach deiner Freigabe beginnt die eigentliche Umsetzung.

Das simuliert den Workflow zwischen einem Architekten und einem Implementierer. Gerade bei komplexen Refactorings – etwa dem Umbau einer Authentifizierungsschicht oder der Migration einer API-Version – reduziert das logische Fehler spürbar.

Codemaps: Visuelle Code-Navigation

Codemaps generieren dynamische, visuelle Darstellungen deiner Code-Struktur. Module werden logisch gruppiert, Abhängigkeiten als Verbindungen dargestellt. Anders als statische UML-Diagramme sind Codemaps interaktiv und KI-annotiert: Du kannst hineinzoomen und Trace-Guides sehen, die erklären, wie Daten durch das System fließen.

Besonders wertvoll ist das beim Onboarding in fremde oder Legacy-Projekte. Statt stundenlang Ordnerstrukturen zu durchforsten, bekommst du in Sekunden einen visuellen Überblick.

Arena Mode: Modelle direkt vergleichen

Der Arena Mode (eingeführt mit Wave 14) ist eine der cleversten Funktionen. Du lässt zwei Modelle – zum Beispiel GPT-5.3 und Claude Opus 4.6 – parallel an derselben Aufgabe arbeiten und vergleichst die Ergebnisse Seite an Seite.

Technisch nutzt Windsurf Git Worktrees, um für jeden Agenten eine isolierte Umgebung zu schaffen. Die Dateiänderungen der beiden Modelle überschreiben sich nicht gegenseitig. Per Voting-Button wählst du das bessere Ergebnis. Die Daten fließen in ein globales Leaderboard ein, das eine realistische Einschätzung der Modellperformance unter echten Arbeitsbedingungen liefert.

Wenn du regelmäßig zwischen ChatGPT, Claude und Gemini wechselst, bekommst du im großen Vergleich ChatGPT vs. Claude vs. Gemini 2026 ein Gefühl dafür, welches Modell sich für welche Aufgaben eignet – eine Entscheidung, die auch in Windsurf über Kosten und Ergebnisqualität entscheidet.

Turbo Mode: Autonomes Debugging

Der Turbo Mode erlaubt es Cascade, Terminal-Befehle automatisch auszuführen – ohne dass du jeden Befehl einzeln bestätigst. Das ermöglicht einen fast autonomen Debugging-Loop: Der Agent sieht einen Fehler, schreibt einen Test, führt ihn aus, sieht das Scheitern, korrigiert den Code und führt den Test erneut aus – bis alles grün ist.

Für sicherheitskritische Befehle (Datenbank-Löschungen, Deployment-Kommandos) lassen sich Allow- und Deny-Lists konfigurieren. Das gibt dir die Kontrolle zurück, wo du sie brauchst.

MCP-Integration (Figma, GitHub, Slack & Co.)

Das Model Context Protocol (MCP) verbindet externe Datenquellen und Werkzeuge direkt mit Cascade. Du kannst Server für GitHub, Slack, PostgreSQL oder Figma integrieren.

Ein praktisches Beispiel: Verbindest du Figma, liest der Agent Design-Spezifikationen direkt aus der API und generiert passenden CSS-Code – ohne Screenshots oder manuelles Kopieren von Werten. Seit den jüngsten Updates lässt sich granular steuern, welche MCP-Server in einer Sitzung aktiv sind, um Kontextfenster und Kosten zu optimieren.

Welche KI-Modelle stecken drin?

Windsurf verfolgt eine modellagnostische Strategie. Du bist nicht auf ein einziges Modell festgelegt, sondern wählst je nach Aufgabe.

| Modell | Anbieter | Stärke | Einsatzszenario |

|---|---|---|---|

| SWE-1.5 | Cognition | Geschwindigkeit (950 t/s) | Standard-Refactoring, Boilerplate, iterative Fehlerbehebung |

| Claude Opus 4.6 | Anthropic | Reasoning & Logik | Komplexe Architekturplanung, Race Conditions debuggen |

| GPT-5.3-Codex-Spark | OpenAI | Latenz & Tooling | Optimiert für agentische Loops (neu seit 12. Feb. 2026) |

| Gemini 3 Flash | Riesiges Kontextfenster | Analyse großer Monorepos oder Log-Dateien |

Die Arena-Leaderboard-Daten vom Februar 2026 zeigen: Claude Opus 4.6 führt mit einem ELO von 1.074 bei reiner Intelligenz. SWE-1.5 (ELO 1.015) wird im Alltag trotzdem oft bevorzugt, weil eine 95-Prozent-Lösung in 3 Sekunden häufig nützlicher ist als eine 99-Prozent-Lösung in 45 Sekunden.

Windsurf im Alltag: Workflow & Benutzererfahrung

Der Alltag mit Windsurf fühlt sich nach einer kurzen Eingewöhnung flüssig an. Die Basis ist vertraut (VS Code), die KI-Funktionen fügen sich als zusätzliche Schicht ein, ohne den gewohnten Workflow zu zerstören.

Was positiv auffällt: Die Geschwindigkeit von SWE-1.5 sorgt dafür, dass sich die Interaktion mit dem Agenten fast wie ein Gespräch anfühlt. Du fragst, du bekommst eine Antwort – ohne spürbares Warten. Die lokale Indexierung hält die Suchergebnisse relevant, und die parallelen Tool Calls beschleunigen den gesamten Prozess.

Was weniger gut läuft: In sehr großen Monorepos berichten Nutzer von „halluzinierten“ Dateipfaden. Gelegentlich gerät Cascade in Endlosschleifen, wenn es Linter-Fehler zu beheben versucht, die es selbst verursacht hat. Und die lokale Indexierung treibt die RAM- und CPU-Nutzung nach oben – wer auf einem älteren Laptop arbeitet, spürt das. Updates im Januar und Februar 2026 haben die Ressourcennutzung aber spürbar verbessert.

Ein Tipp: Nutze den „Stable“-Release-Kanal. Der „Windsurf Next“-Kanal (Beta) bietet die neuesten Features, gilt aber als experimentell.

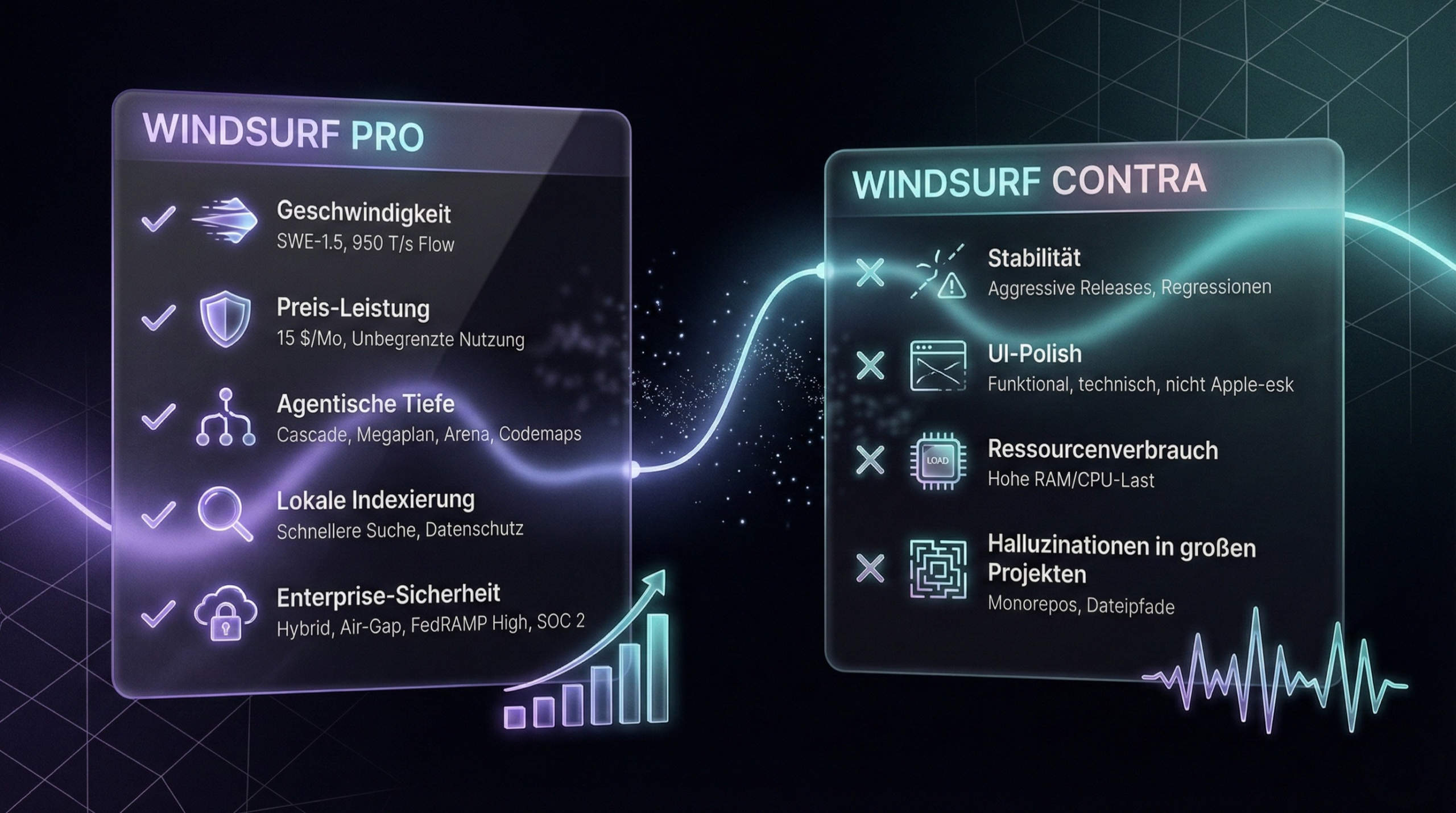

Pro: Was Windsurf gut macht

Geschwindigkeit. SWE-1.5 mit 950 Token pro Sekunde hält dich im Flow. Das ist kein Benchmark-Detail, sondern ein echtes UX-Feature.

Preis-Leistung. 15 Dollar pro Monat mit unbegrenzter Nutzung des Hausmodells – günstiger als Cursor (20 $) bei vergleichbarem oder besserem Funktionsumfang.

Agentische Tiefe. Cascade, Megaplan, Arena Mode und Codemaps gehen weit über Code-Vervollständigung hinaus. Hier arbeitet ein Agent, kein Autocomplete.

Lokale Indexierung. Schnellere Suche und besserer Datenschutz als bei rein cloudbasierten Ansätzen.

Enterprise-Sicherheit. Hybrid Deployment, Air-Gap-Optionen, FedRAMP High, SOC 2 Type 2 und HIPAA-Konformität machen Windsurf zur einzig ernsthaften agentischen Option für regulierte Branchen.

Contra: Wo Windsurf schwächelt

Stabilität. Die aggressive Release-Kadenz bringt gelegentlich Regressionen und Bugs. „Bleeding Edge“ ist hier wörtlich zu nehmen.

UI-Polish. Die Oberfläche wirkt funktionaler und technischer als die von Cursor. Wer eine „Apple-eske“ Ästhetik erwartet, wird enttäuscht.

Ressourcenverbrauch. Die lokale Indexierung kostet RAM und CPU. Auf schwächerer Hardware fällt das ins Gewicht.

Halluzinationen in großen Projekten. Bei sehr großen Monorepos halluziniert der Agent gelegentlich Dateipfade oder bleibt in Korrekturschleifen hängen.

Für wen eignet sich Windsurf?

Einzelentwickler & Startups

Hier bietet Windsurf Pro den höchsten ROI im aktuellen Markt. 15 Dollar im Monat, unbegrenztes SWE-1.5 und tiefe agentische Funktionen – das ist schwer zu schlagen. Wenn du schnell iterierst und dir ein Tool wünschst, das mitdenkt statt nur zu ergänzen, ist Windsurf die erste Wahl.

Enterprise & regulierte Branchen

Für Unternehmen aus dem Finanz-, Gesundheits- oder Regierungssektor ist Windsurf dank Hybrid Deployment, FedRAMP-High-Zertifizierung und Air-Gap-Optionen praktisch alternativlos unter den agentischen IDEs. Code und Indizes bleiben auf der eigenen Infrastruktur, nur die anonymisierte Inferenz geht in die Cloud – mit Zero Data Retention.

Wer woanders besser aufgehoben ist

Wer absolute UI-Perfektion und maximale Stabilität über Feature-Reichtum stellt, fährt mit Cursor derzeit noch besser. Und wer tief im GitHub-Ökosystem steckt und vor allem nahtlose Pull-Request- und Issue-Integration braucht, findet bei GitHub Copilot den geringsten Reibungsverlust – auch wenn die agentischen Fähigkeiten dort schwächer ausfallen.

Windsurf vs. Cursor vs. GitHub Copilot

| Kriterium | Windsurf | Cursor | GitHub Copilot |

|---|---|---|---|

| Preis | 15 $/Monat (Pro) | 20 $/Monat (Pro) | 10 $/Monat (Individual) |

| Basis | VS Code (Fork) | VS Code (Fork) | VS Code (Extension) |

| Agentischer Kern | Cascade (zustandsbehaftet) | Composer | Copilot Agent |

| Hauseigenes Modell | SWE-1.5 (950 t/s) | Keines | Keines |

| Multi-File-Refactoring | Sehr stark (Megaplan) | Stark (Composer) | Mittel |

| Lokale Indexierung | Ja (Fast Context) | Cloud-basiert | Cloud-basiert |

| Arena / Modellvergleich | Ja (Git Worktrees) | Nein | Nein |

| Enterprise / Air-Gap | Ja (FedRAMP High) | Begrenzt | Ja (GitHub Enterprise) |

| UI-Polish | Funktional | Sehr poliert | Standard (VS Code) |

| Stabilität | Gelegentlich Regressionen | Hoch | Hoch |

Cursor punktet bei UI und Stabilität. GitHub Copilot punktet bei der nativen GitHub-Integration und dem niedrigen Einstiegspreis. Windsurf punktet bei Geschwindigkeit, Preis-Leistung, agentischer Tiefe und Enterprise-Sicherheit.

Gerade wenn du stark im GitHub-Ökosystem arbeitest, lohnt sich ein Blick auf den GitHub Copilot Test, um realistisch einzuschätzen, wie weit Copilot bei agentischen Workflows tatsächlich ist und wo er gegenüber Cascade oder Megaplan an Grenzen stößt.

Sicherheit & Enterprise-Features

Hybrid Deployment & Air-Gap

Windsurfs Hybrid-Deployment-Modell ist ein echtes Alleinstellungsmerkmal. Code und Suchindizes verbleiben vollständig auf der Infrastruktur des Kunden – On-Premise oder in einer privaten Cloud-VPC. Nur die anonymisierte Inferenz wird an die Cloud gesendet, unter strikten Zero-Data-Retention-Garantien.

Für den Verteidigungs- und Regierungssektor gibt es vollständig Air-Gapped-Lösungen ohne Verbindung zum öffentlichen Internet.

Zertifizierungen (FedRAMP, SOC 2, HIPAA)

Windsurf verfügt über FedRAMP-High-Zertifizierung, SOC 2 Type 2 und HIPAA-Konformität. Dazu kommen Role-Based Access Control (RBAC) und Single Sign-On (SSO) im Enterprise-Tier. Für Teams mit mehr als 200 Entwicklern ist das essenziell – und ein Bereich, in dem viele Konkurrenten nicht mithalten können.

FAQ

Was kostet Windsurf?

Es gibt einen kostenlosen Plan mit 25 Credits pro Monat. Der Pro-Plan kostet 15 Dollar pro Monat und enthält 500 Credits sowie unbegrenzte Nutzung des SWE-1.5-Modells. Teams zahlen 30 Dollar pro Nutzer, Enterprise-Konditionen sind individuell.

Ist Windsurf besser als Cursor?

Für die meisten Entwickler bietet Windsurf das bessere Preis-Leistungs-Verhältnis und tiefere agentische Funktionen. Cursor hat die poliertere Oberfläche und ist stabiler. Es hängt davon ab, was dir wichtiger ist.

Welche Modelle kann ich in Windsurf nutzen?

Das hauseigene SWE-1.5, Claude Opus 4.6, GPT-5.3-Codex-Spark, Gemini 3 Flash und weitere. Du wählst pro Aufgabe das passende Modell.

Ist mein Code bei Windsurf sicher?

Bei lokaler Indexierung verlässt dein Code das Gerät nicht (außer für die Inferenz). Enterprise-Kunden können Hybrid Deployment oder vollständig Air-Gapped-Lösungen nutzen. Zertifizierungen: FedRAMP High, SOC 2 Type 2, HIPAA.

Läuft Windsurf auf Linux?

Ja. macOS (Apple Silicon & Intel), Windows und Linux werden unterstützt. ARM64-Support für Linux gibt es seit Februar 2026.

Fazit: Für wen lohnt sich der Umstieg?

Windsurf ist im Februar 2026 der KI-Code-Editor mit dem stärksten Gesamtpaket. Das SWE-1.5-Modell liefert eine unerreichte Balance aus Geschwindigkeit und Qualität für den Alltag. Cascade, Megaplan und Arena Mode setzen neue Maßstäbe für agentische Entwicklung. Und mit 15 Dollar pro Monat ist der Preis fair.

Für Einzelentwickler und Startups ist Windsurf Pro die klare Empfehlung. Für Unternehmen in regulierten Branchen ist es dank Hybrid Deployment und FedRAMP-Zertifizierung praktisch die einzige agentische Option.

Der Umstieg lohnt sich nicht, wenn du maximale UI-Eleganz und absolute Stabilität brauchst – dann bleib vorerst bei Cursor. Und wer nur leichte Code-Vervollständigung ohne agentische Tiefe sucht, kommt mit GitHub Copilot günstiger weg.

Aber der Trend ist klar: Agentische IDEs sind die Zukunft der Softwareentwicklung. Und Windsurf steht an der Spitze dieser Bewegung.