Fazit vorweg: Lohnt sich DALL-E 3 in ChatGPT noch?

Kurze Antwort: DALL-E 3 als eigenständiges Modell gibt es in ChatGPT praktisch nicht mehr. OpenAI hat es durch die neue GPT-Image-Modellfamilie ersetzt – und das ist eine gute Nachricht. Der Nachfolger GPT-Image-1.5 generiert Text im Bild nahezu fehlerfrei, versteht komplexe Anweisungen deutlich besser und lässt sich per Gespräch steuern statt über kryptische Prompt-Befehle.

Für 20 Dollar im Monat (ChatGPT Plus) bekommst du das aktuell beste Gesamtpaket aus Bildgenerierung, Textverständnis und Workflow-Integration. Wer allerdings künstlerische Hochglanz-Ästhetik sucht, wird mit Midjourney v7 glücklicher. Und wer den Pro-Plan für 200 Dollar in Betracht zieht, sollte vorher unbedingt den Abschnitt zu den versteckten Limits lesen.

DALL-E 3 in ChatGPT – Steckbrief

| Eigenschaft | Details |

|---|---|

| Aktuelles Modell | GPT-Image-1.5 (seit Dezember 2025) |

| Vorgänger | DALL-E 3 (nur noch als Legacy-Option in der API) |

| Architektur | Autoregressiv (Token-basiert, kein Diffusionsmodell mehr) |

| Integration | Nativ in GPT-5.2 eingebettet |

| Besondere Stärke | Text-Rendering, semantische Präzision, Instruction Following |

| Besondere Schwäche | „Zu perfekter“ Look, strenge Content-Filter |

| Günstigster Zugang | Kostenlos (stark limitiert: 2–3 Bilder/Tag) |

| Empfohlener Plan | ChatGPT Plus (20 $/Monat) |

Preise: Was kostet die Bildgenerierung in ChatGPT?

Die Bildgenerierung ist in allen ChatGPT-Plänen enthalten – aber die Unterschiede bei Limits, Geschwindigkeit und Modellqualität sind erheblich.

ChatGPT Free – der Teaser-Zugang

Im kostenlosen Plan bekommst du Zugriff auf GPT-Image-1-mini, ein kleineres und effizienteres Modell. Das Limit liegt bei etwa 2 bis 3 Bildern pro Tag. Die Auflösung ist oft reduziert, und Funktionen wie Inpainting oder Vektorisierung sind deaktiviert. Zum Ausprobieren reicht das – für echte Projekte nicht.

Und falls du überlegst, ob du mit dem Free-Plan startest oder direkt upgraden solltest, gibt dir der Überblick zu den besten kostenlosen KI-Tools 2026 eine realistische Erwartungshaltung.

ChatGPT Plus für 20 Dollar im Monat

Der Plus-Plan ist das Arbeitstier. Du bekommst vollen Zugriff auf GPT-Image-1.5 mit offiziell bis zu 50 Bildern alle 3 Stunden.

Allerdings: Dieses Limit ist in der Praxis volatil. In Spitzenzeiten (vor allem während der US-Tageszeiten) sinkt es auf etwa 20 Bilder, oder das System schaltet unangekündigt auf das qualitativ schwächere GPT-Image-1 zurück. Für die meisten Anwender ist der Plus-Plan trotzdem die beste Wahl.

ChatGPT Pro für 200 Dollar im Monat – und die Fair-Use-Falle

OpenAI bewirbt den Pro-Plan mit „unbegrenztem Zugang“ und priorisierter Rechenleistung. Die Realität sieht anders aus.

Ein undurchsichtiger Algorithmus überwacht die Nutzung. Wer intensiv Bilder generiert – etwa 100 oder mehr in kurzer Zeit –, riskiert eine automatische Sperre. Zahlreiche Pro-Nutzer meldeten Anfang 2026 die Fehlermeldung: „You’ve hit the pro plan limit… limit resets in 720 hours.“ Das sind 30 Tage Wartezeit – bei einem Abo, das 200 Dollar kostet.

OpenAI definiert „unbegrenzt“ offenbar als „unbegrenzt für menschliche Interaktionsgeschwindigkeit“. Automatisierte oder extrem schnelle Anfragereihen werden bestraft. Für Agenturen und Power-User ist das ein ernstes Risiko.

Preisvergleich auf einen Blick

| Feature | Free | Plus (20 $) | Business/Team (30 $) | Pro (200 $) |

|---|---|---|---|---|

| Modell | GPT-Image-1-mini | GPT-Image-1.5 | GPT-Image-1.5 | GPT-Image-1.5 (Prio) |

| Bild-Limit | ~2–3/Tag | ~50/3 Std. | ~100–300/Tag | „Unbegrenzt“ (Fair Use) |

| Reaktionszeit | Langsam | Standard | Schnell | Priorisiert |

| Datenschutz | Training möglich | Opt-Out möglich | Kein Training | Kein Training |

| Kommerzielle Rechte | Eingeschränkt | Ja | Ja | Ja |

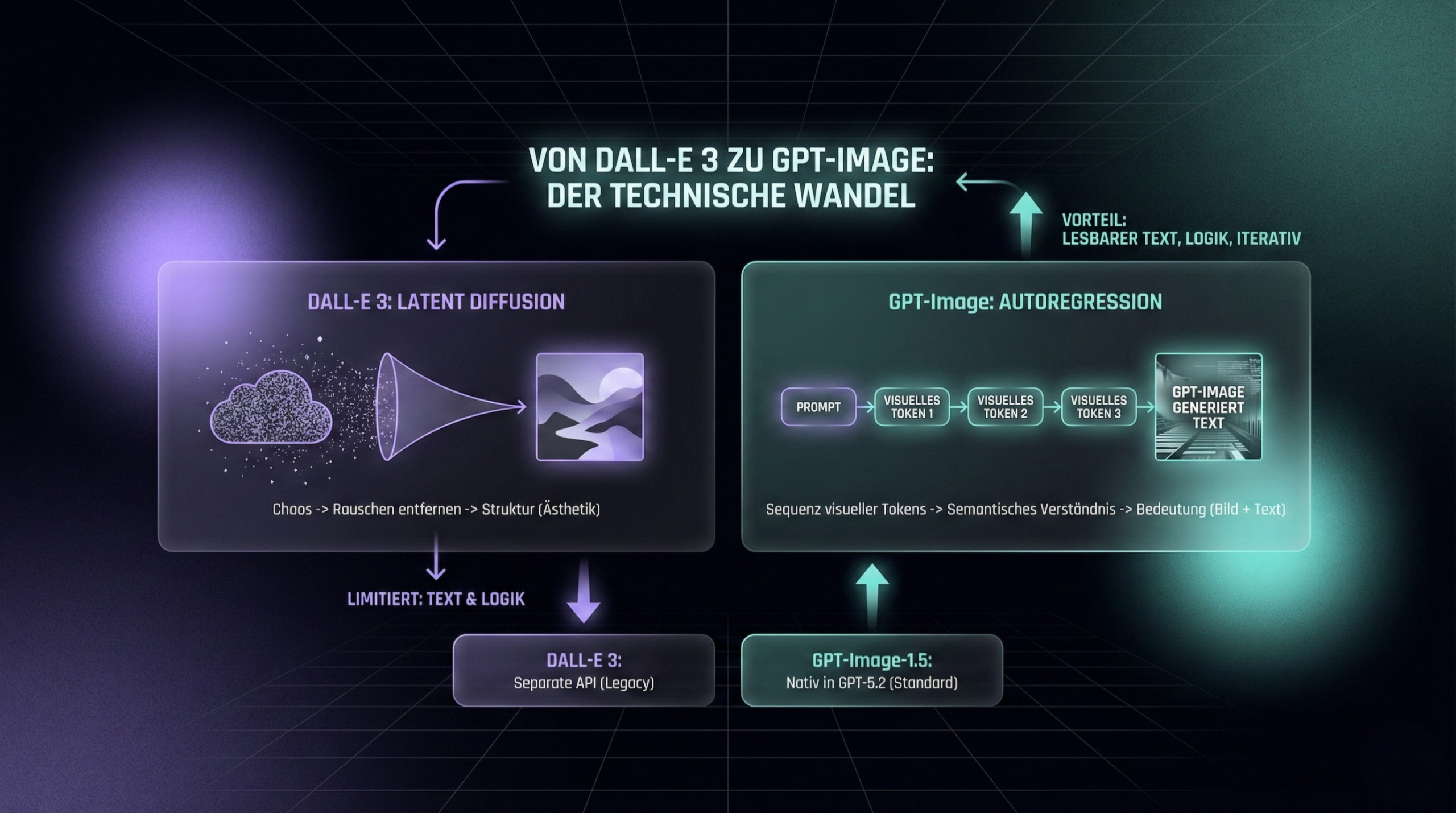

Von DALL-E 3 zu GPT-Image: Was hat sich technisch verändert?

Diffusionsmodell vs. Autoregression – einfach erklärt

DALL-E 3 war ein sogenanntes Latent Diffusion Model. Es erzeugte Bilder, indem es schrittweise Rauschen entfernte – aus Chaos wurde Struktur. Das funktionierte gut für ästhetische Bilder, aber schlecht für Text, präzise räumliche Logik und komplexe Objektbeziehungen.

Im März 2025 hat OpenAI diesen Ansatz komplett über Bord geworfen. Das neue GPT-Image-Modell arbeitet autoregressiv – genau wie GPT-5 Text erzeugt, „schreibt“ GPT-Image ein Bild als Sequenz von visuellen Token. Es baut das Bild Stück für Stück auf, basierend auf dem semantischen Verständnis des Prompts.

Der entscheidende Vorteil: Bild und Text werden mit demselben Transformer-Mechanismus verarbeitet. Das Modell „versteht“ Buchstaben nicht als Formen, sondern als Bedeutung. Damit löst es eines der größten Probleme der KI-Bildgenerierung – lesbaren Text im Bild.

GPT-Image-1.5 als neuer Standard

Die aktuelle Version GPT-Image-1.5 wurde am 16. Dezember 2025 veröffentlicht und ist der Standard in ChatGPT Plus und Pro. DALL-E 3 existiert nur noch als Legacy-Option in der API und soll voraussichtlich im Mai 2026 endgültig abgeschaltet werden.

Anders als früher, wo DALL-E als separates Tool aufgerufen wurde, ist GPT-Image-1.5 nativ in den Inferenzprozess von GPT-5.2 eingebettet. Du musst keinen Modus wechseln. Schreibst du mitten in einer Textdiskussion „Zeig mir, wie das aussehen könnte“, startet die Bildgenerierung automatisch.

Die wichtigsten Funktionen im Test

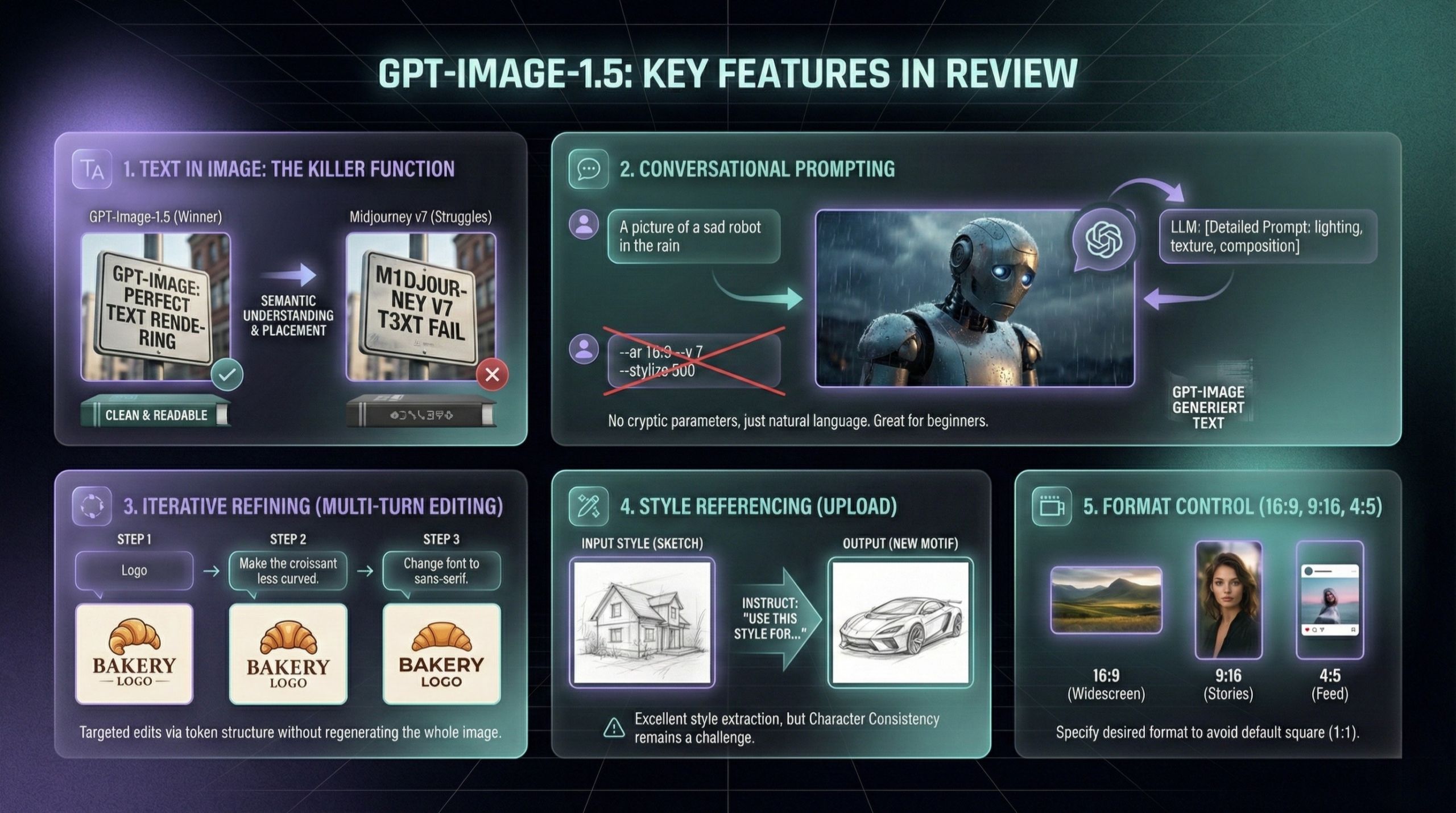

Text im Bild – die Killer-Funktion

GPT-Image-1.5 ist der unangefochtene Marktführer bei der Darstellung von Text in Bildern. Lange Slogans, Menükarten, Diagrammbeschriftungen oder Buchrücken werden nahezu fehlerfrei gerendert.

Zum Vergleich: Midjourney v7 stellt einzelne Wörter gut dar, scheitert aber regelmäßig an ganzen Sätzen. ChatGPT hingegen „versteht“ den Text semantisch und platziert ihn logisch korrekt im Bildraum – zum Beispiel perspektivisch verzerrt auf einem Straßenschild.

Conversational Prompting – Bilder per Gespräch erstellen

Du brauchst keine kryptischen Parameter wie bei Midjourney (–ar 16:9 –v 7 –stylize 500). Stattdessen beschreibst du einfach, was du willst. Aus „Ein Bild von einem traurigen Roboter im Regen“ macht das LLM intern einen detaillierten technischen Prompt mit Beleuchtung, Textur und Komposition.

Der Vorteil: Einsteiger bekommen sofort ansprechende Ergebnisse. Der Nachteil: Fortgeschrittene Nutzer kämpfen manchmal gegen diese automatische Verschönerung, wenn sie bewusst rohe oder minimalistische Ergebnisse wollen.

Iteratives Verfeinern (Multi-Turn Editing)

Das autoregressive Modell ermöglicht echte Bildbearbeitung durch Sprache. Ein typischer Workflow:

- „Erstelle ein Logo für eine Bäckerei.“

- „Mach das Croissant weniger gebogen.“

- „Ändere die Schriftart in eine serifenlose Schrift.“

Dabei wird nicht jedes Mal ein komplett neues Bild erzeugt. Dank der Token-Struktur kann das Modell einzelne Bildbereiche neu berechnen, während der Rest erhalten bleibt. Bei Diffusionsmodellen veränderten kleine Anpassungen oft das gesamte Bild – dieses Problem gehört der Vergangenheit an.

Stil-Referenzierung per Bildupload

Du kannst ein Referenzbild hochladen (zum Beispiel eine Skizze oder ein Beispielfoto) und instruieren: „Nutze den Stil dieses Bildes, aber zeige mir Motiv X.“ Das autoregressive Modell verarbeitet Stilextraktion mittlerweile sehr gut.

Allerdings bleibt die Character Consistency eine Herausforderung. Dasselbe Gesicht in verschiedenen Posen konsistent darzustellen, gelingt spezialisierten Tools wie LoRAs in Stable Diffusion noch besser.

Format-Kontrolle (16:9, 9:16, 4:5)

ChatGPT tendiert standardmäßig zu quadratischen Bildern (1:1). Gib deshalb immer das gewünschte Format an: „Format 16:9″ für Breitbild, „Format 9:16″ für Stories oder „Format 4:5″ für den Instagram-Feed.

Bildqualität im Härtetest

Realismus und physikalische Logik

GPT-Image-1.5 versteht komplexe räumliche Anweisungen. „Ein blauer Würfel auf einem roten Zylinder, der neben einer Pyramide steht“ – das Modell baut die Szene logisch auf, statt Objekte miteinander zu verschmelzen, wie es Diffusionsmodelle häufig taten.

Anatomie – das Finger-Problem

Die berüchtigten sechs Finger von DALL-E 3 sind selten geworden. Das autoregressive Modell „zählt“ anatomische Strukturen, statt sie nur statistisch zu halluzinieren. Hände und Gliedmaßen werden deutlich stabiler dargestellt als noch beim Vorgänger.

Künstlerische Stile und der „ChatGPT-Look“

Hier zeigt sich die größte Schwäche. Bilder aus ChatGPT neigen standardmäßig zu einem sauberen, kommerziellen, leicht plastischen Look – eine Art „Stock Photo Ästhetik“. Es fehlt oft der künstlerische Grit, das unperfekte Rauschen oder die emotionale Tiefe, die Midjourney auszeichnet.

Um organische, künstlerische Ergebnisse zu erzielen, brauchst du erhebliche Überzeugungsarbeit im Prompt. Befehle wie „Do not enhance prompt“ oder „Use raw style“ helfen, sind aber nicht immer zuverlässig.

Content-Filter und Einschränkungen

Was ist verboten?

OpenAI verfolgt die konservativste Content-Politik der Branche. Nacktheit wird mit Null-Toleranz behandelt – auch künstlerische Nacktheit im Stil klassischer Kunst führt oft zu Blockaden. Die Generierung von Politikern oder Prominenten ist gesperrt. Geschützte Charaktere wie Disney-Figuren werden aktiv gefiltert, wobei das System oft generische Versionen anbietet.

Der verzögerte „Adult Mode“

OpenAI hatte einen „Adult Mode“ angekündigt, der verifizierten Erwachsenen mehr Freiheiten geben sollte – zum Beispiel für Horror-Autoren oder Erotik-Literatur. Stand Januar 2026 wurde der Start auf Q1/Q2 2026 verschoben. Grund: technische Probleme bei der Altersverifikation und regulatorischer Druck. Aktuell sorgt das System zusätzlich für Frust, weil es Erwachsene teilweise fälschlicherweise in einen „Teen-Modus“ einstuft.

Die automatische Prompt-Erweiterung – Segen oder Fluch?

Bevor dein Prompt das Bildmodell erreicht, durchläuft er zwei Schichten: einen Safety-Check und eine automatische Prompt-Erweiterung. Aus „Ein Hund“ wird intern ein 50-Wörter-Prompt mit Kamera-Einstellungen und Beleuchtungsanweisungen.

Für 90 Prozent der Nutzer ist das ein Vorteil. Für Profis wird es zum Problem: Wer bewusst ein skizzenhaftes oder „hässliches“ Bild will, bekommt trotzdem ein „schönes“ Ergebnis. Befehle wie „Use exact prompt provided“ werden besser befolgt als früher, aber nicht zu 100 Prozent zuverlässig.

Vorteile von DALL-E 3 / GPT-Image in ChatGPT

Marktführer bei Text im Bild. Kein anderes Tool rendert Schrift so zuverlässig – von Slogans über Menükarten bis zu Diagrammbeschriftungen.

Multimodaler Workflow. Der nahtlose Wechsel zwischen Text, Code, Web-Suche und Bildgenerierung ist einzigartig. Du kannst ChatGPT recherchieren lassen und direkt daraus ein Bild generieren.

Natürliche Bedienung. Keine Discord-Befehle, keine Installation, keine Parameter-Syntax. Einfache Sprache reicht.

Iterative Bearbeitung. Fehler wie „Die Katze hat drei Augen“ lassen sich im Dialog beheben, ohne ein komplett neues Bild zu erzeugen.

Semantische Präzision. Das Modell versteht komplexe Anweisungen und setzt räumliche Logik korrekt um.

Nachteile und Schwächen

Übermäßige Bevormundung. Die automatische Prompt-Erweiterung und die strengen Content-Filter ersticken oft subtile kreative Intentionen.

Der „ChatGPT-Look“. Bilder wirken häufig zu glatt, zu perfekt ausgeleuchtet und verlieren dadurch an Glaubwürdigkeit oder emotionaler Resonanz.

Intransparente Limits. Besonders im Pro-Plan droht bei intensiver Nutzung eine 30-Tage-Sperre – ein geschäftskritisches Risiko.

Character Consistency. Dasselbe Gesicht in verschiedenen Posen konsistent darzustellen, bleibt schwierig im Vergleich zu spezialisierten Tools.

API-Qualitätsgefälle. Die API liefert oft schlechtere Ergebnisse als der Chat, weil die automatische Prompt-Verbesserung dort fehlt.

Für wen eignet sich ChatGPT zur Bildgenerierung?

Marketing & Social Media

Das ist der Sweet Spot. Instagram-Stories mit integriertem Text („Sale –50 %“), schnelle Visualisierungen von Kampagnen-Ideen für Präsentationen, Social-Media-Posts mit Typografie – dank der Text-Kompetenz sparst du dir oft den Umweg über Canva oder Photoshop.

Technisches Konzept-Design & Prototyping

Web-Design-Mockups, bei denen Buttons und Headlines logisch korrekt platziert werden. Architektur-Skizzen, bei denen die korrekte Anzahl von Fenstern oder Etagen zählt. Überall dort, wo es auf strukturelle Genauigkeit ankommt, spielt ChatGPT seine Stärke aus.

Bildung & Wissenschaft

Komplexe Sachverhalte visualisieren – etwa einen Querschnitt einer Zelle mit Beschriftung. Hier versagen künstlerische Tools wie Midjourney oft komplett, während ChatGPT die Labels korrekt setzt.

Alternativen zu DALL-E 3 in ChatGPT

Midjourney v7

Midjourney bleibt der Goldstandard für ästhetische Exzellenz. Die Bilder wirken organisch, malerisch und fotorealistisch. Die Character Consistency ist dank –cref-Parameter stärker als bei ChatGPT. Bedienung über Web-Interface und Discord mit Parameter-Syntax. Ab 10 Dollar im Monat als separates Abo. Wähle Midjourney, wenn dein Anspruch von „Kommunikation“ zu „Kunst“ wechselt.

Adobe Firefly (Image 4)

Adobes Firefly Positionierung: „Safe for Business.“ Firefly garantiert Urheberrechtsfreiheit, da ausschließlich auf Adobe Stock trainiert. Die Integration in Photoshop macht es perfekt für Composing und Freistellen. Bei der Textgenerierung hat Firefly Image 4 aufgeholt, wirkt aber oft steifer als ChatGPT. Die kreative Explosivität für Brainstorming fehlt.

Google Imagen 4 (Gemini Advanced)

Googles direkter Konkurrent. Beim Fotorealismus teilweise auf Augenhöhe, besonders bei Landschaftsaufnahmen. Die größte Schwäche: extreme Zensur. Die Generierung von Menschen ist so stark reglementiert, dass das Tool für Storyboards oft unbrauchbar wird.

Stable Diffusion / Flux

Die Open-Source-Alternative Stable Diffusion ist für Enthusiasten mit eigener Hardware. Keine Zensur, volle Kontrolle, Training eigener Modelle auf Gesichter oder Produkte. Der Nachteil: hohe technische Hürde. ChatGPT ist Plug & Play, Stable Diffusion ist Engineering.

Tipps: So holst du die besten Ergebnisse raus

Vom Groben ins Feine. Starte simpel („Ein Logo für eine Kaffeemarke“), iteriere („Mach es minimalistischer, füge eine Kaffeebohne hinzu“) und finalisiere („Ändere den Text zu ‚Berlin Roast‘. Format 1:1.“).

Format immer angeben. ChatGPT wählt sonst 1:1. Nutze „Format 16:9″ für Breitbild, „Format 9:16″ für Mobile/Stories und „Format 4:5″ für Instagram.

Stil-Referenz hochladen. Lade ein Beispielbild hoch und schreibe: „Nutze den Stil dieses Bildes, aber zeige mir Motiv X.“

Englische Fachbegriffe nutzen. Auch wenn ChatGPT Deutsch versteht, sind englische Stilbegriffe oft präziser, da die Trainingsdaten englisch dominiert sind. „Cyberpunk“ funktioniert besser als „Zukunfts-Dystopie“.

Automatische Verschönerung deaktivieren. Wenn du rohe oder minimalistische Ergebnisse willst, nutze Befehle wie „Do not enhance prompt“ oder „Use raw style“.

Fazit: DALL-E 3 in ChatGPT im Test

DALL-E 3 als Markenname stirbt – aber die Bildgenerierung in ChatGPT war nie besser. Mit GPT-Image-1.5 hat OpenAI die KI-Bildgenerierung „domestiziert“: weniger wildes Experimentierfeld, mehr verlässliches Produktivitäts-Tool.

Für Generalisten, Content Marketer und Konzepter, die schnelle und semantisch korrekte Visualisierungen mit Text und Logik brauchen, gibt es derzeit kein effizienteres Werkzeug. Der Plus-Plan für 20 Dollar im Monat bietet das beste Preis-Leistungs-Verhältnis. Vom Pro-Plan für 200 Dollar raten wir wegen der undurchsichtigen Fair-Use-Limits vorerst ab.

Sobald der Anspruch von Kommunikation zu Kunst wechselt – für High-End-Kampagnen, künstlerische Illustrationen oder fotorealistische Ästhetik, bei der Textur und Lichtstimmung wichtiger sind als logische Korrektheit –, bleibt Midjourney v7 die bessere Wahl.

FAQ – Häufige Fragen zu DALL-E 3 in ChatGPT

Gibt es DALL-E 3 noch in ChatGPT? Nein, nicht direkt. In der ChatGPT-Oberfläche wurde DALL-E 3 durch GPT-Image-1.5 ersetzt. DALL-E 3 existiert nur noch als Legacy-Option in der API und soll voraussichtlich im Mai 2026 abgeschaltet werden.

Kann ich mit ChatGPT kostenlos Bilder erstellen? Ja, aber stark eingeschränkt. Im Free-Plan hast du Zugriff auf GPT-Image-1-mini mit einem Limit von etwa 2 bis 3 Bildern pro Tag bei reduzierter Auflösung.

Wie viele Bilder kann ich mit ChatGPT Plus erstellen? Offiziell bis zu 50 Bilder alle 3 Stunden. In der Praxis schwankt dieses Limit je nach Serverauslastung und kann in Spitzenzeiten auf etwa 20 Bilder sinken.

Was ist die 720-Stunden-Sperre beim Pro-Plan? Pro-Nutzer, die sehr viele Bilder in kurzer Zeit generieren, können für 30 Tage (720 Stunden) gesperrt werden. OpenAI definiert „unbegrenzt“ als normale menschliche Nutzungsgeschwindigkeit – automatisierte Batch-Generierungen werden bestraft.

Was kann ChatGPT besser als Midjourney? Text im Bild, semantische Präzision, Instruction Following und den nahtlosen multimodalen Workflow. Midjourney ist stärker bei ästhetischer Qualität, künstlerischen Stilen und Character Consistency.

Kann ChatGPT auch Videos generieren? Seit Dezember 2025 läuft der Rollout von Sora 2 für Plus- und Pro-Nutzer. Die Funktion ist noch stark limitiert (5–10 Sekunden Clips in begrenzter Auflösung), aber nahtlos in den Chat integriert.

Wie verhindere ich den typischen „ChatGPT-Look“? Nutze Befehle wie „Do not enhance prompt“, „Use raw style“ oder „No rewriting“. Lade außerdem Referenzbilder im gewünschten Stil hoch. Englische Stilbegriffe funktionieren oft besser als deutsche.

Darf ich mit ChatGPT generierte Bilder kommerziell nutzen? Ja, in allen bezahlten Plänen (Plus, Business, Pro) besitzt du die kommerziellen Nutzungsrechte. Im Free-Plan gelten Einschränkungen.