GitHub Copilot hat sich verändert – grundlegend. Was 2021 als graue Code-Vorschläge beim Tippen begann, ist Anfang 2026 eine Plattform aus autonomen Agenten, Cloud-Workflows und einer Multi-Model-Strategie. Copilot schreibt nicht mehr nur Code-Zeilen fertig. Es plant Aufgaben, führt Terminal-Befehle aus, öffnet Pull Requests und behebt eigene Fehler selbstständig.

Dieser Artikel ist dein zentraler Anlaufpunkt für alles rund um GitHub Copilot: Funktionen, Preise, Modelle, Alternativen und die wichtigsten Entwicklungen im Januar 2026.

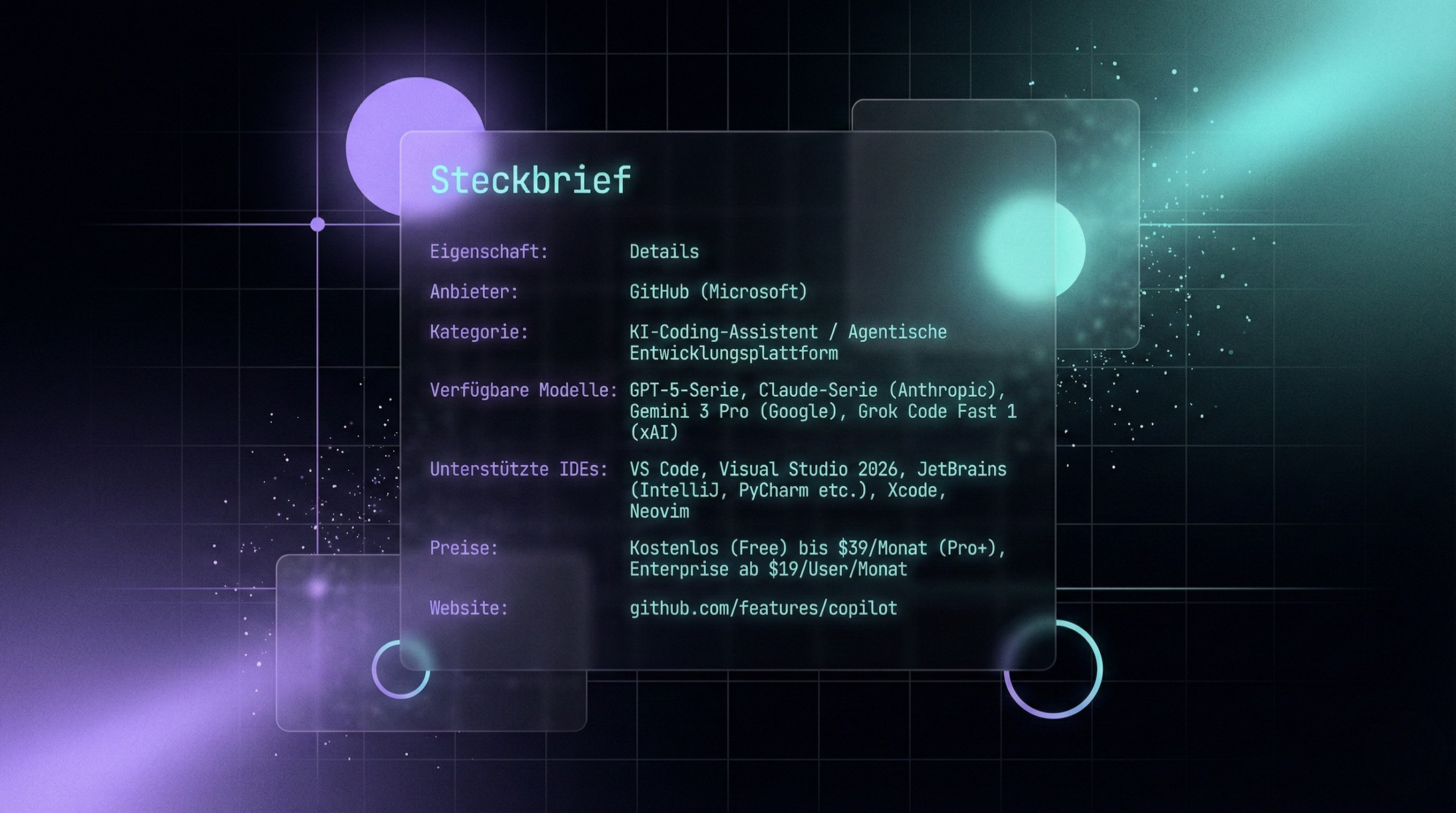

Steckbrief

| Eigenschaft | Details |

|---|---|

| Anbieter | GitHub (Microsoft) |

| Kategorie | KI-Coding-Assistent / Agentische Entwicklungsplattform |

| Verfügbare Modelle | GPT-5-Serie, Claude-Serie (Anthropic), Gemini 3 Pro (Google), Grok Code Fast 1 (xAI) |

| Unterstützte IDEs | VS Code, Visual Studio 2026, JetBrains (IntelliJ, PyCharm etc.), Xcode, Neovim |

| Preise | Kostenlos (Free) bis $39/Monat (Pro+), Enterprise ab $19/User/Monat |

| Website | github.com/features/copilot |

Für wen ist GitHub Copilot geeignet?

Hobby-Entwickler und Einsteiger kommen mit dem kostenlosen Free-Plan aus. 2.000 Code Completions und 50 Premium Requests pro Monat reichen für kleinere Projekte und zum Ausprobieren.

Professionelle Solo-Entwickler brauchen mindestens den Pro-Plan ($10/Monat) für unbegrenzte Completions und Zugang zum Coding Agent. Wer intensiv mit dem Agent Mode arbeitet, stößt allerdings schnell an die 300 Premium Requests – dann wird Pro+ ($39/Monat) quasi Pflicht.

Teams und Unternehmen setzen auf Business ($19/User/Monat) oder Enterprise. Hier geht es weniger um Features als um Compliance: Zero Data Retention, Admin-Kontrollen, Audit-Logs und die Copyright-Indemnification sind in regulierten Branchen unverzichtbar.

Preise & Versionen

Free

Der Einstieg kostet nichts. Du bekommst limitierte Code Completions (2.000/Monat), 50 Premium Requests und Zugang zu den Standard-Modellen. Agent Mode ist nutzbar, frisst aber schnell dein Request-Budget auf. Der Coding Agent fehlt komplett.

Pro

Für $10 pro Monat fallen die Limits bei Code Completions weg. Du bekommst 300 Premium Requests, Zugriff auf eine erweiterte Modell-Auswahl und den Coding Agent. Für die meisten Entwickler mit moderater KI-Nutzung ist das der Sweet Spot.

Pro+

$39 pro Monat – der Plan für Power-User. 1.500 Premium Requests, Vollzugriff auf alle Modelle (inklusive Claude Opus 4.6, GPT-5.2 und Gemini 3 Pro) und unbegrenzter Agent Mode mit allen Modellen. Wer täglich mehrere Stunden im Agent Mode arbeitet, kommt um Pro+ kaum herum.

Business & Enterprise

Business kostet $19 pro User und Monat. Die Premium Requests werden über das Team gepoolt. Dazu kommen organisationsweite Policies, IP-Indemnification und Zero Data Retention. Enterprise bietet zusätzlich SAML-SSO, erweiterte Audit-Logs und dedizierten Support.

Premium Requests – das Abrechnungssystem erklärt

Premium Requests sind die interne Währung von Copilot. Nicht jede Interaktion kostet gleich viel: Ein simpler Chat mit GPT-5 mini verbraucht vielleicht 0,1 Requests, eine komplexe Agenten-Aufgabe mit Claude Opus 4.6 kann mehrere Requests auf einmal kosten. Die Multiplikatoren hängen vom gewählten Modell und der Aufgabenkomplexität ab.

Wichtig zu wissen: Die Copilot-Preise sind additiv. Du brauchst ein GitHub-Konto, und wer als Freiberufler GitHub Pro ($4) plus Copilot Pro+ ($39) nutzt, zahlt effektiv $43 pro Monat. Zusätzliche Premium Requests lassen sich für $0,04 pro Stück nachkaufen.

Die wichtigsten Funktionen

Inline Assistance (Code Completions)

Die klassische Funktion: Grauer „Ghost Text“ erscheint beim Tippen und vervollständigt deinen Code. Für minimale Latenz (unter 200 ms) kommen spezialisierte, schnelle Modelle wie Claude Haiku 4.5 oder GPT-5 mini zum Einsatz. Dein Flow wird nicht unterbrochen – du tippst, die KI ergänzt.

Neu seit Januar 2026 sind die Next Edit Suggestions: Änderst du eine Funktionssignatur in einer Datei, erkennt Copilot automatisch, welche anderen Dateien betroffen sind (Implementierung, Tests, Typen), und schlägt die nötigen Anpassungen proaktiv vor.

Agent Mode

Der Agent Mode ist der größte Sprung gegenüber der klassischen Autocomplete-Funktion. Statt einzelne Zeilen zu ergänzen, übernimmt die KI ganze Aufgaben.

Du gibst zum Beispiel ein: „Migriere diese Komponente von Options API zu Composition API (Vue.js).“ Der Agent durchläuft dann eine Autonomie-Schleife:

- Planung – Analyse der Abhängigkeiten und betroffenen Dateien

- Aktion – Datei-Änderungen durchführen

- Verifikation – Tests oder Build-Kommandos im Terminal ausführen

- Korrektur – Fehlermeldungen auswerten und den Code selbstständig fixen

Seit VS Code v1.109 (Januar 2026) kann der Haupt-Agent außerdem Sub-Agenten parallel starten. Einer durchsucht die Dokumentation einer Bibliothek, ein anderer analysiert den lokalen Code – gleichzeitig.

Coding Agent (Cloud)

Der Coding Agent arbeitet asynchron in der Cloud. Du weist ein GitHub Issue dem Benutzer @copilot zu, und im Hintergrund passiert folgendes: Eine GitHub-Actions-Instanz startet, klont das Repository in eine Sandbox, führt die Änderungen durch, lässt die CI/CD-Pipeline laufen und erstellt bei Erfolg einen Pull Request. Schlägt die Pipeline fehl, versucht der Agent die Fehler anhand der Logs selbst zu beheben.

Der Unterschied zum Agent Mode: Agent Mode ist Pair Programming in Echtzeit – du schaust zu und steuerst. Der Coding Agent ist Delegation – du übergibst eine Aufgabe und arbeitest an etwas anderem weiter. Er ist ab dem Pro-Plan verfügbar, die Rechenkosten für autonome Agentenschleifen sind allerdings deutlich höher.

Copilot Edits & Next Edit Suggestions

Copilot Edits ist die Multi-File-Editing-Variante. Du behältst die volle Kontrolle darüber, welche Dateien angefasst werden, und genehmigst jeden Änderungsschritt einzeln. Predictive Edits schlagen dabei Änderungen in zusammenhängenden Dateien vor, bevor du überhaupt dorthin navigierst.

Copilot CLI & Background Agents

Im Terminal hat sich Copilot vom reinen Übersetzungstool (natürliche Sprache → Shell-Befehl) zur Plattform für Background Agents entwickelt. Du kannst Analyseaufgaben wie „Untersuche die Logs der letzten 24 Stunden auf Anomalien“ an einen CLI-Agenten übergeben. Seit Januar 2026 laufen diese Hintergrundaufgaben in isolierten Git-Worktrees – du kannst im Haupt-Terminal weiterarbeiten, ohne Checkout-Konflikte.

Copilot Spaces (Kontext-Management)

Nach der Einstellung der Knowledge Bases im August 2025 ist Copilot Spaces die Lösung für Kontext-Management. Du erstellst Sammlungen aus Dateien, Dokumentationen, Issues und externen URLs. Copilot nutzt Retrieval-Augmented Generation (RAG), um Antworten auf Basis dieses kuratierten Wissens zu generieren – nicht nur auf Basis der Trainingsdaten oder der gerade geöffneten Dateien.

Für Unternehmen ist das entscheidend: Proprietäre Frameworks, interne Richtlinien oder „Golden Paths“ lassen sich so direkt in den KI-Workflow einbinden.

Agent HQ & MCP-Integration

Agent HQ ist GitHubs Antwort auf die Frage: Wie steuert man mehrere spezialisierte Agenten? Es fungiert als „Mission Control“, in der du verschiedene Agenten – den hauseigenen Copilot, Sicherheits-Agenten oder Drittanbieter-Agenten – zentral überwachst und steuerst.

Technisch basiert die Öffnung auf dem Model Context Protocol (MCP). MCP ist eine universelle Schnittstelle (vergleichbar mit LSP für Sprachserver), über die Copilot standardisiert mit externen Datenquellen und Werkzeugen kommuniziert – ohne für jedes Tool eine eigene Integration zu brauchen.

Unterstützte IDEs und Sprachen

IDE-Hierarchie: VS Code → JetBrains → Xcode & Co.

Nicht jede Entwicklungsumgebung bietet das gleiche Copilot-Erlebnis. Es gibt eine klare Hierarchie:

Tier 1 – VS Code & Visual Studio 2026: Volle Feature-Unterstützung, neue Funktionen landen hier zuerst. VS Code v1.109 ist die einzige Plattform mit parallelen Sub-Agenten und tiefer MCP-Integration. Visual Studio 2026 bietet spezialisierte App-Modernisierungs-Agenten für Java und .NET.

Tier 2 – JetBrains IDEs: Unterstützung über Plugins (mindestens Version 1.5.61 für GPT-5.1). Die UI-Integration des Agent Mode hinkt leicht hinterher.

Tier 3 – Xcode, Eclipse, Vim/Neovim: Funktionalität meist auf Inline Completion und Chat beschränkt. Agent Mode existiert teilweise, aber die tiefe Build-System-Integration fehlt.

Sprachkompetenz: Tier 1 bis Tier 3

Die Qualität des generierten Codes hängt direkt von den verfügbaren Trainingsdaten ab:

Tier 1 (dominant): Python, JavaScript/TypeScript, Go, Rust. Hier ist Copilot extrem leistungsfähig. Die Fehlerquote ist so niedrig, dass viele Entwickler den Code kaum noch manuell prüfen – was ein eigenes Risiko darstellt (mehr dazu unter „Vibe Coding“).

Tier 2 (stark): C#, Java, C++. Die starke Typisierung hilft dem Agenten, syntaktisch korrekten Code zu garantieren. Spezielle App-Modernization-Features zielen auf diese Enterprise-Sprachen.

Tier 3 (schwach): Legacy-Sprachen wie COBOL oder Fortran und esoterische DSLs. Copilot kann hier Syntax generieren, halluziniert aber häufiger – etwa durch Erfindung nicht existierender Bibliotheken.

Aufsteiger: WebAssembly (WASM). Da WASM viel Boilerplate erfordert, ist die KI-Unterstützung beim Portieren von Rust/C++ ins Web ein massiver Beschleuniger.

Die Multi-Model-Strategie

Verfügbare Modelle im Überblick

GitHub Copilot ist kein reines OpenAI-Produkt mehr. Seit 2025 fungiert es als Modell-Aggregator mit einer kuratierten Auswahl:

| Modell | Anbieter | Status (Jan 2026) | Einsatzzweck | Stärke |

|---|---|---|---|---|

| GPT-5.1 | OpenAI | GA | Deep Reasoning | Komplexe Architektur-Analyse, Refactoring |

| GPT-5.1-Codex | OpenAI | GA | Engineering Tasks | Höchste Code-Qualität, strikte Anweisungsbefolgung |

| GPT-5 mini | OpenAI | GA | General Purpose | Schnell, kosteneffizient, Standard für die meisten Aufgaben |

| GPT-5.2 | OpenAI | GA | High-End Reasoning | Extrem komplexe Logik, technische Entscheidungsfindung |

| Claude Sonnet 4.5 | Anthropic | GA | Agentic Tasks | Balance aus Intelligenz und Geschwindigkeit, beliebt für „Vibe Coding“ |

| Claude Opus 4.6 | Anthropic | GA | Maximum Reasoning | Das leistungsstärkste Modell, teuer und langsam, für schwierigste Debugging-Fälle |

| Claude Haiku 4.5 | Anthropic | GA | Latency Sensitive | Inline Chat, Syntax-Hilfe, extrem schnell |

| Gemini 3 Pro | Public Preview | Massive Context | Analyse riesiger Codebasen (>1M Token Kontextfenster) | |

| Grok Code Fast 1 | xAI | GA | Speed & Debugging | Extrem schnelle Generierung, spezialisiert auf C/C++ |

Wichtig: GPT-5 und GPT-5-Codex werden am 17. Februar 2026 abgeschaltet. Wer diese Modelle noch nutzt, muss auf 5.1 oder 5.2 migrieren.

Die Multi-Model-Strategie ergibt nur Sinn, wenn du weißt, wie große Sprachmodelle grundsätzlich funktionieren. Genau hier setzt der Grundlagenartikel Wie funktionieren Large Language Models? an – ideal, um Unterschiede zwischen GPT-5.2, Claude Opus oder Gemini 3 Pro besser einordnen zu können.

Welches Modell wofür?

Copilot bietet einen Auto-Modus, der basierend auf der Prompt-Komplexität das passende Modell wählt. Power-User setzen aber gezielt auf bestimmte Modelle:

Komplexes Debugging: GPT-5.2 oder Claude Opus 4.6. Diese Modelle können Kausalketten über mehrere Dateien verfolgen und logische Fehler finden, die einfacheren Modellen entgehen.

Boilerplate & Refactoring: GPT-5 mini oder Claude Haiku 4.5. Verbrauchen weniger Premium Requests und liefern Ergebnisse fast sofort.

„Vibe Coding“ (schnelles Prototyping): Claude Sonnet 4.5. In der Community hat sich dieses Modell als Favorit etabliert – der generierte Code wirkt natürlicher und das Modell neigt weniger zu unnötigen Verweigerungen.

Riesige Codebasen: Gemini 3 Pro. Mit über einer Million Token Kontextfenster analysiert es ganze Repositories auf einmal.

Wenn du die Modellwahl strategisch angehen willst, statt dich auf den Auto-Modus zu verlassen, liefert dir der systematische Vergleich OpenAI vs. Anthropic – Top-Modelle im direkten Vergleich eine klare Entscheidungsgrundlage. Das ist besonders hilfreich, wenn du Premium Requests gezielt optimieren möchtest.

Alternativen

Die strategische Entscheidung zwischen Copilot, Cursor und Windsurf fällt leichter, wenn du die Unterschiede gebündelt siehst – im großen Coding-Assistenten-Vergleich: GitHub Copilot vs. Cursor vs. Windsurf.

Cursor

Cursor ist ein Fork von VS Code und gilt unter Power-Usern als größte Copilot-Alternative. Der „Composer Mode“ ermöglicht das Spezifizieren ganzer Features, bevor eine Zeile Code geschrieben wird. Da Cursor den gesamten Editor-Stack kontrolliert, kann es die UX radikaler anpassen als Copilot, das an die Extension-API von VS Code gebunden ist. Preis: $20/Monat. Größter Nachteil: Cursor lebt ausschließlich lokal – keine DevOps-Integration, keine Cloud-Agenten, keine automatischen PRs.

Windsurf (Codeium)

Windsurf setzt auf Geschwindigkeit und tiefe Kontext-Indizierung. Es erstellt einen umfassenden Index deiner Codebasis für extrem schnelle Retrieval-Performance. Preislich aggressiv bei $10–15/Monat, zielt es auf Solo-Entwickler, die maximale Geschwindigkeit suchen. Wie Cursor fehlen Cloud-Agenten und DevOps-Integration.

Vergleichstabelle

| Feature | GitHub Copilot (Pro+) | Cursor (Pro) | Windsurf |

|---|---|---|---|

| Kern-Modell | Multi-Model (GPT-5, Claude, Gemini) | Claude 3.5 Sonnet / GPT-4o | Eigene Modelle / Llama Basis |

| Multi-File Edits | Copilot Edits | Cursor Composer | Cascade / Flows |

| Kontext-Management | Copilot Spaces (RAG) | Lokale Indizierung | Deep Context Awareness |

| DevOps-Integration | Coding Agent (GitHub Actions) | Keine | Keine |

| Security | Enterprise Policy, Indemnification | Basis | Basis |

| Preis | $39/Monat | $20/Monat | $10–15/Monat |

| Hauptvorteil | Nahtlose GitHub-Integration | Beste UX für komplexe Refactorings | Geschwindigkeit & Preis |

GitHubs Verteidigungsstrategie ist klar: Plattform-Integration. Cursor mag der bessere Editor sein – aber Copilot ist besser im DevOps. Der Coding Agent öffnet autonom PRs, überwacht CI-Pipelines und behebt Testfehler in der Cloud. Für Unternehmen kommt dazu: konsolidierte Abrechnung, Compliance und Copyright-Schutz über den bestehenden GitHub-Enterprise-Vertrag.

Wenn dein Fokus auf einer kostenlosen Alternative liegt, lohnt sich der Blick auf Codeium im Test – kostenlose Copilot-Alternative. Gerade als Freelancer oder Student kannst du so abwägen, ob dir die Features reichen oder ob dir Multi-Model-Strategie und Agentenfunktionen fehlen würden.

Produktivität & Risiken

Was die Studien sagen

Die Zahlen aus aktuellen Studien (Ende 2025/Anfang 2026) sind beeindruckend:

- Entwickler schließen Aufgaben mit Copilot durchschnittlich 55 % schneller ab

- Die Durchlaufzeit für Pull Requests sank in Studien um durchschnittlich 3,5 Stunden, in hochintegrierten Umgebungen sogar um bis zu 75 %

- 90 % der Fortune-100-Unternehmen nutzen Copilot

- Copilot generiert mittlerweile fast 46 % allen Codes bei seinen Nutzern (bei Java-Entwicklern sogar bis zu 61 %)

- 90 % der Entwickler berichten von höherer Arbeitszufriedenheit, vor allem durch den Wegfall von Boilerplate-Aufgaben

Vibe Coding – Chance und Gefahr

„Vibe Coding“ beschreibt einen Workflow, bei dem Entwickler den KI-generierten Code nur noch oberflächlich prüfen – sie achten auf den „Vibe“, statt jede Zeile zu verstehen. Besonders verbreitet ist das bei leistungsfähigen Modellen wie Claude Sonnet 4.5 und in Tier-1-Sprachen wie Python oder TypeScript, wo die Fehlerquote niedrig genug erscheint.

Das Risiko: Studien zeigen einen Anstieg der relativen Wahrscheinlichkeit für Sicherheitslücken um 20–30 %. Der Code sieht funktional korrekt aus, enthält aber subtile Fehler – fehlende Input-Validierung, ungeprüfte Edge Cases. Die KI bevorzugt den „Happy Path“.

Die Gegenmaßnahmen: Automatisierte AI-Code-Review-Agenten fungieren als Gatekeeper. Copilot Autofix (in Kombination mit CodeQL-Scans) erkennt Schwachstellen direkt im Pull Request und schlägt Fixes vor. Die KI schreibt den Code – und eine andere KI überprüft ihn.

Sicherheit, Datenschutz & Recht

Urheberrecht: Doe v. GitHub

Die Sammelklage Doe v. GitHub, Inc. schwebt auch im Januar 2026 noch über der Branche. Die Kernvorwürfe bezüglich DMCA Section 1202 (Entfernung von Copyright-Management-Informationen) wurden vom Bezirksgericht abgewiesen, befinden sich aber in der Berufung vor dem Ninth Circuit Court of Appeals.

Für Enterprise-Kunden bieten Microsoft und GitHub das Copilot Copyright Commitment: Zahlende Kunden (Business/Enterprise) werden von Ansprüchen Dritter freigestellt, sofern die Sicherheitsfilter aktiviert sind – insbesondere „Block suggestions matching public code“.

Zero Data Retention & Compliance

Für Business- und Enterprise-Tarife gilt eine strikte Zero-Data-Retention-Politik. Prompts und Code-Snippets werden weder von GitHub noch von den Modell-Partnern (OpenAI, Anthropic, Google) gespeichert. Die Daten werden flüchtig im Arbeitsspeicher verarbeitet und sofort verworfen.

Administratoren steuern über das AI-Controls-Dashboard, welche Modelle genutzt werden dürfen, ob Daten an MCP-Server fließen und können Audit-Logs jeder Agenten-Interaktion einsehen.

Sicherheitslücken in KI-Code

Laut Studien weisen rund 29,1 % des KI-generierten Python-Codes potenzielle Schwachstellen auf. GitHub begegnet dem mit Copilot Autofix: In Kombination mit CodeQL-Scans erkennen Sicherheits-Agenten Vulnerabilities im PR (z. B. SQL Injection) und schlagen autonom einen Fix vor. Der Kreislauf schließt sich – die KI schreibt Code, und die KI behebt ihre eigenen Sicherheitslücken.

Aktuelle Updates (Januar 2026)

Die wichtigsten Entwicklungen im Januar 2026 auf einen Blick:

VS Code v1.109 bringt parallele Sub-Agenten im Agent Mode und verbessertes Session-Management.

Visual Studio 2026 integriert Copilot tief in die .NET-Toolchain mit spezialisierten App-Modernisierungs-Agenten für Java und .NET.

End-of-Life für GPT-5 und GPT-5-Codex am 17. Februar 2026. Nutzer müssen auf GPT-5.1, GPT-5.1-Codex oder GPT-5.2 migrieren. Auch ältere Claude-Versionen (Opus 4.1) erreichen ihr End-of-Life.

Copilot Workspace eingestellt: Die separate Technical Preview wurde bereits im Mai 2025 beendet. Die Kernfunktionen (Repository-weiter Kontext, Ausführungspläne, Multi-File-Edits) sind vollständig in Agent Mode und Coding Agent integriert. An die Stelle des Workspace-Begriffs tritt Copilot Spaces für Kontext-Management.

FAQ

Was kostet GitHub Copilot? Es gibt einen kostenlosen Free-Plan. Pro kostet $10/Monat, Pro+ $39/Monat und Business $19/User/Monat. Die Hauptunterschiede liegen bei den Premium Requests und dem Modell-Zugriff.

Welche KI-Modelle kann ich nutzen? Je nach Plan: GPT-5-Serie (OpenAI), Claude-Serie (Anthropic), Gemini 3 Pro (Google) und Grok Code Fast 1 (xAI). Den vollen Zugriff auf alle Modelle gibt es ab Pro+.

Was ist der Unterschied zwischen Agent Mode und Coding Agent? Agent Mode ist synchrones Pair Programming in der IDE – du steuerst in Echtzeit. Der Coding Agent arbeitet asynchron in der Cloud, übernimmt Issues und erstellt eigenständig Pull Requests.

Ist mein Code mit Copilot sicher? Für Business- und Enterprise-Tarife gilt Zero Data Retention – dein Code wird nicht gespeichert. Für zusätzlichen Schutz sorgen die IP-Indemnification und der Filter „Block suggestions matching public code“.

Brauche ich Pro oder Pro+? Wenn du den Agent Mode nur gelegentlich nutzt, reicht Pro mit 300 Premium Requests. Arbeitest du intensiv mit Agenten oder brauchst Zugriff auf alle Modelle (Claude Opus, GPT-5.2, Gemini 3 Pro), kommst du um Pro+ kaum herum.

Welche IDEs werden unterstützt? Volle Unterstützung in VS Code und Visual Studio 2026. Gute Unterstützung über Plugins in JetBrains IDEs (IntelliJ, PyCharm etc.). Basisunterstützung in Xcode, Eclipse und Vim/Neovim.

Fazit + Nächste Schritte

GitHub Copilot hat den Sprung von der Code-Vervollständigung zur agentischen Plattform geschafft. Im Januar 2026 ist es keine Frage mehr, ob KI-Tools die Entwicklung verändern – sondern wie stark.

Drei Kernaussagen für deine Entscheidung:

Der Plan macht den Unterschied. Die Kluft zwischen Free und Pro+ ist riesig. Professionelle Entwicklung erfordert effektiv Zugang zu den höheren Tiers, um die notwendige Rechenleistung für Agenten zu erhalten.

Copilot gewinnt über die Plattform. Cursor und Windsurf bieten teils bessere Editor-Erfahrungen. Aber kein Konkurrent kann die DevOps-Integration liefern: Cloud-Agenten, automatische PRs, CI/CD-Überwachung – alles innerhalb des GitHub-Ökosystems.

Reviewen wird wichtiger als Schreiben. Da Agenten immer mehr Code produzieren, verschiebt sich der Engpass. Die Fähigkeit, KI-generierten Code kritisch zu bewerten, wird zur wichtigsten Kompetenz für erfahrene Entwickler.

Nächste Schritte: Probiere den Free-Plan aus und teste den Agent Mode mit einer echten Aufgabe. Wenn du merkst, dass du an die 50 Premium Requests stößt, ist es Zeit für ein Upgrade. Für Teams lohnt sich der Blick auf Business – weniger wegen der Features, sondern wegen Compliance und zentraler Verwaltung.

Der Ausblick auf den Rest des Jahres 2026: Die nächste große Hürde wird die autonome Wartung von Legacy-Code. Die Coding Agents beginnen gerade erst, ihr Potenzial in diesem Feld zu zeigen.