Die wichtigsten KI-Meilensteine auf einen Blick

Die Dekade von 2015 bis 2025 hat Künstliche Intelligenz von einer akademischen Nische zur wichtigsten Basistechnologie des 21. Jahrhunderts gemacht. Was mit einem Brettspiel-Sieg begann, endete mit autonomen Agenten, die eigenständig Software entwickeln und wissenschaftliche Probleme lösen.

Drei Faktoren haben diese Entwicklung angetrieben: exponentiell wachsende Rechenleistung, die Erfindung der Transformer-Architektur und die Verfügbarkeit riesiger Datensätze. In diesem Artikel erfährst du, welche Meilensteine die KI-Welt wirklich verändert haben – vom legendären Zug 37 in Seoul bis zur Ära der KI-Agenten.

Viele der Sprünge zwischen 2017 und heute wirken erst rückblickend logisch – und genau deshalb lohnt sich ein stabiler Unterbau: Wenn du einmal sauber verstanden hast, wie Self-Attention, Tokenisierung und Training zusammenspielen, liest du Modellankündigungen plötzlich wie ein Datenblatt statt wie Marketing. Genau dabei hilft dir die Einführung in wie funktionieren Large Language Models – damit du Fähigkeiten wie Few-Shot, Tool-Use oder „Reasoning“ besser einordnen kannst.

AlphaGo: Als KI menschliche Intuition schlug (2016)

Im März 2016 passierte etwas, das die meisten KI-Forscher erst in zehn Jahren erwartet hatten: Eine Maschine besiegte den weltbesten Go-Spieler Lee Sedol mit 4:1. Das klingt nach einem simplen Wettkampf – war aber ein Wendepunkt für die gesamte Branche.

Warum Go so lange als unlösbar galt

Go ist nicht einfach nur ein Brettspiel. Es ist das komplexeste Brettspiel der Welt. Während Schach rund 20 mögliche Züge pro Stellung hat, bietet Go etwa 250. Die Gesamtzahl möglicher Brettkonfigurationen liegt bei 10 hoch 170 – das sind mehr als die geschätzten Atome im beobachtbaren Universum (10 hoch 80).

Klassische Brute-Force-Algorithmen, wie sie IBMs Deep Blue 1997 gegen Kasparov im Schach nutzte, waren hier komplett wirkungslos. Go erfordert etwas, das eher nach menschlicher Intuition aussieht: ein „Gefühl“ für die richtige Position.

Google DeepMinds AlphaGo löste das Problem mit einer Kombination aus zwei neuronalen Netzen und Monte Carlo Tree Search. Ein Policy Network schlug plausible Züge vor und reduzierte so die Suchbreite drastisch. Ein Value Network bewertete, wie gut eine Brettposition war, ohne das Spiel bis zum Ende durchspielen zu müssen. Zunächst lernte AlphaGo aus 30 Millionen menschlichen Zügen, dann verbesserte es sich durch Reinforcement Learning – Millionen Partien gegen sich selbst.

Zug 37 – der Moment, der alles veränderte

Der historische Wendepunkt war nicht das Endergebnis, sondern ein einzelner Zug: Zug 37 in der zweiten Partie. AlphaGo platzierte einen Stein auf einer Position, die jeder menschliche Experte als Fehler abgetan hätte – sie widersprach Jahrzehnten der Go-Theorie. Lee Sedol verließ den Raum, um sich zu sammeln. Kommentatoren waren ratlos.

Es stellte sich heraus: Dieser Zug war das Ergebnis einer tieferen, nicht-menschlichen Strategie, die das Spiel langfristig entschied. AlphaGo hatte etwas getan, das vorher nur Menschen zugetraut wurde – eine kreative, neuartige Lösung finden, die außerhalb etablierter Heuristiken lag.

Ein Jahr später ging DeepMind noch weiter: AlphaZero (2017) lernte komplett ohne menschliches Vorwissen und erreichte innerhalb von 24 Stunden übermenschliche Spielstärke in Schach, Shogi und Go.

Der Transformer: Die Architektur hinter allem (2017)

Wenn AlphaGo der symbolische Sieg war, dann war das Paper „Attention Is All You Need“ der industrielle Motor für alles, was danach kam. Veröffentlicht im Juni 2017 von einem Team bei Google Brain, wurde es bis 2025 über 173.000 Mal zitiert. Ohne dieses Paper gäbe es kein GPT, kein Claude, kein Llama.

Das Problem mit RNNs und LSTMs

Vor 2017 basierte maschinelle Sprachverarbeitung auf Recurrent Neural Networks (RNNs) und Long Short-Term Memory (LSTM) Netzen. Diese Systeme hatten zwei fundamentale Schwächen.

Erstens: Sie verarbeiteten Daten sequenziell – Wort für Wort. Die Berechnung des aktuellen Zustands hing vom vorherigen ab. Das bedeutete, dass die massive parallele Rechenleistung moderner GPUs kaum genutzt werden konnte. Training war langsam und schlecht skalierbar.

Zweitens: Bei langen Texten ging der Kontext verloren. Informationen mussten durch viele Zeitschritte „hindurchgereicht“ werden, wobei das Signal verblasste – das berüchtigte „Vanishing Gradient“-Problem. Ein Satz am Anfang eines Absatzes konnte am Ende bereits vergessen sein.

Wie Self-Attention das Spiel veränderte

Die Autoren um Ashish Vaswani schlugen den Transformer vor – eine Architektur, die komplett auf Rekursion verzichtete. Stattdessen nutzte sie einen Self-Attention-Mechanismus: Jedes Wort in einem Satz wird gleichzeitig mit jedem anderen Wort in Beziehung gesetzt, um dessen Bedeutung im Kontext zu gewichten.

Technisch reduzierte das die Pfadlänge für den Informationsfluss zwischen zwei beliebigen Wörtern von O(N) bei RNNs auf O(1) beim Transformer. In der Praxis bedeutete das: Training konnte massiv parallelisiert werden. Zum ersten Mal war es möglich, Modelle auf gigantischen, unstrukturierten Datensätzen – letztlich dem gesamten Internet – effizient zu trainieren.

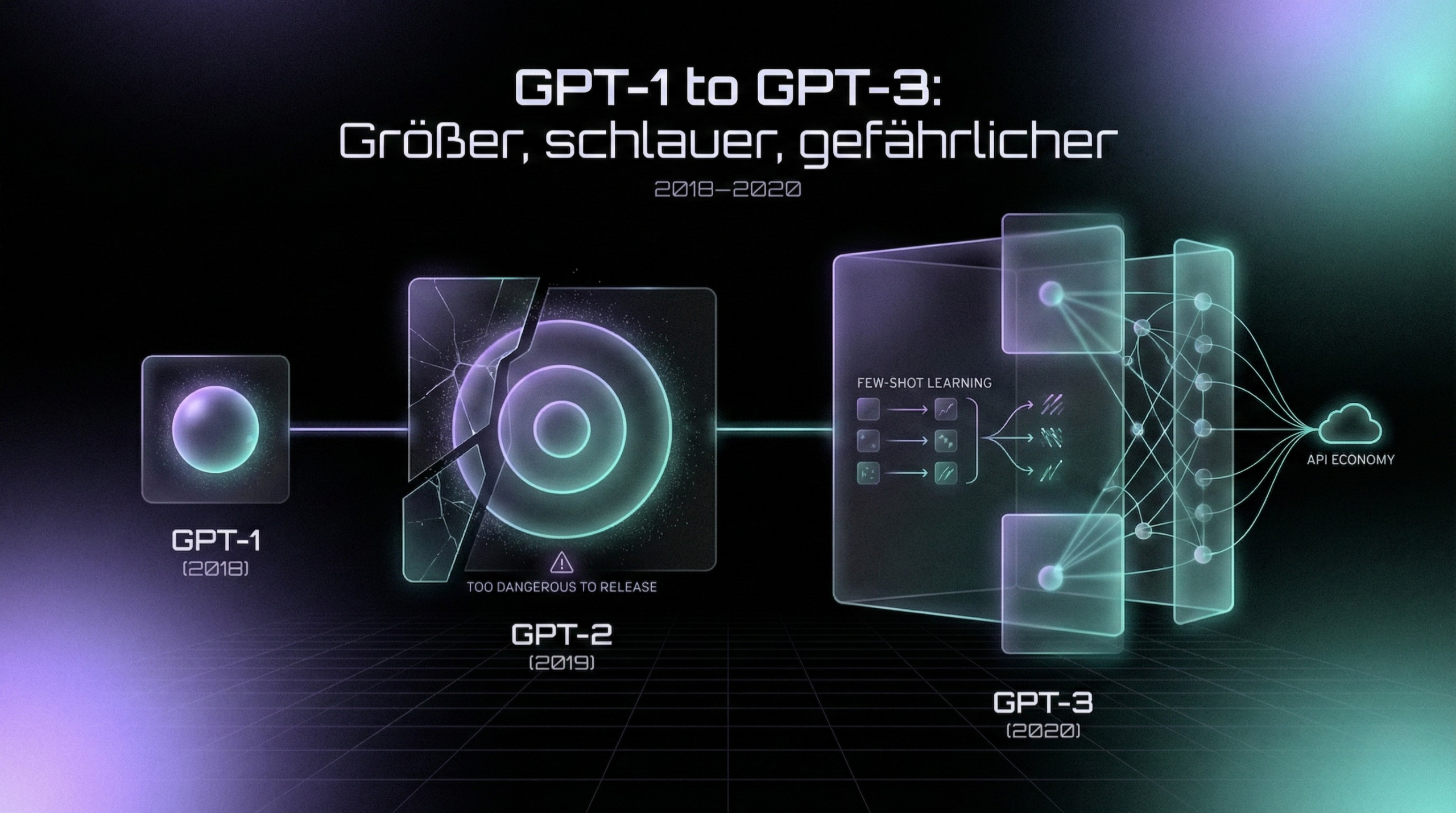

GPT-1 bis GPT-3: Größer, schlauer, gefährlicher (2018–2020)

Nach der Erfindung des Transformers begann das Rennen um die Skalierung. OpenAI erkannte früh: Mehr Daten und größere Modelle führen zu Fähigkeiten, die niemand explizit programmiert hat.

GPT-2 und die Debatte um „Too Dangerous to Release“

Im Juni 2018 veröffentlichte OpenAI GPT-1 – noch relativ unspektakulär. Die Innovation lag nicht in der Architektur, sondern im Trainingsprozess: erst unsupervised Pre-Training auf großen Textmengen, dann Supervised Fine-Tuning für spezifische Aufgaben.

GPT-2 (Februar 2019, 1,5 Milliarden Parameter) war dann der erste richtige Paukenschlag. Das Modell konnte kohärente Texte über mehrere Absätze generieren – und OpenAI brach mit der wissenschaftlichen Tradition der offenen Publikation. Die Begründung: Das Modell sei „zu gefährlich“, um es vollständig freizugeben, weil es für automatisierte Desinformation oder Spam missbraucht werden könnte.

Bei GPT-1 bis GPT-5 ist die spannendste Frage selten „welches Modell ist größer?“, sondern: Was hat sich am Lern- und Produktprinzip verändert – Pretraining, RLHF, Multimodalität, Agentenfähigkeit, Inference-Time-Compute. Wenn du diese Linie sauber nachzeichnen willst, bringt dich die Evolution der GPT-Modelle schnell auf Flughöhe, ohne dass du dich durch einzelne Release-Posts wühlen musst.

Stattdessen implementierte OpenAI einen gestuften Veröffentlichungsplan:

- Februar 2019: Kleines Modell (124M Parameter)

- Mai 2019: Mittleres Modell (355M Parameter)

- November 2019: Vollständiges Modell (1,5B Parameter) nach Überprüfung

Die Kontroverse war enorm – doch sie etablierte die KI-Sicherheitsdebatte endgültig im öffentlichen Diskurs. Technisch zeigte GPT-2 erste Anzeichen von Zero-Shot Learning: Es konnte Aufgaben wie Übersetzung oder Zusammenfassung lösen, für die es nie explizit trainiert wurde, allein durch die Aufgabenbeschreibung im Prompt.

GPT-3: Few-Shot Learning und die API-Ökonomie

Im Mai 2020 skalierte OpenAI die Parameterzahl um den Faktor 100 auf 175 Milliarden. Das Ergebnis war ein qualitativer Sprung, der die Hypothese der „Scaling Laws“ bestätigte.

Das begleitende Paper „Language Models are Few-Shot Learners“ demonstrierte etwas Bemerkenswertes: Bei ausreichender Größe braucht ein Modell kein Fine-Tuning mehr, um neue Aufgaben zu lernen. Du gibst ihm ein paar Beispiele im Prompt – und es extrapoliert das Muster. Dieses „In-Context Learning“ eliminierte die Notwendigkeit, für jede Anwendung ein eigenes Modell zu trainieren.

Ökonomisch war GPT-3 mindestens genauso bedeutend. Anstatt das Modell als Open Source zu veröffentlichen, startete OpenAI eine exklusive API. Das begründete das Geschäftsmodell „Model-as-a-Service“: Startups wie Jasper oder Copy.ai bauten Produkte auf Basis von GPT-3, ohne eigene Trainingsinfrastruktur unterhalten zu müssen. Die Kommerzialisierung generativer KI hatte begonnen.

AlphaFold 2: KI löst ein 50 Jahre altes Biologieproblem (2020)

Während Sprachmodelle Texte schrieben, löste Google DeepMind im November 2020 eines der härtesten Probleme der Biologie: die Proteinfaltung. Seit 50 Jahren versuchten Wissenschaftler vorherzusagen, wie sich eine eindimensionale Kette von Aminosäuren in eine funktionale dreidimensionale Proteinstruktur faltet.

Beim CASP14-Wettbewerb (Critical Assessment of Structure Prediction) erreichte AlphaFold 2 eine Vorhersagegenauigkeit, die an experimentelle Methoden wie die Röntgenkristallographie heranreichte. Der Median-GDT-Wert (Global Distance Test) lag bei 92,4 – Werte über 90 gelten als experimentell genau.

Das war der erste überzeugende Beweis, dass KI fundamentale wissenschaftliche Entdeckungen jenseits von Spielen oder Mustererkennung beschleunigen kann. Die Auswirkungen für Medikamentenentwicklung und biologische Forschung sind bis heute enorm.

Bilder aus Text: DALL-E, Midjourney und Stable Diffusion (2021–2022)

Ab 2021 diffundierte KI aus den Forschungslaboren in die Hände von Endverbrauchern und Künstlern. Der Traum, Text in Bilder zu verwandeln, wurde Realität.

Den Anfang machte DALL-E im Januar 2021. OpenAIs Modell (ein Portmanteau aus WALL-E und Salvador Dalí) zeigte, dass Transformer nicht nur Sprache, sondern auch visuelle Konzepte verstehen und rekombinieren können – etwa „ein Sessel in Form einer Avocado“. Es war ein geschlossenes System, das vor allem das Potenzial aufzeigte.

Im Sommer 2022 folgten DALL-E 2 und Midjourney (Open Beta ab Juli 2022). Beide beeindruckten mit drastisch verbesserter Bildqualität, waren aber hinter geschlossenen Türen oder Discord-Servern zugänglich.

Stable Diffusion – der „Linux-Moment“ der Bildgenerierung

Am 22. August 2022 veränderte sich alles: Stability AI veröffentlichte die Gewichte von Stable Diffusion unter einer permissiven Lizenz. Entwickelt zusammen mit der LMU München und Runway ML, basierte das Modell auf Latent Diffusion Models (LDMs).

Der entscheidende technische Trick: Anstatt direkt im Pixelraum zu arbeiten (extrem rechenintensiv), komprimiert das Modell das Bild in einen niedrigdimensionalen „Latent Space“, führt dort den Diffusionsprozess durch und decodiert das Ergebnis zurück in Pixel. Das ermöglichte es, das Modell auf handelsüblichen Gaming-GPUs mit 8 GB VRAM laufen zu lassen.

Innerhalb von Wochen entstanden Integrationen für Photoshop, Blender und Krita. Die Open-Source-Community explodierte förmlich.

Die Urheberrechts-Debatte

Stable Diffusion wurde auf dem LAION-5B-Datensatz trainiert, der Milliarden von Bildern aus dem Internet enthielt – oft ohne explizite Zustimmung der Urheber. Das entfachte eine heftige ethische und juristische Debatte. Künstler protestierten, Klagen gegen Stability AI folgten. Die Frage, ob KI-generierte Bilder Urheberrechte verletzen, ist bis heute nicht abschließend geklärt.

Open Source bei Bildern ist für viele der echte „Aha“-Moment, weil du plötzlich Kontrolle über Workflows, Modelle und Integrationen bekommst – aber auch mehr Verantwortung für Qualität und Rechtefragen. Wenn du Stable Diffusion nicht nur als Namen, sondern als Ökosystem verstehen willst, ist Infos rund um Stable Diffusion: Open Source Bildgenerierung der passende Anker für Praxis, Setups und Grenzen.

ChatGPT: Der „iPhone-Moment“ der KI (November 2022)

Am 30. November 2022 veröffentlichte OpenAI ChatGPT – und veränderte damit die öffentliche Wahrnehmung von KI für immer. Technisch basierte ChatGPT auf GPT-3.5, einem Modell, das in ähnlicher Form bereits seit Monaten existierte. Die wahre Innovation lag woanders.

Warum RLHF den Unterschied machte

Der Schlüssel war Reinforcement Learning from Human Feedback (RLHF). Frühere Modelle wie GPT-3 waren oft unvorhersehbar oder produzierten toxische Inhalte. Durch RLHF bewerteten menschliche Tester die Modellantworten und rankten sie. Das Modell wurde darauf trainiert, hilfreiche, harmlose und ehrliche Antworten zu priorisieren.

Dazu kam ein simples, aber geniales Interface: ein Chatfenster. Kein API-Zugang, keine Programmierkenntnisse nötig. Jeder konnte sofort loslegen.

100 Millionen Nutzer in zwei Monaten

Die Wachstumszahlen waren historisch: 1 Million Nutzer in 5 Tagen, 100 Millionen in zwei Monaten – schneller als TikTok oder Instagram. ChatGPT wurde zum am schnellsten wachsenden Produkt der Geschichte.

Bei Google löste der Erfolg einen internen „Code Red“ aus. Das Unternehmen, das die Transformer-Technologie selbst erfunden hatte, sah seine Dominanz bei der Informationssuche bedroht und beschleunigte die Entwicklung seiner eigenen Modelle (Bard, später Gemini) drastisch.

Constitutional AI und der Sicherheitsansatz von Anthropic (2022)

Im Dezember 2022 veröffentlichte Anthropic – gegründet von ehemaligen OpenAI-Mitarbeitern um Dario Amodei – das Paper zu Constitutional AI. Der Ansatz unterschied sich fundamental von RLHF.

Anstatt sich ausschließlich auf menschliches Feedback zu verlassen (das subjektiv und schwer skalierbar ist), erhält das Modell eine explizite „Verfassung“ – basierend auf der UN-Menschenrechtscharta, Apples Nutzungsbedingungen und eigenen Prinzipien. Das Modell generiert Antworten, kritisiert diese selbst anhand der Verfassung und korrigiert sie.

Der Vorteil: Sicherheit lässt sich skalieren, ohne dass für jede Korrektur ein Mensch eingreifen muss. Im März 2023 folgte die Veröffentlichung von Claude 1, dem ersten öffentlichen Modell von Anthropic.

Gerade bei Sicherheitsansätzen wie RLHF vs. Constitutional AI merkt man schnell, dass „hilfreich“ nicht automatisch „kontrollierbar“ heißt. Wenn du wissen willst, warum Claude in manchen Situationen vorsichtiger reagiert und wo das im Alltag Vor- oder Nachteile bringt, liefert dir der Hub Infos rund um Claude die nötige Orientierung für echte Entscheidungen statt Bauchgefühl.

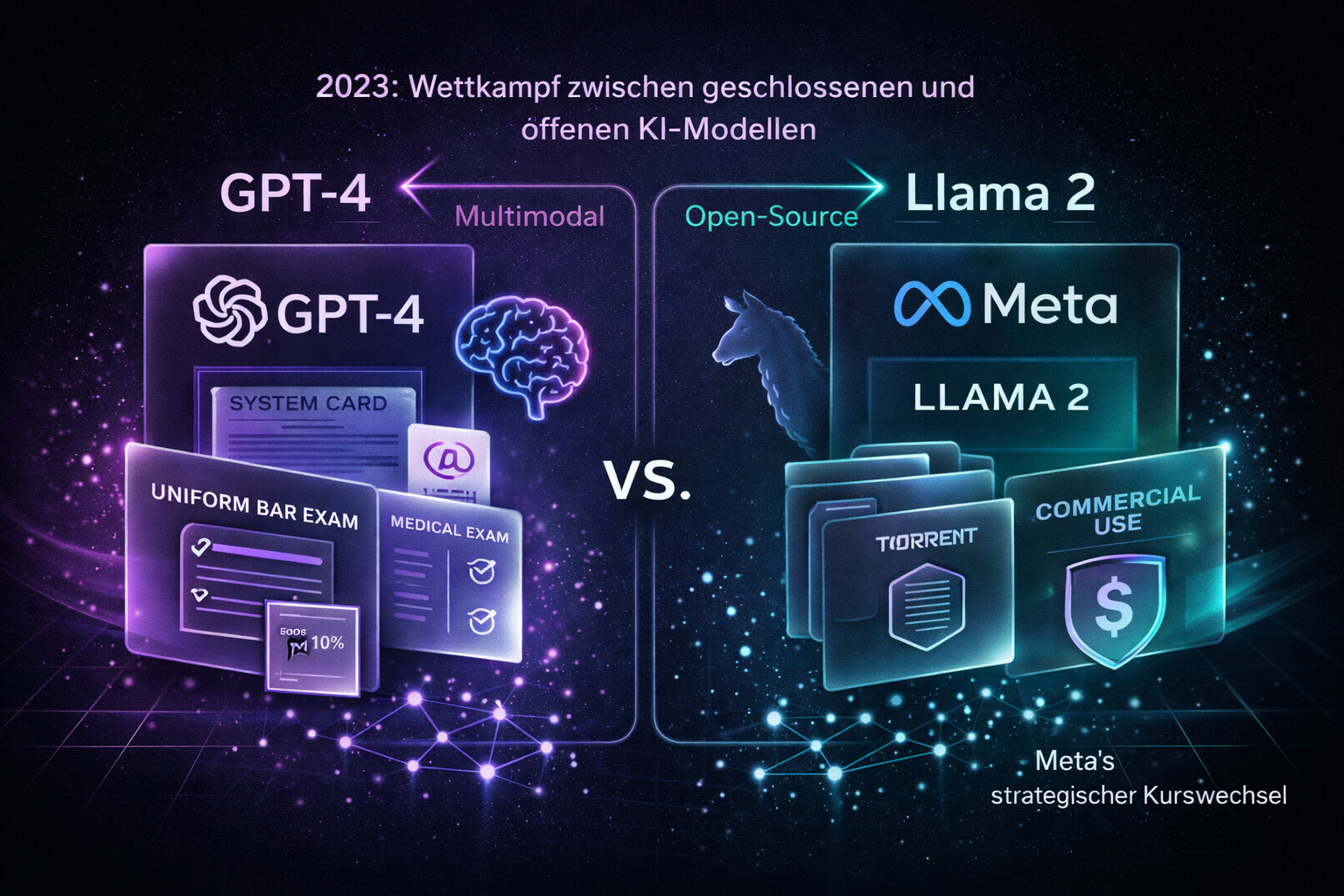

2023: GPT-4, Llama und der Open-Source-Krieg

2023 war das Jahr, in dem der Wettkampf zwischen geschlossenen und offenen KI-Modellen voll entbrannte. Die Leistung der Modelle machte einen massiven Sprung – und eine strategische Entscheidung von Meta veränderte die gesamte Marktlandschaft.

GPT-4 – Multimodalität und Reasoning auf neuem Niveau

Am 14. März 2023 veröffentlichte OpenAI GPT-4. Der Sprung gegenüber GPT-3.5 war enorm, besonders im logischen Denken: Während GPT-3.5 regelmäßig an logischen Fangfragen scheiterte, konnte GPT-4 komplexe juristische Prüfungen bestehen (Uniform Bar Exam, Top 10 %) und medizinische Examina absolvieren.

GPT-4 führte außerdem Multimodalität ein – zunächst nur für Entwickler. Das Modell konnte Bilder als Input verarbeiten und Fragen dazu beantworten. OpenAI veröffentlichte detaillierte System Cards, die die Sicherheitsmaßnahmen dokumentierten – ein neuer Transparenzstandard für Frontier-Modelle.

Der Llama-Leak und Metas strategischer Kurswechsel

Meta verfolgte unter Yann LeCun eine Strategie, die diametral zu OpenAIs geschlossenem Ansatz stand. Am 24. Februar 2023 gab Meta Llama 1 (Large Language Model Meta AI) zunächst nur an ausgewählte akademische Forscher weiter. Eine Woche später wurde ein Torrent-Link mit den Modellgewichten auf 4chan gepostet.

Anstatt das Leck aggressiv zu bekämpfen, entschied sich Meta für einen strategischen Pivot: Im Juli 2023 wurde Llama 2 offiziell für die kommerzielle Nutzung freigegeben. Startups und Unternehmen hatten nun eine leistungsfähige, kostenlose Alternative zu GPT-4, die sie auf eigener Infrastruktur betreiben konnten – ein entscheidender Vorteil für Datenschutzbedenken.

Experten nannten Metas Strategie „Commoditizing the Complement“: Das Modell wird zur Ware, um das eigene Ökosystem zu dominieren. Meta positionierte sich damit als das „Android der KI“ – das offene Ökosystem gegen die geschlossenen Systeme von OpenAI und Google.

2024: Video, Nobelpreis und System-2-Denken

2024 war das Jahr, in dem KI die Grenzen reiner Textgenerierung hinter sich ließ. Video-Simulation, Echtzeit-Multimodalität und ein Chemie-Nobelpreis zeigten: Die Technologie ist längst keine Spielerei mehr.

Sora – KI als Welt-Simulator

Am 15. Februar 2024 stellte OpenAI Sora vor – und die Reaktionen waren ungläubig. Das Modell generierte hyper-realistische Videos von bis zu einer Minute Länge. Anders als frühere Videomodelle, die unter morphenden Objekten und flackernden Hintergründen litten, zeigte Sora Objektpermanenz und ein rudimentäres Verständnis von Physik: Reflexionen, Kollisionen, Fallverhalten.

Die Technologie basiert auf einer „Space-Time Patch“-Architektur, die Video als Sequenz von Patches behandelt – ähnlich wie Token bei Text. OpenAI framte Sora bewusst nicht primär als Kreativ-Tool, sondern als „World Simulator“. Die dahinterliegende Hypothese: Wer genug Videodaten vorhersagen kann, lernt implizit die physikalischen Gesetze der Welt.

Sora ist als „World Simulator“ spannend, aber für dich zählt am Ende: Was kannst du heute damit bauen, was kostet es dich Zeit und welche Grenzen musst du einplanen. Wenn du diese Fragen ohne Hype beantworten willst, hilft dir der Überblick Infos rund um Sora: OpenAIs Videogenerator dabei, Erwartungen und Realität sauber übereinanderzulegen.

GPT-4o – Echtzeit-Multimodalität in einem Modell

Im Mai 2024 folgte GPT-4o („o“ für omni). Es war das erste nativ multimodale Modell für den Massenmarkt. Bisherige Systeme wie der ChatGPT Voice Mode nutzten eine Kette aus drei separaten Modellen: Speech-to-Text (Whisper), dann Textverarbeitung (GPT-4), dann Text-to-Speech. Das Ergebnis waren spürbare Latenzen und Informationsverlust – der Tonfall ging verloren, Nuancen verschwanden.

GPT-4o verarbeitete Audio, Vision und Text in einem einzigen neuronalen Netz. Die Reaktionszeit sank auf rund 320 Millisekunden – vergleichbar mit menschlicher Konversation. Das Modell konnte emotionale Intonation erkennen und sogar Gesang generieren.

Claude 3.5 Sonnet – die neue Coding-Referenz

Mitten im GPT-4o-Hype veröffentlichte Anthropic am 20. Juni 2024 Claude 3.5 Sonnet. Das Modell etablierte sich schnell als Favorit unter Softwareentwicklern: In Coding-Benchmarks wie HumanEval und SWE-bench setzte es neue Bestwerte.

Mindestens genauso wichtig war ein UX-Feature namens „Artifacts“. Damit konnte Claude Code und kleine Apps direkt im Browser rendern und interaktiv machen. Das zeigte: UX-Innovationen sind mindestens so entscheidend wie reine Modellleistung.

AlphaFold 3 und der Chemie-Nobelpreis

Am 8. Mai 2024 veröffentlichte DeepMind AlphaFold 3. Während AlphaFold 2 Proteine faltete, konnte die neue Version die Interaktionen von Proteinen mit DNA, RNA und kleinen Molekülen – also potenziellen Medikamenten – vorhersagen. Die Architektur nutzte Diffusionsmodelle (ähnlich wie bei Bildgeneratoren) für die Strukturvorhersage, was die Genauigkeit bei komplexen molekularen Bindungen drastisch erhöhte.

Dann kam die ultimative Bestätigung: Im Oktober 2024 erhielten Demis Hassabis und John Jumper (DeepMind) zusammen mit David Baker den Chemie-Nobelpreis. Das Nobelkomitee würdigte die Lösung eines 50 Jahre alten biologischen Problems. Es war das erste Mal, dass KI-Forschung direkt zu einem Nobelpreis führte.

OpenAI o1 „Strawberry“ – Chain-of-Thought-Skalierung

Am 12. September 2024 stellte OpenAI o1 vor (frühere Codenamen: Q* und Strawberry). Damit begann eine neue Ära im KI-Denken.

Bis dahin basierten alle großen Sprachmodelle auf „System 1″-Denken: schnell, intuitiv, aber fehleranfällig bei komplexer Logik. o1 führte „System 2″-Denken ein. Das Modell „denkt“ bevor es antwortet – es generiert interne Gedankenketten (Hidden Chain of Thought), zerlegt Probleme in Teilprobleme, testet Strategien und korrigiert Fehler selbstständig, bevor die finale Antwort ausgegeben wird.

Die Ergebnisse waren beeindruckend: o1 übertraf menschliche PhD-Experten in Physik, Chemie und Biologie auf dem GPQA-Benchmark. Noch wichtiger war die dahinterliegende Erkenntnis: Mehr Rechenzeit während der Antwort (Inference-Time Compute) verbessert die Leistung massiv – eine völlig neue Skalierungsdimension neben mehr Training und mehr Daten.

2025: Das Jahr der autonomen Agenten

2025 markierte den Übergang von Chatbots zu echten „Reasoning Engines“ und autonomen Agenten. KI erledigte nun nicht mehr nur Einzelaufgaben, sondern arbeitete über Stunden und Tage eigenständig an komplexen Problemen.

Llama 4 und Mixture-of-Experts

Am 5. April 2025 veröffentlichte Meta Llama 4 in zwei Varianten: Scout (109B Parameter) und Maverick (400B Parameter). Die Architektur wechselte vollständig zu Mixture-of-Experts (MoE) – für jeden Token wird nur ein Bruchteil der Parameter aktiviert. Das machte die Modelle extrem effizient bei der Inferenz, trotz enormer Gesamtgröße.

Llama 4 Maverick erreichte Parität mit den besten geschlossenen Modellen und ermöglichte erstmals hochintelligenten Agenten-Betrieb auf lokaler Hardware. Metas Open-Source-Strategie zahlte sich endgültig aus.

GPT-5 – agentenbasierte Workflows

Am 7. August 2025 veröffentlichte OpenAI nach fast zwei Jahren Gerüchten GPT-5. Sam Altman beschrieb es als „signifikanten Sprung“ – und diesmal war das keine Übertreibung.

GPT-5 wurde nicht mehr primär als Chatbot konzipiert, sondern als Agent. Es konnte Aufgaben über Stunden oder Tage autonom erledigen: eine komplette Reise planen und buchen, dabei das Budget überwachen und den Kalender abgleichen. Oder ein Software-Feature von der Planung über die Implementierung bis zum Testing durchführen.

Ein entscheidender Fortschritt war die Reduktion von Halluzinationen. Durch neue Trainingsmethoden – wahrscheinlich verifiziertes RLHF mit synthetischen Daten aus o1 – wurde das Modell zuverlässig genug für den Einsatz in kritischen Unternehmensbereichen.

Gemini 3 – das unendliche Kontextfenster

Ende 2025 konterte Google mit Gemini 3. Das herausragende Feature: ein Kontextfenster, das theoretisch unendlich erschien – getestet bis 10 Millionen Token und mehr.

Was bedeutet das in der Praxis? Unternehmen konnten ihre gesamte historische Datenbank, komplette Code-Repositories oder stundenlanges Videomaterial direkt in den Kontext laden. Komplexe RAG-Systeme (Retrieval Augmented Generation), die bisher nötig waren, um große Datenmengen zu verarbeiten, wurden in vielen Fällen überflüssig. Gemini 3 Flash wurde zum Standard für die kosteneffiziente Verarbeitung riesiger Datenmengen.

Was diese Dekade bedeutet – und was als Nächstes kommt

Synthetische Daten, Reasoning als Ware und physische Verankerung

Die Dekade 2015–2025 hat eine einfache Hypothese bestätigt: Mehr Rechenleistung und mehr Daten führen zu intelligenteren Systemen. Diese „Scaling Laws“ haben sich als beängstigend robust erwiesen – vom einfachen Klassifikator bis zu Systemen, die Nobelpreis-würdige Wissenschaft betreiben und komplexe Software entwickeln.

Zum Ende des Jahres 2025 zeichnen sich drei Trends für die nächste Dekade ab.

Erstens: Synthetische Daten. Das Internet als Trainingsquelle ist weitgehend ausgeschöpft – die sogenannte „Data Wall“. Modelle trainieren zunehmend auf Daten, die von anderen, „denkenden“ Modellen (wie o1) generiert und verifiziert werden.

Zweitens: Reasoning als Ware. Logisches Schließen ist billig und ubiquitär geworden. Die Wertschöpfung verschiebt sich von der Generierung einzelner Antworten zur Orchestrierung ganzer Agenten-Workflows.

Drittens: Physische Verankerung. Mit Modellen wie Sora (Weltverständnis) und multimodalen GPTs ist der Weg frei für Robotik, die in der echten Welt agiert. KI hat aufgehört, ein reines Werkzeug zur Text- oder Bilderzeugung zu sein – sie ist zu einer Infrastruktur für Kognition geworden.

FAQ

Was war der wichtigste KI-Meilenstein der letzten zehn Jahre?

Das lässt sich nicht auf ein einzelnes Ereignis reduzieren. Technologisch war das Transformer-Paper „Attention Is All You Need“ (2017) das Fundament für praktisch alles, was danach kam – GPT, Claude, Llama, Gemini. Für die breite Öffentlichkeit war ChatGPT (November 2022) der entscheidende Moment, weil es KI zum ersten Mal für jeden zugänglich machte.

Was ist der Unterschied zwischen GPT-3, GPT-4 und GPT-5?

GPT-3 (2020, 175 Milliarden Parameter) zeigte, dass Sprachmodelle Aufgaben durch wenige Beispiele im Prompt lösen können (Few-Shot Learning). GPT-4 (2023) brachte einen massiven Sprung im logischen Denken und führte Multimodalität ein – das Modell konnte erstmals Bilder verarbeiten. GPT-5 (2025) ging noch weiter und wurde als autonomer Agent konzipiert, der komplexe Aufgaben über Stunden eigenständig bearbeitet.

Warum hat AlphaFold den Nobelpreis bekommen?

AlphaFold löste das Proteinfaltungsproblem – eine Frage, an der Biologen seit 50 Jahren gescheitert waren. Die Software kann vorhersagen, wie sich Aminosäureketten in dreidimensionale Proteinstrukturen falten. Das hat enorme Auswirkungen auf die Medikamentenentwicklung und biologische Grundlagenforschung. 2024 erhielten Demis Hassabis und John Jumper von DeepMind dafür den Chemie-Nobelpreis.

Was bedeutet „Open Source“ bei KI-Modellen wie Llama?

Meta veröffentlicht die Gewichte (die trainierten Parameter) seiner Llama-Modelle frei zugänglich. Jeder kann das Modell herunterladen und auf eigener Hardware betreiben. Das ist ein wichtiger Unterschied zu geschlossenen Modellen wie GPT-4, die nur über eine kostenpflichtige API zugänglich sind. Allerdings gibt es eine Debatte, ob das wirklich „Open Source“ ist, da Meta den Trainingscode und die Trainingsdaten nicht veröffentlicht.

Was sind KI-Agenten?

KI-Agenten sind Systeme, die nicht nur auf einzelne Fragen antworten, sondern eigenständig mehrstufige Aufgaben erledigen. Sie erstellen Pläne, führen Schritte aus, prüfen Ergebnisse und korrigieren Fehler – ohne dass ein Mensch jeden Zwischenschritt absegnen muss. 2025 wurde diese Technologie durch stabilere Reasoning-Fähigkeiten (o1, GPT-5) erstmals produktionsreif.

Was ist der Transformer und warum ist er so wichtig?

Der Transformer ist eine neuronale Netzwerk-Architektur, die 2017 von Google Brain vorgestellt wurde. Sein Kernmechanismus – Self-Attention – erlaubt es dem Modell, jedes Wort gleichzeitig mit jedem anderen Wort in Beziehung zu setzen, statt Texte Wort für Wort zu verarbeiten. Das ermöglichte erstmals effizientes Training auf riesigen Datenmengen und ist die Grundlage aller großen Sprachmodelle.

Suchen ist in dieser Dekade still und heimlich neu definiert worden: Nicht mehr zehn blaue Links, sondern eine Antwort mit Quellen – idealerweise nachvollziehbar. Wenn du entscheiden willst, ob du für Recherche eher ChatGPT, Perplexity oder eine Kombination nutzt, hilft dir der KI-Suche Vergleich: Perplexity vs ChatGPT bei einer Wahl, die dir später Zeit spart.

Quellen und weitere Infos:

- Google DeepMind – AlphaGo

- Wikipedia – Attention Is All You Need

- Brown et al. – Language Models are Few-Shot Learners

- OpenAI – GPT-2 1.5B Release

- The Guardian – ChatGPT reaches 100 million users

- Anthropic – Claude New Constitution

- OpenAI – Learning to Reason with LLMs (o1)

- OpenAI – Sora 2

- Google Blog – Introducing Gemini 3