ElevenLabs hat sich vom viralen Startup zum dominierenden Player für KI-generierte Stimmen entwickelt. Die Plattform kann weit mehr als nur Text vorlesen – sie klont Stimmen, synchronisiert Videos und transkribiert Sprache in Echtzeit.

Ob du Hörbücher produzierst, NPCs in Spielen zum Sprechen bringst oder Artikel für dein Magazin vertonen willst: Hier erfährst du alles, was du über ElevenLabs wissen musst – Funktionen, Preise, deutsche Sprachqualität und die besten Alternativen.

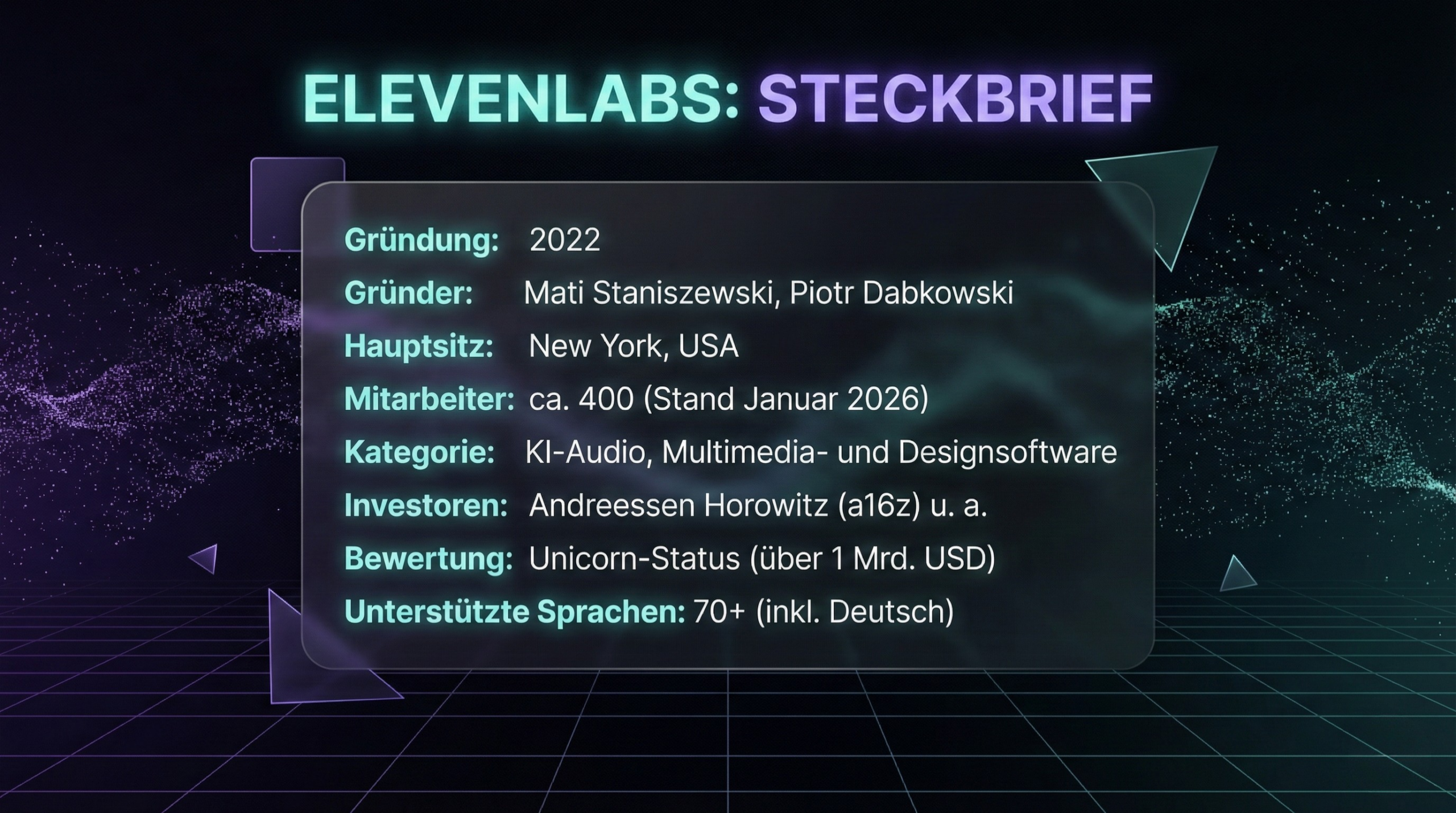

ElevenLabs im Steckbrief

| Merkmal | Details |

|---|---|

| Gründung | 2022 |

| Gründer | Mati Staniszewski, Piotr Dabkowski |

| Hauptsitz | New York, USA |

| Mitarbeiter | ca. 400 (Stand Januar 2026) |

| Kategorie | KI-Audio, Multimedia- und Designsoftware |

| Investoren | Andreessen Horowitz (a16z) u. a. |

| Bewertung | Unicorn-Status (über 1 Mrd. USD) |

| Unterstützte Sprachen | 70+ (inkl. Deutsch) |

Die Gründungsgeschichte beginnt mit einer persönlichen Frustration: Staniszewski und Dabkowski störten sich an der schlechten Qualität polnischer Synchronisationen in westlichen Filmen. Statt robotisch klingende Stimmen zu bauen, war das Ziel von Anfang an Natürlichkeit – inklusive Atempausen, Intonationsschwankungen und sogar Lachen.

Innerhalb weniger Monate nach dem Start 2023 registrierten sich über eine Million Nutzer. Heute positioniert sich ElevenLabs als eine Art „Audio-Betriebssystem“, das Hören (Transkription), Verstehen (Konversationslogik) und Sprechen (Sprachsynthese) unter einem Dach vereint.

Für wen ist ElevenLabs geeignet?

Content Creator und YouTuber

Du brauchst einen konsistenten Erzähler für deine Videos, willst aber kein Mikrofon aufbauen? Mit ElevenLabs erstellst du professionelle Voiceovers in Minuten. Besonders praktisch: Du kannst deine eigene Stimme klonen und sparst dir künftige Aufnahme-Sessions.

Wenn du ElevenLabs primär für YouTube, Podcasts oder Social-Media-Content nutzen willst, ist der Blick auf das Gesamt-Toolkit entscheidend. In den besten KI-Tools für Content Creator siehst du, wie Sprachsynthese mit Video-, Bild- und Text-KI zusammenspielt – und wo ElevenLabs im Creator-Stack den größten Hebel hat.

Verlage und Medienhäuser

Partner wie TIME und The New Yorker nutzen ElevenLabs bereits, um Webartikel automatisch zu vertonen. Das steigert die Verweildauer auf der Seite und macht Premium-Inhalte für ein breiteres Publikum zugänglich.

Spieleentwickler und App-Developer

Dynamische NPC-Dialoge, Sprachassistenten oder interaktive Chatbots – das Flash-Modell liefert Antworten in unter 75 Millisekunden. Damit klingen KI-gesteuerte Charaktere nicht mehr wie Anrufbeantworter.

Unternehmen mit Lokalisierungsbedarf

Das Dubbing Studio übersetzt und synchronisiert Videoinhalte in über 70 Sprachen. Die Partnerschaft mit ESTsoft (Perso.ai) geht noch weiter: Mundbewegungen im Video werden frame-genau an die neue Sprache angepasst.

Freelancer stehen oft vor der Frage, welches Tool wirklich Umsatz bringt und nicht nur Spielerei ist. Die Übersicht der Top 10 KI-Tools für Freelancer zeigt dir, wie du Voice Cloning, Transkription und Automatisierung profitabel kombinierst – besonders spannend, wenn du Kundenprojekte skalieren willst.

Hörbuchproduzenten

Das Studio-Tool ermöglicht dokumentenbasiertes Arbeiten mit mehreren Sprechern, granularer Pausenkontrolle und der Möglichkeit, einzelne Absätze neu zu generieren, ohne das gesamte Projekt anzufassen.

ElevenLabs Preise & Pläne

Preisübersicht

| Plan | Preis/Monat | Credits (Zeichen) | Audio-Dauer (ca.) | Wichtigste Features |

|---|---|---|---|---|

| Free | 0 $ | 10.000 | ~10 Min. | 3 Custom Voices, Attribution-Pflicht, 32 kbps Audio |

| Starter | 5 $ | 30.000 | ~30 Min. | Kommerzielle Lizenz, Instant Voice Cloning |

| Creator | 22 $ | 100.000 | ~2 Std. | Professional Voice Cloning, 192 kbps, API-Zugriff |

| Pro | 99 $ | 500.000 | ~10 Std. | 44,1 kHz PCM-Output (WAV), Priority Support |

| Scale | 330 $ | 2.000.000 | ~40 Std. | Multi-Seat Workspace (3 Sitze), höhere Rate Limits |

| Business | 1.320 $ | 11.000.000 | ~220 Std. | 5 Sitze, dedizierter Support, niedrigere Latenz-Preise |

Ein Credit entspricht in der Regel einem Zeichen. Flash-Modelle kosten nur 0,5 Credits pro Zeichen – das halbiert die Kosten für Echtzeit-Anwendungen.

Sobald du ernsthaft über ein Abo nachdenkst, hilft dir ein datenbasierter Praxiseindruck weiter: Im ausführlichen ElevenLabs-Test zum KI-Stimmen-Marktführer findest du konkrete Klangbeispiele, Einschätzungen zur deutschen Sprachqualität und eine realistische Bewertung der Credit-Kosten im Alltag.

Versteckte Kosten: Der Regenerations-Multiplikator

Die Preistabelle erzählt nicht die ganze Geschichte. Da KI-Sprachgenerierung probabilistisch arbeitet, ist der erste Take selten perfekt. In der Praxis musst du denselben Satz oft 3–4 Mal generieren, bis Intonation und Betonung stimmen. Jede Regeneration kostet volle Credits.

Erfahrene Nutzer kalkulieren deshalb mit einem Multiplikator von 2,2x bis 2,8x der eigentlich benötigten Textmenge. Für ein Projekt mit 100.000 Zeichen solltest du also eher 220.000–280.000 Credits einplanen.

Dazu kommt: Professionelle Produktionen (Rundfunk, High-End-YouTube) brauchen unkomprimierten PCM-Output in 44,1 kHz. Den gibt es erst ab dem Pro-Plan für 99 $/Monat. Der Creator-Plan liefert nur 192 kbps MP3.

Bevor du dich zwischen Free, Starter oder Pro entscheidest, lohnt sich ein strategischer Blick auf die Grundsatzfrage: Wann rechnet sich ein Upgrade wirklich? Die Analyse zu Kostenlos vs. Premium bei KI-Tools – lohnt sich ein bezahltes Abo 2026? hilft dir, ElevenLabs im Kontext deiner Content- oder Business-Ziele einzuordnen.

API-Kosten und Concurrency Limits

Für Entwickler gelten strikte Limits bei gleichzeitigen Anfragen. Der Starter-Plan erlaubt nur 3 parallele Requests – ein Spiel mit tausenden Spielern läuft hier sofort gegen die Wand. Erst ab dem Scale-Plan (15 gleichzeitige Anfragen) oder mit dedizierten Enterprise-Verträgen ist echte Skalierung möglich. Viele Teams bauen deshalb eigene Queueing-Systeme oder steigen früher auf teurere Pläne um.

Gerade bei API-Projekten entscheidet nicht nur die Klangqualität, sondern das Verhältnis aus Preis, Skalierbarkeit und Limits. Wenn du ElevenLabs in Apps, Games oder Agenten einbauen willst, solltest du die besten KI-APIs nach Preis-Leistung im Vergleich prüfen, um zu sehen, wo ElevenLabs bei Concurrency, Rate Limits und Gesamtkosten im Marktvergleich steht.

Die wichtigsten Funktionen

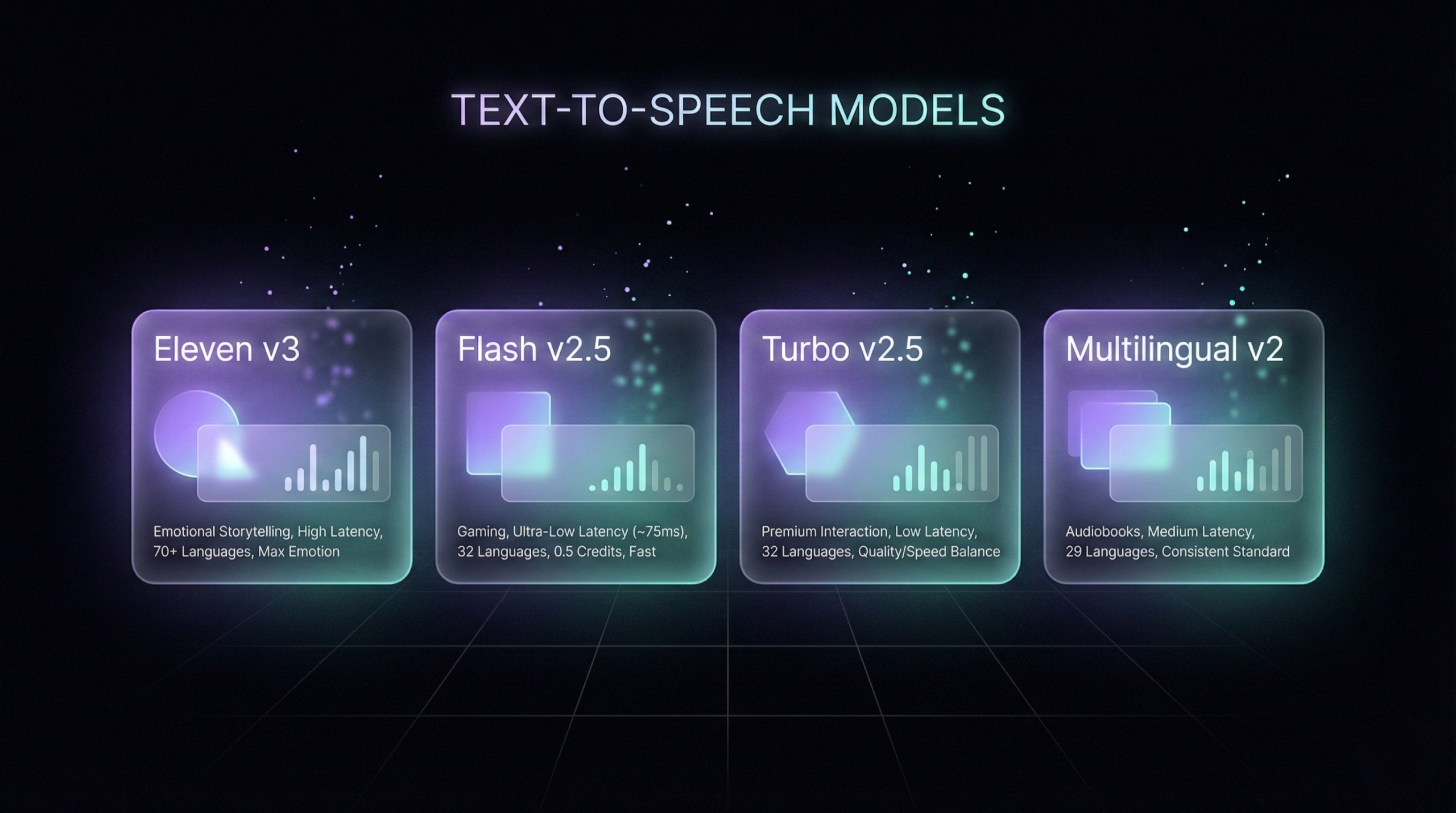

Text-to-Speech: Die Modelle im Überblick

ElevenLabs bietet nicht ein TTS-Modell, sondern eine ganze Suite – jeweils optimiert für unterschiedliche Kompromisse zwischen Qualität, Geschwindigkeit und Kosten.

| Modell | Einsatzzweck | Latenz | Sprachen | Besonderheit |

|---|---|---|---|---|

| Eleven v3 (Alpha) | Emotionales Storytelling | Hoch | 70+ | Maximale emotionale Bandbreite, versteht Regieanweisungen |

| Flash v2.5 | Gaming, Chatbots | Ultra-niedrig (~75 ms) | 32 | 0,5 Credits/Zeichen, extrem schnell |

| Turbo v2.5 | Premium-Interaktion | Niedrig | 32 | Balance aus Qualität und Geschwindigkeit |

| Multilingual v2 | Hörbücher, Long-form | Mittel | 29 | Stabiler Standard, konsistente Aussprache |

Eleven v3 – Emotionen auf neuem Level

Eleven v3 ist kein Vorleser, sondern ein Schauspieler. Das Modell analysiert den semantischen Kontext und kann unterscheiden, ob ein Flüstern bedrohlich oder beruhigend klingen soll. Über Audio-Tags wie [laughing], [sighs] oder [hesitation] gibst du direkte Regieanweisungen.

Der Haken: Im Januar 2026 befindet sich v3 noch im Alpha-Status. Die Latenz ist höher, Requests sind auf 5.000 Zeichen begrenzt, und bei kurzen Prompts treten Inkonsistenzen auf. Für Echtzeitanwendungen ist das Modell noch nicht empfehlenswert.

Flash v2.5 – Für Echtzeit-Anwendungen

Wenn Geschwindigkeit zählt, ist Flash v2.5 die Wahl. Antworten kommen in unter 75 Millisekunden (ohne Netzwerklatenz). Das ermöglicht flüssige Gespräche mit KI-Agenten ohne unnatürliche Pausen. Dazu kommt der ökonomische Vorteil: Nur 0,5 Credits pro Zeichen machen hochvolumige Anwendungen erst rentabel.

Multilingual v2 – Der stabile Standard

Für Hörbücher und längere Produktionen bleibt Multilingual v2 das Arbeitspferd. Es liefert konsistente Aussprache über Stunden hinweg und neigt weniger zu Halluzinationen als neuere Modelle. Wer 10 Stunden Narration braucht, fährt hier am sichersten.

Voice Cloning: Instant vs. Professional

Das Klonen von Stimmen ist das Flaggschiff-Feature von ElevenLabs. Es gibt zwei Stufen:

Instant Voice Cloning (IVC) braucht nur 1–5 Minuten Audiomaterial. Die KI inferiert Stimmcharakteristika per Few-Shot-Learning und liefert sofort Ergebnisse. Die Qualität reicht für Standard-Erzähler, ist aber anfällig für Akzente und schlechte Aufnahmequalität.

Professional Voice Cloning (PVC) ist ab dem Creator+-Plan verfügbar und benötigt 30 Minuten bis 3 Stunden hochwertiges Audio. Hier wird ein dediziertes Modell trainiert (Fine-Tuning). Das Ergebnis ist eine hyperrealistische Replikation, die selbst subtile Atemgeräusche und Mikro-Inflektionen einfängt. Der Prozess beinhaltet eine strikte Verifizierung, bei der du einen zufälligen Text live einsprechen musst, um zu beweisen, dass es sich um deine eigene Stimme handelt.

Speech-to-Speech: Stimmen transformieren

Anders als bei Text-to-Speech gibst du hier nicht Text ein, sondern sprichst selbst. Die KI übernimmt deine Betonung, deinen Rhythmus und deine Intonation und überträgt sie auf eine Zielstimme. Das ist besonders wertvoll für Synchronarbeiten, bei denen das Timing nicht verhandelbar ist.

Scribe v2 – Sprache zu Text

Mit Scribe v2 ist ElevenLabs 2026 auch in die Spracherkennung eingestiegen und konkurriert direkt mit Lösungen wie OpenAIs Whisper.

Scribe v2 Realtime erreicht eine Latenz von unter 150 Millisekunden, unterstützt über 90 Sprachen und erkennt automatisch Sprachwechsel – ideal für mehrsprachige Meetings.

Scribe v2 Batch ist für die Nachbearbeitung langer Audiodateien optimiert. Das Besondere: Über „Keyterm Prompting“ kannst du spezifische Fachbegriffe oder Produktnamen einspeisen, um die Erkennungsrate zu verbessern. Zusätzlich erkennt das System automatisch personenbezogene Daten (PII) für die Compliance-Sicherung.

Dubbing Studio und Lip-Sync

Das Dubbing Studio übersetzt und synchronisiert Videoinhalte. Die KI versucht dabei, die tonalen Eigenschaften des Originalsprechers in der Zielsprache beizubehalten. Ein Timeline-Editor erlaubt präzise Eingriffe: Übersetzungen lassen sich zeitlich verschieben, kürzen oder neu generieren, um Asynchronität zwischen Bild und Ton zu minimieren.

Durch die Partnerschaft mit ESTsoft (Perso.ai) geht ElevenLabs noch einen Schritt weiter: Die Mundbewegungen der Sprecher im Video werden frame-genau an die neue Sprache angeglichen. Für die globale Unterhaltungsindustrie ist das ein Gamechanger.

Audio Native – Artikel automatisch vertonen

Für Verlage gibt es Audio Native: ein eingebetteter Player, der Webartikel automatisch vertont. Die Integration funktioniert über ein einfaches JavaScript-Snippet. Verlage wie TIME nutzen das, um die Verweildauer auf ihren Seiten zu steigern. Das System generiert Audio on-the-fly bei Veröffentlichung neuer Artikel.

Für komplexe Workflows – etwa automatische Vertonung neuer Blogposts – brauchst du mehr als nur eine API. Der Vergleich Make vs. Zapier vs. n8n – Automatisierungs-Tools im Überblick zeigt dir, wie du ElevenLabs sauber in Publishing-, CRM- oder E-Commerce-Prozesse integrierst.

Studio – Hörbücher und Long-form Content

Das Studio (ehemals „Projects“) ist die zentrale Arbeitsumgebung für längere Inhalte. Du importierst ein Manuskript, weist verschiedenen Textabschnitten unterschiedliche Sprecher zu und steuerst Pausen granular über Tags wie <break time="1.5s" />. Wenn ein einzelner Satz misslingt, generierst du nur diesen Abschnitt neu – nicht das ganze Kapitel.

Ein Tipp aus der Praxis: Der Roh-Output von ElevenLabs ist „trocken“. Für professionelle Ergebnisse solltest du in der Nachbearbeitung (DAW) einen leichten Kompressor, EQ (Anhebung bei 3–5 kHz für Präsenz) und eine Normalisierung auf −3 dB anwenden.

ElevenLabs auf Deutsch

Qualität der deutschen Stimmen

Die Modelle Multilingual v2 und Eleven v3 beherrschen Deutsch fließend. Die Qualität hat sich bis 2026 deutlich verbessert – besonders bei zusammengesetzten Substantiven (Komposita), die für ältere TTS-Systeme regelmäßig eine Stolperfalle waren.

Regionale Akzente und Dialekte

Neben Hochdeutsch bietet die Voice Library zunehmend regionale Akzent-Stimmen:

Bayerisch: Stimmen wie Niraj oder Muskaan sind als „Bayerisch“ kategorisiert. Nutzerfeedback zeigt allerdings, dass die Authentizität schwankt und oft Ausprobieren nötig ist.

Sächsisch und Ostdeutsch: Neuere Stimmen wie Ronny Ratze (Sachsen-Anhalt/Magdeburg) oder Tony Saxon bilden spezifische ostdeutsche Dialekte ab – relevant für lokale Produktionen oder Comedy-Formate.

Bekannte Probleme bei gemischtsprachigen Texten

Ein spezifisches Problem betrifft die ElevenLabs Reader App: Bei Texten mit deutschen und englischen Passagen kann die automatische Spracherkennung ins Stolpern geraten. Deutsche Abschnitte werden dann mit englischem Akzent vorgelesen. Im Studio lässt sich die Sprache für einzelne Textblöcke manuell festlegen – das funktioniert, verlangsamt aber den Workflow.

ElevenLabs Alternativen

Cartesia – Günstiger und schneller

Cartesia ist der aggressive Herausforderer mit Fokus auf Geschwindigkeit. Die „Sonic Turbo“-Modelle sind oft schneller und kosten rund ein Fünftel von ElevenLabs. Der Nachteil: Es fehlt die Tiefe des Ökosystems – kein Studio, weniger Sprachen. In Blindtests bevorzugen 60 % der Teilnehmer die Stimmen von ElevenLabs in Sachen Natürlichkeit. Wer aber reine Echtzeit-Anwendungen baut und auf den Preis achten muss, sollte Cartesia prüfen.

Play.ht – Stark beim Voice Cloning

Play.ht bietet oft attraktivere Flatrate-Modelle für Power-User. Bei der emotionalen Bandbreite liegt Play.ht etwas hinter ElevenLabs, ist aber für Standard-Anwendungen eine solide Alternative – besonders wenn das Budget begrenzt ist.

OpenAI TTS – Einfach, aber eingeschränkt

OpenAIs TTS-Modelle (TTS-1, TTS-1-HD) sind extrem günstig und einfach zu integrieren. Der große Nachteil: Kein Voice Cloning (Stand Januar 2026). Du bist auf wenige Preset-Stimmen wie Alloy oder Echo beschränkt. Wer Individualität braucht, kommt an ElevenLabs nicht vorbei.

Sicherheit und Ethik

Stimm-Verifizierung

Um einen Professional Voice Clone zu erstellen, musst du eine aktive Verifizierung durchlaufen. Das System fordert dich auf, einen zufälligen Text live einzusprechen. Die KI vergleicht die akustischen Merkmale der Live-Aufnahme mit den hochgeladenen Trainingsdaten. Stimmen diese nicht überein – etwa wenn jemand die Stimme eines Prominenten klonen will – wird der Prozess blockiert.

No-Go List und AI Classifier

Stimmen von Politikern und hochriskanten Personen des öffentlichen Lebens sind systemseitig gesperrt. Zusätzlich stellt ElevenLabs einen AI Classifier bereit, mit dem überprüft werden kann, ob eine Audiodatei von der ElevenLabs-KI generiert wurde. Das Unternehmen unterstützt außerdem den C2PA-Standard, um Metadaten über die synthetische Herkunft direkt in Mediendateien einzubetten.

Aktuelle Updates (Januar 2026)

Eleven v3 im Alpha-Status

Das neueste Modell setzt neue Maßstäbe bei synthetischen Emotionen. Audio-Tags ermöglichen Regieanweisungen wie Lachen, Seufzen oder Zögern. Noch ist v3 aber nicht stabil genug für den Produktionseinsatz in Echtzeit.

Scribe v2 für Echtzeit-Transkription

Mit Scribe v2 bietet ElevenLabs erstmals eine eigene Spracherkennung an – mit unter 150 ms Latenz, über 90 Sprachen und automatischer Erkennung von Sprachwechseln.

Partnerschaft mit ESTsoft (Perso.ai)

Die Kooperation verbindet ElevenLabs‘ Stimmsynthese mit der frame-genauen Lippensynchronisation von ESTsoft. Das Ziel: Das „Uncanny Valley“ bei synchronisierten Videoinhalten endgültig schließen.

Deprecation älterer Modelle

ElevenLabs hat im Dezember 2025 alle V1-Modelle abgeschaltet. Im Januar 2026 folgte das beliebte „English v2″-Modell. Nutzer müssen ihre Workflows kontinuierlich migrieren – neue Modelle klingen oft anders als ihre Vorgänger.

FAQ

Was kostet ElevenLabs? Es gibt einen kostenlosen Plan mit 10.000 Zeichen (~10 Minuten Audio). Bezahlpläne starten bei 5 $/Monat (Starter) und reichen bis 1.320 $/Monat (Business). Für professionelle Produktionen mit unkomprimiertem Audio brauchst du mindestens den Pro-Plan für 99 $/Monat. Bedenke den Regenerations-Multiplikator: Plane 2,2x–2,8x der benötigten Credits ein.

Kann man mit ElevenLabs deutsche Stimmen erstellen? Ja. Die Modelle Multilingual v2 und Eleven v3 unterstützen Deutsch. Die Voice Library enthält zudem regionale Akzente wie Bayerisch oder Sächsisch, wobei die Authentizität variiert.

Wie funktioniert Voice Cloning bei ElevenLabs? Es gibt zwei Stufen: Instant Voice Cloning braucht nur 1–5 Minuten Audio und liefert sofort Ergebnisse. Professional Voice Cloning benötigt 30 Minuten bis 3 Stunden hochwertiges Material, liefert dafür hyperrealistische Ergebnisse. Für PVC musst du per Live-Aufnahme verifizieren, dass es deine eigene Stimme ist.

Welches Modell eignet sich für Hörbücher? Multilingual v2 ist die sicherste Wahl für lange Produktionen. Es liefert konsistente Qualität über Stunden. Eleven v3 klingt emotionaler, ist aber im Alpha-Status noch zu instabil für 10-Stunden-Narrationen.

Gibt es eine kostenlose Version? Ja, der Free-Plan bietet 10.000 Zeichen pro Monat. Einschränkungen: Nur 32 kbps Audioqualität, Attribution-Pflicht und maximal 3 Custom Voices.

Wie gut sind die regionalen Dialekte (Bayerisch, Sächsisch)? ElevenLabs bietet zunehmend regionale Stimmen an. Die Qualität ist unterschiedlich – bayerische Stimmen existieren, erfordern aber oft Experimentieren. Sächsische Stimmen wie Ronny Ratze oder Tony Saxon sind neuere Ergänzungen und auf einem guten Weg, aber noch nicht perfekt.

Fazit + Nächste Schritte

ElevenLabs ist im Januar 2026 der Goldstandard für KI-generierte Stimmen. Die Stärken sind klar: unerreichte Stimmqualität (besonders mit Eleven v3), breite Sprachunterstützung mit über 70 Sprachen und ein umfassendes Ökosystem aus Dubbing Studio, Voice Cloning, Transkription und API.

Die Schwächen solltest du aber kennen: Die realen Produktionskosten liegen durch notwendige Regenerationen deutlich über den Listenpreisen. Das Credit-System ist für Einsteiger undurchsichtig. Und für extrem preissensitive Echtzeit-Anwendungen könnte ein Wettbewerber wie Cartesia die bessere Wahl sein.

Wenn du ElevenLabs ausprobieren willst, starte mit dem kostenlosen Plan und teste verschiedene Stimmen und Modelle. Für ernsthafte Projekte empfiehlt sich direkt der Pro-Plan – allein wegen des unkomprimierten Audio-Outputs. Entwickler sollten früh die API-Dokumentation und die Concurrency Limits studieren, um später keine bösen Überraschungen zu erleben.