Fazit vorweg: Lohnt sich DeepSeek V3?

DeepSeek V3 ist eine der größten Überraschungen der KI-Branche. Das chinesische Labor hat ein Modell gebaut, das mit GPT-4o und Claude 3.5 Sonnet auf Augenhöhe liegt – bei einem Bruchteil der Kosten. Die API ist bis zu 20-mal günstiger als bei OpenAI, die Modelle sind Open Weight und lassen sich lokal betreiben.

Der Haken: Daten fließen über die offizielle API nach China, politische Themen werden zensiert, und die DSGVO-Konformität ist bei Cloud-Nutzung nicht gegeben. Wer DeepSeek schlau einsetzt – nämlich lokal oder nur mit unkritischen Daten – bekommt allerdings Weltklasse-KI zum Schnäppchenpreis.

Technisch brillant, politisch kompliziert. So lässt sich DeepSeek V3 am besten zusammenfassen.

DeepSeek V3 im Steckbrief

| Eigenschaft | Details |

|---|---|

| Entwickler | DeepSeek (China), gegründet von Liang Wenfeng |

| Mutterkonzern | High-Flyer (Hedgefonds) |

| Architektur | Mixture-of-Experts (MoE) |

| Parameter gesamt | 671 Milliarden |

| Parameter aktiv pro Token | 37 Milliarden |

| Kontextlänge | 128k Tokens (V3), bis zu 4 Mio. Tokens (V3.2) |

| Open Weights | Ja |

| Trainingskosten | ca. 5,5 Mio. US-Dollar |

| API verfügbar | Ja |

| Kostenloser Chat | Ja, über chat.deepseek.com |

| Aktuelle Version (Jan 2026) | V3.2 (Exp und Speciale) |

Preise & Versionen

Kostenloser Zugang über Chat

DeepSeek bietet über die Weboberfläche chat.deepseek.com und die mobile App kostenlosen Zugriff auf V3 und das Reasoning-Modell R1. Es gibt Fair-Use-Limits, und bei hoher Last kann es zu Wartezeiten kommen. Finanziert wird das Ganze durch das Kapital des Mutterkonzerns High-Flyer.

API-Preise im Detail

Die API-Preise von DeepSeek sind aggressiv niedrig und haben einen echten Preiskampf in der Branche ausgelöst.

| Modell | Input (Cache Miss) | Input (Cache Hit) | Output |

|---|---|---|---|

| DeepSeek V3 (Chat) | $0,27 / 1M Tokens | $0,07 / 1M Tokens | $1,10 / 1M Tokens |

| DeepSeek R1 (Reasoner) | $0,55 / 1M Tokens | – | $2,19 / 1M Tokens |

Besonders interessant ist der Cache-Hit-Preis von nur $0,07 pro Million Tokens. Wer DeepSeek V3 für RAG-Anwendungen (Retrieval Augmented Generation) nutzt, bei denen der Systemkontext häufig gleich bleibt, zahlt fast nichts für den Input.

Vergleich mit OpenAI und Anthropic

Ein Unternehmen, das täglich Millionen Dokumentenseiten analysiert, kann durch den Wechsel zu DeepSeek V3 seine monatlichen KI-Kosten von 50.000 € auf unter 2.000 € senken. OpenAIs o1-Modell und GPT-4o kosten oft das 10- bis 20-Fache. Das ist der ökonomische Hebel, der DeepSeek für viele Anwendungsfälle unwiderstehlich macht.

Der strategische Vergleich mit westlichen Anbietern wird erst richtig greifbar, wenn du dir im Detail anschaust, wie sich OpenAI und Anthropic positionieren – genau das liefert der Überblick zu OpenAI vs. Anthropic im direkten Modellvergleich.

Die Technik hinter DeepSeek V3

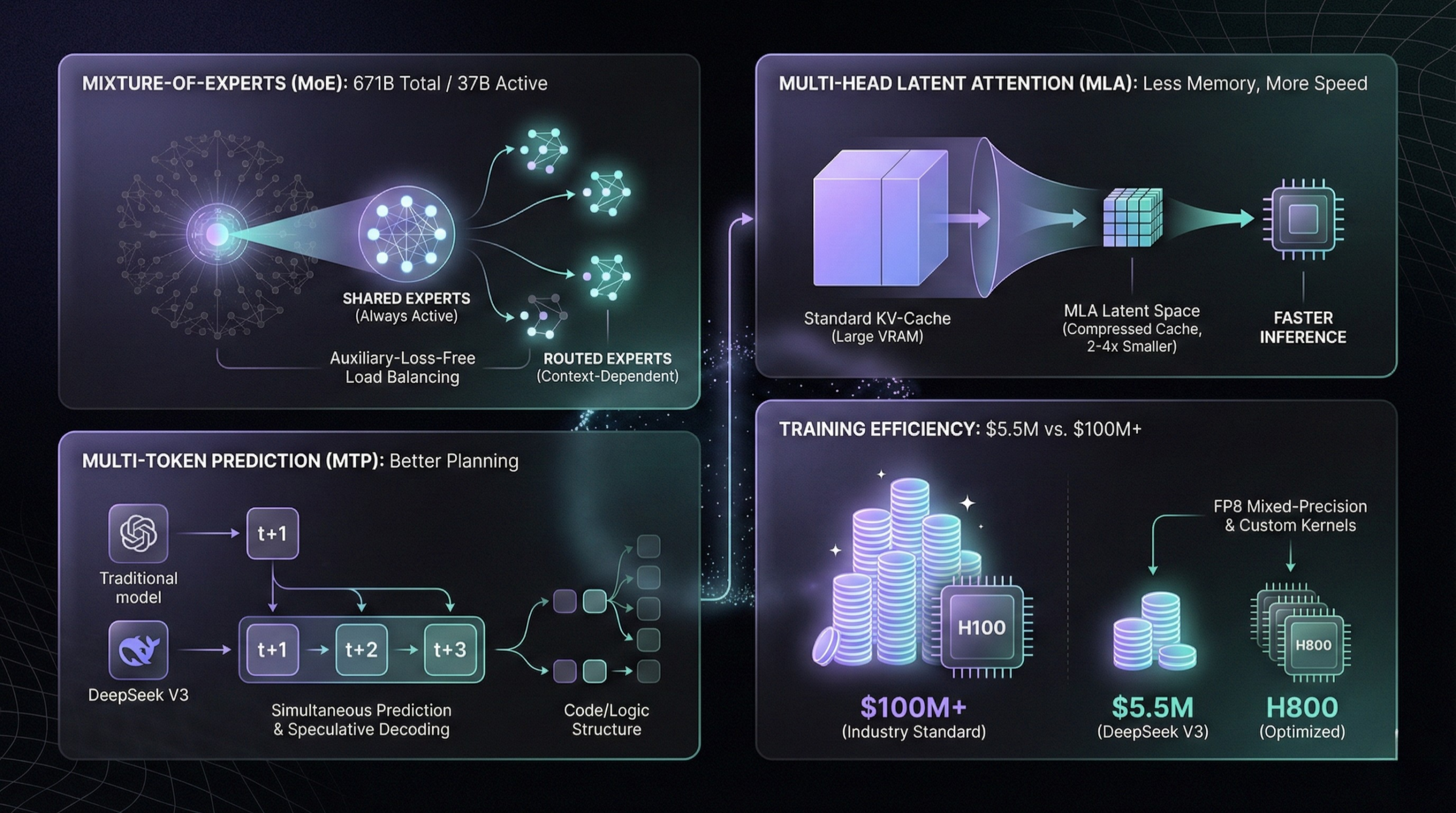

Mixture-of-Experts (MoE): 671 Milliarden Parameter, nur 37 aktiv

DeepSeek V3 ist ein sogenanntes Mixture-of-Experts-Modell. Das bedeutet: Es hat zwar 671 Milliarden Parameter, aber pro Token werden nur 37 Milliarden davon aktiviert. Der Rest bleibt „schlafend“. Bei dichten Modellen wie Llama 3.1 405B wird dagegen für jedes Wort das gesamte Netz durchlaufen.

Das Besondere an DeepSeeks MoE-Architektur ist die Unterscheidung zwischen zwei Arten von Experten:

Shared Experts sind immer aktiv und speichern allgemeines Weltwissen sowie grundlegende Sprachstrukturen. Sie sorgen dafür, dass das Modell auch bei seltenen Themen kohärent bleibt.

Routed Experts sind hochspezialisierte Sub-Netzwerke, die dynamisch je nach Kontext hinzugeschaltet werden. Ob Rust-Code oder französische Lyrik – das Modell aktiviert nur die Experten, die gerade gebraucht werden.

Ein weiterer technischer Durchbruch ist das sogenannte Auxiliary-Loss-Free Load Balancing. In klassischen MoE-Systemen neigen die Router dazu, immer dieselben starken Experten zu nutzen, was zu einem Ungleichgewicht führt. Normalerweise wird das durch einen künstlichen Strafterm in der Verlustfunktion korrigiert, der aber die Modellqualität verschlechtert. DeepSeek V3 löst das Problem eleganter: durch eine Bias-Anpassung direkt im Routing-Mechanismus, ganz ohne Hilfsverlust.

Multi-head Latent Attention (MLA): Weniger Speicher, mehr Speed

MLA ist die vielleicht wichtigste Innovation für die Inferenz-Effizienz. Das Problem: Bei langen Texten wächst der sogenannte Key-Value-Cache (KV-Cache) linear mit der Textlänge. Bei 128k Tokens Kontext belegt dieser Cache bei großen Modellen hunderte Gigabyte VRAM.

DeepSeeks Lösung: Anstatt vollständige Key- und Value-Vektoren zu speichern, projiziert MLA diese in einen komprimierten latenten Raum. Während der Inferenz werden die Vektoren on-the-fly rekonstruiert. Das reduziert den Speicherbedarf für den KV-Cache um den Faktor 2 bis 4 im Vergleich zu Standard-Multi-Head-Attention.

In der Praxis bedeutet das: DeepSeek V3 kann auf Hardware mit begrenztem Speicher deutlich längere Kontexte und mehr parallele Anfragen verarbeiten als Konkurrenzmodelle gleicher Größe.

Multi-Token Prediction (MTP)

Klassische Sprachmodelle werden darauf trainiert, immer nur das nächste Token vorherzusagen. DeepSeek V3 lernt, mehrere zukünftige Tokens gleichzeitig zu antizipieren. Das bringt zwei Vorteile.

Erstens verbessert es die Planung: Das Modell muss lokale Strukturen und Abhängigkeiten besser verstehen, um korrekte Vorhersagen für Token t+2 oder t+3 zu treffen. Das hilft besonders bei Code (Klammern schließen) und logischen Argumentationen.

Zweitens beschleunigt es die Inferenz: In der Anwendung kann dieser Mechanismus für Speculative Decoding genutzt werden. Das Modell schlägt einen ganzen Block von Tokens vor, der dann in einem einzigen Verifikationsschritt validiert wird.

Trainingskosten: 5,5 Millionen Dollar statt 100 Millionen

Die Zahl, die die westliche KI-Welt erschütterte: DeepSeek V3 wurde für lediglich 5,576 Millionen US-Dollar trainiert. Zum Vergleich: Das Training von GPT-4 wird auf über 100 Millionen Dollar geschätzt.

Erreicht wurde das durch die Kombination aus MoE-Effizienz, einem FP8-Mixed-Precision-Framework (Training in 8-Bit-Präzision ohne Konvergenzprobleme) und maßgeschneiderten Kernels für die Inter-GPU-Kommunikation. Die Ursache für diese Effizienz liegt auch in den US-Exportbeschränkungen: DeepSeek musste auf älterer Hardware (H800 statt H100) trainieren und entwickelte deshalb Algorithmen, die mit weniger Speicherbandbreite auskommen. Diese „Notlösungen“ erwiesen sich als überlegene Architekturen.

DeepSeek V3 in der Praxis

Coding und Softwareentwicklung

Coding war schon immer eine Stärke von DeepSeek (durch die spezialisierte „DeepSeek Coder“-Linie). DeepSeek-V3.2 erreicht auf dem HumanEval-Benchmark einen Pass@1-Score von 82,6 % und übertrifft damit GPT-4o (ca. 80,5 %). Auf dem schwierigeren LiveCodeBench mit Aufgaben aus echten Wettbewerben liegt V3.2 bei 74,1 %.

Entwickler berichten, dass V3.2 besonders stark bei der Refaktorisierung von Legacy-Code und der Generierung von Unit-Tests ist. Die R1-Variante glänzt bei algorithmischen Problemen, neigt aber dazu, bei einfachen Aufgaben zu „overthinken“ und unnötig komplexe Lösungen zu produzieren.

Mathematik und logisches Denken

Hier dominiert DeepSeek. Auf dem MATH-500-Benchmark erreicht die V3.2-Speciale-Variante 90,2 %, GPT-4o liegt bei 74,6 %. Bei den Aufgaben der amerikanischen Mathematik-Olympiade (AIME 2024) kommt R1 auf 79,8 % bis 83,3 % – auf Augenhöhe mit OpenAIs o1.

Das liegt am Reinforcement-Learning-Ansatz: R1 wurde nicht mit menschlichen Lösungswegen trainiert, sondern entwickelte seine Reasoning-Strategien eigenständig durch Trial-and-Error.

Gerade wenn du regelmäßig mit GPT-4o arbeitest, lohnt sich ein Blick in die Infos rund um ChatGPT, um Preisstruktur, Funktionsumfang und Modellvarianten sauber mit DeepSeek V3 abzugleichen. So erkennst du schnell, ob dich eher Features wie multimodale Eingaben oder Ökosystem-Integration binden – oder ob der massive Preisvorteil von DeepSeek dein Setup wirtschaftlich sinnvoller macht.

Texte auf Deutsch

Ein häufiger Kritikpunkt an chinesischen Modellen war die schwache Leistung in westlichen Sprachen. Das ist bei DeepSeek V3 nicht mehr der Fall. Im MMLU-Benchmark erreicht V3 88,5 % – praktisch gleichauf mit Claude 3.5 Sonnet (88,3 %) und GPT-4o (87,2 %).

In spezifischen Tests zur deutschen Sprache (u. a. MMLU-Redux German) zeigt DeepSeek V3 eine Kompetenz von 80–85 %. Nutzerberichte bestätigen, dass das Modell Nuancen der deutschen Grammatik und des Stils exzellent beherrscht – die Unterscheidung zwischen „Sie“ und „Du“, Fachterminologie, und es vermeidet das „Denglisch“, das bei schlecht lokalisierten Modellen häufig auftritt.

Lange Kontexte und Dokumentenanalyse

Mit der V3.2-Version hat DeepSeek durch Sparse Attention (DSA) die Verarbeitung extrem langer Kontexte deutlich verbessert. Statt alle Tokens in die Berechnung einzubeziehen, analysiert ein leichter Router, welche Teile des Textes tatsächlich relevant sind. Nur die wichtigsten Blöcke werden berücksichtigt, der Rest wird übersprungen.

Das Ergebnis: V3.2 kann theoretisch Kontexte von bis zu 4 Millionen Tokens verarbeiten. Effektiv getestet ist die Verarbeitung bis zu 1 Million Tokens. Für Unternehmen, die große Dokumentenmengen analysieren, ist das ein relevanter Vorteil.

DeepSeek R1: Das Reasoning-Modell

Chain-of-Thought: So denkt R1

DeepSeek R1 ist das Pendant zu OpenAIs o1-Serie. Der Fokus liegt nicht auf allgemeiner Sprachkompetenz, sondern auf logischem Schließen. Das Besondere: R1 macht seinen Denkprozess transparent. In sogenannten Thinking-Tags zeigt das Modell, wie es ein Problem analysiert, Hypothesen prüft und verwirft, bevor es die finale Antwort gibt.

Die bahnbrechende Erkenntnis bei der Entwicklung war, dass diese Fähigkeiten emergent entstehen können. DeepSeek trainierte eine frühe Version (R1-Zero) ohne jedes menschliche Vorbild für Lösungswege. Das Modell bekam nur eine Belohnung, wenn das Endergebnis korrekt war. Daraufhin begann es selbstständig, lange interne Monologe zu entwickeln – mit Selbstverifikation („Wait, let me check that again“) und Backtracking („This approach leads to a contradiction“).

Destillierte Modelle für den lokalen Betrieb

Strategisch besonders wichtig: DeepSeek hat die Reasoning-Fähigkeiten von R1 in kleinere Modelle destilliert. Das große 671B-Modell generierte Millionen hochwertiger Trainingsbeispiele (Frage + Gedankenkette + Antwort), mit denen kleinere Open-Source-Modelle nachtrainiert wurden.

| Modell | Basis | VRAM (4-Bit) | Empfohlene Hardware |

|---|---|---|---|

| R1-Distill-Qwen-1.5B | Qwen 2.5 | ca. 1–2 GB | Jeder moderne PC |

| R1-Distill-Qwen-7B | Qwen 2.5 | ca. 5 GB | RTX 3060 / MacBook M1 16 GB |

| R1-Distill-Qwen-14B | Qwen 2.5 | ca. 10 GB | RTX 4070 / MacBook M2 16 GB |

| R1-Distill-Qwen-32B | Qwen 2.5 | ca. 20–22 GB | RTX 3090 / RTX 4090 (24 GB) |

| R1-Distill-Llama-8B | Llama 3 | ca. 5–6 GB | RTX 3060 / Gaming-Laptop |

| R1-Distill-Llama-70B | Llama 3 | ca. 40–48 GB | 2x RTX 4090 / RTX 6000 Ada / Mac Studio M2 Ultra 64 GB+ |

Das 32B-Qwen-Modell gilt als der Sweet Spot: Es läuft auf einer einzelnen RTX 4090 mit 30–50 Tokens pro Sekunde und liefert bei Mathe- und Code-Aufgaben Ergebnisse, die GPT-4o nahekommen.

DeepSeek V3.2 und der Ausblick auf V4

Sparse Attention (DSA) für Millionen-Token-Kontexte

Die zentrale Neuerung von V3.2 ist DeepSeek Sparse Attention (DSA). Selbst mit MLA steigen die Rechenkosten der Attention-Mechanik quadratisch mit der Textlänge. Bei Kontexten von 1 Million Tokens wird das unbezahlbar.

DSA löst das durch einen dynamischen Indexing-Mechanismus. Für jedes zu generierende Token analysiert ein leichter Router, welche Teile des bisherigen Textes relevant sind. Nur die Top-k relevantesten Blöcke (z. B. 2.048) werden in die Berechnung einbezogen. Das reduziert die Komplexität von quadratisch auf effektiv linear.

V3.2-Speciale vs. V3.2-Exp

DeepSeek hat sein Portfolio mit V3.2 in zwei Varianten aufgeteilt:

V3.2-Exp (Experimental) ist der Allrounder für den täglichen Gebrauch. Es balanciert Geschwindigkeit und Qualität, ideal für Chatbots und Dokumentenanalyse. Es nutzt DSA aggressiv für maximale Effizienz.

V3.2-Speciale ist auf Hard Reasoning optimiert und konkurriert mit Google Gemini 3.0 Pro. Es erreicht Gold-Medaillen-Niveau bei der Informatik-Olympiade (IOI 2025). Der Nachteil: Es verbraucht extrem viele Tokens für den internen Denkprozess und ist daher teurer und langsamer.

MoE, MLA, Sparse Attention – all das baut auf der Transformer-Logik auf. Wenn du die Mechanik dahinter wirklich durchdringen willst, lohnt sich ein Blick auf die Transformer-Architektur einfach erklärt.

Engram-Architektur: Was V4 bringen könnte

Im Januar 2026 verdichten sich die Hinweise auf DeepSeek V4, das voraussichtlich Mitte Februar 2026 erscheint. Ein Forschungspapier beschreibt eine neue Architektur namens „Engram“, die statisches Faktenwissen in einen externen, hash-basierten Lookup-Speicher auslagert. Das neuronale Netz konzentriert sich dann rein auf Logik und Verarbeitung.

Die Vorteile wären erheblich: kleinere Modelle, schnellere Inferenz, trivial aktualisierbares Wissen – und potenziell deutlich weniger Halluzinationen bei Faktenabfragen. In DeepSeeks GitHub-Repositories wurden bereits Referenzen auf ein „MODEL1“ gefunden, das die Engram-Architektur mit neuen Optimierungen kombiniert.

Vorteile von DeepSeek V3

Extrem günstige API-Preise

DeepSeeks API-Preise sind bis zu 20-mal günstiger als bei OpenAI. Besonders der Cache-Hit-Preis von $0,07 pro Million Tokens macht das Modell für datenintensive Anwendungen attraktiv.

Sobald du nicht nur Modelle vergleichen, sondern eine echte Kaufentscheidung treffen willst, hilft dir der umfassende Guide zu den besten KI-APIs nach Preis-Leistung. Dort siehst du, wie DeepSeek im API-Kostenvergleich abschneidet und welche Anbieter bei bestimmten Workloads – etwa RAG oder Massenanalyse – wirtschaftlich wirklich dominieren.

Open Weights – lokaler Betrieb möglich

Alle DeepSeek-Modelle sind als Open Weights verfügbar. Unternehmen können sie herunterladen, lokal hosten und ohne jede Verbindung zu DeepSeeks Servern betreiben. Kein Datenabfluss, keine API-Kosten, volle Kontrolle.

Starke Benchmark-Ergebnisse auf Augenhöhe mit GPT-4o

Im MMLU liegt DeepSeek V3 bei 88,5 %, im Coding bei 82,6 % (HumanEval) und im Reasoning mit R1 deutlich vor GPT-4o. Die Leistungsunterschiede zu den westlichen Top-Modellen sind in den meisten Kategorien marginal.

Destillierte Modelle für Consumer-Hardware

Dank Destillation laufen leistungsfähige Reasoning-Modelle auf einer einzelnen RTX 4090. Das R1-Distill-Qwen-32B ist das beliebteste Modell für lokale Inferenz und liefert GPT-4o-nahe Ergebnisse auf dem eigenen Rechner.

Nachteile von DeepSeek V3

Datenschutz: Daten gehen nach China

Wer die offizielle API oder die Chat-Oberfläche nutzt, schickt seine Daten an Server in der Volksrepublik China. DeepSeeks Privacy Policy räumt ein, dass Daten auf Anfrage an chinesische Sicherheitsbehörden herausgegeben werden können. Für personenbezogene Daten von EU-Bürgern ist das ein klares Problem.

Zensur bei politischen Themen

DeepSeek-Modelle unterliegen der Zensur der KPCh. Fragen zum Tiananmen-Massaker, zur Unabhängigkeit Taiwans oder zu Kritik an Xi Jinping werden verweigert oder mit staatstragenden Narrativen beantwortet. Die Zensur ist tief im Modell verankert (durch RLHF und Safety-Filter). Für technische Aufgaben wie Code und Mathe ist das irrelevant. Für journalistische oder historische Analysen disqualifiziert sich das Modell als objektive Quelle.

Volles 671B-Modell lokal kaum praktikabel

Das volle DeepSeek-V3-Modell mit 671 Milliarden Parametern braucht selbst in FP8-Quantisierung ca. 676 GB VRAM. Das erfordert Cluster aus mindestens 8 NVIDIA H100 GPUs. Für Einzelnutzer und die meisten Unternehmen ist nur der Betrieb der destillierten Modelle realistisch.

DSGVO-Konformität bei API-Nutzung nicht gegeben

Die italienische Datenschutzbehörde hat DeepSeek bereits im Januar 2025 vorläufig verboten. Für China gibt es keinen Angemessenheitsbeschluss der EU-Kommission nach DSGVO Art. 44 ff. Die Nutzung der DeepSeek-API für personenbezogene Daten von EU-Bürgern ist für Unternehmen praktisch nicht DSGVO-konform möglich.

Für wen eignet sich DeepSeek V3?

Entwickler und technische Teams

DeepSeek V3 und R1 sind hervorragend für Coding, Code-Review, Unit-Test-Generierung und algorithmische Problemlösung. Die Kombination aus starker technischer Leistung und niedrigen Kosten macht es zum idealen Tool für Entwicklerteams – besonders bei lokaler Nutzung.

Unternehmen mit Datenschutz-Anforderungen (On-Premise)

Der wahre Wert von DeepSeek für europäische Unternehmen liegt in den Open Weights. Die Modelle lassen sich herunterladen und in einer isolierten europäischen Cloud oder On-Premise hosten. Kein Datenabfluss nach China, keine API-Abhängigkeit. Use Cases: interne Wissensdatenbanken, Coding-Assistenten, Analyse sensibler Dokumente.

Forscher und Einzelnutzer mit begrenztem Budget

Der kostenlose Chat-Zugang und die extrem günstigen API-Preise machen DeepSeek zur besten Option für Nutzer, die Weltklasse-KI ohne Abo-Kosten wollen. Die destillierten Modelle erlauben es Forschern, auf dem eigenen Laptop mathematische Beweise zu führen oder Code zu refaktorisieren.

DeepSeek V3 vs. GPT-4o vs. Claude 3.5 Sonnet

| Benchmark | DeepSeek V3.2 | GPT-4o | Claude 3.5 Sonnet | DeepSeek R1 |

|---|---|---|---|---|

| MMLU (Wissen) | 88,5 % | 87,2 % | 88,3 % | 90,8 % |

| MATH-500 | 90,2 % | 74,6 % | – | 96,4 % |

| HumanEval (Code) | 82,6 % | 80,5 % | 92,0 % | – |

| GPQA Diamond (Experten) | 59,1 % | 53,6 % | – | 71,5 % |

| LiveCodeBench | 74,1 % | – | – | 57,2 % |

| API-Preis (Input/1M Tokens) | ab $0,07 | ab $2,50 | ab $3,00 | $0,55 |

DeepSeek V3.2 liegt in den meisten Benchmarks auf Augenhöhe mit GPT-4o und Claude 3.5 Sonnet. Beim Reasoning (MATH-500, GPQA) ist DeepSeek R1 den westlichen Generalisten deutlich überlegen. Beim Coding führt Claude 3.5 Sonnet, dicht gefolgt von DeepSeek. Der größte Unterschied liegt beim Preis: DeepSeek ist um ein Vielfaches günstiger.

Fazit: Technisch brillant, politisch kompliziert

DeepSeek V3 hat bewiesen, dass Weltklasse-KI nicht von US-Monopolen abhängt und dass algorithmische Effizienz wichtiger ist als schiere Rechenpower. Für 5,5 Millionen Dollar hat ein chinesisches Startup ein Modell trainiert, das es mit Systemen aufnimmt, die das 20-Fache gekostet haben.

Für europäische Unternehmen ergibt sich eine klare Strategie: Die offizielle API und den Chat niemals für sensible Daten nutzen. Stattdessen die Open-Weight-Modelle herunterladen, lokal oder in einer europäischen Cloud hosten und so volle Datenkontrolle behalten. Für unkritische Massendaten ohne Personenbezug kann die API wegen des extremen Preisvorteils genutzt werden.

Mit der bevorstehenden V4-Architektur („Engram“) könnte der nächste große Sprung bevorstehen. Für Europa bietet DeepSeek eine paradoxe Chance: durch chinesische Technologie mehr digitale Souveränität zu erlangen – indem man die Technologie nutzt, aber die Verbindung zum Hersteller kappt.

FAQ

Ist DeepSeek V3 kostenlos?

Ja. Über chat.deepseek.com und die App ist DeepSeek V3 kostenlos nutzbar. Es gibt Fair-Use-Limits und bei hoher Last Wartezeiten. Die API ist extrem günstig, aber nicht kostenlos – die Preise beginnen bei $0,07 pro Million Tokens (Cache Hit).

Kann ich DeepSeek V3 lokal betreiben?

Ja, über die Open-Weight-Downloads. Das volle 671B-Modell braucht allerdings ca. 676 GB VRAM und ist für Einzelnutzer nicht praktikabel. Die destillierten Modelle sind die bessere Wahl: Das R1-Distill-Qwen-32B läuft auf einer RTX 4090, das 8B-Modell sogar auf einem Gaming-Laptop.

Ist DeepSeek V3 DSGVO-konform?

Nicht bei Nutzung der offiziellen API oder des Chats. Daten werden auf Servern in China gespeichert, es gibt keinen EU-Angemessenheitsbeschluss, und chinesische Behörden können Zugriff auf die Daten verlangen. Lokaler Betrieb der Open-Weight-Modelle umgeht dieses Problem vollständig.

Wie schneidet DeepSeek V3 im Vergleich zu ChatGPT ab?

In den meisten Benchmarks liegt DeepSeek V3.2 auf Augenhöhe mit GPT-4o. Beim mathematischen Reasoning ist DeepSeek R1 deutlich stärker. Beim Coding liegt DeepSeek knapp hinter spezialisierten Modellen wie Claude 3.5 Sonnet. Der größte Unterschied: DeepSeek ist bis zu 20-mal günstiger.

Welche Hardware brauche ich für DeepSeek R1 lokal?

Für das beliebteste Modell (R1-Distill-Qwen-32B) brauchst du eine GPU mit 24 GB VRAM, also eine RTX 3090 oder RTX 4090. Das 8B-Modell läuft ab ca. 6 GB VRAM auf fast jeder modernen GPU oder einem MacBook Pro mit M1/M2/M3 und 16 GB RAM.

Was ist der Unterschied zwischen DeepSeek V3 und R1?

DeepSeek V3 ist der Generalist – schnell, vielseitig, günstig, ideal für Chat, Textverarbeitung und Code. R1 ist das Reasoning-Modell, optimiert für logisches Denken, Mathematik und komplexe Problemlösung. R1 zeigt seinen Denkprozess transparent in Chain-of-Thought-Tags, braucht dafür aber mehr Tokens und ist langsamer.